Rédaction : Kuli, Deep Tide TechFlow

Titre original : Le peuple a besoin d'un mauvais capitaliste, l'IA a fabriqué une rumeur sur la livraison de repas

Il s'est passé quelque chose de plutôt fantastique la semaine dernière.

Les PDG de deux géants américains de la livraison de repas, l'un valant 2,7 milliards de dollars, l'autre dirigeant la plus grande plateforme de VTC au monde, n'ont pas dormi samedi à l'aube, écrivant des textes de justification en ligne pour se blanchir.

La cause : un post anonyme sur Reddit.

La personne qui a posté prétendait être un ingénieur backend d'une grande plateforme de livraison de repas, ivre, se connectant en Wi-Fi public à la bibliothèque pour divulguer des informations.

Le contenu était à peu près :

L'entreprise analyse la situation des chauffeurs de VTC, puis leur attribue un « score de désespoir », plus le chauffeur est désespéré financièrement, moins il reçoit de bonnes commandes ; la prétendue livraison prioritaire des repas est fausse, les commandes ordinaires sont retardées ; divers « frais de bien-être des chauffeurs » n'ont pas été versés aux chauffeurs, mais utilisés pour lobbying au Congrès contre les syndicats...

La fin du post était très réaliste : je suis ivre, je suis en colère, donc je divulgue.

Se présentant parfaitement comme un lanceur d'alerte dénonçant « les grandes entreprises qui exploitent les chauffeurs avec des algorithmes ».

Le post a obtenu 87 000 likes en trois jours, atteignant la page d'accueil de Reddit. Certains l'ont également partagé sur X, générant 36 millions d'impressions.

Il faut savoir que le marché américain de la livraison de repas n'a que quelques grands acteurs. Le post ne nommait personne, mais tout le monde devinait qui c'était.

Tony Xu, PDG de DoorDash, n'a pas tenu le coup le premier, tweetant que ce n'était pas eux, et qu'il licencierait quiconque ferait une telle chose. Le COO d'Uber a également répondu : « Ne croyez pas tout ce que vous voyez en ligne ».

DoorDash a même publié une déclaration en cinq points sur son site officiel, réfutant point par point le contenu des fuites. Ces deux entreprises, valant ensemble plus de 80 milliards de dollars, ont été contraintes de faire des clarifications publiques en urgence à cause d'un post anonyme.

Ensuite, ce post s'est avéré avoir été fabriqué par une IA.

C'est Casey Newton, journaliste du média technologique海外 Platformer, qui l'a révélé.

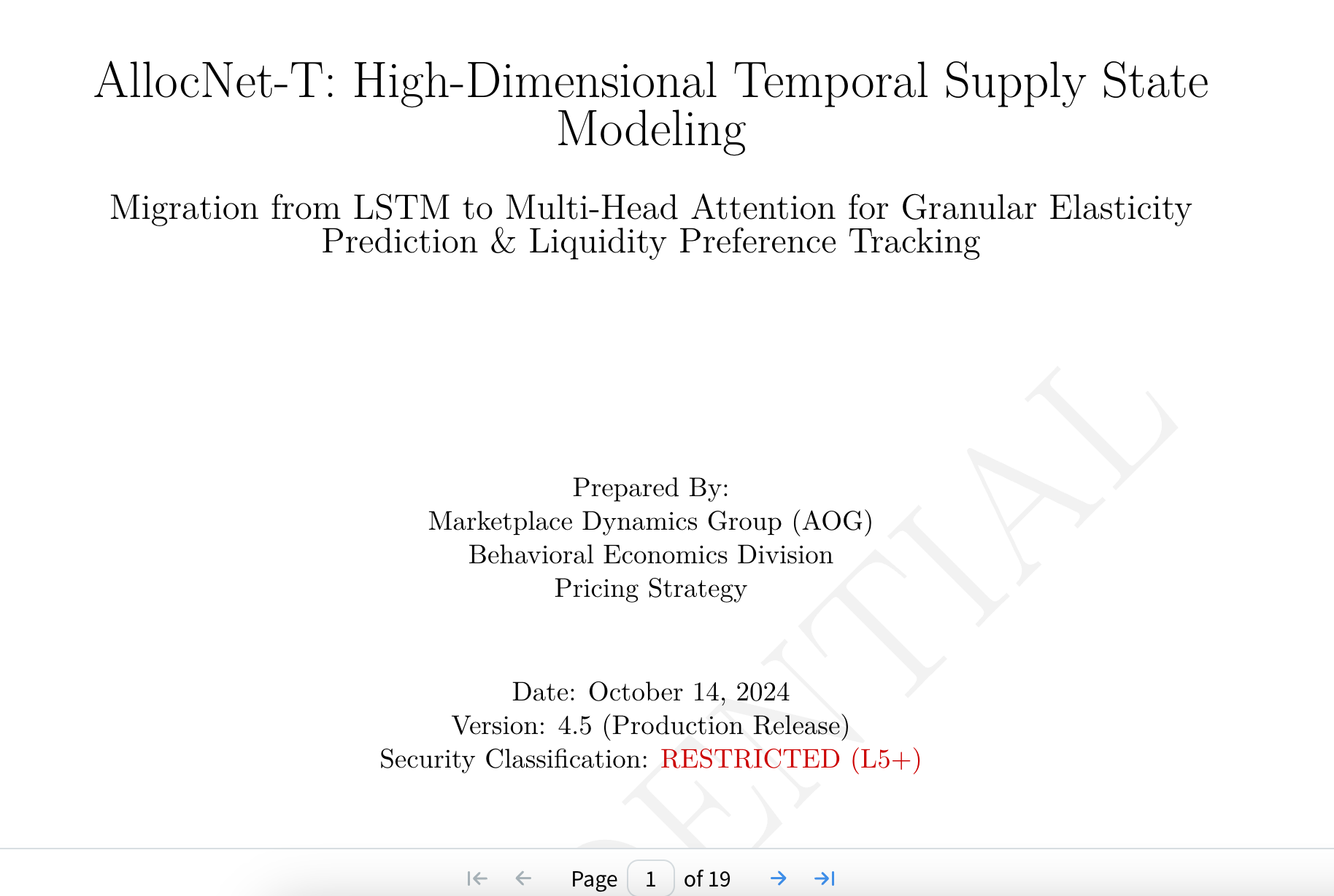

Il a contacté la source du post, qui lui a immédiatement envoyé un « document technique interne » de 18 pages, au titre très académique : « AllocNet-T: High-Dimensional Temporal Supply State Modeling ».

Traduit approximativement par « Modélisation de l'état d'approvisionnement temporel en haute dimension ». Chaque page portait un filigrane « confidentiel », attribué au « Groupe de dynamique de marché · Département d'économie comportementale » d'Uber.

Le contenu expliquait comment le modèle mentionné dans le post Reddit, qui attribue un « score de désespoir » aux chauffeurs, était réellement calculé. Il y avait des diagrammes d'architecture, des formules mathématiques, des flux de données...

(Capture d'écran du faux article, à première vue, cela semblait réel)

Newton a déclaré que ce document l'avait initialement trompé. Qui prendrait la peine de falsifier 18 pages de documentation technique pour piéger un journaliste ?

Mais maintenant, c'est différent.

Ces 18 pages de documentation peuvent être générées par une IA en quelques minutes.

Simultanément, la source a également envoyé au journaliste une photo floutée de son badge d'employé Uber, prouvant qu'il travaillait bien chez eux.

Par curiosité, le journaliste Newton a soumis la photo du badge à Google Gemini pour vérification, et Gemini a indiqué que l'image était générée par IA.

La raison pour laquelle cela a pu être détecté est que Google a intégré un filigrane invisible, appelé SynthID, dans le contenu généré par son IA, invisible à l'œil nu mais détectable par machine.

Plus absurde, le badge portait le logo « Uber Eats ».

Un porte-parole d'Uber a confirmé : « Nous n'avons pas de badges à la marque Uber Eats, tous les badges portent uniquement le logo Uber. »

De toute évidence, ce faux « lanceur d'alerte » ne savait même pas qui il voulait attaquer. Lorsque le journaliste a demandé des informations sur les comptes de réseaux sociaux comme LinkedIn pour vérification ultérieure,

la source a directement supprimé son compte et a fui.

En réalité, nous ne voulons pas parler de la capacité de l'IA à falsifier, ce n'est pas nouveau.

Nous voulons plutôt discuter de : pourquoi des dizaines de millions de personnes sont-elles prêtes à croire un post de divulgation anonyme ?

En 2020, DoorDash a été poursuivi pour avoir utilisé les pourboires pour compenser le salaire de base des chauffeurs et a payé 16,75 millions de dollars d'indemnités. Uber a développé un outil appelé Greyball pour échapper spécifiquement à la régulation. Ce sont des faits réels.

Il est facile de trouver une identification subconsciente, à savoir : les plateformes ne sont pas des entités bienveillantes, ce jugement ne peut pas se tromper.

Donc, quand quelqu'un dit « l'algorithme de la plateforme de livraison exploite les chauffeurs », la première réaction n'est pas « est-ce vrai ? », mais « effectivement ».

Les fausses nouvelles peuvent circuler parce qu'elles ressemblent à ce que les gens croient déjà dans leur cœur.

Ce que l'IA fait, c'est réduire le coût de cette « ressemblance » à presque zéro.

Il y a un détail dans cette histoire.

La supercherie a été démasquée grâce à la détection de filigrane de Google. Google développe l'IA, Google développe également des outils de détection de l'IA.

Mais SynthID ne peut vérifier que l'IA de Google elle-même. Cette fois, cela a fonctionné parce que le faussaire a utilisé Gemini par hasard. Avec un autre modèle, cela aurait pu ne pas être aussi chanceux.

Donc, résoudre cette affaire est moins une victoire technologique que :

l'adversaire a commis une erreur grossière.

Auparavant, une enquête de Reuters montrait que 59 % des personnes craignaient de ne pas pouvoir distinguer le vrai du faux en ligne.

Les tweets de clarification des PDG des entreprises de livraison ont été vus par des centaines de milliers de personnes, mais combien croient fermement qu'il s'agit de relations publiques, de mensonges ? Bien que ce faux post de divulgation ait été supprimé, certaines personnes commentent encore en critiquant les plateformes de livraison.

Le mensonge a fait le tour de la moitié du monde, la vérité est encore en train de lacer ses chaussures.

Imaginez maintenant si ce post ne parlait pas d'Uber, mais de Meituan ou Ele.me ?

Quelque chose comme « score de désespoir », « exploitation des algorithmes pour pressurer les livreurs », « les frais de bien-être n'ont pas été versés aux livreurs ». En voyant ces accusations, votre première réaction est-elle une adhésion émotionnelle ?

« Les livreurs à vélo, piégés dans le système », vous vous souvenez de cet article ?

Donc, le problème n'est pas de savoir si l'IA peut falsifier ou non. Le problème est que, quand un mensonge ressemble à ce que les gens croient déjà dans leur cœur, est-ce que la vérité importe encore ?

La personne qui a supprimé son compte et fui, quels étaient ses motifs, on ne sait pas.

On sait seulement qu'elle a trouvé une sortie émotionnelle et y a versé un seau de carburant généré par IA.

Le feu a pris. Quant à savoir si le bois brûlé est vrai ou faux, qui s'en soucie ?

Dans les contes, Pinocchio voit son nez s'allonger quand il ment.

L'IA n'a pas de nez.