Note de la rédaction : La divergence future des agents IA ne dépend pas d'un saut de capacité des modèles, mais d'une variable de conception plus fondamentale - sur qui repose finalement la responsabilité.

L'auteur estime que « l'augmentation humaine » et « le remplacement humain » ne sont pas deux trajectoires technologiques différentes, mais deux résultats d'un même système selon différents choix de conception - lorsque la décision nécessite encore une signature humaine et que la responsabilité peut être retracée à une personne spécifique, l'IA est un amplificateur ; lorsque cet élément est supprimé (comme l'approbation automatique, le contournement des autorisations), le système glisse naturellement vers le remplacement.

L'article souligne en outre que la valeur réelle d'un agent IA n'est pas de « terminer le travail », mais de compresser un monde complexe en une « unité de décision signable », permettant à un humain de comprendre et d'en assumer les conséquences. Mais en réalité, la « fatigue des autorisations » amènera les utilisateurs à abandonner progressivement la vérification, passant de l'approbation article par article au consentement par défaut, finissant par laisser le système contourner l'humain ; c'est un mécanisme cognitif, et non un problème individuel.

Par conséquent, l'article propose deux contraintes clés : premièrement, chaque décision importante doit correspondre à une personne spécifique, identifiable et pouvant refuser ; deuxièmement, celui qui profite de l'autonomie de l'Agent doit être responsable en cas de problème.

Une fois la responsabilité revenue aux constructeurs, la logique par défaut du système changera. Dans ce cadre, le récit commercial de l'IA est également réécrit. Plutôt qu'un marché de quelques géants « remplaçant la moitié des emplois », il s'agit d'un marché d'outils distribués « amplifiant la productivité humaine », dont l'ampleur est ancrée sur les revenus mondiaux du travail intellectuel d'environ 40 000 milliards de dollars, et non sur les dépenses logicielles des entreprises.

Finalement, l'article converge vers un choix extrêmement simple mais percutant : l'IA est-elle au service des humains, ou a-t-elle elle-même pour but - et cette réponse est silencieusement déterminée par chaque détail de conception de produit.

Voici l'article original :

TL;DR

· Les futurs « d'augmentation » et de « remplacement » utilisent les mêmes modèles, les mêmes outils. Ce qui les distingue vraiment, c'est un choix de conception concernant « sur qui retombent finalement les conséquences ».

· Le vrai travail d'un Agent n'est pas de terminer la tâche à la place de l'homme, mais de compresser le monde complexe en une « unité de décision » minimale et fidèle, permettant à quelqu'un d'y apposer sa signature et d'en assumer la responsabilité. Si cette compression est correcte, tout le reste suivra.

· Et ce « quelqu'un » doit être un individu spécifique, clairement identifiable. Une responsabilité floue, généralisée, s'effondre rapidement sous une charge élevée. Par conséquent, chaque action ayant des conséquences réelles doit pouvoir être retracée à une personne réelle ayant un véritable droit de refus.

· La « fatigue des autorisations » fera glisser spontanément les systèmes d'Agents vers le « remplacement de l'humain » le long de leur propre trajectoire d'évolution. Par conséquent, le futur « d'augmentation » n'est pas celui qui se produit par défaut ; il doit être consciemment conçu pour résister à cette tendance.

· Si vous construisez un Agent et profitez de son autonomie, vous devriez également assumer la responsabilité lorsque cette autonomie pose problème. Une fois que le coût repose véritablement sur le constructeur, le comportement par défaut de l'ensemble du système changera en conséquence.

· Le marché qui se forme sous cette prémisse que « l'homme doit encore assumer la responsabilité » sera probablement d'un ordre de grandeur plus grand que le récit actuel largement investi d'« Agents verticaux remplaçant la moitié des emplois », car il s'ancre non pas sur le budget logiciel des entreprises, mais sur la masse salariale totale de la main-d'œuvre hautement qualifiée.

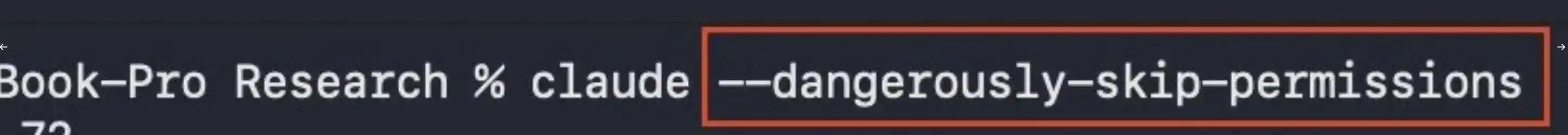

Claude Code propose un paramètre nommé --dangerously-skip-permissions. Cette dénomination est honnête ; le paramètre fait exactement ce que son nom indique. Un Agent fonctionnant avec ce paramètre activé n'est pas plus capable que sans ; ce qui change, c'est qu'un chemin qui devait passer par un humain le contourne désormais.

Ce paramètre est en soi un aveu. Il reconnaît qu'avec exactement les mêmes capacités de base, le même système peut fonctionner soit en mode « d'augmentation humaine », soit en mode de « remplacement silencieux de l'humain ». Le mode dit de remplacement n'a pas besoin d'un modèle différent ; il suffit de déplacer l'étape du « consentement ».

C'est l'argument compressé. Dans les systèmes d'Agents les plus capables actuellement déployés, une grande partie de l'écart entre « augmentation » et « remplacement effectif » provient de la suppression de l'approbation, et non de l'invention d'une nouvelle catégorie de capacités. La prochaine décennie ressemblera-t-elle plus à un « monde humain augmenté » ou à un « monde où des Agents autonomes agissent en notre nom » ? Cela dépend moins des capacités des modèles que de la façon dont les constructeurs de ces systèmes considèrent « l'humain dans la boucle » : comme le cœur du système, ou comme une friction.

L'IA augmente-t-elle l'homme, ou le contourne-t-elle ?

Sous chaque question technique se cache une question non technique que peu de gens osent poser ouvertement : L'IA est-elle destinée à augmenter l'humain, ou l'IA est-elle elle-même le but ?

Ces deux réponses impliquent des futurs véritablement différents. La position de l'« augmentation » estime que la valeur réside dans l'humain lui-même, et que le travail de l'Agent est de permettre à cette personne d'aller plus loin, de prendre de meilleures décisions. La position de « l'IA comme but » estime que l'intelligence dans le monde est elle-même la valeur, et que l'humain n'est finalement qu'un support inefficace. La plupart des produits Agent encodent silencieusement l'une ou l'autre de ces positions, et il est surprenant de constater que peu de fondateurs sont directement interrogés sur celle à laquelle ils appartiennent.

La conception des capacités et des mécanismes de consentement évolue encore. Cet article se concentre sur le côté « consentement », car c'est la variable que les constructeurs peuvent vraiment contrôler aujourd'hui, et aussi parce qu'une fois la capacité de génération devenue bon marché, les attributs qui conservent une valeur économique sont ceux qui ne peuvent être détachés de l'humain : le jugement, le goût, les relations, la responsabilité, et la volonté d'apposer sa signature sur une décision et d'en assumer les conséquences. Parmi ceux-ci, la « responsabilité » (liability) est la plus concrète, et la seule à disposer déjà d'une infrastructure d'exécution vieille de plusieurs siècles.

La responsabilité, ligne de partage entre augmentation et remplacement

La règle structurelle qui distingue le futur « d'augmentation » du futur « de remplacement » peut être formulée ainsi : toute action exécutée par un Agent et ayant des conséquences réelles doit pouvoir être retracée, via une chaîne enregistrée, à une personne spécifique - une personne qui a vu le contexte pertinent et a effectivement eu la possibilité de dire « non ».

Une responsabilité généralisée échoue rapidement à ce test. « L'entreprise est responsable » ne couvre opérationnellement rien de concret. « L'utilisateur a cliqué sur J'accepte » n'a accepté aucune chose spécifique. « Un humain a examiné le processus » permet à cette personne d'examiner quelque chose de complètement différent du contenu final publié. Ce qu'il faut vraiment, c'est une personne spécifique, une personne avec un nom, qui a vu cette décision présentée devant elle, avait l'option de refuser, et a choisi de ne pas refuser.

Cela ressemble à de la bureaucratie, jusqu'à ce que l'on remarque que la « responsabilité » possède des caractéristiques que les autres approches n'ont pas. L'amélioration des capacités ne peut l'optimiser ; un modèle plus intelligent n'affecte pas qui sera finalement poursuivi, condamné à une amende ou emprisonné. Cela force la conception de l'interface à exposer un « point de refus ». Cela s'étend naturellement avec le risque. Et c'est une contrainte trans-domaines extrêmement forte, disposant déjà d'une infrastructure d'exécution prête à l'emploi : les tribunaux, les assureurs, les ordres professionnels, les régulateurs. Les régimes d'autorisation, les responsabilités fiduciaires et la réglementation sectorielle fonctionnent aussi, mais ils contraignent des domaines plus étroits et supposent tous que la question de « l'attribution de la responsabilité » est déjà résolue.

En comparaison, les alternatives au niveau de l'IA ne passent pas le même test. L'« alignement » n'est pas exécutoire ; nous ne pouvons même pas nous mettre d'accord sur sa signification. L'« explicabilité » peut être formellement satisfaite sans l'être substantiellement. « L'humain dans la boucle » a été vidé de son sens pour devenir « il y a un humain quelque part ». La raison pour laquelle la « responsabilité » a du poids, c'est que l'infrastructure d'exécution qui la sous-tend a été construite des siècles avant la technologie.

La fatigue des autorisations, poussant le système vers le « remplacement »

Ce gradient pousse le système vers le « remplacement », et la poussée est forte. Chaque demande d'autorisation consomme de l'attention. Les Agents ont souvent raison. D'un point de vue décisionnel individuel, le bénéfice espéré de « accepter sans lire » est souvent positif. Ainsi, un utilisateur rationnel apprendra à cliquer plus vite sur Accepter, puis à accepter par lot, puis à activer l'acceptation automatique pour une certaine catégorie d'actions, à l'étendre à plus de catégories, puis à activer cet interrupteur dangereux dans une session, et finalement à oublier son existence.

J'ai activé cet interrupteur lors de ma deuxième semaine d'utilisation de Claude Code, et à la troisième semaine, je ne le remarquais plus. Tous les développeurs que je connais et qui utilisent Cursor ou Devin depuis longtemps ont vécu une expérience similaire. Ce modèle apparaît également dans les bannières de cookies, les contrats de licence utilisateur final (CLUF), les avertissements TLS, les demandes d'autorisation sur mobile. Les décisions de consentement à faible risque qui se répètent finissent par converger vers un « consentement inconditionnel ». C'est une caractéristique cognitive, et non un problème moral.

Le futur « d'augmentation » ne se produira pas automatiquement. Un système Agent non soigneusement conçu a comme chemin par défaut d'évoluer vers le remplacement, car les utilisateurs eux-mêmes, dans leur quête de commodité, choisiront activement le chemin du remplacement. L'autre futur doit être conçu à contre-courant de ce gradient.

La valeur de l'Agent n'est pas l'exécution, mais de permettre à l'homme de « signer »

Ce qui est vraiment précieux chez un Agent, ce n'est pas d'accomplir le travail lui-même, mais de compresser le travail sous une forme qui peut être signée.

Un modèle de pointe peut facilement écrire une soumission de code de 4000 lignes, rédiger un contrat de 30 pages, générer un dossier clinique ou exécuter une transaction. Mais le goulot d'étranglement pour que ces produits aient un impact réel ne réside pas dans leur « génération », mais dans la capacité humaine à en assumer les conséquences une fois qu'ils sont mis en œuvre. Une soumission de code que personne ne comprend vraiment devient un fardeau une fois fusionnée ; un contrat que personne n'a lu est une bombe à retardement une fois signé ; un dossier clinique sans l'aval réel d'un médecin praticien n'est même pas considéré comme un dossier valide dans la plupart des systèmes de santé réglementés.

Dans le cadre de l'« augmentation », l'Agent accomplit tout sauf la « signature » : lire dix mille pages de contexte, écrire quatre mille lignes de code, calculer trente scénarios plausibles, puis compresser tout cela en une expression minimale et fidèle, permettant à une personne de prendre une décision « oui » ou « non » basée sur celle-ci, et d'apposer son nom au bas du document.

On peut comprendre l'Agent comme un porte-parole. Le président signe, mais le travail du porte-parole est de faire tout le travail préparatoire avant la signature.

C'est en fait un problème d'ingénierie plus difficile que « laisser le système accomplir le travail de manière autonome ». La capacité à générer du contenu progresse rapidement, mais la capacité à « compresser fidèlement une décision » est très en retard. À l'avenir, dans le marché de « l'augmentation », ceux qui l'emporteront seront les équipes capables de fournir les résumés décisionnels les plus courts et les plus fidèles pour des scénarios à haut risque de responsabilité.

Le vrai problème non résolu dans cette phrase est le mot « fidèle ». Un résumé compréhensible par un humain n'a de valeur que si le processus de compression n'a pas déformé l'information. Savoir si cela peut être vérifié de manière programmatique est le véritable problème technique difficile dans le futur « d'augmentation », et la plupart des gens ne l'ont même pas encore vraiment abordé.

Quelques méthodes de base émergent :

Confirmer par un test de reformulation si la compréhension humaine est conforme au contenu original

Forcer la présentation d'opinions minoritaires ou dissidentes dans le résumé

Effectuer des tests contrefactuels (« si vous refusez, que ferait cet Agent ? »)

Vérifications de reproductibilité (un autre Agent peut-il générer le même résumé à partir du même contexte)

Tout cela est loin d'être résolu. Et les équipes qui résoudront ces problèmes en premier construiront un avantage concurrentiel qui ne sera pas facilement érodé par l'amélioration des capacités des modèles.

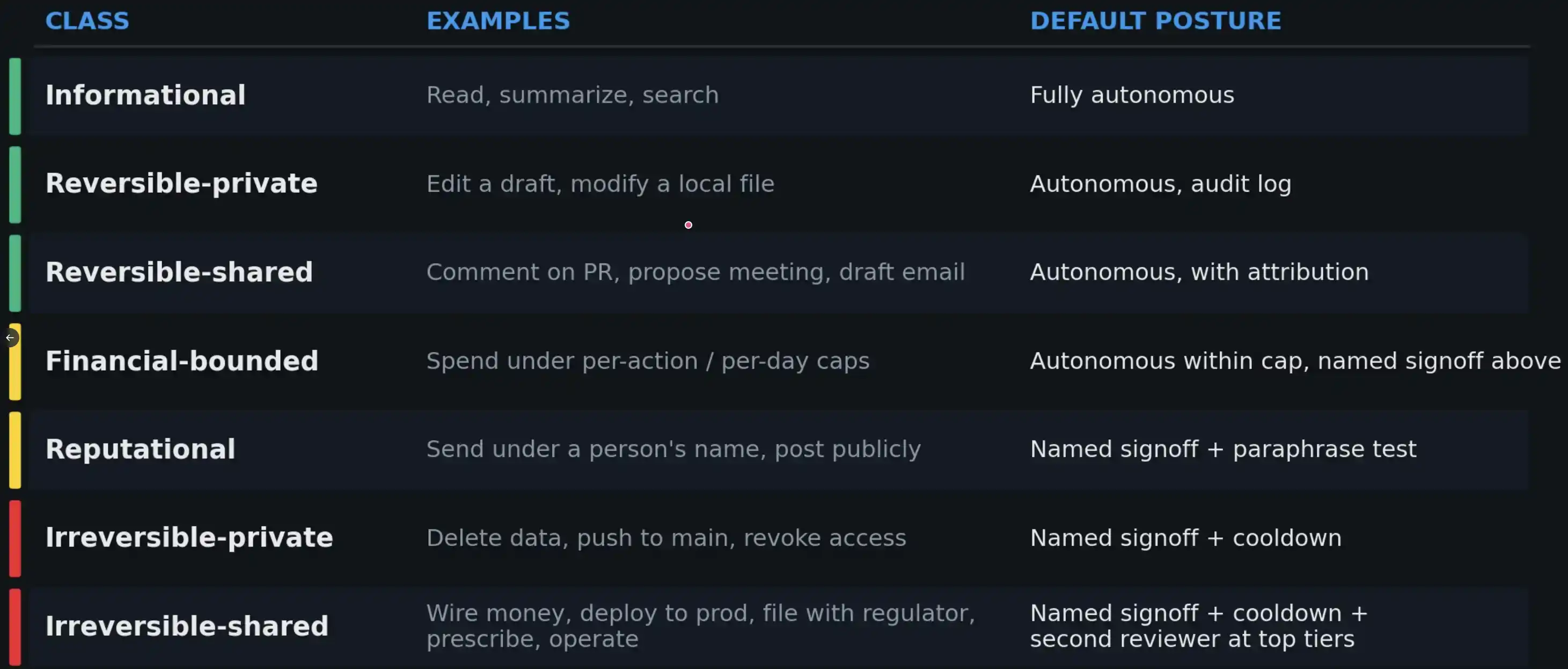

Établir une gradation de responsabilité pour les actions de l'IA

Si la « responsabilité » joue un rôle structurel, alors chaque action exécutée par un Agent devrait être assortie d'un « niveau de responsabilité », et ce niveau déterminerait le mécanisme de signature minimal requis pour cette action.

Actuellement, un tel système standard n'est pas largement établi – mais il devrait probablement l'être.

Une « posture d'approbation » adaptée aux conséquences est le seul chemin réaliste pour gérer la fatigue des autorisations. Aux niveaux de risque élevé, des mécanismes d'engagement positif plus contraignants doivent être ajoutés (par exemple, tests de reformulation, délais de réflexion, second examinateur), car dans ces scénarios, le vrai mode d'échec n'est pas que l'Agent propose une erreur, mais que l'humain approuve sans réfléchir.

Est-ce que cela vous importe ?

Toutes les questions ci-dessus convergent finalement vers une question fondamentale au niveau du fondateur : vous souciez-vous que les humains fassent toujours partie de ce futur ? De nombreuses décisions de conception actuelles concernant les produits Agent sont essentiellement un « vote silencieux » sur cette question, simplement que les votants hésitent souvent à admettre qu'ils sont en train de faire un choix.

Si cela vous importe, alors les contraintes de conception ne sont pas floues : vous devez construire un système de stratification des responsabilités ; concevoir le « refus » comme une fonction de première classe ; la métrique devrait être la qualité du résumé que l'Agent remet à l'humain, et non son degré d'autonomie à accomplir des tâches sans intervention ; vous devez lier chaque action ayant des conséquences réelles à une personne spécifique dans un journal à falsification extrêmement difficile.

Ce travail technique est lui-même réaliste et faisable. La véritable difficulté réside dans la volonté de le faire – parce que le chemin de construction « d'augmentation » est moins spectaculaire en démonstration, et moins agressif dans les modèles économiques basés sur les sièges que l'autre chemin.

Le paradoxe d'Anthropic : le plus soucieux de la sécurité, mais le plus facile pour contourner l'homme

Anthropic est un cas d'école très typique de la façon dont ce domaine subit un « décalage endogène ». Ce n'est pas parce qu'il est particulièrement négligent, bien au contraire, c'est parce que son discours sur la sécurité est le plus clair, donc l'écart entre le « cadre » et la « surface du produit » est le plus facile à voir. Sa « Politique de mise à l'échelle responsable » et ses travaux sur « l'IA constitutionnelle » contraignent principalement le comportement du modèle pendant l'entraînement ; mais les Agents construits sur ces modèles, leurs paramètres d'autonomie par défaut relèvent d'un autre système de stratégie, et ce « commutateur dangereux » pratique peut être activé depuis l'état par défaut en une seule pression.

Ce modèle existe dans la plupart des principaux Agents de programmation, mais le cas d'Anthropic est le plus facile à observer clairement. C'est ce qu'on appelle le « paradoxe d'Anthropic » : le laboratoire qui écrit le cadre de sécurité le plus clair de l'industrie, offre également le chemin le plus court pour passer de l'« augmentation » au « remplacement », et nous pouvons voir ce dernier précisément parce que le premier est suffisamment clair.

Pour être juste, ils ont lancé en mars un « mode auto » (automatic mode), comme chemin intermédiaire entre l'approbation manuelle et le commutateur dangereux. Dans ce mode, chaque action est examinée par un classifieur Sonnet 4.6 avant exécution. Ils ont directement pointé le problème dans leur note officielle – l'appelant « fatigue d'approbation », et ont fourni une donnée : les utilisateurs en mode manuel acceptent 93 % des invites. C'est essentiellement la quantification de la « fatigue des autorisations ». Ce constat est cohérent avec l'analyse de cet article.

Mais sur le chemin de la résolution, je proposerais un point de vue différent. Le « mode auto » remplace l'approbation humaine par l'approbation du modèle, ce qui signifie que le gradient de « glissement vers le remplacement » ne s'arrête pas, mais monte simplement d'un niveau. Le classifieur peut certainement bloquer les comportements dangereux, mais pour les comportements autorisés, aucune personne spécifique n'assume réellement la responsabilité. Anthropic lui-même admet que le « mode auto » n'élimine pas les risques et recommande aux utilisateurs de l'exécuter dans un environnement isolé – en d'autres termes, la question de « l'attribution de la responsabilité » reste en suspens.

Une objection évidente est : si la responsabilité finale doit incomber à un individu, n'est-ce pas justement le mode manuel ? Et le mode manuel est précisément celui qui est vaincu par la fatigue. La raison pour laquelle « faire porter la responsabilité au constructeur » peut échapper à ce gradient, c'est parce que cela change le porteur du coût de « l'approbation excessive ». Dans la structure actuelle, l'utilisateur paie le coût de chaque lecture attentive, et le constructeur n'a rien à assumer, donc les paramètres par défaut tendent à réduire la friction pour l'utilisateur et à externaliser le risque. Une fois le coût des « comportements non examinés » transféré au constructeur, tout le calcul s'inverse : le constructeur aura une motivation économique directe à concevoir une stratification des responsabilités, des tests de reformulation et des mécanismes d'approbation qui rendent le coût de signature des décisions à faible risque plus bas, et celui des décisions à haut risque plus élevé. Le gradient ne disparaît pas, mais sa direction change. Aucun laboratoire majeur n'a vraiment mis cela en pratique à ce jour, y compris celui qui s'en est le plus approché.

Si vous construisez un Agent, vous devriez en assumer la responsabilité

Si le but explicite d'un Agent est de remplacer un humain en exécutant des actions qui étaient auparavant effectuées par une personne, alors l'entreprise qui construit et exploite cet Agent devrait assumer la même responsabilité que l'humain. Ce principe n'est pas radical ; il s'applique déjà à toutes les industries qui « produisent des actions dans le monde réel » : Toyota est responsable des freins, Boeing des systèmes de contrôle de vol, Pfizer des médicaments, l'ingénieur des ponts des ponts, le médecin des ordonnances. Ce modèle de responsabilité existe dans presque tous les systèmes juridiques.

Cependant, l'IA jouit actuellement d'une certaine « exemption implicite ». Les fournisseurs de modèles affirment n'être que des vendeurs d'outils ; les entreprises d'applications supérieures affirment n'être qu'un mince wrapper autour des modèles ; les utilisateurs renoncent à toute responsabilité dès le départ via des clauses d'arbitrage. Lorsque les systèmes d'Agents subissent des échecs en cascade (comme l'affaire du chatbot d'Air Canada, l'incident de suppression de la base de données de production par Replit, ou un événement similaire au bug de trading de Knight Capital en 2012 qui a perdu 440 millions de dollars en 45 minutes), la perte finale est souvent supportée par la partie la moins capable de la supporter – l'utilisateur. Cette répartition des responsabilités ne survivra pas au premier accident majeur véritablement « monétisé et documenté ».

La solution est en fait simple à énoncer : celui qui construit l'Agent et profite de son autonomie devrait assumer les conséquences lorsqu'il devient incontrôlable. Une fois la responsabilité véritablement portée par le constructeur, les invites d'autorisation ne seront plus perçues comme une « friction », mais comme une « assurance ». Ce commutateur dangereux sera renommé, et les paramètres par défaut changeront en conséquence.

La volonté d'assumer la responsabilité de son propre système est ce qui distingue une industrie réelle d'une « industrie extractive ».

La régulation comme « mécanisme de guidage »

Le marché lui-même n'évoluera pas naturellement vers le futur « d'augmentation ». Ce qui joue vraiment un rôle de guidage, ce sont souvent les autorités de régulation et les assureurs, et dans l'ensemble, ce n'est pas nécessairement une mauvaise chose.

L'Europe deviendra probablement le premier canal de régulation. L'UE a des antécédents clairs en matière d'établissement de règles (comme le RGPD, la « Loi sur l'IA », le DMA), et ses règles sont souvent suivies par défaut à l'échelle mondiale, car le coût de maintenance d'un produit distinct pour les marchés non européens est généralement supérieur au coût du respect direct des normes européennes. Une ligne de base exige que « toute action ayant des conséquences réelles doit finalement être confirmée par un humain identifié nommément et disposant d'un droit de refus » se rapproche plus des normes de test de collision automobile que d'un obstacle au progrès technologique.

Une poussée plus directe viendra du secteur de l'assurance. Les assureurs qui fixent les prix pour l'assurance responsabilité civile erreurs et omissions (E&O), l'assurance responsabilité des administrateurs et dirigeants (D&O) et la cyberassurance doivent répondre à une question : lorsque un Agent agit avec l'autorisation de l'utilisateur et cause un préjudice, comment la responsabilité est-elle établie ? Le chemin le plus facile pour former une structure indemnisable est la présence d'un humain identifié nommément dans la chaîne. Par conséquent, les systèmes sans une telle structure verront naturellement leurs primes d'assurance refléter une prime de risque plus élevée. Pour les constructeurs qui souhaitent définir leurs propres règles plutôt que de laisser les régulateurs ou les assureurs le faire, la fenêtre de temps n'est en réalité pas très large.

La logique de marché masquée par le récit dominant

Le récit dominant actuel est le suivant : les Agents verticaux absorberont environ la moitié des emplois dans les industries qu'ils touchent, et la valeur se concentrera entre les mains de quelques entreprises d'Agents verticalement intégrées – un « Anthropic » dans le domaine juridique, un « Anthropic » dans le domaine médical, un « Anthropic » dans le domaine comptable. Presque tout le financement de l'IA de plusieurs milliards de dollars au cours de l'année et demie écoulée repose d'une certain manière sur cette hypothèse. C'est la version « logique de remplacement » habillée en commerce, mais son jugement sur la structure de marché est erroné, et cette erreur affecte directement la façon dont le capital est alloué.

Le cadre « d'augmentation » implique quant à lui une autre forme de marché. Si chaque action ayant des conséquences réelles doit finalement retomber sur une personne nommément désignée, alors l'unité vendue n'est pas un « Agent autonome », mais une « capacité humaine amplifiée ». Le médecin qui peut traiter trois fois plus de cas avec une précision plus élevée est l'acheteur ; de même, l'avocat couvrant dix fois plus de flux de transactions, l'ingénieur livrant à cinq fois la vitesse, et derrière eux le comptable, l'assureur, l'analyste, l'architecte, le chirurgien, l'enseignant, l'agent de crédit, le journaliste et le pharmacien sont tous des acheteurs.

Ce marché est plus grand parce qu'il ne dépend pas de la centralisation, mais d'une distribution à grande échelle. L'ancre d'évaluation raisonnable ne devrait pas être le budget logiciel des entreprises, mais la masse salariale totale de la main-d'œuvre « amplifiée ». Les dépenses informatiques mondiales des entreprises s'élèvent à environ 4 000 milliards de dollars par an (données Gartner) ; tandis que la rémunération totale mondiale des travailleurs qualifiés, certifiés et du savoir est approximativement d'un ordre de grandeur supérieur, environ 40 000 milliards de dollars (estimation basée sur les données de l'OIT, hors partie faiblement qualifiée). Les entreprises d'IA n'obtiendront certes pas l'intégralité du bassin salarial, mais elles peuvent en obtenir une partie de la productivité. Même ne capturer qu'un faible pourcentage suffirait à soutenir un marché de la taille de l'actuel marché global des logiciels d'entreprise, et ce n'est que la limite inférieure, et non supérieure. La taille finale de l'espace marché dépend d'une décision de conception cruciale : sur qui repose finalement la responsabilité.

Les gagnants finaux ressembleront plus à des outils qu'à des remplaçants, leur tarification sera basée sur « la personne amplifiée », et non sur « le poste remplacé » ; ils s'intégreront dans les flux de travail professionnels existants, plutôt que de les remplacer ; ils seront par milliers, et non par quelques-uns. La forme finale de ce marché se rapprochera plus du SaaS que de l'infrastructure cloud. Nous en sommes encore aux tout premiers stades de la courbe de déploiement, le graphique de taux de pénétration habituel, sur un axe qui s'étendra encore sur dix ans, n'est que les quelques pixels les plus à gauche. Et la forme de ces « pixels » est déterminée par les choix de conception dans une petite partie des produits actuels.

Choix : faire assumer l'homme, ou faire disparaître l'homme ?

Faire assumer la responsabilité aux humains force l'architecture du système à s'articuler autour de l'« augmentation humaine » ; tandis qu'une fois l'homme retiré de la chaîne de responsabilité, le système glissera par défaut vers le « remplacement », même si chaque personne présente, si on lui demandait explicitement, ne choisirait probablement pas ce résultat.

La vraie question n'est pas de savoir si certaines actions devraient être entièrement automatisées – le cadre ci-dessus l'admet déjà, par exemple les opérations de pure lecture d'information peuvent certainement l'être. Le point clé est de savoir comment cette frontière bouge à mesure que le risque augmente progressivement, et qui décide de son emplacement. Dans les systèmes d'Agents les plus avancés actuels, le chemin de glissement de l'« augmentation » vers le « remplacement effectif » est anormalement court, souvent juste un paramètre ou un réglage par défaut. Le travail vraiment important est de s'assurer que ce commutateur soit toujours considéré comme une « option dangereuse », et ne devienne pas progressivement la valeur par défaut sous l'impulsion de la commodité.

Si les constructeurs font ce travail activement, nous entrerons relativement en douceur dans un futur « d'augmentation » ; s'ils ne le font pas, les régulateurs et les assureurs le feront à leur place, et le résultat ira également dans cette direction.

Est-ce que cela importe, c'est un choix de conception. Et ce choix déterminera ce que vous construisez. Aujourd'hui, chaque fondateur lançant un produit Agent doit répondre publiquement à une question qu'il semble hésiter à affronter : construisez-vous une augmentation, ou un remplacement ?