Fin mars à début avril 2026, le secteur de la génération vidéo par IA a connu deux événements marquants en l'espace de deux semaines.

Premier événement : Sora, autrefois considéré comme le "Saint Graal" par l'industrie, a été complètement arrêté par OpenAI le 24 mars — l'application indépendante, l'interface API et la fonctionnalité vidéo intégrée à ChatGPT ont toutes été mises hors ligne, OpenAI se retirant ainsi complètement du marché grand public de la génération vidéo.

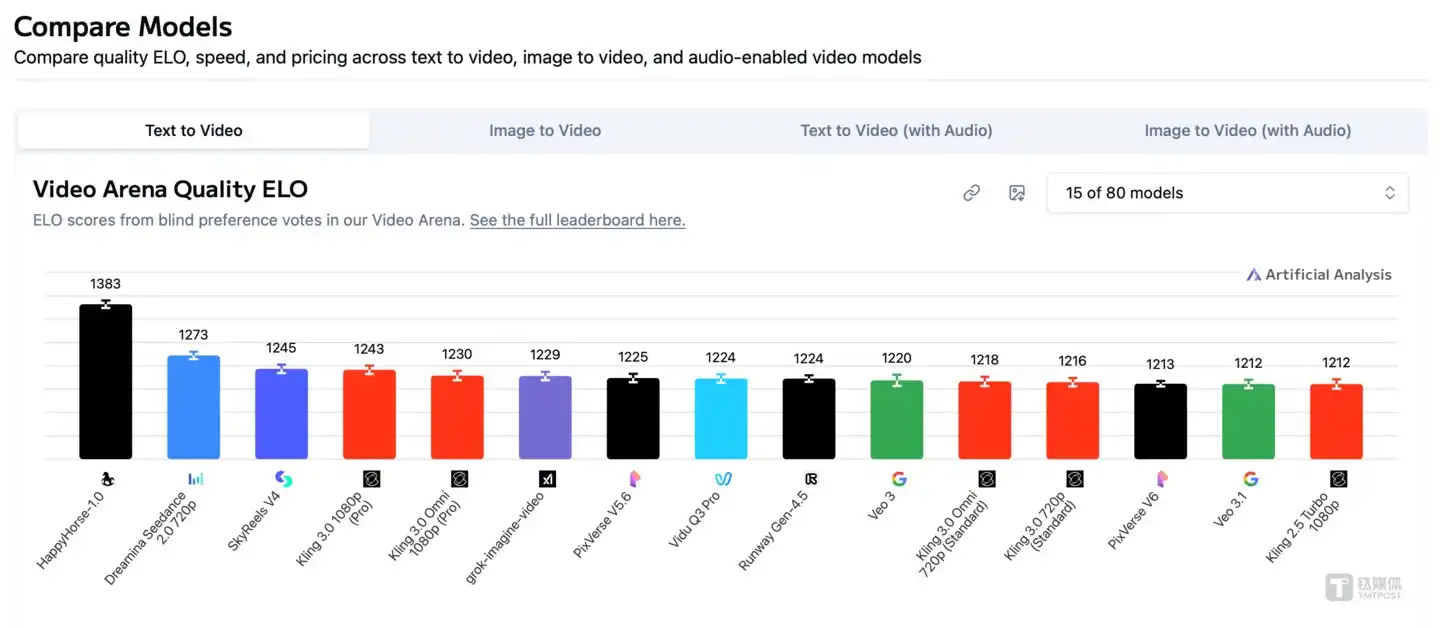

Deuxième événement : Moins de deux semaines plus tard, le 7 avril, un modèle anonyme portant le nom de code "HappyHorse-1.0" a atterri sans préavis en tête du classement de test en aveugle de vidéos IA le plus autoritaire au monde, Artificial Analysis, avec un score écrasant.

D'un côté, un géant de la Silicon Valley qui capitule après un jeu de brûlage d'argent à hauteur de 15 millions de dollars par jour, de l'autre, un outsider technologique d'origine inconnue qui détrône l'équipe chinoise qui dominait longtemps le classement en aveugle. Deux événements survenus dans la même fenêtre temporelle, semblant sans rapport, mais pointent vers le même constat : Les règles du jeu dans la vidéo IA sont en train de changer qualitativement — passant de "quel modèle est plus intelligent" à "quel calcul est moins cher, quel mur de conformité est plus épais".

Vérité derrière le massacre : la suprématie visuelle pure et le outsider "spécialisé"

Pour juger de la qualité d'un outsider, regardons d'abord qui est l'arbitre.

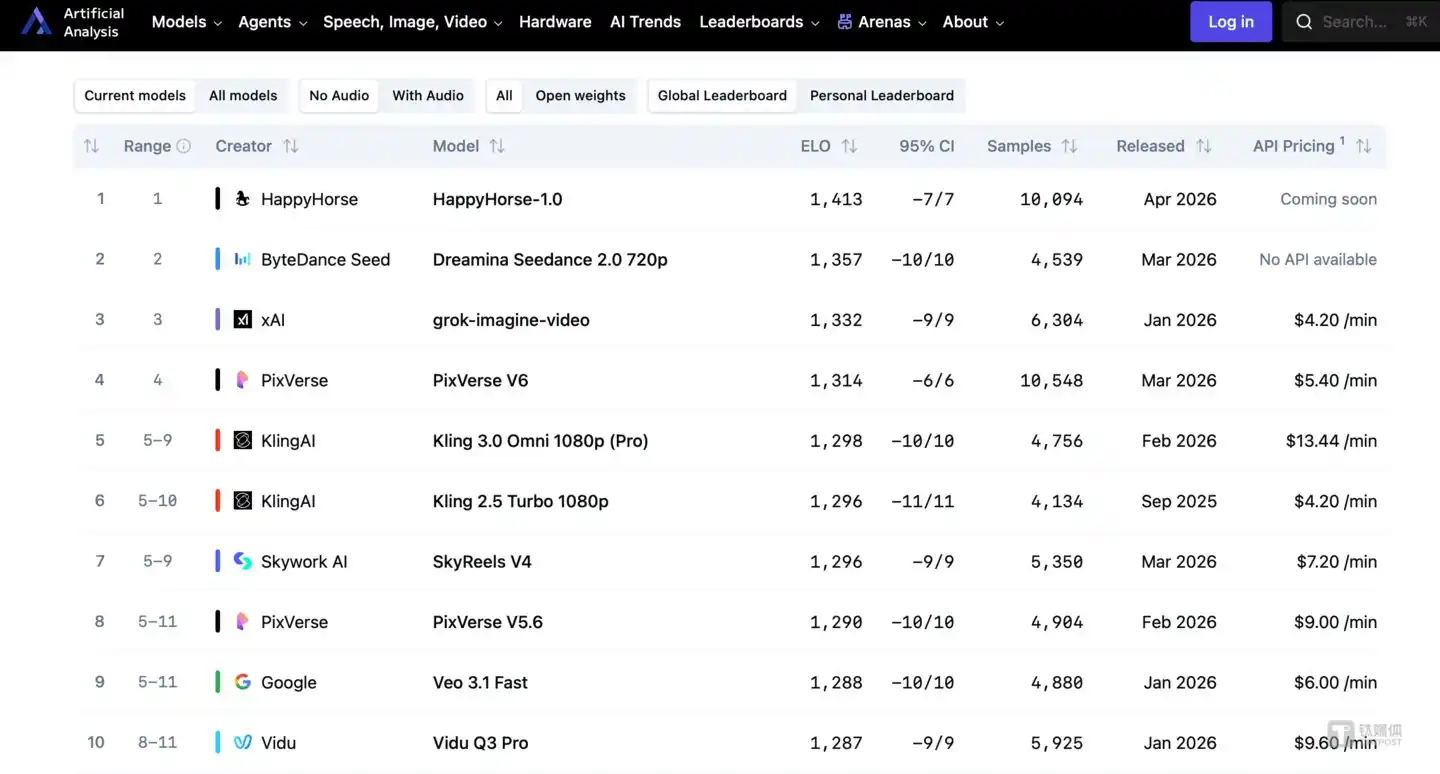

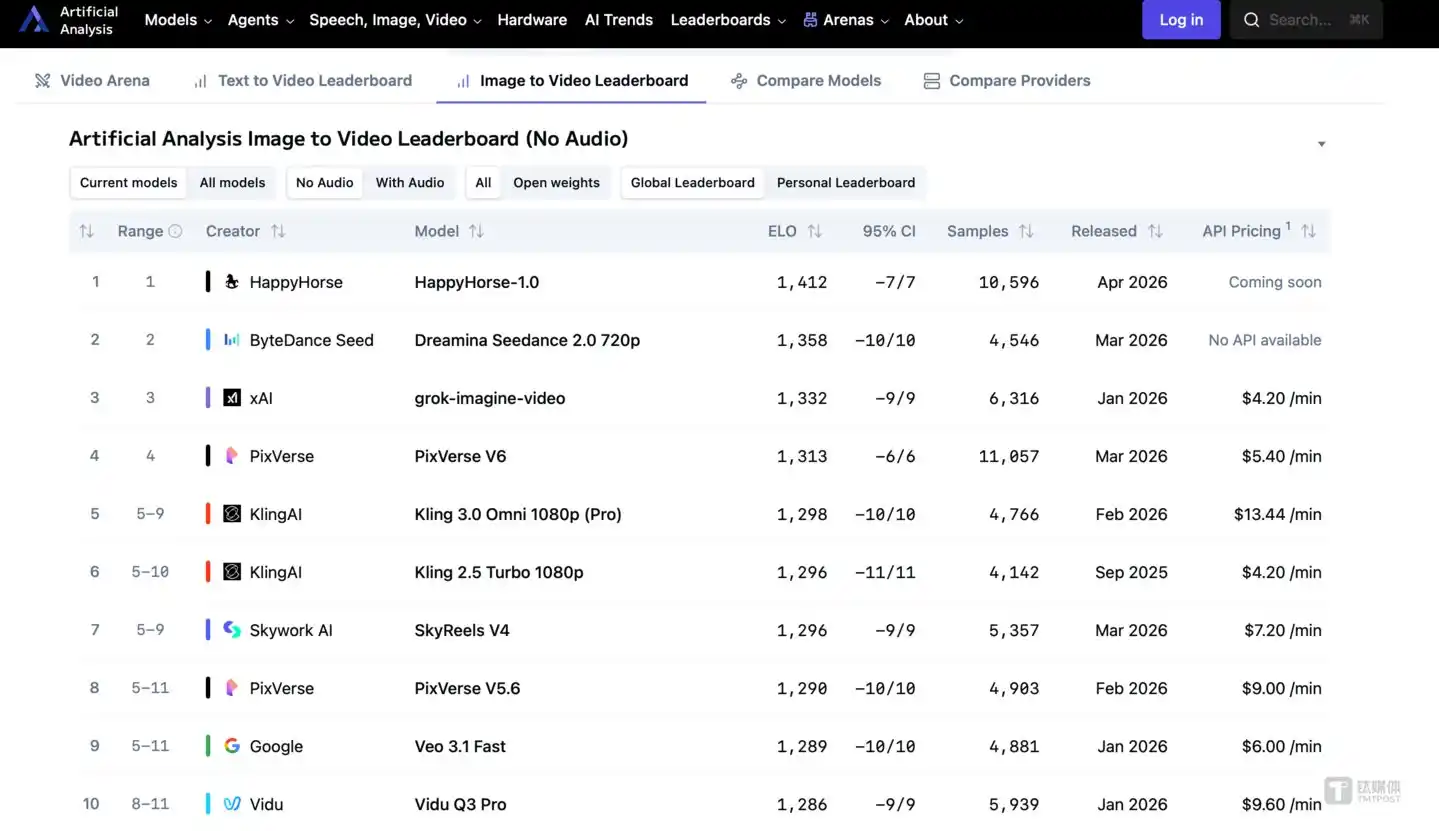

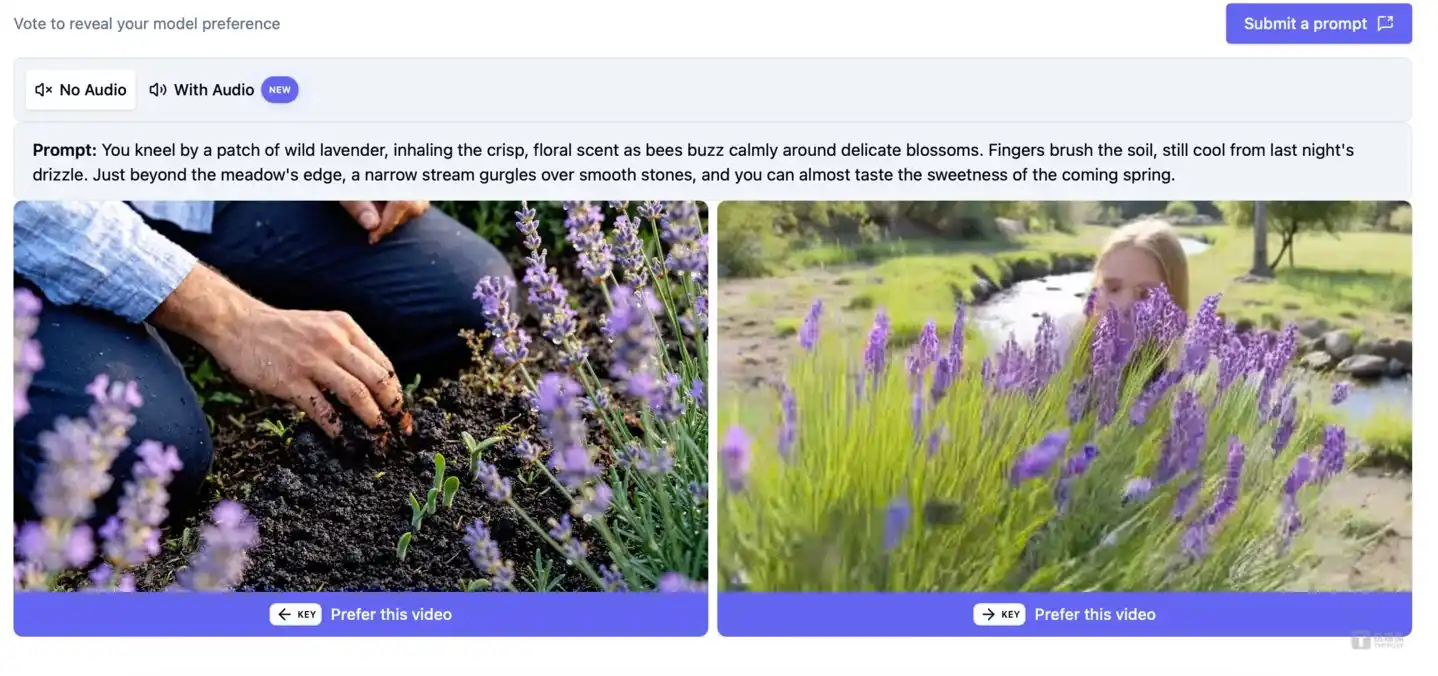

Artificial Analysis Video Arena n'est pas un classement de relations publiques où les fabricants se félicitent eux-mêmes, mais un classement Elo établi par des milliers d'utilisateurs réels votant en aveugle sur des vidéos générées.

Le bulletin de notes de HappyHorse-1.0 est écrasant.

Dans la catégorie "Texte vers vidéo (sans audio)", il a obtenu 1357 points (au 9 avril), devançant le deuxième, Seedance 2.0 (1273 points), de pas moins de 84 points. Cela signifie qu'en test aveugle, les utilisateurs ont choisi son modèle de manière significativement plus fréquente que tout autre modèle. Sous ses pieds se trouvent non seulement ByteDance, mais aussi des produits stars comme Kling 3.0, SkyReels V4, etc.

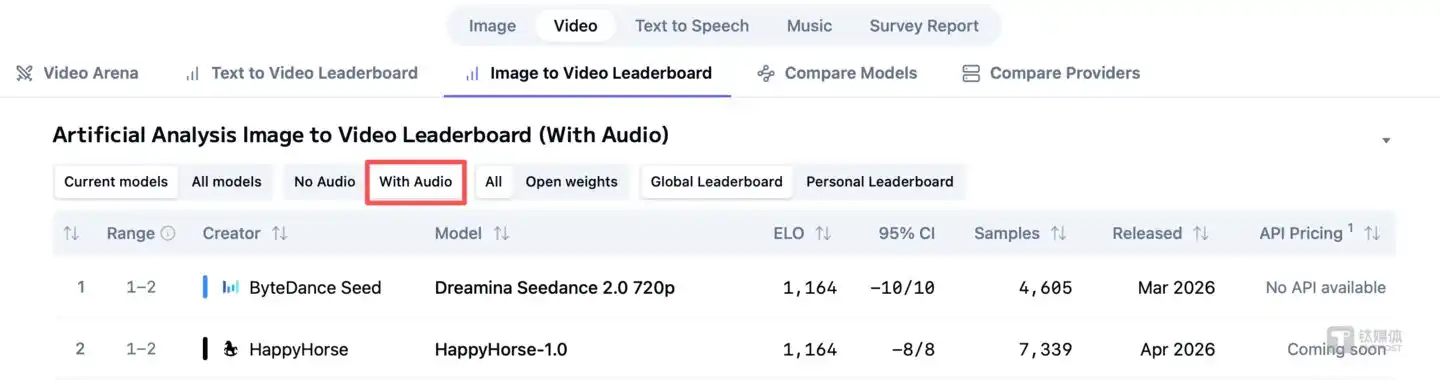

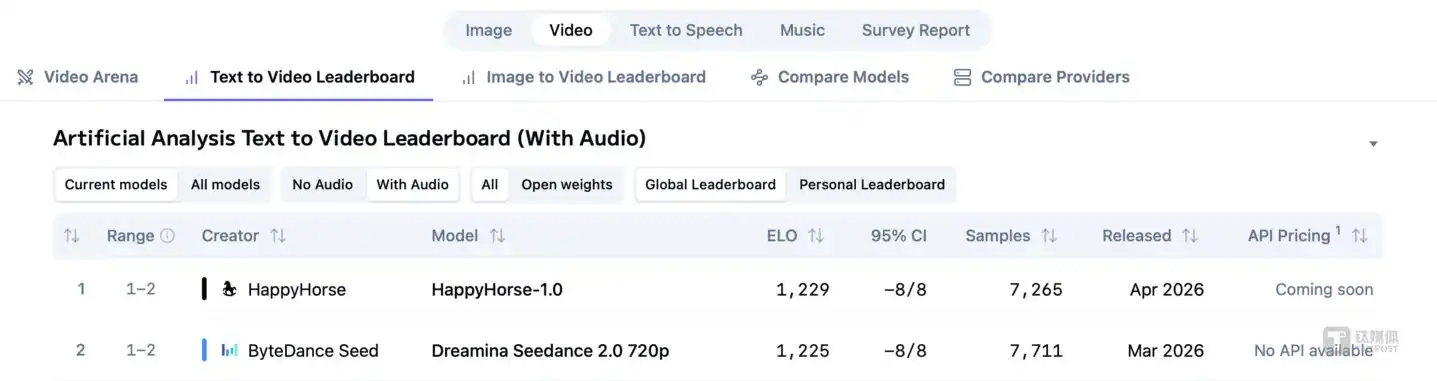

Mais sa "spécialisation" est aussi un fait. Dès que la dimension audio est incluse, dans la catégorie "Texte vers vidéo (avec audio)", il n'obtient que 1217 points, perdant face à Seedance 2.0 (1220 points) par seulement 3 points. En d'autres termes, HappyHorse-1.0 a percé la ligne de défense de la réputation technique purement visuelle de ByteDance, mais sur l'expérience combinée audio-visuelle, Seedance a maintenu sa position.

La signification de ce massacre réside davantage dans le fait qu'il a brisé l'attente du marché selon laquelle "les modèles vidéo chinois étaient déjà figés" — un nouveau challenger peut, avec un petit modèle de seulement 15B paramètres, surpasser tous les grands fabricants sur la dimension purement visuelle.

Comment est-il si rapide ?

Sur une seule carte graphique H100 haut de gamme, il ne lui faut que 38,4 secondes pour générer une vidéo HD 1080p (avec audio synchronisé). La confiance dans sa vitesse vient de l'architecture sous-jacente unifiée de transformateur à 15 milliards de paramètres (15B), combinée à la technologie de distillation DMD-2, qui compresse le nombre d'étapes d'inférence à seulement 8.

Pour faire simple, les grands modèles vidéo traditionnels ressemblent à une "équipe externalisée" — un grand modèle de texte comprend d'abord votre demande, puis la transmet à un modèle de diffusion pour "dessiner", avec d'énormes pertes de communication intermédiaires. L'architecture unifiée de transformateur adoptée par HappyHorse-1.0 est un "généraliste complet", traitant à la fois le texte et les pixels visuels dans le même réseau neuronal, éliminant les pertes intermédiaires intermodales.

Il est intéressant de noter que HappyHorse-1.0, lors de son entrée initiale dans le classement (7-8 avril), avait été soupçonné d'être un "produit marketing futur" — le site officiel prétendait être open source, mais les dépôts GitHub et les liens de téléchargement du modèle n'étaient initialement que des 404 ou "à venir". Mais le 9 avril, plusieurs médias ont rapporté qu'il avait officiellement annoncé son open source, les utilisateurs pouvant l'expérimenter en ligne via du texte ou une image sur le site officiel. Du "open source de Schrödinger" à la publication réelle des poids, il n'a fallu que moins de 48 heures.

Stratagème anonyme : Pourquoi les grands fabricants entrent-ils masqués ?

L'industrie a actuellement deux suppositions principales.

La première est qu'il provient du "Future Life Lab" nouvellement créé par le groupe Taotian d'Alibaba, dirigé par Zhang Di, ancien vice-président technique de Kuaishou et responsable de Kling AI.

La seconde est qu'il s'inspire profondément de la technologie sous-jacente de daVinci-MagiHuman de la startup chinoise Sand.ai — l'utilisateur Zhihu Vigo Zhao a comparé point par point les données de référence publiques de HappyHorse-1.0 avec des modèles connus et a trouvé une correspondance élevée. Le journal Jiemian a également rapporté que la "conclusion la plus crédible dans les cercles techniques" est que HappyHorse est une version optimisée et itérée de daVinci-MagiHuman.

Ces suppositions n'ont pas encore été confirmées officiellement. Cependant, des informations exclusives ce matin indiquent que HappyHorse-1.0 a bien été développé par Alibaba, dirigé par l'ancien vice-président de Kuaishou et responsable technique de Kling, Zhang Di, qui est revenu chez Alibaba en novembre 2025. De plus, Alibaba Cloud mettra bientôt ce modèle en ligne sur la plateforme Bailian, et les récentes réorganisations d'Alibaba sont liées à cela.

Au moment de la publication, Alibaba n'a pas encore répondu.

La question se pose : Pourquoi, alors qu'ils détiennent une arme redoutable, les grands fabricants n'organisent-ils pas de conférence de presse ? Pourquoi se mêler anonymement à une plateforme de test en aveugle tierce ?

Bien qu'il n'y ait pas encore d'explication officielle, en se basant sur les pratiques du secteur et la logique commerciale, on peut supposer au moins deux niveaux de planification derrière cela.

Premier niveau, une "récolte de données" gratuite.

Le plus grand goulot d'étranglement actuel de la vidéo IA est le manque de données réelles sur les préférences humaines. Atterrir anonymement sur une plateforme de test en aveugle équivaut à faire faire des tests A/B par les internautes du monde entier gratuitement. Sans dépenser un centime, on peut cibler avec précision les défauts du modèle dans le monde réel.

Deuxième niveau, éviter les "mines terrestres" mortelles de conformité.

La vidéo IA est sur un volcan de litiges sur les droits d'auteur. Publier sous son vrai nom avant que le grand modèle n'ait mis en place des mécanismes de filigrane numérique et d'interception de portrait peut facilement attirer des demandes d'indemnisation faramineuses d'Hollywood. Tester anonymement permet à la fois de montrer sa force musculaire et d'établir un isolement physique juridique.

Cependant, d'un autre côté, la frénésie autour de HappyHorse-1.0 contraste avec la mélancolie de Sora. Pourquoi un destin si divergent pour deux projets vidéo ? En y regardant de plus près, le retrait de Sora déchire en fait la plaie la plus sanglante de cette industrie : un ROI (Retour sur Investissement) gravement inversé.

Selon les estimations de SemiAnalysis, le coût opérationnel quotidien de Sora s'élevait à 15 millions de dollars, brûlant environ 5,4 milliards de dollars par an. Son architecture de modèle de diffusion nécessite de rendre environ 30 images pour générer 1 seconde de vidéo, mais les problèmes courants dans les résultats générés, tels que la déformation des objets ou les incohérences de mouvement, entraînent l'abandon d'un grand nombre de vidéos, le taux d'utilisation final étant estimé par les analystes à seulement 5% à 10%.

Produire 1 vidéo utilisable gaspille plus de dix fois la puissance de calcul. Lorsqu'un outil ne peut pas s'intégrer dans le flux de travail quotidien des utilisateurs et se contente de devenir un "jouet de curiosité", personne n'est prêt à payer continuellement. Selon les données divulguées par un associé d'a16z, le taux de rétention de Sora n'était que de 10% après 1 jour, 2% après 7 jours, 1% après 30 jours et proche de 0% après 60 jours.

Sora, avec un coût annuel de 5,4 milliards de dollars et une courbe de rétention en chute libre, a prouvé que la voie de l'empilement brutal de puissance de calcul par des modèles de diffusion purs n'est pas viable. HappyHorse-1.0 apporte une autre réponse — 15B paramètres, architecture unifiée de transformateur, 8 étapes d'inférence, 38,4 secondes par carte. L'écart entre les deux n'est pas l'échelle des paramètres, mais l'efficacité architecturale. Le modèle de diffusion est un trou noir de calcul, l'architecture unifiée de transformateur est un compresseur de calcul. L'issue de cette bataille architecturale pourrait avoir plus de signification pour le secteur que n'importe quel massacre de classement ponctuel.

En regardant les géants chinois de l'IA restants, ils jouent un autre jeu économique de calcul.

Regardons d'abord le coût d'appel API :

Seedance 2.0 de ByteDance facture son API de génération vidéo pure 1080p à 46 yuan RMB / 100 millions de Tokens. Selon des tests réels, générer une vidéo de 15 secondes consomme environ 308 880 Tokens, ce qui se traduit par un coût d'environ 1 yuan RMB (environ 0,14 dollar US) par seconde de vidéo de qualité commerciale.

C'est la réalité commerciale. Pour la grande majorité des entreprises, il est bien plus intéressant d'appeler directement une API fermée coûtant environ quatorze cents de dollar par seconde que de dépenser des millions de yuan pour acheter des serveurs H100 et se battre avec des modèles dits "open source".

Cadre à plusieurs millions : L'ultime barrière du combat des géants

Si vous pensez que le calcul bon marché est la seule barrière, vous vous trompez.

Pour accéder à Seedance 2.0 et utiliser des images de référence réelles pour générer des vidéos, les entreprises doivent signer un contrat cadre annuel prépayé de plusieurs millions. De plus, les nouveaux contrats cadres doivent verser 50% de l'acompte ou 1 million de yuan (la valeur la plus élevée étant retenue) comme caution, qui ne sera libérée progressivement qu'après un an.

Ce seuil de plusieurs millions est essentiellement une caution qui fait assumer la responsabilité principale aux entreprises — transférant le risque juridique de génération de deepfakes (vidéos truquées) par le biais de contrats commerciaux à des entreprises B2B de premier plan ayant une capacité à absorber les risques.

Mi-février de cette année, une vidéo réaliste générée par Seedance 2.0 par un réalisateur irlandais, montrant Tom Cruise et Brad Pitt se battre sur un toit, est devenue virale. Le 13 février, la lettre de cessation et d'abstention de l'avocat de Disney, David Singer, est arrivée chez ByteDance. L'Association cinématographique américaine (MPA) a ensuite accusé sévèrement Seedance 2.0 d'"utilisation non autorisée à grande échelle de contenu protégé par le droit d'auteur", et le syndicat d'acteurs SAG-AFTRA a également vivement critiqué l'utilisation non autorisée des portraits de ses membres.

Pour se protéger, les géants ont établi des barrières financières très élevées et un examen rigoureux de la solvabilité des entreprises (KYC).

Ils se moquent que les utilisateurs grand public puissent créer quelques vidéos amusantes, ils veulent devenir les "services publics" de la production de contenu industrialisé B2B. En monopolisant l'infrastructure de calcul et en établissant un système d'autorisation strict, ils bloquent complètement les concurrents de la longue traîne.

Le grand remaniement de l'ère post-Sora, qu'a-t-il laissé à l'industrie ?

Le jeu de l'infrastructure sous-jacente de la vidéo IA est déjà une table de jeu réservée aux géants lourds en capital et en calcul. Mais ce qui se joue sur la table, c'est l'infrastructure, tandis que dans les interstices sous la table, poussent des opportunités lucratives.

La logique centrale est simple, le coût du calcul baisse à vue d'œil — de plusieurs dollars par seconde à l'ère de Sora, à environ 1 yuan RMB par seconde pour Seedance 2.0 aujourd'hui, et théoriquement à un coût marginal local nul après l'open source de HappyHorse-1.0. Chaque fois que le coût baisse d'un ordre de grandeur, il fait émerger de nouveaux scénarios commerciaux.

Globalement, dans le domaine de la génération vidéo IA, les trois directions les plus prometteuses actuellement sont probablement :

Automatisation des vidéos de vente en ligne. Les vidéos de promotion de produits sur les plateformes de courtes vidéos chinoises sont encore principalement tournées manuellement, avec un coût unitaire de 500-2000 yuan et un cycle de production de 2-5 jours. Si l'on compresse ce coût à 10-50 yuan et le cycle de production à l'échelle de la minute grâce à la puissance de calcul API, toute la logique de diffusion sera réécrite — la quantité de matériel de test peut passer de 10 à 1000 vidéos par jour, l'efficacité et la précision des tests A/B seront considérablement améliorées.

Production industrialisée de mini-séries. Les mini-séries en format vertical explosent sur le marché mondial, avec un budget par épisode généralement de 50 000 à 150 000 yuan, mais le cycle de tournage et le coût des acteurs sont des goulots d'étranglement rigides. La vidéo IA ne peut pas encore remplacer le jeu d'acteur réel, mais elle peut déjà remplacer 30% à 40% des travaux de tournage sur des plans "non émotionnels" tels que les plans d'ambiance, les transitions ou les effets visuels, réduisant directement le coût total de production.

Localisation des publicités à l'international. Le même produit diffusé en Asie du Sud-Est, au Moyen-Orient et en Amérique latine nécessite du matériel publicitaire dans différentes langues, avec différentes ethnies et différents symboles culturels. La méthode traditionnelle nécessite des équipes de tournage dans plusieurs pays, la vidéo IA peut comprimer ce processus à une personne sur un ordinateur en une journée, et le coût n'augmente presque pas linéairement avec le nombre de marchés.

Ces trois directions ont une caractéristique commune : elles ne demandent pas que le modèle soit premier au classement, ni qu'il génère une qualité d'image cinématographique, mais elles exigent que le coût soit suffisamment bas, la vitesse suffisamment rapide et la stabilité suffisamment bonne — et c'est précisément le scénario pour lequel l'appel API est plus adapté que le déploiement local.

HappyHorse-1.0 a ouvert la porte. Mais derrière la porte se tiennent les infrastructures commerciales que ByteDance et Kuaishou ont construites depuis deux ans — la chaîne d'approvisionnement en calcul, le système d'examen de conformité, le réseau de clients B2B.

Un outsider technologique peut gagner des applaudissements pour un week-end, mais gagner la guerre nécessite des accumulations d'une autre dimension. À partir d'aujourd'hui, les règles de la concurrence dans la vidéo IA sont passées de "quel modèle est plus fort" à "quel flux de travail est plus épais".(Cet article a été publié pour la première fois sur l'application Titanium Media, auteur| AGI-Signal, éditeur| Lin Shen)