El hombre más rico del mundo y 'Iron Man de Silicon Valley', Elon Musk, llevará a SpaceX a cotizar en bolsa en 2026.

La valoración total es de aproximadamente 1,5 billones de dólares (alrededor de 10,6 billones de yuanes), y se planea que el tamaño de la financiación "supere significativamente los 30.000 millones de dólares". Si se logra, superará a Saudi Aramco en 2019 (29.400 millones de dólares) y se convertirá en la OPI más grande del mundo.

El gran objetivo de una valoración de 1,5 billones de dólares no puede depender solo del "sueño de las estrellas y el mar" de Starlink y Starship. Musk ha creado oportunamente un nuevo sueño: la capacidad de computación espacial.

Musk, en la conferencia anual de inversores de Baron Capital del 18 de noviembre, expuso por primera vez públicamente el concepto de "capacidad de IA espacial". "En cinco años, ejecutar el entrenamiento e inferencia de IA en el espacio será la opción de menor coste".

Musk señaló claramente que en la órbita terrestre hay un sol que nunca se pone y proporciona electricidad gratuita; el vacío cósmico es el disipador de calor definitivo; la reutilización de Starship reducirá drásticamente el coste de transportar materiales al espacio orbital terrestre.

Sin embargo, para aprovechar el espacio y la energía en el espacio, la capacidad de computación espacial requiere avances tecnológicos adicionales, incluyendo protección contra la radiación, disipación de calor, etc., lo que a su vez plantea problemas de rentabilidad, cuando originalmente el objetivo de llevar la computación al espacio era resolver precisamente el problema de la rentabilidad.

Un investigador senior aeroespacial bromeó: "Poner los datos del usuario bajo el violento viento solar para que se 'laven' no necesita un ordenador, necesita un suplemento para el cerebro".

01

El núcleo de la nueva narrativa: Capacidad de computación espacial

El "centro de datos espacial" propuesto por Musk no es una imaginación de ciencia ficción, sino que apunta directamente a los dos principales cuellos de botella de la infraestructura de IA terrestre actual: el coste energético y el coste de refrigeración.

Las características ambientales que ofrece el espacio lo convierten en una solución de sustitución disruptiva, que incluye principalmente un sol que nunca se pone y el vacío cósmico. El primero es una fuente de energía casi gratuita, y el segundo es el "disipador de calor definitivo" natural.

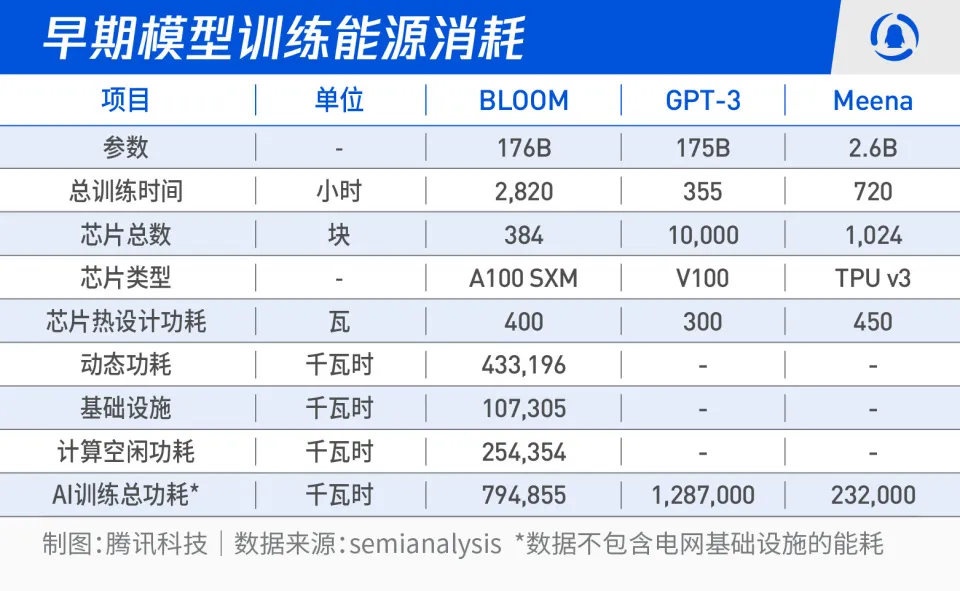

A medida que la escala de los modelos de IA se expande rápidamente, la energía se ha convertido en la mayor presión para la economía de la computación. Entrenar un modelo como GPT-5 podría costar cientos de millones de dólares, siendo el coste de la electricidad una parte extremadamente grande.

En primer lugar, los recursos de luz solar continuos: los satélites de órbita baja dan aproximadamente 16 vueltas a la Tierra al día. Mediante la distribución orbital y la programación de enlaces intersatelitales, las tareas pueden conmutarse en tiempo real a nodos situados en la zona iluminada, logrando un suministro de energía cercano a las 24 horas.

En segundo lugar, no se necesitan terrenos, redes eléctricas ni subestaciones. Una vez desplegada, la energía solar fotovoltaica espacial tiene un coste marginal de electricidad a largo plazo cercano a cero.

La energía y la infraestructura se abaratan en el espacio, pero hay que resolver el problema de la disipación de calor. La alta densidad térmica de las GPU de alto rendimiento hace que entre el 30% y el 40% de la electricidad de los centros de datos terrestres se consuma en refrigeración.

En el espacio, el entorno de vacío, al carecer de convección y conducción, disipa el calor solo por radiación térmica, lo que para los satélites en la cara iluminada equivale a un "modo barbacoa". Además, los rayos cósmicos y las partículas de alta energía podrían destrozar el proceso de computación de alto rendimiento.

"Es muy probable que los chips de computación que usas en tierra no funcionen en el cielo", enfatizó el investigador antes mencionado.

Otro pilar clave que sustenta la historia de la computación espacial de SpaceX es el coste de la capacidad de lanzamiento de Starship.

La rentabilidad de la computación espacial se basa en el coste de lanzamiento extremadamente bajo de Starship. El Starship V3 planeado por Musk (carga útil de unas 100 toneladas por lanzamiento) podría reducir el precio de transporte a 200-300 dólares por kilo tras su reutilización frecuente, muy por debajo de los cohetes actuales.

Según esta estimación, el coste de transporte de un centro de datos orbital de clase 200MW al espacio sería de unos 5.000-7.500 millones de dólares, aún muy por debajo de la inversión total necesaria para construir una supercomputadora de IA de clase similar en la Tierra (15.000-25.000 millones de dólares).

La historia siempre es hermosa, pero la realidad presenta muchos desafíos.

Además de los problemas de disipación de calor y radiación cósmica mencionados anteriormente, los promotores de la narrativa de la "computación espacial" tienen que considerar primero el problema de las explosiones y accidentes de cohetes: el coste de estos eventos de baja probabilidad superaría con creces el valor aportado por el aumento de la capacidad de lanzamiento, especialmente considerando que 1GW de capacidad de computación en la Tierra cuesta 50.000 millones de dólares.

Desde este punto de vista, todo vuelve al punto de partida original: el "problema económico".

En cuanto a la disipación de calor, aunque es posible utilizar el frío del espacio profundo para aliviarlo, esto plantea otro problema: la distancia es demasiado grande, por lo que se necesita otra fuente de energía más eficiente, como la nuclear, para reemplazar la solar.

Y en cuanto al problema de la radiación, aunque se puede abordar mediante el endurecimiento contra la radiación, esto añade desafíos técnicos y costes adicionales más allá de las GPU convencionales.

"El endurecimiento contra la radiación, los materiales y procesos en sí son caros, y además hay un límite incluso con el endurecimiento, que no es tan efectivo como la protección contra la radiación de la atmósfera", dijo el investigador antes mencionado.

Para abordar este problema, SpaceX está utilizando la experiencia de los chips de IA de nivel automotriz de Tesla: la arquitectura de triple redundancia (TMR) y la verificación en tiempo real mejoran significativamente la resistencia a la radiación.

02

Los impulsores de capital de Silicon Valley "suben al carro"

La nueva narrativa de la capacidad de computación espacial de SpaceX está recibiendo una fuerte respuesta de Wall Street y el capital de Silicon Valley.

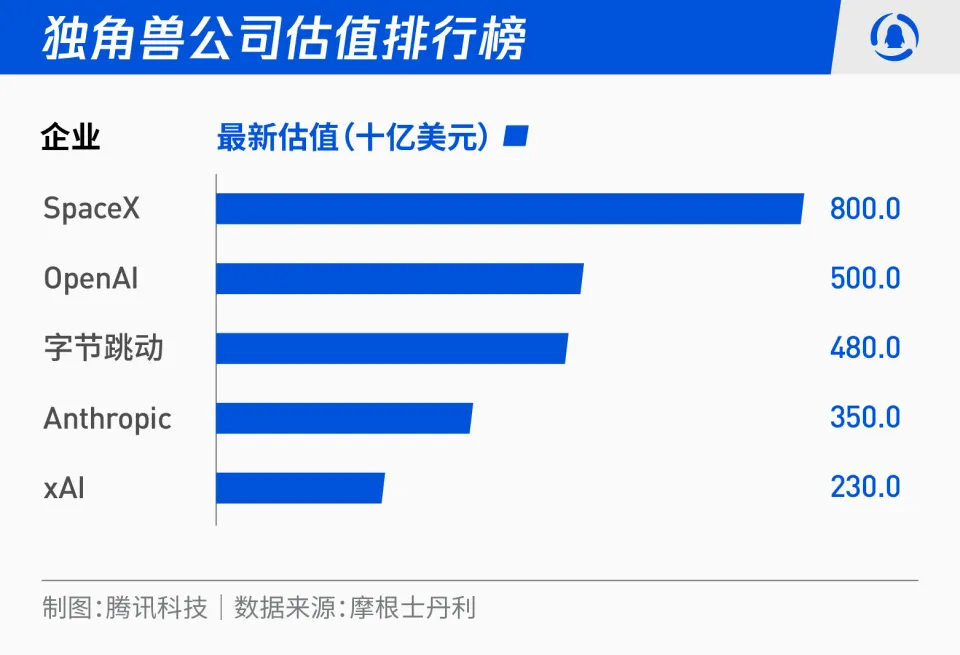

El banco de inversión Morgan Stanley, en un informe de investigación publicado recientemente, enfatizó que la reevaluación de la valoración de SpaceX proviene esencialmente de la nueva expansión de sus límites comerciales. El "centro de datos orbital" se ha convertido en una nueva narrativa de infraestructura de IA que impulsa su salto de valoración.

Wall Street ha respondido positivamente a la nueva historia que Musk ha "creado" para SpaceX. El ejemplo más representativo es Ark Investment, liderado por Cathie Wood ("Cathy la Leñadora").

Ark, en su último modelo, valoró explícitamente a SpaceX completamente como una empresa de infraestructura de IA y de software de alto crecimiento, no como una empresa aeroespacial o de telecomunicaciones tradicional. Casi toda la nueva valoración en su modelo proviene de la línea de negocio de "capacidad de IA espacial".

Como inversores veteranos de Musk, hicieron supuestos de escenario radicales: para 2030, los usuarios finales de Starlink alcanzarán los 120 millones, contribuyendo con 300.000 millones de dólares en ingresos anuales; los centros de datos orbitales aportarán ingresos adicionales de 80.000-120.000 millones de dólares, con un margen neto superior al 70%, muy por encima de los servicios cloud terrestres.

Ark Investment cree que el punto clave es reducir el coste de lanzamiento de Starship a menos de 100 dólares por kilo. Después de eso, el despliegue a escala de la capacidad de computación espacial crecerá exponencialmente, como lo hizo AWS de Amazon, impulsando a SpaceX a ser una empresa de 2,5 billones de dólares.

Por otro lado, la influencia del magnate de Silicon Valley Peter Thiel en SpaceX es aún más estratégica.

Como uno de los primeros y más cruciales inversores externos, Thiel, en 2008 cuando SpaceX tuvo tres lanzamientos fallidos consecutivos y estuvo al borde de la bancarrota, invirtió 20 millones de dólares a través de Founders Fund como "ayuda timely", "salvándola". Posteriormente, ha realizado múltiples inversiones adicionales en SpaceX.

El apoyo de Thiel a SpaceX va mucho más allá del dinero, es un respaldo de autoridad del sistema de pensamiento de Silicon Valley. La entrada de Peter Thiel equivale a respaldar la narrativa de la "capacidad de computación espacial". Más crucialmente, Thiel utiliza su influencia "Silicon Valley-Washington" para ganar espacio regulatorio y político clave para SpaceX.

El respaldo de estos grandes capitalistas equivale a poner una etiqueta de "creíble" en la valoración de 1,5 billones de dólares de SpaceX. Por lo tanto, Morgan Stanley señaló en el informe mencionado que, aunque Musk negó la "valoración de 800.000 millones de dólares" de los rumores, negó más la "acción de financiación" que la valoración en sí.

El progreso de Starship y Starlink, la obtención del espectro celular global directo, el centro de datos orbital como nueva narrativa, y la capacidad abrumadora de SpaceX que ocupa el 90% de la masa de lanzamiento global, hacen que el mercado de capitales crea que estas variables se convertirán en la "arteria principal de la futura infraestructura de IA".

03

Competencia, burbujas y riesgos

En los últimos años, impulsar el desarrollo de la computación espacial no ha sido solo Musk.

Ya en 2021, el Barcelona Supercomputing Center (BSC) y Airbus Defence and Space lanzaron conjuntamente el proyecto GPU4S (GPU for Space), financiado por la Agencia Espacial Europea (ESA), para verificar la viabilidad de las GPU integradas en aplicaciones espaciales.

El proyecto produjo el suite de benchmarks de código abierto GPU4S Bench, para evaluar el rendimiento en procesamiento de imágenes, navegación autónoma, etc., y produjo OBPMark, un suite de pruebas de benchmarks de código abierto adoptado por la ESA, sentando las bases para que Europa logre la autonomía tecnológica en el campo de la computación orbital.

El 2 de noviembre de 2025, el Falcon 9 de SpaceX lanzó con éxito el primer satélite de prueba Starcloud-1 de la startup Starcloud a la órbita terrestre baja. El satélite llevaba una GPU NVIDIA H100, verificando por primera vez la capacidad de procesamiento de datos de IA en órbita. Según se informa, NVIDIA y Starcloud desarrollaron conjuntamente una arquitectura de disipación de calor de vacío conjunto, que conduce el calor a través de materiales de alta conductividad térmica en el exterior del satélite hacia la superficie, disipándolo en forma de radiación infrarroja.

Como viejo rival de Musk en la carrera espacial comercial, Jeff Bezos también está impulsando a Blue Origin para desarrollar tecnología de centros de datos de IA orbitales, planeando utilizar energía solar espacial para alimentar la capacidad de computación de IA a gran escala.

Él predice que en los próximos 20 años, el coste de los centros de datos orbitales podría ser menor que el de las instalaciones terrestres.

Y otro oponente en el campo de la IA, el CEO de OpenAI, Sam Altman, también está ansioso por intentarlo, considerando adquirir la compañía de cohetes Stoke Space para llevar cargas útiles de computación de IA al espacio.

Puede decirse que el camino de SpaceX hacia la valoración de 1,5 billones en "capacidad de computación espacial" está lleno de desafiantes, pero el oponente más directo en esta etapa es Project Kuiper de Amazon.

Según información pública, Kuiper, a través de acuerdos de lanzamiento con Blue Origin, planea desplegar 3200 satélites entre 2026 y 2029. Su mayor ventaja radica en el ecosistema global de cloud de AWS, que puede ofrecer a las empresas productos de capacidad de computación híbridos "tierra + espacio".

Pero en opinión de Thiel, Kuiper sigue siendo una "extensión de la nube tradicional", su enfoque dependiente de la infraestructura terrestre no ha cambiado. Mientras que la IA espacial de SpaceX es un nuevo paradigma completo: trasladar el centro de computación mismo a la órbita, haciendo que los centros de datos terrestres sean una capa complementaria. Esta diferencia de paradigma determina el techo de ambas partes en la futura competencia de la "nube orbital".

Y más allá de los muchos desafíos técnicos y competitivos, tampoco se puede ignorar el problema de la regulación, incluida la gestión de desechos orbitales, la coordinación del espectro internacional y las controversias sobre la militarización del espacio, todo lo cual podría afectar el ritmo de avance de SpaceX en los próximos dos o tres años.

Volviendo a SpaceX: desde la "OPI de Starlink" en 2019, hasta "Starship es el activo central" en 2022, y ahora "el centro de datos espacial se convertirá en la capacidad de computación de IA más barata", Musk ha reescrito tres veces la narrativa de SpaceX en los últimos seis años, y casi cada vez ha pasado de las dudas a convertirse en un prototipo real.

Ahora, ha unido la capacidad de chips de Tesla, el modelo xAI, el ancho de banda de Starlink y la capacidad de lanzamiento de Starship en una estrategia unificada, apuntando directamente al recurso más caro de la era de la IA: la capacidad de computación de bajo coste.

Wall Street ya ha comenzado a apostar. La pregunta es: ¿podrá el nuevo "sueño espacial" del hombre más rico del mundo volver a materializarse?