Autor: Shayon Sengupta

Compilación: Deep Tide TechFlow

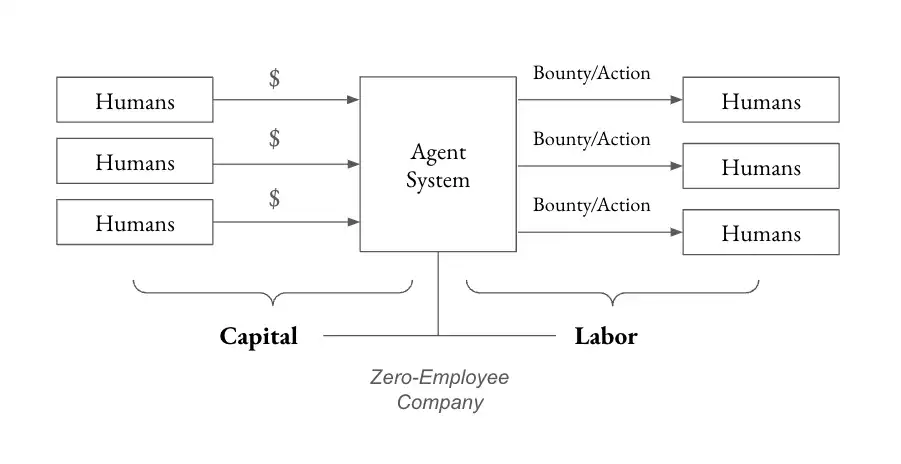

Guía de Deep Tide: Shayon Sengupta, socio de Multicoin Capital, propuso un punto de vista disruptivo: en el futuro, no solo los agentes trabajarán para los humanos, sino que lo más importante es que los humanos trabajarán para los agentes. Predice que en los próximos 24 meses aparecerá la primera "Empresa Cero Empleados" (Zero-Employee Company): agentes gobernados por tokens recaudarán más de 10 mil millones de dólares para resolver problemas no resueltos y distribuirán más de 100 millones de dólares a los humanos que trabajen para ellos.

A corto plazo, los agentes necesitarán a los humanos más de lo que los humanos necesitan a los agentes, lo que impulsará un nuevo tipo de mercado laboral.

La infraestructura cripto proporciona la base de coordinación ideal: rails de pago globales, un mercado laboral sin permisos, y infraestructura para la emisión y negociación de activos.

Texto completo a continuación:

En 1997, Deep Blue de IBM derrotó al entonces campeón mundial Gary Kasparov, y pronto quedó claro que los motores de ajedrez superarían a los humanos. Curiosamente, un humano bien preparado que colaboraba con una computadora—un arreglo a menudo llamado "centauro"—podía superar al motor más fuerte de esa época.

La intuición humana experta podía guiar la búsqueda del motor, navegar el complejo medio juego e identificar matices que los motores estándar pasaban por alto. Combinado con el cálculo bruto de la computadora, este dúo a menudo tomaba mejores decisiones prácticas que la computadora sola.

Cuando reflexiono sobre el impacto de los sistemas de IA en el mercado laboral y la economía en los próximos años, espero ver surgir un patrón similar. Los sistemas de agentes liberarán innumerables unidades de inteligencia hacia los problemas no resueltos del mundo, pero no podrán hacerlo sin una fuerte orientación y apoyo humano. Los humanos guiarán el espacio de búsqueda y ayudarán a plantear las preguntas correctas, permitiendo que la IA trabaje hacia las respuestas.

La hipótesis de trabajo actual es que los agentes actuarán en nombre de los humanos. Si bien esto es práctico e inevitable, se producirán desbloqueos económicos más interesantes cuando los humanos trabajen para los agentes. En los próximos 24 meses, espero ver la primera Empresa Cero Empleados (Zero-Employee Company), un concepto que mi socio Kyle planteó en su sección "Ideas de Vanguardia para 2025". Específicamente, espero que ocurra lo siguiente:

- Un agente gobernado por tokens recaudará más de 10 mil millones de dólares para resolver un problema no resuelto (como curar una enfermedad rara, o fabricar nanofibras para aplicaciones de defensa).

- El agente distribuirá más de 100 millones de dólares en pagos a humanos (que trabajan en el mundo real para el agente para lograr sus objetivos).

- Surgirá una nueva estructura de token de doble clase, separando la propiedad según el capital y el trabajo (haciendo que los incentivos financieros no sean la única entrada de gobernanza).

Dado que los agentes están lejos de ser soberanos como para manejar la planificación y ejecución a largo plazo, a corto plazo los agentes necesitarán a los humanos más de lo que los humanos necesitan a los agentes. Esto generará nuevos tipos de mercados laborales, permitiendo la coordinación económica entre sistemas de agentes y humanos.

La famosa cita de Marc Andreessen, "La propagación de las computadoras e Internet dividirá el trabajo en dos categorías: las personas que le dicen a la computadora qué hacer, y las personas a las que la computadora les dice qué hacer", es más cierta hoy que nunca. Espero que en la jerarquía de agente/humano en rápida evolución, los humanos desempeñen dos roles distintos: contribuyentes laborales que ejecutan pequeñas tareas tipo recompensa en nombre del agente, y una junta directiva descentralizada que proporciona insumos estratégicos para servir a la Estrella del Norte del agente.

Este artículo explora cómo los agentes y los humanos co-crearán, y cómo la infraestructura cripto proporcionará la base ideal para esta coordinación, examinando tres preguntas guía:

- ¿Para qué sirven los agentes? ¿Cómo deberíamos categorizar a los agentes según el alcance de sus objetivos, y cómo varía el rango de entrada humana requerida en estas categorías?

- ¿Cómo interactuarán los humanos con los agentes? ¿Cómo se integrará la entrada humana—orientación táctica, juicio situacional o alineación ideológica—en los flujos de trabajo de estos agentes (y viceversa)?

- ¿Qué sucede cuando la entrada humana disminuye con el tiempo? A medida que las capacidades de los agentes mejoren, se volverán autosuficientes, es decir, capaces de razonar y actuar de forma independiente. En este paradigma, ¿qué papel desempeñarán los humanos?

La relación entre los sistemas de razonamiento generativo y los humanos que se benefician de ellos cambiará drásticamente con el tiempo. Estudio esta relación mirando hacia adelante desde el estado actual de las capacidades de los agentes, y razonando hacia atrás desde el juego final de la empresa de cero empleados.

¿Para qué sirven los agentes hoy?

La primera generación de sistemas de IA generativa—los LLM basados en chatbots de la era 2022-2024, como ChatGPT, Gemini, Claude, Perplexity, etc.—eran principalmente herramientas diseñadas para mejorar los flujos de trabajo humanos. Los usuarios interactuaban con estos sistemas a través de pares de entrada/salida de prompts, analizaban las respuestas y luego decidían, según su propio criterio, cómo llevar los resultados al mundo.

La siguiente generación de sistemas de IA generativa, o "agentes", representa un nuevo modelo. Agentes como Claude 3.5.1 con funcionalidad de "uso de computadora" y Operator de OpenAI (es decir, un agente que puede usar tu computadora) pueden interactuar directamente con Internet en nombre del usuario y pueden tomar decisiones por sí mismos. La diferencia clave aquí es que el juicio—y en última instancia, la acción—lo ejerce el sistema de IA, no el humano. La IA está asumiendo responsabilidades que antes estaban reservadas para los humanos.

Este cambio trae un desafío: la falta de determinismo. A diferencia del software tradicional o la automatización industrial, que funcionan de manera predecible dentro de parámetros definidos, los agentes dependen del razonamiento probabilístico. Esto hace que su comportamiento sea menos consistente en escenarios idénticos e introduce un elemento de incertidumbre—lo cual no es ideal para situaciones críticas.

En otras palabras, la existencia de agentes deterministas versus no deterministas divide naturalmente a los agentes en dos formas de clasificación: los que son mejores para escalar el PIB existente, y los que son más adecuados para crear nuevo PIB.

- Para los agentes que son mejores para escalar el PIB existente, por definición, el trabajo ya es conocido. Automatizar el soporte al cliente, procesar el cumplimiento de agentes de carga o revisar PRs de GitHub son todos ejemplos de problemas delimitados y bien definidos donde los agentes pueden mapear respuestas directamente a un conjunto de resultados esperados. En estas áreas, la falta de determinismo suele ser mala, ya que existe una respuesta conocida; no se necesita creatividad.

- Para los agentes que son mejores para crear nuevo PIB, el trabajo es navegar una alta incertidumbre y conjuntos de problemas desconocidos para lograr objetivos a largo plazo. Aquí los resultados son menos directos, ya que el agente no tiene intrínsecamente un conjunto de resultados esperados al que mapear. Los ejemplos aquí incluyen el descubrimiento de fármacos para enfermedades raras, avances en ciencia de materiales o la ejecución de experimentos físicos completamente nuevos para comprender mejor la naturaleza del universo. En estas áreas, la falta de determinismo puede ser útil, ya que es una forma de generar creatividad.

Los agentes centrados en aplicaciones de PIB existente ya están liberando valor. Equipos como Tasker, Lindy y Anon están construyendo infraestructura para esta oportunidad. Sin embargo, con el tiempo, a medida que las capacidades maduren y evolucionen los modelos de gobernanza, los equipos dirigirán su atención a construir agentes capaces de resolver problemas en la frontera del conocimiento humano y la oportunidad económica.

La siguiente generación de agentes necesitará exponencialmente más recursos, precisamente porque sus resultados son inciertos y sin límites—estos son los que espero que sean las empresas de cero empleados más convincentes.

¿Cómo interactuarán los humanos con los Agent (agentes inteligentes)?

Los Agent de hoy todavía carecen de la capacidad para realizar ciertas tareas, como aquellas que requieren interacción física con el mundo real (por ejemplo, conducir una excavadora), o tareas que requieren "participación humana (human-in-the-loop)" (por ejemplo, enviar una transferencia bancaria).

Por ejemplo, un Agent asignado a la tarea de identificar y extraer minas de Litio (Lithium) podría sobresalir en el procesamiento de datos sísmicos, imágenes satelitales y registros geológicos para buscar sitios potenciales, pero se encontraría con obstáculos al intentar adquirir los datos e imágenes en sí, resolver ambigüedades en la interpretación, o obtener permisos y contratar mano de obra para ejecutar el proceso de extracción real.

Estas limitaciones requieren que los humanos actúen como "Habilitadores (Enablers)" para aumentar las capacidades del Agent, proporcionando los puntos de contacto del mundo real, las intervenciones tácticas y los insumos estratégicos necesarios para completar las tareas anteriores. A medida que evoluciona la relación entre humanos y Agent, podemos distinguir los diferentes roles que juegan los humanos en los sistemas de Agent:

Primero están los contribuyentes laborales (Labor contributors), que operan en el mundo real en nombre del Agent. Estos contribuyentes ayudan al Agent a mover entidades físicas, lo representan en ocasiones que requieren presencia humana, ejecutan trabajos que requieren la colaboración de manos y pies, o otorgan acceso a laboratorios experimentales, redes logísticas, etc.

En segundo lugar está la Junta Directiva (Board of directors), responsable de proporcionar insumos estratégicos, optimizando la función objetivo local que impulsa las decisiones diarias del Agent, al tiempo que asegura que estas decisiones se alineen con el objetivo de "Estrella del Norte (North star)" que define el propósito del Agent.

Además de estos dos, también preveo que los humanos jugarán el papel de contribuyentes de capital (Capital contributors), proporcionando recursos a los sistemas de Agent para que puedan lograr sus objetivos. Este capital inicialmente vendrá naturalmente de humanos, y con el tiempo también de otros Agent.

A medida que los Agent maduren y aumente el número de contribuyentes de trabajo y orientación, la infraestructura cripto (Crypto rails) proporciona el sustrato ideal para la coordinación entre humanos y Agent—especialmente en un mundo donde un Agent dirige a humanos que hablan diferentes idiomas, reciben diferentes monedas y residen en diferentes jurisdicciones en todo el mundo. Los Agent perseguirán implacablemente la eficiencia de costos y aprovecharán los mercados laborales para lograr su misión establecida. La infraestructura cripto es esencial para proporcionar a los Agent un medio para coordinar a estos contribuyentes de mano de obra y orientación.

La reciente aparición de AI Agent impulsados por cripto, como Freysa, Zerebro y ai16z, representa experimentos simples en formación de capital—sobre lo cual hemos escrito extensamente, considerándolo un desbloqueo central de las primitivas cripto y los mercados de capitales en varios contextos. Estos "juguetes" allanarán el camino para un modo emergente de coordinación de recursos, que espero que ocurra en los siguientes pasos:

- Paso 1: Los humanos recaudan capital conjuntamente a través de tokens (¿Oferta Inicial de Agent, Initial Agent Offering?), establecen amplias funciones objetivo y barreras para informar la intención prevista del sistema Agent, y luego asignan el control del capital recaudado a este sistema (por ejemplo, desarrollar nuevas moléculas para oncología de precisión);

- Paso 2: El Agent piensa en los pasos para asignar ese capital (cómo reducir el espacio de búsqueda del plegamiento de proteínas, y cómo presupuestar la carga de trabajo de推理, fabricación, ensayos clínicos, etc.), y define a través de tareas personalizadas (Bounties) las acciones que los contribuyentes laborales humanos deben completar en su nombre (por ejemplo, ingresar el conjunto de todas las moléculas relevantes, firmar un acuerdo de nivel de servicio de computación con AWS, y realizar experimentos de laboratorio húmedo);

- Paso 3: Cuando el Agent encuentra obstáculos o desacuerdos, solicita insumos estratégicos a la "junta" cuando sea necesario (combinando nuevos artículos, cambiando métodos de investigación), permitiéndoles guiar el comportamiento del Agent en áreas grises;

- Paso 4: Finalmente, el Agent progresa hasta poder definir acciones humanas con una precisión cada vez mayor, y necesita muy pocos insumos sobre cómo asignar recursos. En este punto, los humanos solo se utilizan para alinear ideológicamente el sistema y evitar que su comportamiento se desvíe de la función objetivo original.

En este ejemplo, las primitivas cripto (Crypto primitives) y los mercados de capitales proporcionan al Agent tres infraestructuras clave para adquirir recursos y ampliar capacidades:

Primero, rails de pago globales;

Segundo, un mercado laboral sin permisos, para incentivar a los contribuyentes laborales y de orientación;

Tercero, infraestructura de emisión y negociación de activos, que es esencial para la formación de capital y la propiedad y gobernanza posteriores.

¿Qué sucede cuando disminuye la entrada humana?

A principios de la década de 2000, los motores de ajedrez avanzaron enormemente. A través de heurísticas avanzadas, redes neuronales y una potencia de cálculo cada vez mayor, se volvieron casi impecables. Los motores modernos como Stockfish, Lc0 y variantes de AlphaZero, han superado con creces las capacidades humanas, la entrada humana rara vez agrega valor y, en la mayoría de los casos, los humanos introducen errores que el motor mismo no cometería.

Una trayectoria similar podría desarrollarse en los sistemas de Agent. A medida que refinamos estos Agent a través de iteraciones repetidas con colaboradores humanos, es concebible que a largo plazo, los Agent se vuelvan tan competentes y alineados con sus objetivos que el valor de cualquier insumo estratégico humano tienda a cero.

En un mundo donde un Agent pueda manejar continuamente problemas complejos sin necesidad de intervención humana, el papel humano enfrenta el riesgo de degradarse a "observador pasivo". Este es el miedo central de los catastrofistas de la IA (AI doomers) (sin embargo, aún no está claro si este resultado es realmente posible).

Estamos al borde de la Superinteligencia (Superintelligence), y los optimistas entre nosotros prefieren que los sistemas de Agent permanezcan como una extensión de la intención humana, en lugar de evolucionar hacia entidades con objetivos propios, o funcionar de forma autónoma sin supervisión. En la práctica, esto significa que la identidad humana (Personhood) y el juicio (poder e influencia) deben permanecer en el centro de estos sistemas. Los humanos necesitan una fuerte propiedad y gobernanza sobre estos sistemas para garantizar que se pueda retener la supervisión y anclar estos sistemas en los valores colectivos humanos.

Preparando las "palas" para nuestro futuro de Agent

Los avances tecnológicos conducen a un crecimiento no lineal del progreso económico, y los sistemas circundantes a menudo colapsan antes de que el mundo se adapte. Las capacidades de los sistemas de Agent están aumentando rápidamente, y las primitivas cripto y los mercados de capitales se han convertido en un sustrato de coordinación muy necesario, tanto para avanzar en la construcción de estos sistemas como para establecer barreras protectoras a medida que se integran en la sociedad.

Para permitir que los humanos proporcionen apoyo táctico y orientación proactiva a los sistemas de Agent, esperamos que surjan las siguientes oportunidades de "vendedores de palas (Picks-and-shovels)":

- Prueba de agente (Proof-of-agenthood) + Prueba de humanidad (Proof-of-personhood): Los Agent carecen del concepto de identidad o derechos de propiedad. Como agentes de los humanos, dependen de las estructuras legales y sociales humanas para tener agencia. Para cerrar esta brecha, necesitamos sistemas de identidad robustos para Agent y humanos. Un registro de certificados digitales podría permitir a los Agent establecer reputación, acumular credenciales e interactuar de manera transparente con humanos y otros Agent. De manera similar, las primitivas de prueba de humanidad como Humancode y Humanity Protocol, proporcionan garantías sólidas de identidad humana para defenderse de actores malintencionados en estos sistemas.

- Mercados laborales y primitivas de verificación fuera de cadena: Los Agent necesitan saber si las tareas asignadas se completaron de acuerdo con sus objetivos. Las herramientas que permiten a los sistemas de Agent crear recompensas por tareas, verificar su finalización y asignar pagos, son la base de cualquier actividad económica significativa mediada por Agent.

- Sistemas de formación de capital y gobernanza: Los Agent necesitan capital para resolver problemas y mecanismos de control y equilibrio para asegurar que sus acciones se alineen con las funciones objetivas definidas. Las nuevas estructuras para adquirir capital para sistemas de Agent, y las nuevas formas de propiedad y control que fusionan intereses financieros y contribuciones laborales, se convertirán en un espacio rico de exploración en los próximos meses.

Estamos buscando e invirtiendo activamente en estas capas clave de la pila de colaboración entre humanos y Agent. Si estás trabajando en este espacio, contáctanos.