Nota del editor: En el contexto del continuo aumento de la narrativa de inversión e industria de la IA, la pregunta de "si existe una burbuja" se ha convertido en un tema central de discusión en el mercado. Por un lado, las narrativas de riesgo extremo continúan intensificando la preocupación por la pérdida de control de la tecnología; por otro, los rápidos gastos de capital y los niveles de valoración también mantienen viva la teoría de la "burbuja". Bajo esta divergencia, el juicio del mercado muestra una clara incertidumbre.

El autor de este artículo, Ben Thompson, es el fundador de la plataforma de análisis tecnológico Stratechery y ha seguido durante mucho tiempo la evolución de la estructura industrial y los modelos de negocio del sector tecnológico. En vísperas de la celebración de la GTC 2026 de Nvidia, rectificó su juicio previo sobre "si la IA está en una burbuja": ya no ve el momento actual como una burbuja, sino como un crecimiento estructural impulsado por cambios en el paradigma tecnológico.

Este juicio se basa en la observación de tres transiciones clave de los LLM. Desde que ChatGPT mostró por primera vez las capacidades de los modelos de lenguaje grande (LLM) al mercado en 2022, estos han pasado de ser "utilizables pero no confiables" a "poseer capacidad de razonamiento" y luego a "poder ejecutar tareas de forma independiente". Especialmente a finales de 2025, con el lanzamiento de Anthropic Opus 4.5 y OpenAI GPT-5.2-Codex, las cargas de trabajo de agentes (agentic) comenzaron a pasar del concepto a la realidad.

La clave no está en los modelos mismos, sino en la aparición del "arnés de agente" (agent harness). El agente desacopla al usuario del modelo, se encarga de gestionar el modelo, invocar herramientas y verificar resultados, transformando a la IA de una herramienta que requiere intervención humana constante a un sistema de ejecución al que se le pueden encomendar tareas. Este cambio no solo mejora la confiabilidad, sino que también expande las fronteras de aplicación de la IA.

Basándose en este cambio de paradigma, el autor señala además que la expansión de la demanda de IA ya no depende de la escala de usuarios, sino más bien de la capacidad de gestión por usuario; al mismo tiempo, las cargas de trabajo de agentes tienen características de "el ganador se lo lleva todo", lo que continuará impulsando la demanda de potencia de cálculo de alto rendimiento y creará oportunidades estructurales para los fabricantes de chips y los proveedores de servicios en la nube.

En este marco, los grandes gastos de capital actuales ya no son solo apuestas especulativas sobre el futuro, sino más bien una respuesta anticipada a una demanda real. A medida que la IA pasa de ser una "herramienta de asistencia" a una "infraestructura de ejecución", su impacto económico quizás recién esté comenzando a manifestarse.

A continuación, el texto original:

En el pasado, me inclinaba más por lo segundo, incluso pensaba que una burbuja, en ciertas etapas, no necesariamente era algo malo.

Pero ahora, en marzo de 2026, en la inauguración de la GTC de Nvidia, mi juicio ha cambiado: esto no necesariamente es una burbuja. (Y, irónicamente, este juicio en sí mismo podría ser precisamente la señal de una burbuja).

Las tres transiciones de paradigma de los LLM

En las últimas semanas, al discutir los resultados financieros de Nvidia y Oracle, he mencionado repetidamente que los LLM ya han experimentado tres transiciones clave.

Primera fase: ChatGPT

El primer punto de inflexión fue el lanzamiento de ChatGPT en noviembre de 2022, algo que casi no necesita explicación. Aunque los modelos de lenguaje grande basados en Transformer existían desde 2017 y sus capacidades mejoraban continuamente, fueron subestimados durante mucho tiempo. Incluso en octubre de 2022, en una entrevista para Stratechery, pensaba que esta tecnología, aunque sorprendente, carecía de productización y dinamismo emprendedor.

Pero unas semanas después, todo cambió radicalmente. ChatGPT hizo que el mundo se diera cuenta por primera vez de las capacidades de los LLM.

Sin embargo, las versiones iniciales también dejaron dos impresiones profundas, especialmente citadas por los "teóricos de la burbuja":

Primero, el modelo often se equivocaban, incluso "alucinaban" inventando respuestas cuando no las sabían. Esto lo hacía parecer más una "herramienta para presumir", impresionante pero poco fiable.

Segundo, aun así era muy útil, pero solo si sabías cómo usarlo y necesitabas verificar constantemente su output, corrigiendo errores.

Segunda fase: o1

El segundo punto de inflexión fue el lanzamiento del modelo o1 por OpenAI en septiembre de 2024. Para entonces, los LLM ya habían mejorado significativamente gracias a modelos base más potentes y técnicas de post-entrenamiento, siendo su output más preciso y con menos alucinaciones.

Pero el avance clave de o1 fue: "pensaba" antes de responder.

Los LLM tradicionales son dependientes de la ruta; una vez que se equivocan en el proceso de razonamiento, continúan equivocándose hasta el final. Esta es una debilidad fundamental de los modelos "autoregresivos". En cambio, los modelos de razonamiento se evalúan a sí mismos, generan una respuesta, juzgan si es correcta y, si es necesario, intentan otro camino.

Esto significa que el modelo comenzó a gestionar activamente los errores, reduciendo la carga de intervención del usuario. Los resultados fueron muy significativos. Si el avance de ChatGPT fue "hacer que los LLM sean utilizables", el avance de o1 fue "hacer que los LLM sean confiables".

Tercera fase: Agente (Opus 4.5 / Codex)

A finales de 2025, apareció la tercera transición.

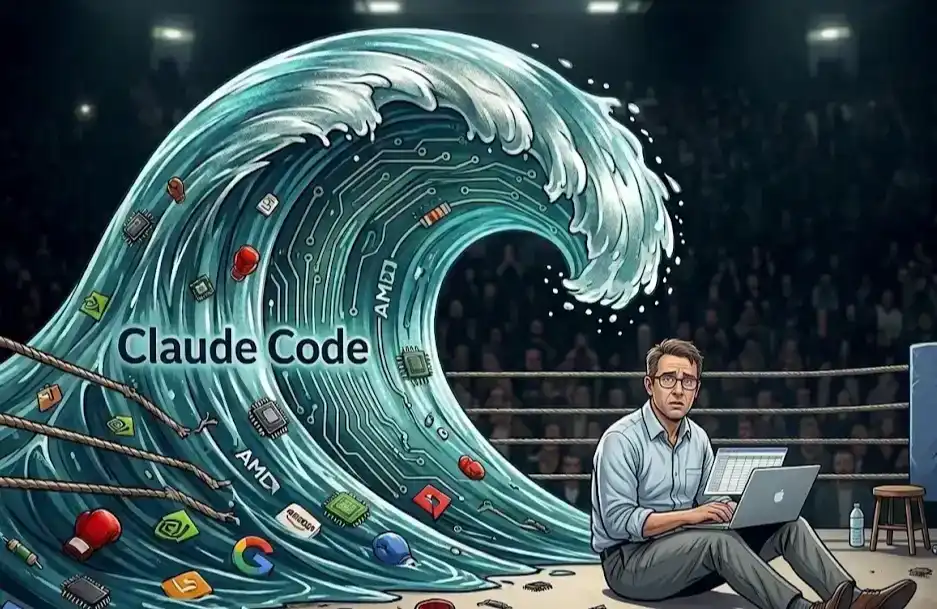

En noviembre de 2025, Anthropic lanzó Opus 4.5, que tuvo inicialmente una recepción moderada. Pero en diciembre, Claude Code, equipado con este modelo, mostró de repente capacidades sin precedentes; casi al mismo tiempo, OpenAI lanzó GPT-5.2-Codex, mostrando un nivel similar.

La gente había estado hablando de "Agentes", pero en este momento, finalmente comenzaron a realizar tareas de verdad, incluso tareas complejas que requerían horas, y las hacían correctamente.

La clave no está en el modelo, sino en la capa de control (harness), la capa de software que gestiona el modelo, invoca herramientas y ejecuta flujos. En otras palabras, el usuario ya no opera el modelo directamente, sino que da un objetivo, y el Agente gestiona el modelo, invoca herramientas, ejecuta el flujo y verifica los resultados.

Tomemos la programación como ejemplo:

· Primera fase: el modelo genera código.

· Segunda fase: el modelo razona durante el proceso de generación.

· Tercera fase: el Agente genera código → ejecuta pruebas → ejecuta pruebas automáticamente → si hay error, lo intenta de nuevo, sin necesidad de que el usuario intervenga continuamente.

Esto significa que los defectos centrales de la era ChatGPT se están resolviendo sistémicamente: mayor tasa de acierto, mayor capacidad de razonamiento, mecanismos de verificación automática.

La única pregunta restante es: ¿para qué deberíamos usarlo realmente?

La razón por la que insisto en estos tres puntos de inflexión es para explicar por qué toda la industria tiene una grave escasez de capacidad de cálculo y por qué los gastos de capital a hiperescala son razonables.

Los tres paradigmas tienen demandas de potencia de cálculo completamente diferentes:

· Primera fase: el entrenamiento consume mucha potencia, pero el coste de inferencia es bajo.

· Segunda fase: el coste de inferencia se dispara (más tokens + mayor frecuencia de uso).

· Tercera fase (Agente): múltiples llamadas al modelo de inferencia, el Agente en sí consume potencia (incluso tendiendo a la CPU), la frecuencia de uso explota aún más.

Pero lo más importante es el tercer punto: el cambio en la estructura de la demanda está gravemente subestimado.

Actualmente, hay muchas más personas usando chatbots que Agentes, y mucha gente en realidad no usa la IA plenamente. La razón es que usar IA requiere "iniciativa". Los LLM son herramientas, no tienen objetivos, no tienen voluntad, solo pueden ser invocados activamente.

Pero el Agente cambia esto, reduce la exigencia de iniciativa humana. En el futuro, una persona puede dirigir múltiples Agentes simultáneamente.

Esto significa que, incluso si solo unas pocas personas tienen "iniciativa", es suficiente para impulsar una enorme demanda de potencia de cálculo y producción económica.

La IA todavía necesita "ser impulsada por personas", pero ya no necesita "a muchas personas".

La disposición a pagar por la IA en el consumo es limitada, esto se ha ido aclarando gradualmente. Quienes realmente están dispuestos a pagar por la productividad son las empresas.

Lo que más emociona a las empresas no es solo que la IA mejore la eficiencia, sino que puede reemplazar mano de obra, y de manera más eficiente.

La realidad actual es que, en las grandes empresas, quienes realmente impulsan el negocio forward suelen ser una minoría; pero las organizaciones son enormes, lo que genera grandes costes de coordinación. El papel del Agente es amplificar la influencia de "quienes generan valor" y, al mismo tiempo, reducir la fricción organizativa.

El resultado es "menos personas → mayor producción → menores costes". Por eso, los futuros despidos probablemente no sean solo "ajustes cíclicos", sino cambios estructurales.

Las empresas reconsiderarán, no solo si "contrataron a demasiada gente durante la pandemia", sino también si, en la era de la IA, realmente necesitan tanta gente.

¿Por qué esto no es una burbuja?

Desde esta perspectiva, la lógica de "no es una burbuja" es bastante clara:

1. Los defectos centrales de los LLM se están resolviendo continuamente con potencia de cálculo y arquitectura.

2. El umbral de número de personas que impulsan la demanda está disminuyendo.

3. Los beneficios que traen los Agentes no son solo reducir costes, sino también aumentar ingresos.

Por lo tanto, es comprensible por qué todos los proveedores de nube dicen que la capacidad de cálculo es insuficiente y continúan aumentando significativamente los gastos de capital.

Agentes y reconfiguración de la cadena de valor

Otra cuestión clave es: si los modelos finalmente se commoditizan, ¿podrán OpenAI y Anthropic seguir ganando dinero?

La visión tradicional dice que no, pero los Agentes cambian esto. La clave está en que el valor real no está en el modelo mismo, sino en la integración de "modelo + sistema de control".

El beneficio tiende a fluir hacia la "capa de integración", no hacia los módulos reemplazables. Al igual que Apple, su hardware no se commoditiza porque está profundamente integrado con el software. Del mismo modo, un Agente necesita una profunda sinergia entre el modelo y el harness, lo que convierte a OpenAI y Anthropic en integradores clave en la cadena de valor, no en un eslabón reemplazable.

El cambio de Microsoft es una señal; originalmente enfatizaba que "el modelo es reemplazable", pero tras lanzar productos de Agente reales, tuvo que abandonar esto.

Esto significa que los modelos podrían no commoditizarse completamente, porque los Agentes necesitan capacidades integradas.

La paradoja final

Debo volver a la paradoja del principio.

Siempre he pensado que, mientras la gente siga preocupada por una burbuja, entonces aún no lo es; la verdadera burbuja es cuando nadie la cuestiona más.

Y ahora, mi conclusión es: esto no es una burbuja.

Pero si el hecho de que "yo diga que esto no es una burbuja" en sí mismo demuestra que lo es, entonces que así sea.