El costo de la inferencia de IA ha caído más del 80% en 18 meses, pero los tres principales proveedores de la nube de China anunciaron aumentos de precios en la misma semana. Esta será una contienda de precios estructural que durará al menos de dos a tres años. Este artículo intenta responder una pregunta más importante: ¿Cuándo terminará?

Mañana (18 de abril), Alibaba Cloud y Baidu AI Cloud comenzarán oficialmente a ajustar sus precios. Tres semanas después, Tencent Cloud también experimentará una nueva ronda de aumentos. A nivel mundial, OpenAI y Anthropic han reducido el precio de sus API en más del 80% en los últimos 18 meses, y la aparición de DeepSeek-R1 hizo creer aún más que el costo de inferencia pronto llegaría a cero.

El resultado: los tres principales proveedores de la nube de China anunciaron aumentos de precios del 20% al 30% en la misma semana.

Figura | Línea de tiempo de eventos de aumento de precios en la nube global en 2026

La primera reacción de los medios fue "la guerra de precios ha terminado, los grandes fabricantes comienzan a cosechar". Esta afirmación no es incorrecta, pero se queda en la interpretación más superficial. Explica por qué los proveedores de la nube están aumentando los precios, pero no responde la pregunta clave: ¿Este aumento de precios es una corrección temporal o el inicio de una tendencia sostenida? La respuesta se esconde en una paradoja económica de hace 150 años.

01.

Paradoja de Jevons: Cuanto más barato, más se consume

En 1865, el economista británico William Jevons observó un fenómeno contraintuitivo: después de que mejoró la eficiencia de la máquina de vapor, el consumo total de carbón en el Reino Unido aumentó drásticamente: la mejora de la eficiencia redujo el costo de uso, desencadenando una explosión de la demanda. Esta es la Paradoja de Jevons (Jevons Paradox), que se replica con precisión en el mercado de la capacidad de cálculo en 2026.

DeepSeek-R1 ciertamente redujo drásticamente el costo de inferencia por Token. Pero al mismo tiempo abrió una compuerta de demanda: muchas empresas que antes consideraban que "la IA es demasiado cara" comenzaron a integrar la IA en sus procesos comerciales. Una vez integrada, el consumo de Tokens se expande a una velocidad no lineal.

Un cambio más crucial es que la aplicación de la IA ha pasado del "diálogo" a "hacer cosas": han llegado los Agent y los Reasoning Model. Una tarea que antes consumía 1000 Tokens, después de conectar una cadena de pensamiento consume 5000, porque el Reasoning Model "piensa" por sí mismo, con un consumo de 10 a 50 veces mayor que el modo normal.

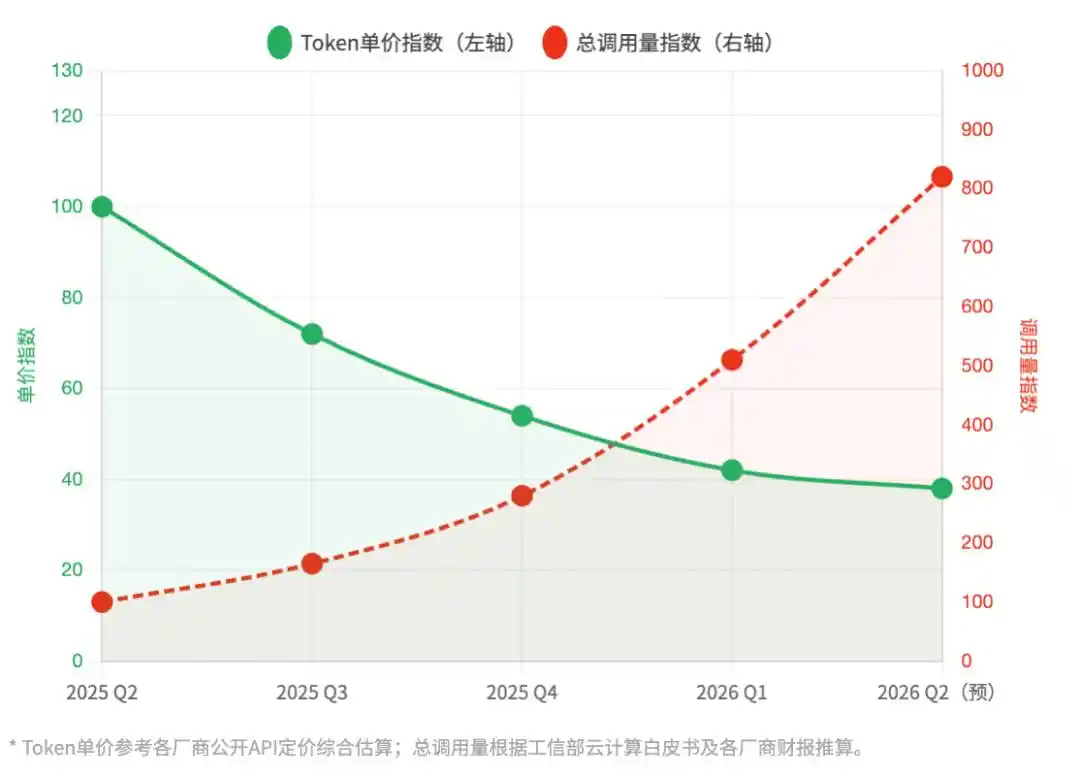

Figura | Antes y después del lanzamiento de DeepSeek: Precio unitario del Token vs. Tendencia de cambio del volumen total de llamadas

Nota: 2025Q2 = Base 100 | Estimación integral de API de inferencia de los principales proveedores de nube chinos

DeepSeek redujo el umbral de entrada, pero rompió el techo de la capacidad de cálculo. Cada unidad de Token es cada vez más barata, pero cada tarea comercial es cada vez más cara. Esta es la base real sobre la que se sustenta esta ronda de aumentos.

02.

Pesos de código abierto, pero no la pila de inferencia

Otro detalle pasado por alto en muchos reportajes: DeepSeek abrió los pesos del modelo, pero no su pila de optimización de inferencia. La diferencia entre estos dos es como recibir los planos de diseño de un motor, pero que no te digan cómo ajustarlo para obtener el rendimiento de un F1.

Lo que realmente determina el costo de inferencia no es solo la arquitectura del modelo, sino la capacidad de ingeniería oculta bajo la superficie: la tasa de acierto de la decodificación especulativa (Speculative Decoding), la estrategia de gestión de memoria de la Caché KV, la optimización de la separación entre las fases de Prefill y Decode, la topología de red de los clústeres de diez mil tarjetas. Estas habilidades técnicas duras siguen siendo la fortaleza de unos pocos proveedores de nube líderes.

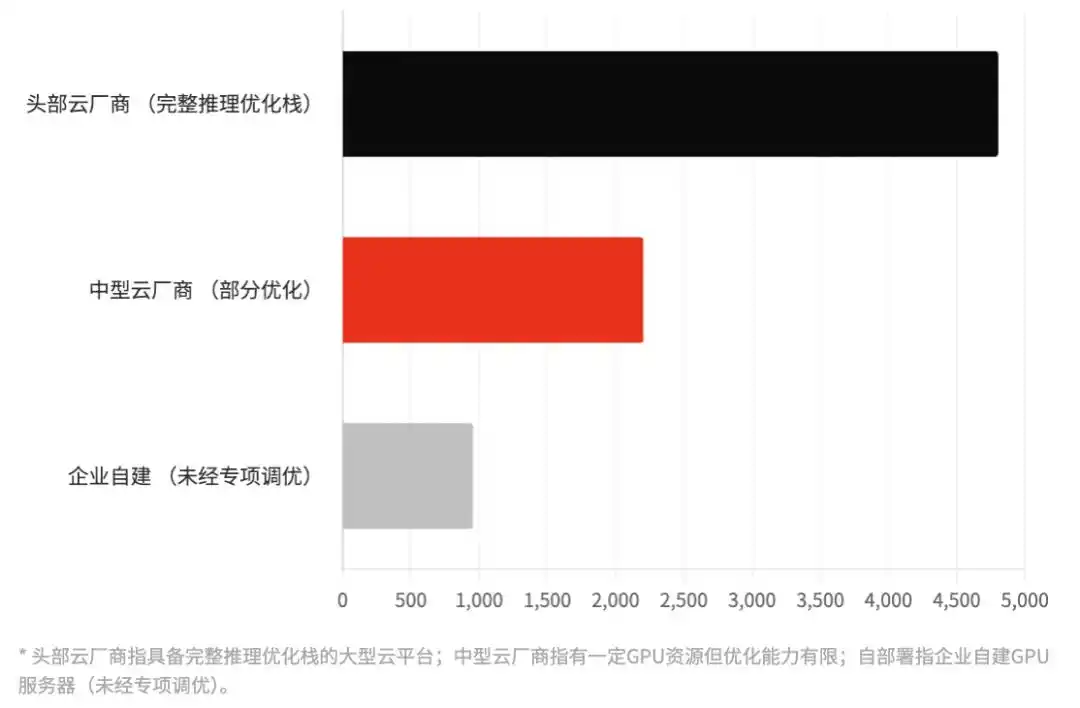

Figura | Brecha real de eficiencia de inferencia bajo la misma escala de modelo

Usando DeepSeek-R1-67B como referencia, comparación de Tokens procesados por segundo (TPS) bajo diferentes condiciones de implementación | Los valores son estimaciones integrales de la industria.

Ejecutando el mismo DeepSeek-R1, la eficiencia de inferencia de los proveedores de nube líderes puede ser de 3 a 5 veces mayor que la de las empresas que lo construyen ellas mismas. Esto significa que, con la misma inversión en capacidad de cálculo, los proveedores de nube pueden servir más concurrencia y tienen un costo unitario menor.

Esta diferencia de eficiencia es una de las fuentes del "sobreprecio" de los proveedores de nube. Es una barrera de ingeniería real. Por lo tanto, este aumento de precios, en cierto modo, también está poniendo precio a su ventaja tecnológica.

03.

Guerra de los Dioses: Los libros de cuentas y ambiciones de cuatro gigantes

En esta ola de ajustes de precios colectivos, los cuatro gigantes centrales tienen posturas diferentes, que reflejan diferentes cálculos comerciales.

Alibaba Cloud: La batalla de "calidad de beneficio" al estilo de Yongming Wu. El ajuste de precios de Alibaba es el más firme, con aumentos concentrados principalmente en instancias de GPU de gama alta y almacenamiento (CPFS). En el contexto del regreso total de Alibaba a la "eficiencia primero", Alibaba Cloud ya no busca la llamada "primera participación en el mercado de la nube", sino competir por el "primer margen de beneficio en capacidad de cálculo de IA". El mensaje subyacente es que Alibaba Cloud está estableciendo una "zona VIP de capacidad de cálculo". Si no puedes cubrir este sobreprecio del 30%, es posible que no estés en la lista de clientes objetivo central de Alibaba.

Baidu AI Cloud: "Filtro de usuarios". Baidu, como el jugador que apostó más temprano por los grandes modelos, enfrenta la presión de que el costo de inferencia de su gran modelo Ernie aumenta con el salto de orden de magnitud en el volumen de llamadas. Por lo tanto, el aumento de precios de Baidu se parece más a un "revolución de usuarios". Está lavando activamente a aquellos pequeños desarrolladores individuales que solo buscan beneficios sin crear un ciclo comercial cerrado, para servir en cambio全力 a grandes clientes empresariales insensibles al precio. Baidu necesita demostrar mediante el ajuste de precios: que su crecimiento en IA ya no depende de subsidios, sino de "vender intelecto con prima".

Tencent Cloud: "Corrección del ROI" después del bloqueo del ecosistema. La acción de Tencent Cloud llegó tres semanas después que la de Alibaba, una típica "estrategia de seguimiento". La confianza de Tencent reside en la profunda integración del ecosistema de WeChat y Enterprise WeChat. Cuando el flujo de trabajo de las empresas ya está profundamente incrustado en el ecosistema social/colaborativo de Tencent, el costo de migración es extremadamente alto. El aumento de precios de Tencent Cloud se parece más a un "aumento compensatorio", utilizado para corregir el ROI sacrificado en los últimos dos años para apoderarse del ecosistema, haciendo que el negocio de IA se vea más "presentable" en los informes financieros.

Volcano Engine: Seguimiento estratégico "desequilibrado" y plan para captar talento. Volcano Engine (ByteDance) es la variable en esta ola de aumentos. Aunque también ajustó algunos precios, en muchas API centrales el aumento fue significativamente menor que el de Alibaba y Baidu. Byte está utilizando esta ventana para realizar una "intercepción de la base existente". Gracias a la terrorífica capacidad de absorción de capacidad de cálculo que le brindan internamente Douyin y TikTok, Volcano tiene un poderoso fondo de reducción de costos. Mientras los oponentes "expulsan clientes" para proteger ganancias, Volcano espera a aquellos que se quedan atrás, intentando completar una última superación en volumen de instalaciones" mediante la diferencia de precios.

04.

La mayor sorpresa: Las grandes empresas comienzan a "marcharse"

Este aumento de precios ha provocado una fuerza de reacción que nadie anticipó: en esencia, ha consolidado la determinación de las grandes empresas de "construir su propia capacidad de cálculo".

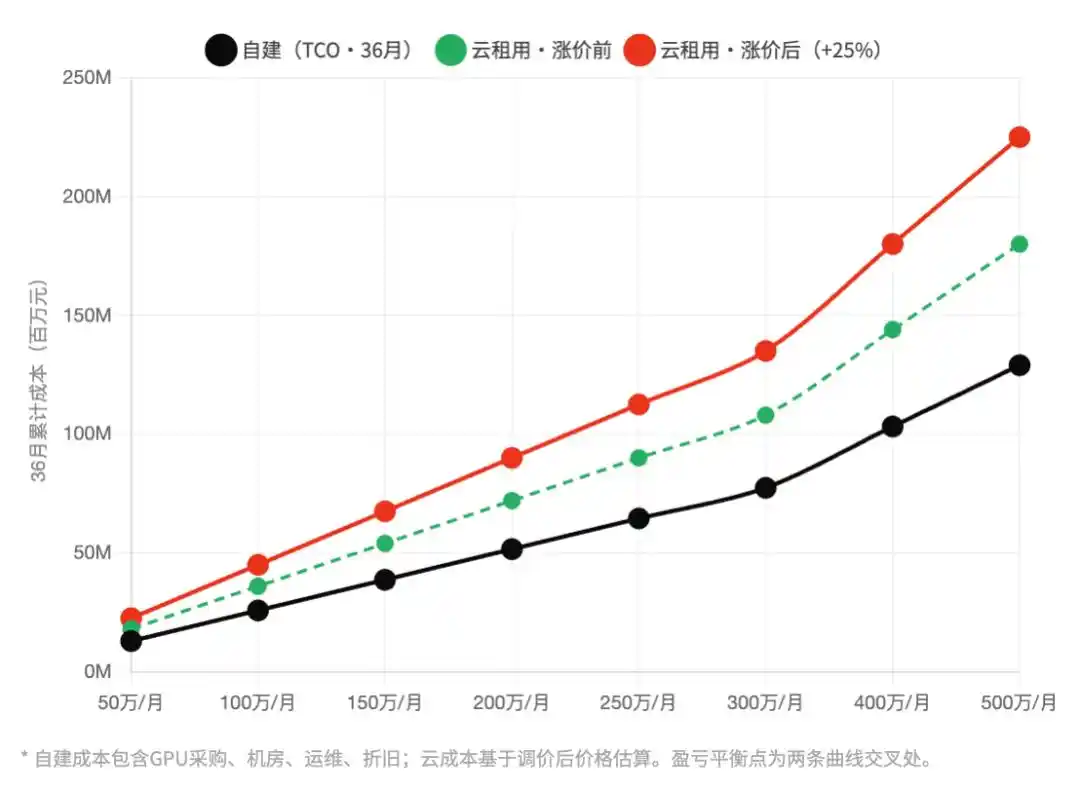

La industria de la computación en nube tiene una ley oculta: cuando la factura mensual supera un cierto umbral, el modelo financiero de "construir vs. alquilar" se invierte. Para bancos, empresas estatales centrales y grandes fabricantes, este umbral está aproximadamente en un gasto mensual en capacidad de cálculo en la nube de 3 a 5 millones de yuanes.

En 2024, la mayoría de las grandes empresas estaban por debajo del umbral, y la autoconstrucción no valía la pena. En 2025, con la expansión de los proyectos de IA, algunas empresas comenzaron a tocar la línea. Y esta ronda de aumentos del 20% al 30% en 2026 empuja directamente a un grupo de clientes que originalmente estaban justo en la línea al rango de "tener que considerar seriamente la autoconstrucción".

Figura | Alquiler en la nube vs. Autoconstrucción: Cálculo del punto de equilibrio del Costo Total de Propiedad (TCO)

Eje horizontal: Gasto medio mensual en capacidad de cálculo (10k yuanes/mes), Eje vertical: Costo acumulado a 36 meses (millones de yuanes) | Comparación antes y después del aumento de precios

Los beneficiarios de esta ola de autoconstrucción no son los competidores de los proveedores de nube, sino actores más periféricos: el volumen de consultas de precios de las plataformas de alquiler de GPU se duplicó en marzo en comparación interanual; el período de entrega para grandes clientes de Huawei Ascend se ha alargado a 6 meses; los integradores especializados en ayudar a las empresas a hacer "clústeres de inferencia privatizados" se han vuelto repentinamente muy codiciados.

Los proveedores de nube pretendían aumentar los precios para cosechar clientes de gama alta, pero inesperadamente alejaron a un grupo de grandes clientes con capacidad de autoconstrucción. Este riesgo de decisión podría ser reevaluado cuando llegue la temporada de resultados financieros.

05.

¿Quién gana? La verdad sobre la distribución de beneficios

El aumento de precios de los tres proveedores de nube es visto por los medios como "cosecha de los grandes fabricantes". Pero mirando toda la cadena industrial, la distribución de los verdaderos ganadores es mucho más compleja.

Hay una realidad irónica: los más perjudicados son aquellas pequeñas y medianas empresas emergentes de IA más innovadoras. Si se derrumban masivamente debido a los costos, el propio ecosistema de los proveedores de nube también se marchitará.

No es la primera vez que sucede. A principios de la década de 2010, los aumentos agresivos de precios en algunos servicios de Amazon AWS aceleraron la transición de algunos desarrolladores a Google Cloud, ayudando indirectamente a GCP a completar su acumulación ecológica inicial. La historia no se repite simplemente, pero rima.

06.

¿Cuánto durará la era de los aumentos?

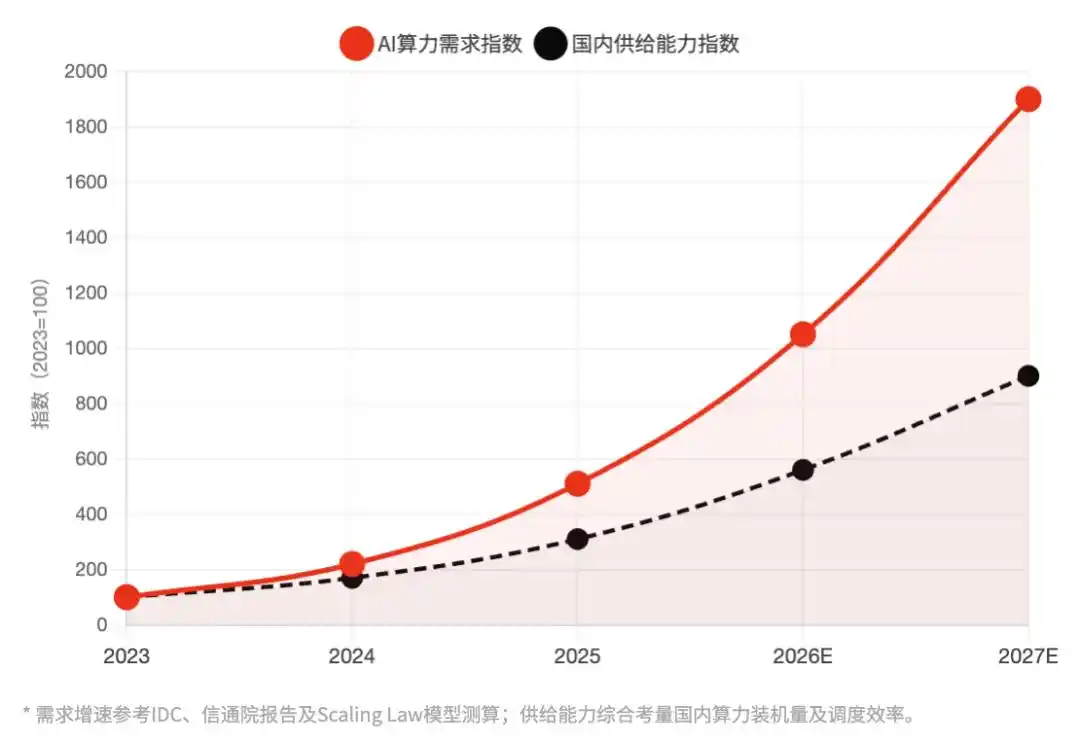

En resumen, la esencia de esta ronda de aumentos es una liberación de presión del mercado chino de capacidad de cálculo de IA entre la explosión de la demanda y las restricciones de suministro. Apretado por ambos lados, el precio solo puede subir. Esto no es completamente una elección activa de los proveedores de nube, en cierto sentido también es una reparación de precios forzada.

Figura | Capacidad de cálculo de IA de alto rendimiento en China: Velocidad de crecimiento de la demanda vs. Velocidad de expansión de la capacidad de suministro nacional Índice: 2023=100 | La brecha persistente entre oferta y demanda es la lógica subyacente de este aumento de precios

Ninguno de los tres factores estructurales que sostienen esta ronda de aumentos desaparecerá sustancialmente en 12 meses: el salto de orden de magnitud en el consumo de Tokens provocado por la popularización de los modelos Reasoning, la aceleración de la implementación a gran escala de Agent de IA y las restricciones de suministro derivadas de los controles de exportación de Nvidia.

El mercado de software B2B tiene una ley verificada repetidamente: el Efecto trinquete de precios (Ratchet Effect). Ninguno de los varios aumentos de precios de AWS a principios de la década de 2010 se revirtió completamente después de que mejorara la oferta. La fijación de precios de almacenamiento de Google Cloud desde 2021 solo ha tenido un paso a la baja, y vino con un ajuste en el límite de almacenamiento. Los proveedores de nube entienden esta ley: este aumento de precios no es solo "cosechar durante la ventana", sino también establecer una nueva línea de base de precios.

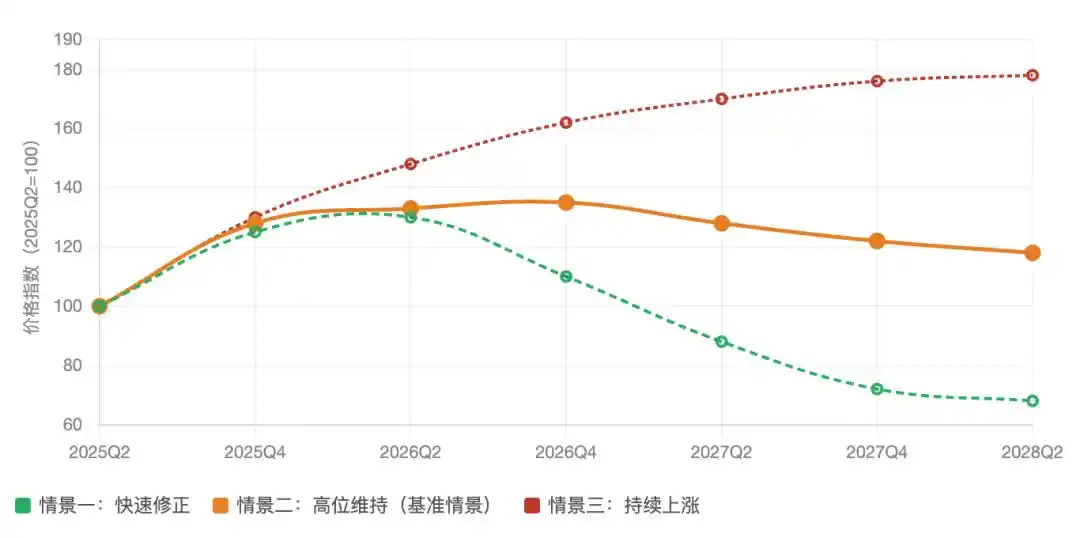

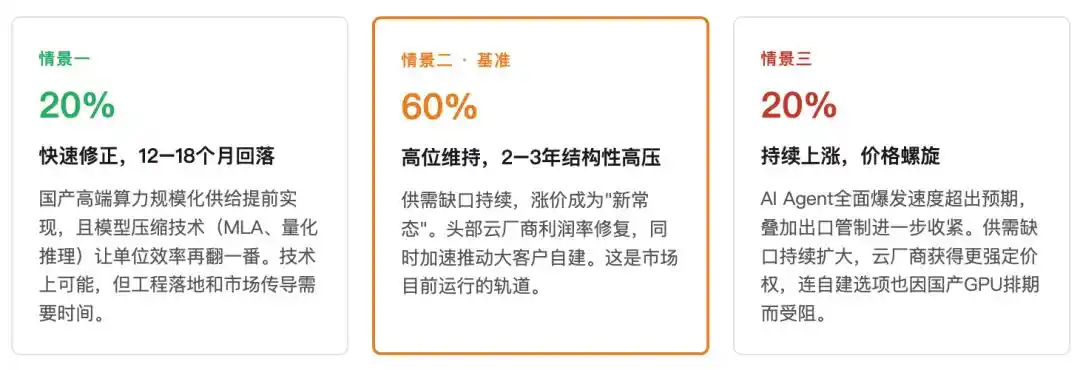

Tendencia del índice de precios de capacidad de cálculo: Tres escenarios de predicción (2025Q2–2028Q2)

2025Q2 = Base 100 | Estimación del índice de precio promedio integral de API de inferencia, incluyendo el efecto de aumento de precios

Por lo tanto, antes de 2027, "llegar a cero la capacidad de cálculo" no se hará realidad. Lo que realmente determinará el punto de inflexión de los precios dependerá de cuándo la eficiencia de planificación de la capacidad de cálculo nacional pueda alcanzar sustancialmente a la de Nvidia H100. Según el progreso actual de ingeniería, este punto de tiempo probablemente esté entre 2027 y 2028.

Y durante esta ventana, los proveedores de nube tienen razones suficientes para "aumentar primero", porque saben que la ventana no estará abierta para siempre.

07

Conclusión: Un juego estructural del lado de la oferta

Lo que revela esta ronda de aumentos no es una gran narrativa como "la mayoría de edad comercial de la IA", sino una realidad industrial más concreta: Cuando la revolución de la eficiencia y la explosión de la demanda ocurren simultáneamente, los precios pueden no bajar, sino subir. La paradoja de Jevons se cumplió en la era del carbón, y también se cumple en la era de la capacidad de cálculo.

Para las pequeñas y medianas empresas de aplicaciones de IA, en lugar de debatir quién está cosechando, es mejor calcular seriamente: en sus escenarios comerciales, ¿cuántos Tokens se están consumiendo ineficazmente?

Ahorrar Tokens es la fortaleza más dura de esta era.

Este artículo proviene del WeChat público "ÉnfasisNext" (ID: leo89203898), autor: Wen Xin, editor: Xiao Bai