Văn bản | AI Chữ cái

Google thực sự sốt ruột.

Vừa mới có thông tin cho biết, đồng sáng lập Google Sergey Brin đã khởi động lại "Chế độ người sáng lập", tự mình chỉ đạo và thành lập "đội đặc nhiệm" tinh nhuệ, nỗ lực hết mức để nâng cao khả năng lập trình AI và trí tuệ nhân tạo tự chủ của Gemini, nhằm đuổi kịp các đối thủ như Anthropic.

Tiếp đó, Google đã thông báo cập nhật lớn vào đêm khuya, ra mắt hai phiên bản trí tuệ nhân tạo nghiên cứu tự chủ thế hệ mới được xây dựng dựa trên mô hình Gemini 3.1 Pro: Deep Research và Deep Research Max.

Không chỉ tăng cường khả năng suy luận ở lớp dưới của mô hình, mà còn thúc đẩy mạnh mẽ trí tuệ nhân tạo nghiên cứu tự chủ phát triển theo hướng doanh nghiệp và nền tảng nhà phát triển, thông qua mở API, hỗ trợ dữ liệu riêng tư, tác vụ nền bất đồng bộ, cố gắng giành lấy thế chủ động trong trường hợp ứng dụng có giá trị cao "công cụ nghiên cứu/phân tích AI", đối phó với sự cạnh tranh từ các đối thủ như OpenAI (Hermes), Perplexity.

Hai trí tuệ nhân tạo này lần đầu tiên cho phép nhà phát triển thông qua một lần gọi API, tích hợp dữ liệu mạng mở với thông tin độc quyền của doanh nghiệp, và tạo biểu đồ và đồ thị thông tin gốc trong báo cáo nghiên cứu, đồng thời có thể kết nối với bất kỳ nguồn dữ liệu bên thứ ba nào thông qua Model Context Protocol (MCP).

Hai trí tuệ nhân tạo này từ nay được mở dưới dạng xem trước công khai thông qua gói trả phí của Gemini API, có thể truy cập thông qua Interactions API mà Google lần đầu ra mắt vào tháng 12 năm 2025.

Đúng vậy, các đại lý mới này hiện chỉ có thể sử dụng thông qua API, người dùng thông thường trong App Gemini không thể sử dụng được, ngay cả khi đã đăng ký trả phí. Thấy tin tức cập nhật nhưng lại không dùng được, có người dùng than phiền: "Google bằng cách nào đó, tiếp tục trừng phạt những người dùng đăng ký Pro của Gemini App chúng tôi..."

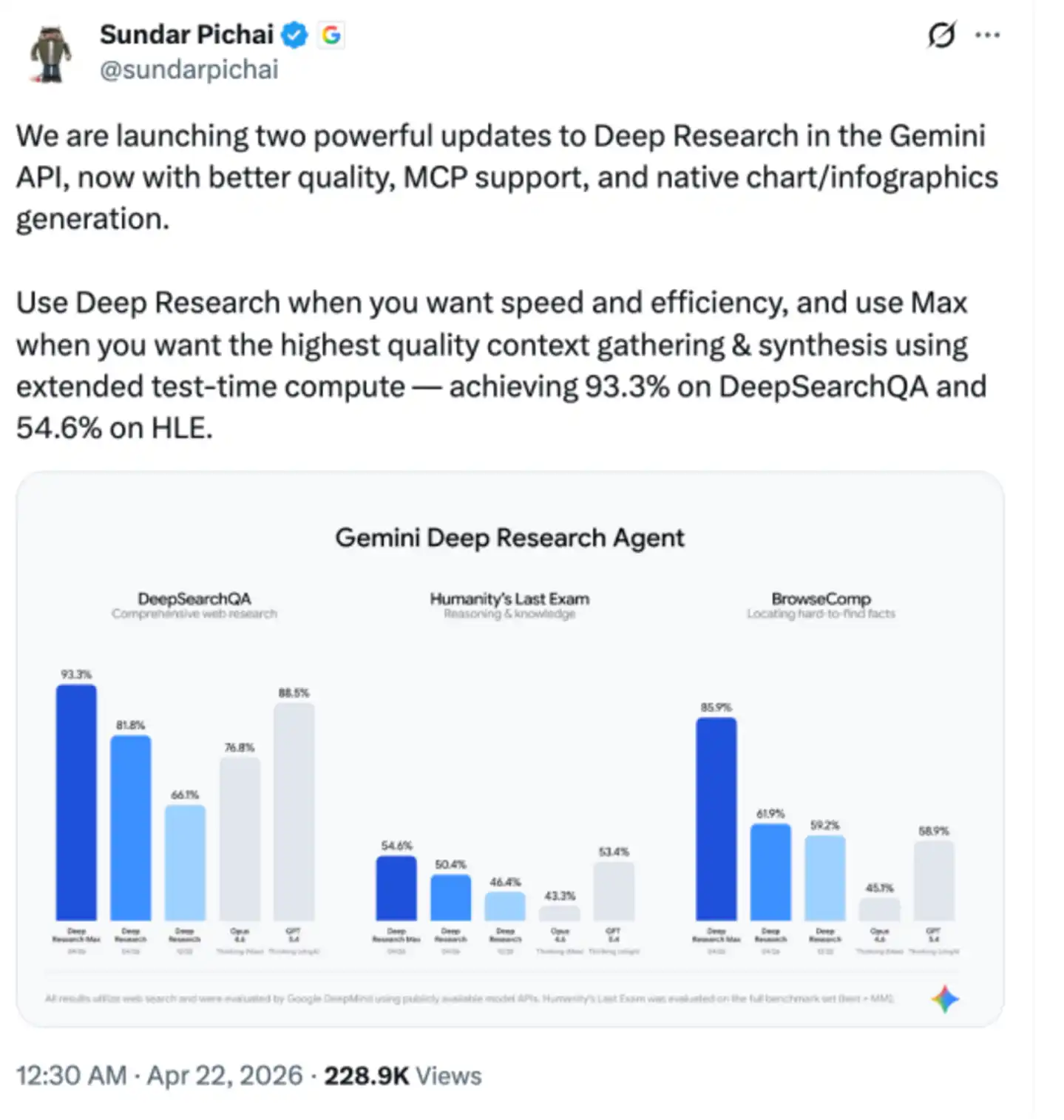

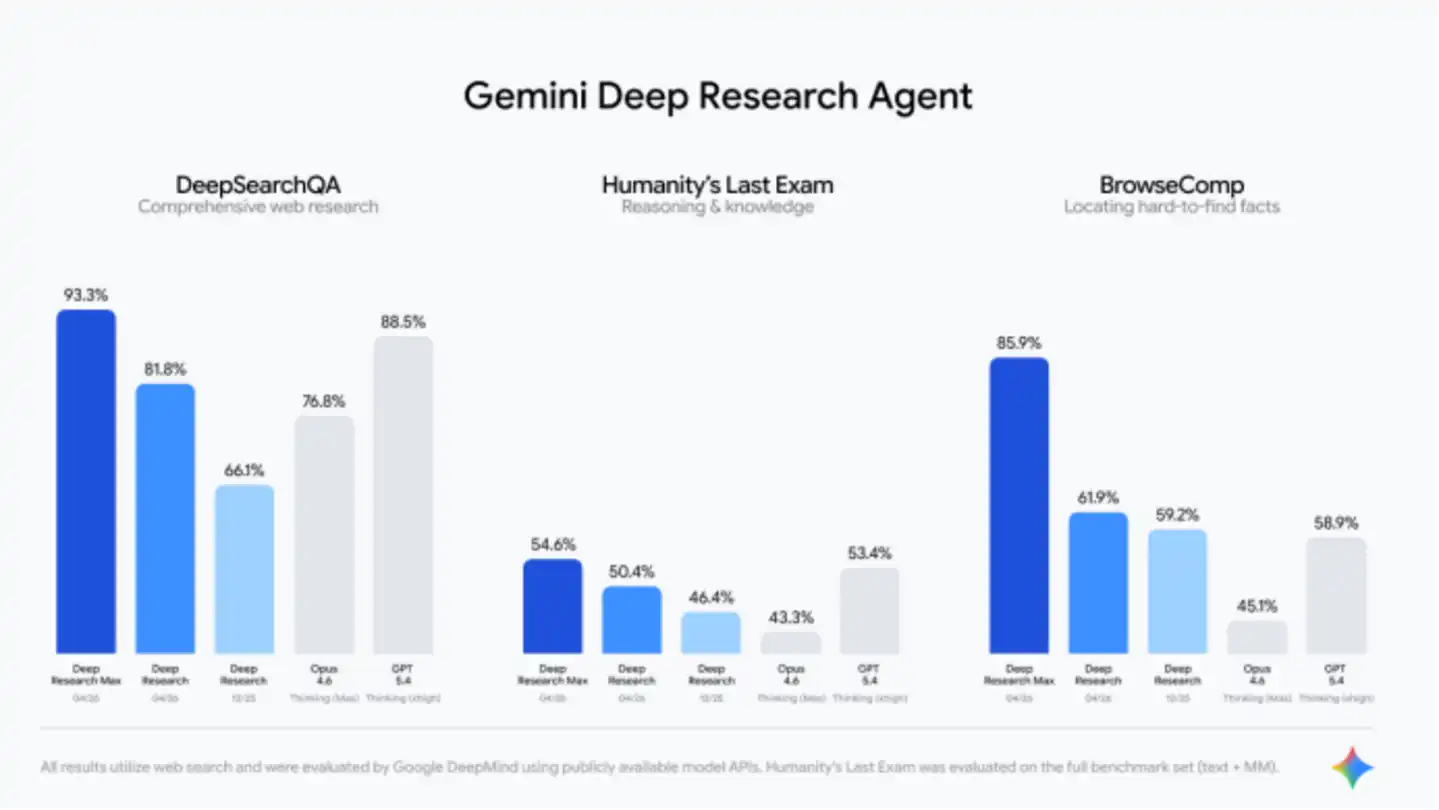

Giám đốc điều hành Google Sundar Pichai cũng tự mình xuất hiện trên X để quảng bá: "Khi bạn cần tốc độ và hiệu suất, hãy sử dụng Deep Research; khi bạn theo đuổi chất lượng thu thập và tổng hợp ngữ cảnh cao nhất, hãy sử dụng phiên bản Max - nó thông qua mở rộng tính toán thời điểm kiểm tra, đạt được điểm số DeepSearchQA 93.3% và HLE 54.6%."

18 tháng trước, mục tiêu của Google Deep Research là giúp nghiên cứu sinh tránh bị chìm ngập trong vô số tab trình duyệt. Giờ đây, Google lại hy vọng nó có thể thay thế công việc nghiên cứu cơ bản của các nhà phân tích ngân hàng đầu tư cấp dưới.

Khoảng cách giữa hai mục tiêu này - và liệu công nghệ này có thể thực sự thu hẹp khoảng cách này hay không - sẽ quyết định liệu đại lý nghiên cứu tự chủ cuối cùng sẽ trở thành sản phẩm biến đổi trong lĩnh vực phần mềm doanh nghiệp, hay chỉ là một buổi trình diễn trí tuệ nhân tạo khác hào nhoáng trong bài kiểm tra chuẩn nhưng lại gây thất vọng trong các cuộc họp.

Hai phiên bản, phù hợp với khối lượng công việc khác nhau

Phiên bản tiêu chuẩn Deep Research có độ trễ thấp hơn và chi phí thấp hơn, phù hợp với các trường hợp cần tốc độ.

Deep Research Max ưu tiên độ sâu hơn là tốc độ. Trí tuệ nhân tạo này thông qua mở rộng tính toán thời điểm kiểm tra (extended test-time compute), thực hiện suy luận sâu, tìm kiếm và lặp lại, cuối cùng tạo ra báo cáo.

Google chỉ ra, quy trình làm việc nền bất đồng bộ là trường hợp sử dụng lý tưởng của nó, ví dụ thông qua tác vụ định thời (cron job) chạy vào ban đêm, sáng hôm sau có thể giao một báo cáo điều tra đầy đủ cho đội ngũ phân tích.

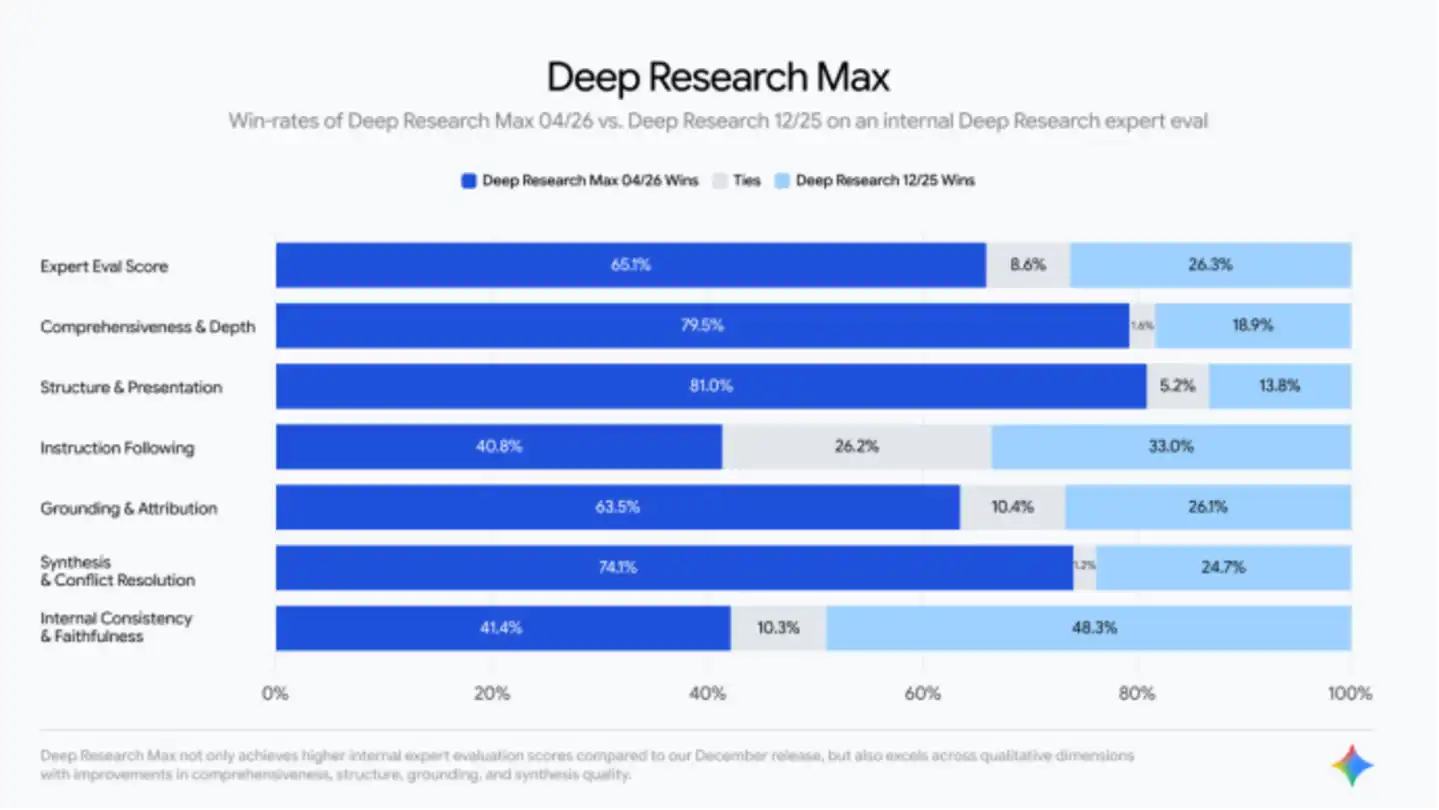

Trong bài kiểm tra chuẩn của chính Google, Deep Research Max đã đạt được tiến bộ đáng kể trong các nhiệm vụ truy xuất và suy luận. Trí tuệ nhân tạo này có thể lấy thông tin từ nhiều nguồn hơn so với phiên bản trước, và nắm bắt được những sắc thái tinh tế mà mô hình cũ dễ bỏ qua.

Google cũng đưa ra so sánh ngang với đối thủ.

Tuy nhiên, so sánh với GPT-5.4 của OpenAI và Opus 4.6 của Anthropic không hoàn toàn công bằng. GPT-5.4 thể hiện xuất sắc trong tìm kiếm mạng tự chủ, nhưng không được tối ưu hóa đặc biệt cho nghiên cứu sâu. Vì vậy, OpenAI cung cấp đại lý DR của riêng mình, đại lý này sau khi cập nhật vào tháng 2 đã chuyển sang GPT-5.2, không phải GPT-5.4. Mô hình tìm kiếm mạnh nhất của OpenAI thực ra là GPT-5.4 Pro, nhưng Google rõ ràng không đưa nó vào phạm vi so sánh.

Theo dữ liệu của OpenAI, GPT-5.4 Pro trong bài kiểm tra chuẩn tìm kiếm đại lý BrowseComp có điểm số cao nhất đạt 89.3%, trong khi GPT-5.4 đạt 82.7%.

Dựa trên báo cáo của chính Anthropic, Opus 4.6 trên BrowseComp có điểm số cao hơn con số mà Google trình bày, cụ thể là 84%. Điểm số này đạt được khi tắt chức năng suy luận, mô hình thể hiện tốt hơn so với thiết lập suy luận cường độ cao mà Google sử dụng trong bài kiểm tra chuẩn API.

Những chênh lệch này rất có thể bắt nguồn từ sự khác biệt trong phương pháp kiểm tra - mô hình được đánh giá thông qua API gốc, hay được đóng gói trong chuỗi công cụ của riêng mỗi phòng thí nghiệm. Dữ liệu của Google chưa chắc đã sai, nhưng đáng để giải thích một cách thận trọng. Dù sao, cách trình bày của nó thiếu tính minh bạch đủ.

Hỗ trợ MCP

Chức năng có ảnh hưởng nhất trong lần ra mắt này, có lẽ là hỗ trợ bổ sung cho Model Context Protocol (MCP). Chức năng này biến Deep Research từ một công cụ nghiên cứu mạng mạnh mẽ, thành một thứ gần hơn với "nhà phân tích dữ liệu tổng hợp".

MCP là một tiêu chuẩn mở mới nổi, dùng để kết nối mô hình AI với các nguồn dữ liệu bên ngoài. Nó cho phép Deep Research có thể truy vấn an toàn cơ sở dữ liệu riêng tư, kho tài liệu nội bộ và dịch vụ dữ liệu bên thứ ba chuyên nghiệp - toàn bộ quá trình, thông tin nhạy cảm không cần rời khỏi môi trường gốc của nó.

Trong ứng dụng thực tế, điều này có nghĩa là một quỹ phòng hộ có thể đồng thời hướng Deep Research tới cơ sở dữ liệu dòng giao dịch nội bộ và terminal dữ liệu tài chính của mình, sau đó yêu cầu trí tuệ nhân tạo kết hợp cả hai với thông tin công khai từ mạng, tổng hợp tạo ra insight.

Google tiết lộ, hiện đang tích cực hợp tác với các công ty như FactSet, S&P và PitchBook, cùng thiết kế máy chủ MCP của mình, điều này cho thấy rõ ràng Google đang tìm kiếm tích hợp sâu với các nhà cung cấp dữ liệu mà Phố Wall và ngành dịch vụ tài chính rộng hơn phụ thuộc hàng ngày.

Theo bài viết blog của giám đốc sản phẩm Google DeepMind Lukas Haas và Srinivas Tadepalli, mục tiêu là "cho phép khách hàng chung có thể tích hợp sản phẩm dữ liệu tài chính vào quy trình làm việc được驱动 bởi Deep Research, và thông qua việc tận dụng vũ trụ dữ liệu khổng lồ của nó, thu thập ngữ cảnh với tốc độ chớp nhoáng, từ đó đạt được bước nhảy vọt về năng suất."

Chức năng này trực tiếp giải quyết một trong những điểm đau dai dẳng nhất khi doanh nghiệp áp dụng AI: khoảng cách lớn giữa thông tin mà mô hình có thể tìm thấy trên internet mở, và thông tin thực tế cần thiết cho quyết định của tổ chức. Trước đây, thu hẹp khoảng cách này cần rất nhiều công việc kỹ thuật tùy chỉnh.

Trong khi đó, hỗ trợ MCP kết hợp với khả năng duyệt và suy luận tự chủ của Deep Research, đơn giản hóa phần lớn phức tạp thành chỉ một lần cấu hình. Nhà phát triển giờ đây có thể cho Deep Research đồng thời sử dụng tìm kiếm Google, máy chủ dịch vụ MCP từ xa, URL Context, thực thi mã và tìm kiếm tệp - hoặc tắt hoàn toàn truy cập mạng, chỉ tìm kiếm trên dữ liệu tùy chỉnh.

Hệ thống còn hỗ trợ đầu vào đa phương thức, bao gồm PDF, CSV, hình ảnh, âm thanh và video, được sử dụng như grounding (ngữ cảnh grounding).

Biểu đồ gốc

Chức năng nặng ký thứ hai là tạo biểu đồ và đồ thị thông tin gốc.

Phiên bản Deep Research trước đây chỉ có thể tạo báo cáo văn bản thuần túy. Nếu người dùng cần trực quan hóa,就必须 xuất dữ liệu và tự làm biểu đồ. Điểm yếu này làm suy yếu đáng kể định vị "tự động hóa end-to-end".

Bây giờ, trí tuệ nhân tạo thế hệ mới có thể nhúng biểu đồ và đồ thị thông tin chất lượng cao gốc trong báo cáo, render động tập dữ liệu phức tạp bằng định dạng HTML hoặc Nano Banana của Google, làm cho nó trở thành một phần trực tiếp của tường thuật phân tích.

Đối với người dùng doanh nghiệp - đặc biệt là người dùng trong ngành tài chính và tư vấn cần tạo ra kết quả có thể giao trực tiếp cho các bên liên quan - chức năng này biến Deep Research từ một công cụ "giai đoạn nghiên cứu tăng tốc", thành một công cụ có thể tạo ra sản phẩm phân tích gần như cuối cùng.

Ngoài ra, kết hợp với chức năng lập kế hoạch hợp tác mới (cho phép người dùng xem xét, hướng dẫn và tối ưu hóa kế hoạch nghiên cứu của trí tuệ nhân tạo trước khi thực thi), và đầu ra streaming thời gian thực các bước suy luận trung gian, hệ thống mới cho phép nhà phát triển kiểm soát chi tiết phạm vi điều tra, đồng thời duy trì mức độ minh bạch cao mà ngành quản lý yêu cầu.

Deep Research đang trở thành một phần "cơ sở hạ tầng" mà Google cung cấp cho doanh nghiệp

Bài viết blog chính thức của Google chỉ rõ, khi nhà phát triển sử dụng trí tuệ nhân tạo Deep Research để xây dựng, họ gọi là "cùng một cơ sở hạ tầng nghiên cứu tự chủ cung cấp năng lực nghiên cứu cho nhiều sản phẩm nổi tiếng của Google (như Gemini App, NotebookLM, Google Search và Google Finance)". Điều này chỉ ra, trí tuệ nhân tạo được cung cấp thông qua API không phải là phiên bản đơn giản hóa của phiên bản nội bộ Google, mà là cùng một hệ thống, cung cấp dịch vụ với quy mô nền tảng.

Quá trình tiến hóa này diễn ra cực kỳ nhanh chóng.

Google lần đầu ra mắt Deep Research trong Gemini App vào tháng 12 năm 2024, như một chức năng C端, khi đó được驱动 bởi Gemini 1.5 Pro. Google mô tả nó như trợ lý nghiên cứu AI cá nhân, có thể tổng hợp thông tin mạng trong vài phút, giúp người dùng tiết kiệm hàng giờ làm việc.

Tháng 3 năm 2025, Google sử dụng Gemini 2.0 Flash Thinking Experimental để nâng cấp Deep Research, và mở dùng thử cho tất cả mọi người. Sau đó nâng cấp lên Gemini 2.5 Pro Experimental, Google báo cáo, người đánh giá ưu tiên báo cáo của nó vượt đối thủ 2 trên 1.

Tháng 12 năm 2025 là điểm ngoặt quan trọng, Google ra mắt Interactions API, lần đầu cung cấp Deep Research theo cách lập trình, được驱动 bởi Gemini 3 Pro, và đồng thời phát hành bài kiểm tra chuẩn DeepSearchQA mã nguồn mở.

Mô hình lớp dưới驱动 cải tiến lần này là Gemini 3.1 Pro, mô hình này được phát hành vào ngày 19 tháng 2 năm 2026. Nó đạt được bước nhảy vọt lớn trong khả năng suy luận cốt lõi: trong bài kiểm tra chuẩn ARC-AGI-2 đánh giá mô hình giải quyết mẫu logic mới, 3.1 Pro đạt điểm 77.1%, gấp hơn hai lần Gemini 3 Pro.