24.377 billion yuan—this is the latest valuation confirmed by Zhipu in its prospectus made public on the 17th after passing the Hong Kong Stock Exchange's hearing. For the first time, people know exactly the valuation amount of a major Chinese large model company.

This is an opportune moment. Three years have passed since ChatGPT dropped a bombshell in the industry. After the frenzy of the "hundred-model battle," the remaining Chinese large model players, having proven that their innovation and technical capabilities are second to none, are now sprinting toward the capital markets.

During this critical transition period from "youth to adulthood," the market expects large model companies to demonstrate to everyone how "novel, tech-showcasing" model technology transitions into end-to-end落地 (landing/implementation) of "practical, adaptable" large models.

As the first company to successfully "come ashore" (go public/secure funding) from the hundred-model battle, Zhipu's answer is not entirely satisfactory. The scale of losses disclosed in the prospectus far exceeds revenue growth, and R&D expenses are still increasing significantly, showing no sign of stopping the "cash burn."

If this were a mature company, such a balance sheet would be quite unsatisfactory. But large models are special.

Zhipu is one of China's earliest independent large model companies, yet it is less than 6 years old. The reason the AI industry excites countless people is its revolutionary potential for the future, which is difficult to deduce directly from past history because change often happens suddenly and exponentially at a certain moment.

This is Zhipu's bet, or what could be called its vision. Before the arrival of the AGI future that many firmly believe in, Zhipu hopes to be as prepared as possible. This involves a series of complex trade-offs and also convincing the market to believe.

Making people believe—this is a gamble full of hope.

Core Data Summary

Zhipu's core commercial revenue primarily consists of localized deployment and cloud deployment. The former refers to providing large model privatization deployment for B-end customers, while the latter provides model API interfaces and token调用 (calling/invocation) services to users via its MaaS platform.

The prospectus shows that based on 2024 revenue, in the enterprise LLM field, Zhipu is already China's largest independent large model vendor and the second-largest large model vendor overall, surpassing Alibaba and SenseTime, with a market share of 6.6%.

From 2022 to 2024, Zhipu's revenues were RMB 60 million, RMB 120 million, and RMB 310 million, respectively, with a CAGR of 130%. Revenues for H1 2024 and H1 2025 were RMB 40 million and RMB 190 million, respectively, a year-on-year increase of over 300%;

Nearly 85% of Zhipu's revenue comes from the localized deployment business, primarily distributed across vertical industries such as internet technology, public services, telecommunications, traditional enterprises, consumer electronics, as well as retail, media, and consulting;

In H1 2025, Zhipu's overseas revenue proportion rapidly increased to nearly 12%, mainly from markets in Malaysia and Singapore. Under the "Belt and Road" strategy, Zhipu is helping overseas countries deploy sovereign large models, achieving a breakthrough of zero for the出海 (going global) of China's large model technology;

From 2022 to 2024 and H1 2025, Zhipu's gross margins were 54.6%, 64.6%, 56.3%, and 50.0%, respectively. For comparison, domestic software outsourcing company China Software typically has around 30%. Zhipu's gross margin for localized large model deployment business is not low;

Notably, the decline in gross margin is mainly due to price fluctuations in the MaaS platform business. Affected by market price wars, Zhipu increased price cuts to gain more customers and application scenarios;

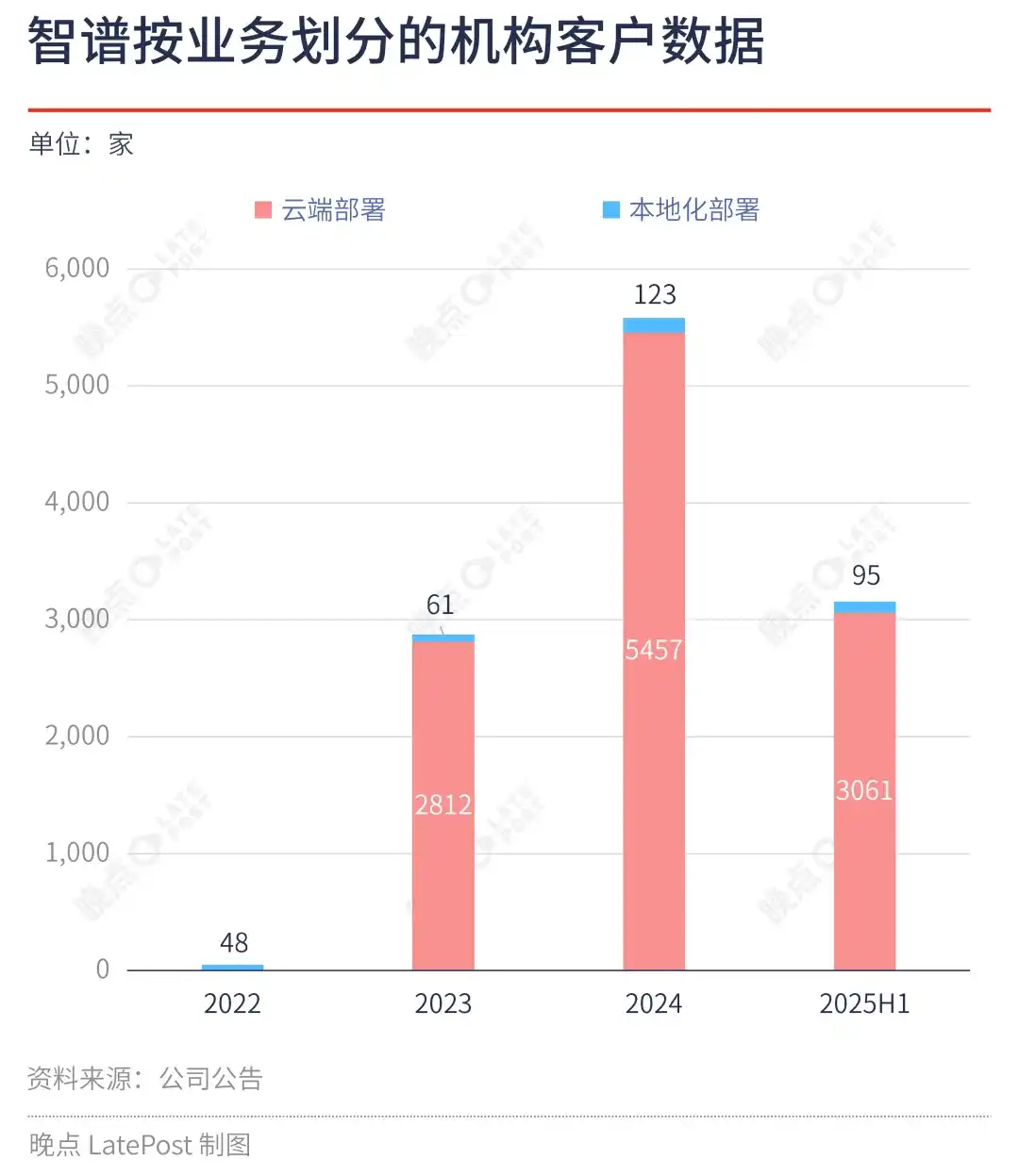

The result of this is that in H1 2025, Zhipu had 95 and 3061 institutional customers for localized and cloud deployment respectively, while the full-year 2024 figures were 123 and 5457 institutional customers. The price reduction in the MaaS business not only increased the number of cloud institutional customers but also had a significant引流 (diversion/traffic acquisition) effect on the localized deployment business;

As of Q3 2025, the company's models have empowered over 80 million end-user devices and more than 45 million developers, and it has over 12,000 institutional customers, a significant increase from the 8,000 customers in H1 2025.

Additionally, in November 2025, Zhipu's daily token consumption reached 4.2 trillion, compared to 500 million in 2022. This is the result of Zhipu releasing its new generation GLM 4.5/4.6 open-source base models and a direct reflection of user volume and调用量 (call volume).

Revenue is More Important Than Anything, But Revenue Requires Patience

In its prospectus, Zhipu introduces a "vertical and horizontal strategy" narrative for the growth prospects of commercial revenue.

Vertically, price reductions and capacity expansion in the MaaS platform business have attracted a wide range of users and application scenarios. Introducing more users will divert traffic to the localized deployment business. This "MaaS traffic acquisition + localized monetization" model will initially build a cycle of customers and commerce.

Horizontally, similar to OpenAI and Anthropic, Zhipu's MaaS platform is highly flexible and scalable. Unlike the traditional impression of heavy-delivery customization projects, Zhipu points out that the enterprise MaaS projects, which constitute the vast majority of revenue, deliver more general model capabilities, thus enabling faster scaling of token call volumes.

The vertical customer cycle model and the horizontal general solution capability scaling reinforce Zhipu's label as China's independent model company with the largest revenue volume. This is the commercial superposition effect Zhipu anticipates. The revenue scale of the MaaS platform business is highly likely to achieve超额增长 (supernormal growth). According to Zhipu's predictions, future revenue from localized deployment and cloud business will be split fifty-fifty. Zhipu is willing to sacrifice gross margin for this: unlike the high margins of localized projects, cloud business has lower gross margins because significant costs are spent on computing power procurement. This is also an inevitable result of the strategic price reduction in MaaS, a necessary compromise for short-term market share争夺 (competition).

The Model is the Product, the Product is Growth

A popular saying in the large model industry is "the model is the product." This reflects a very simple first principle: users pay for the strongest model, and the process of building the model itself is creating a highly competitive product.

This also constitutes the core growth logic of MaaS. In the second half of this year, Zhipu's latest release, the GLM 4.5/4.6 base model, was the first to natively integrate reasoning, coding, and agent capabilities within a single model. Particularly in coding, GLM ranks并列第一 (joint first) with models from Anthropic and OpenAI on Code Arena. After its release, call volume on its MaaS platform grew exponentially.

Similar to the "vertical and horizontal strategy" in the first part, powerful model products are expected to trigger a data flywheel effect, which would be the most ideal moat in large model competition. Zhipu's commercialization goals will be realized within a complete platform encompassing the latest models, APIs, and development tools. MaaS becomes an "operating system"-level infrastructure for the AI era, serving thousands of industries and organizations of all sizes—from individuals and small development teams to large enterprises. And on this complete platform, there is no交付 (delivery/customization), only product managers.

According to data in Zhipu's prospectus, MaaS has over 2.9 million enterprise and application developers, making it one of the most active large model API platforms in China. Currently, 9 out of the top 10 internet companies in China are using Zhipu's GLM large model. Among them, the GLM Coding package (a standardized large model product for developers with monthly subscription fees) gained over 150,000 paid developers within two months of launch, with annual recurring revenue quickly exceeding 100 million yuan.

The Cost of the Strongest Model

The代价 (cost/price) Zhipu paid for the judgment that "users pay for the strongest model" is fully revealed in the prospectus.

From 2022 to 2024, and the first half of this year, Zhipu's adjusted net losses were RMB 97 million, RMB 621 million, RMB 2.466 billion, and RMB 1.752 billion, respectively. R&D expenses were RMB 80 million, RMB 530 million, RMB 2.20 billion, and RMB 1.59 billion, constituting the vast majority.

Zhipu points out that computing service fees as a proportion of R&D expenses rapidly increased from an initial 17% to over 70%. This means a large part of R&D costs is used to purchase computing power,同步 (synchronizing) with the rapid growth in MaaS platform call volume.

On one hand, extremely high R&D investment is Zhipu's冷静的战略选择 (calm strategic choice). Pre-training base model capabilities themselves consume immense computing power. As AGI development progresses, it needs to衍生出 (derive/evolve) more application models to improve the comprehensive performance capabilities of agents, thereby solidifying its comparative advantage in underlying model capabilities and attracting more developers and customers;

On the other hand, in the foreseeable medium term, competition among large tech companies around large models will not cool down. This is a race with no end in sight in the short to medium term and extremely intense ranking competition. Only by始终维持 (consistently maintaining) a position in the top tier can one gain market recognition and attract capital.

Therefore, "边跑边补能" (refueling while running) is the only option.

Unlike the dot-com bubble around the year 2000, participants in the large model competition all know that although long-term cash burn is not a good commercial narrative, it is a market consensus. While model capabilities and market size are changing强烈快速 (strongly and rapidly), staying at the table is paramount. When people look forward to the systemic changes brought by AI, creating a market space worth trillions of dollars, Zhipu is betting that a larger market space will create more revenue growth opportunities and more significant scale effects. Powerful base model capabilities and the MaaS business model both suggest a higher monetary multiplier. This is an arithmetic problem everyone playing the AI game understands.

Burning cash attempts to ensure Zhipu has a place in the AI-dominated future.

Professionalism, Focus, and the Implied Price of Perseverance

AGI is a long tug-of-war. In the words of Zhipu CEO Zhang Peng, it's like "running a marathon at a sprint pace." This contradictory description explains both sides of Zhipu: it诠释了 (interprets/illustrates) Zhipu's technical perseverance and also explains the reason for choosing capitalization.

Born out of the Knowledge Engineering Laboratory of Tsinghua University's Computer Science Department, Zhipu was officially established in 2019. Starting from the underlying architecture of base large models, Zhipu has continuously率先推出 (taken the lead in launching) multiple domestic "first models," accumulating a set of domestically original model portfolios.

Taking the base model GLM-4.5 released in July this year as an example, according to data from Frost & Sullivan, GLM-4.5 achieved the following leading positions globally.

Based on the evaluation results of 12 industry-standard benchmark tests conducted in July 2025, GLM-4.5 ranked third globally, first in China, and top among global open-source models;

In September 2025, according to the LLM Hallucination Leaderboard in the field of Retrieval-Augmented Generation (RAG), GLM-4.5's hallucination rate was the second lowest globally and the lowest in China;

Since the release of GLM-4.5 until now, Zhipu's token consumption on OpenRouter has consistently ranked among the global top ten and the top three in China;

During the same period, Zhipu's paid API revenue on OpenRouter exceeded the sum of all domestic models.

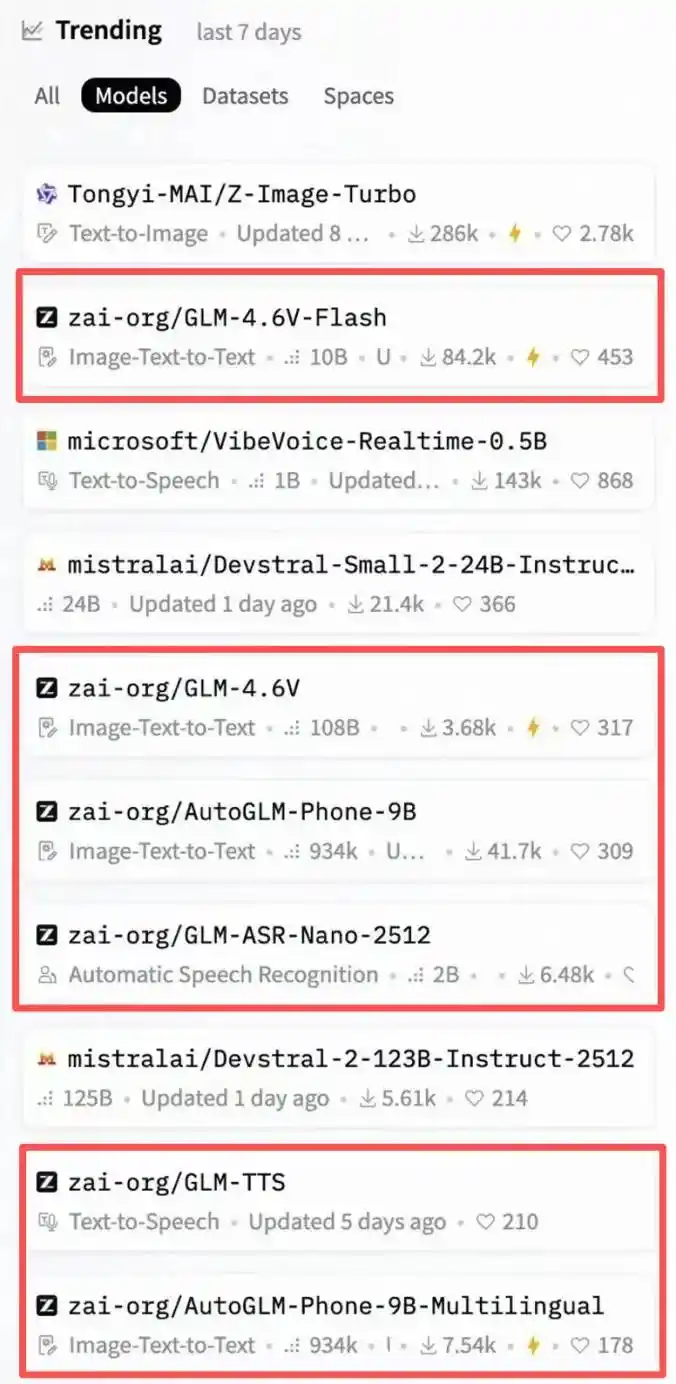

In the second week of December, Zhipu open-sourced GLM multimodal and agent series models for five consecutive days. On the Hugging Face Trending list's top 10, Zhipu occupied 5 spots.

This included not only AutoGLM, which can operate mobile phones on behalf of users, but also the GLM-4.6V multimodal large model, the GLM-ASR series speech recognition models, the GLMTTS industrial-grade text-to-speech system, and core technological achievements in video generation. At first glance, this move seems almost contrary to the logic emphasizing commercialization and profitability. However, at this sensitive time before listing, Zhipu's open-source strategy显示出 (shows/displays) the strong vision of a technology-core AI company. Promoting the prosperity of the entire AI technology stack and open-source community knows no time节点 (node/moment), even during the critical stage when an AI company's growth phase shifts from technical competition to capital operation.

This气质 (temperament/character) is precisely why Zhipu was initially called the Chinese company "most like OpenAI."

As OpenAI recently suspended several non-core projects, including the Sora video generation model, and concentrated all resources within an eight-week period on improving the performance and user experience of its core product, ChatGPT, the two companies' model routes have once again converged: model capability itself is decisive, and other matters should give way to it.

The only major difference might be the huge disparity in valuations between Chinese and US AI companies. OpenAI's ultra-high valuation and continuous financing ensure it has a constant supply of ammunition for model R&D even without going public. Chinese large model enterprises, however, have valuations that are lower by more than an order of magnitude, even though Zhipu is one of the best performers among them. In its 6 years since founding, Zhipu has raised over 8 rounds of financing, with a cumulative financing scale exceeding RMB 8.3 billion.

Now, Zhipu needs a broader market to raise more sufficient ammunition. The capital market's reaction will confirm the substance of independent large model companies represented by Zhipu, thereby pricing the entire Chinese large model industry.

The Future Battle

There is not yet an independent large model company listed on the Chinese capital market for reference. Various doubts surrounding the fierce competition in large models still permeate (弥散) the market. During the growth stage of tech companies, measuring their fundamentals and growth potential using financial profitability indicators is basically无效的 (ineffective). What measures the commercial value or growth logic of such companies are often multiple complex dimensions such as revenue performance, product capability, market space, and business model, and most importantly, expectations for the future.

技术乐观主义者 (Techno-optimists) firmly believe in the future outlined by artificial intelligence. Two days after Zhipu publicly released its prospectus, another large model company, MiniMax, also disclosed its prospectus. Whoever ultimately succeeds in listing first will undoubtedly leave a profound mark on the history of artificial intelligence development.

AI is an infinite war of intelligence concerning productivity and social transformation. The battle has just begun.