Most people who buy Bitcoin today don't use it at all.

They hold it, call it digital gold, and proudly declare they are "in it for the long term." And that's fine—Bitcoin has earned that reputation.

But such massive holdings have created one of the largest pools of idle capital in the crypto ecosystem today. About 61% of Bitcoin hasn't moved in over a year, and nearly 14% hasn't moved in over a decade. Despite a market cap exceeding $2 trillion, only 0.8% of Bitcoin is currently participating in any form of decentralized finance (DeFi) activity.

In other words, Bitcoin is the most valuable asset in crypto, but also the least used.

Now, let's contrast this with other aspects of the crypto world:

- Stablecoins settle payments globally at a massive scale.

- Ethereum powers smart contracts, decentralized autonomous organizations (DAOs), wallets, and entire economies.

- Layer 2s (L2s) run complete ecosystems with lending, trading, gaming, and thousands of applications.

Meanwhile, Bitcoin, the largest, most secure, and most widely held asset, can do none of the above.

Instead, it sits there with trillions in value, idle, generating no yield, creating no liquidity, and contributing nothing to the broader economy beyond security and price appreciation.

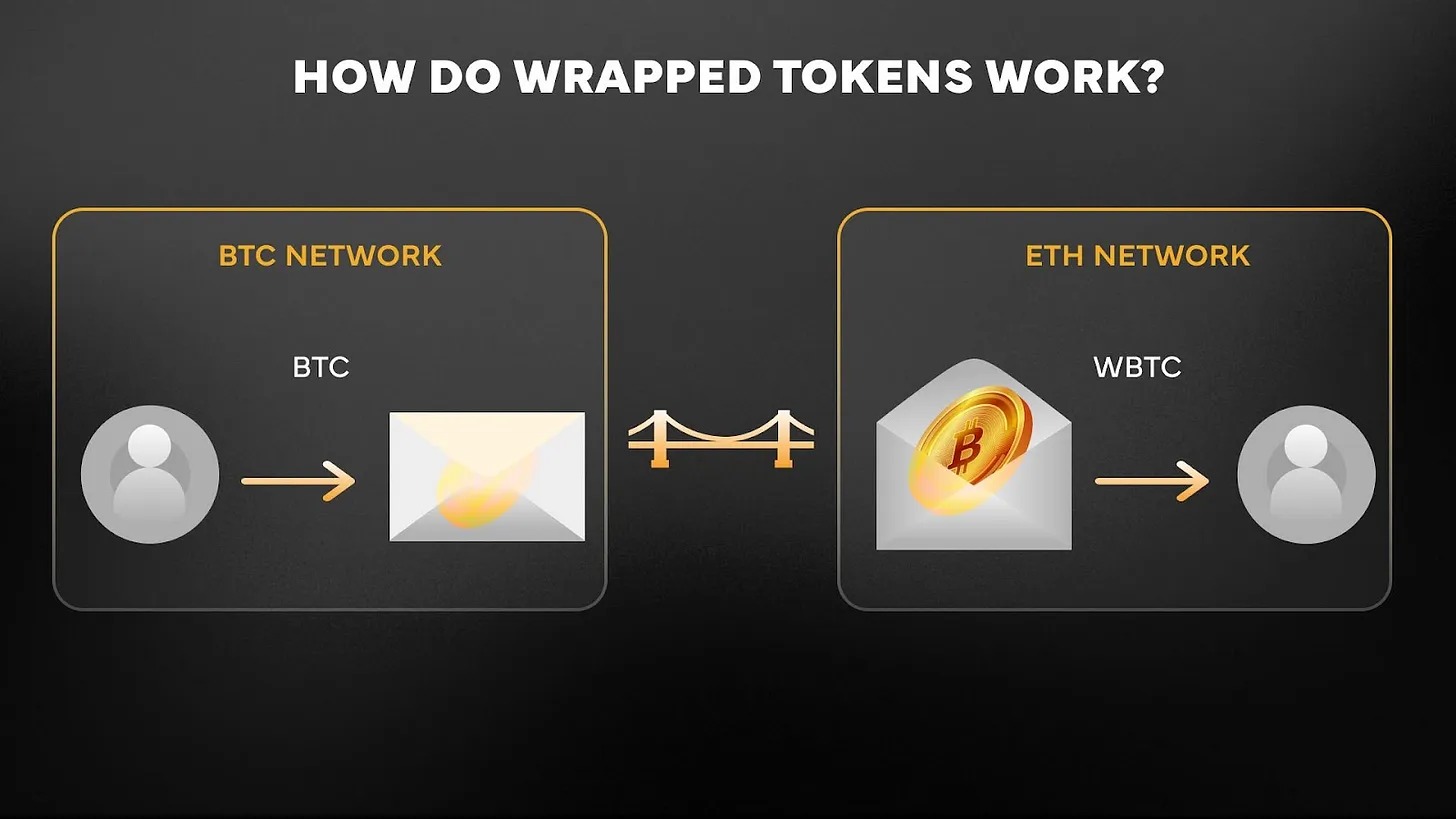

When people tried to solve this, the solutions created new problems. Wrapped BTC (WBTC) became popular but required trusting a custodian. Cross-chain bridges allowed you to move Bitcoin to another chain but introduced security risks. Bitcoin holders wanted to use their Bitcoin, but the infrastructure never provided a secure, native way to do so.

But that is finally changing. Over the past few years, a whole new ecosystem has been forming around Bitcoin, attempting to unlock all this "sleeping capital" without forcing people to wrap their Bitcoin, trust intermediaries, or move it into someone else's custody.

Why Bitcoin Ended Up Here

Bitcoin becoming a passive asset was no accident. Its entire architecture steered it in this direction. Long before DeFi emerged, Bitcoin made a clear trade-off: prioritize security above all else. This decision shaped its culture, developer environment, and ultimately, the type of economic activity that flourished around it.

The result is an extremely immutable blockchain, great for moving money but severely limiting for innovation. Most people only see the surface symptoms: low liquidity, high dormancy rates, and the dominance of wrapped Bitcoin, but the root of the problem goes much deeper.

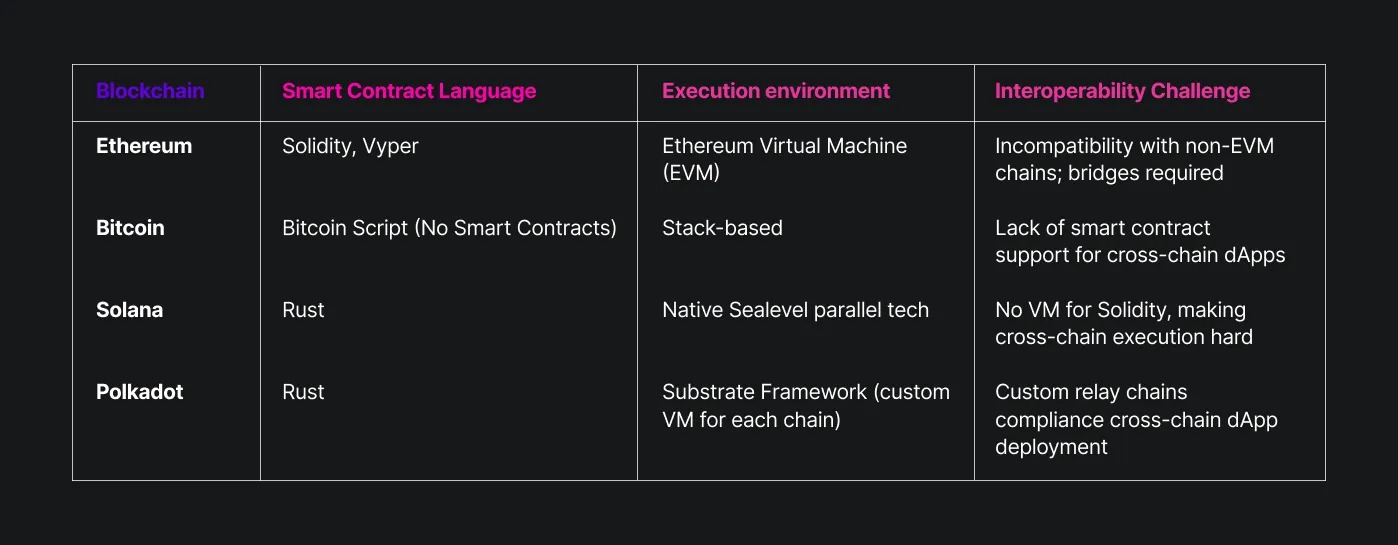

The first limitation is Bitcoin's scripting model. It deliberately avoids complexity, keeping the base layer hard to exploit and predictable. This means no general computation, no native financial logic, no on-chain automation. Ethereum, Solana, and all modern L1s were built on the assumption that developers would build. Bitcoin was built on the assumption that they shouldn't.

The second limitation is Bitcoin's upgrade path. Any change, even a minor feature, requires coordination across the entire ecosystem. Hard forks are socially nearly impossible, and soft forks take years. So, while other cryptos iterated through entire design paradigms (e.g., AMMs, account abstraction, L2s, modular blockchains), Bitcoin remained largely stagnant. It became a settlement layer but never truly an execution layer.

The third limitation is cultural. Bitcoin's developer ecosystem is inherently conservative. This conservatism protects the network but also stifles experimentation. Any proposal introducing complexity is met with skepticism. This mindset safeguards the base layer but ensures new financial primitives can't emerge on Bitcoin like they do elsewhere.

Furthermore, there's a structural limitation: Bitcoin's value grew faster than its surrounding infrastructure. Ethereum had smart contracts from the start; Solana adopted a high-throughput design from day one. Bitcoin's value ballooned into an asset class before its "range of usable applications" could expand. Thus, the entire ecosystem ended up with a paradox: you have trillions in capital with almost nowhere to deploy it.

The final limitation is interoperability. Bitcoin is uniquely isolated; it doesn't interoperate with other blockchains and has no native bridges. Until recently, there was no trust-minimized way to connect Bitcoin to external execution environments. So, any attempt to make Bitcoin usable required abandoning part of Bitcoin's security model—wrapping, bridging, custodial minting, multisigs, federations. For an asset built on distrust of intermediaries, this could never scale.

The First Workarounds: Wrappers, Sidechains, and Bridges

When it became clear that the Bitcoin base layer couldn't support meaningful activity, the industry did what it always does: developed workarounds. Initially, these seemed like progress, enabling Bitcoin to enter realms where DeFi activity thrived. But upon closer inspection, they all shared a common flaw: using them required giving up part of Bitcoin's trust model.

The most prominent example is Wrapped Bitcoin (WBTC). It became the default bridge between Bitcoin and Ethereum, and for a while, this model seemed to work. It unlocked liquidity, allowing Bitcoin to be used as collateral, traded on AMMs, used for margin loans, looped, restaked—basically everything Bitcoin itself couldn't do. But the cost was that WBTC existed only if real Bitcoin was held by someone else. This meant custody, reliance on external entities, operational risk, and a guarantee system divorced from Bitcoin's base security.

Federated systems tried to lessen this trust burden by dispersing control across multiple entities. Instead of a single custodian, a group collectively held the Bitcoin backing the wrapped asset. This was an improvement but far from trustless. Users still relied on a coordinated set of operators, and the strength of the peg depended solely on their incentives and integrity. For a community that prefers trustless systems, this wasn't ideal.

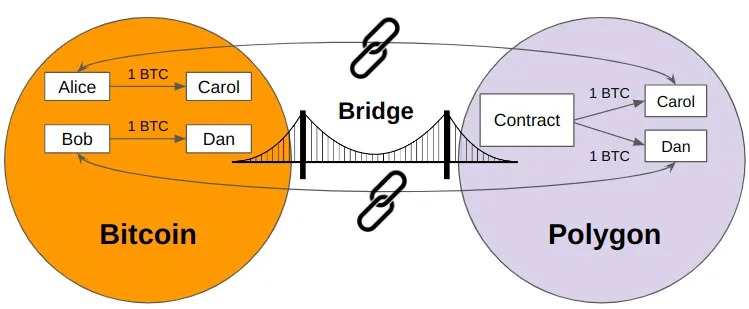

Bridge technology introduced a new set of problems. Instead of relying on custody, users relied on an external set of validators, whose security was often weaker than the chain they were leaving. Bridges enabled moving Bitcoin across chains but became one of the biggest security holes in crypto. Multiple analyses point to bridge exploits as one of the largest sources of fund loss in the space.

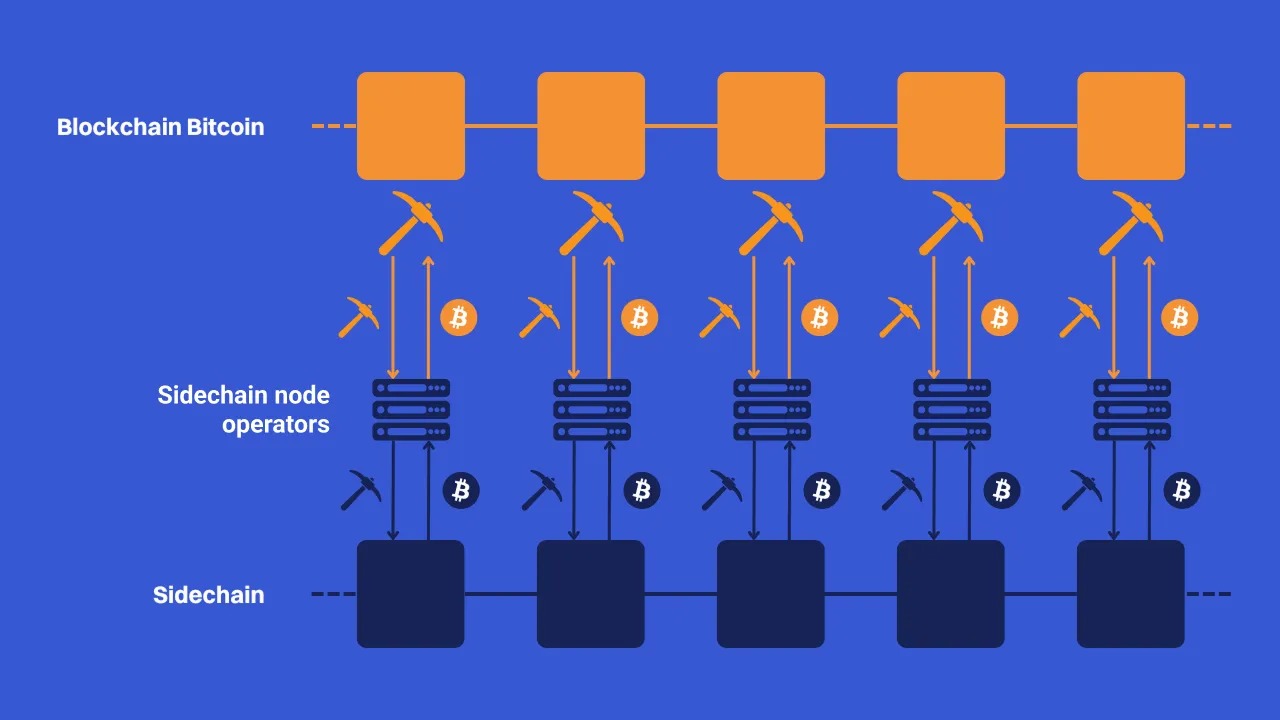

Sidechains added further complexity. They are chains separate from Bitcoin, connected via various peg mechanisms. Some use multisig control, others use Simplified Payment Verification (SPV) proofs. But none inherit Bitcoin's security. They run their own consensus mechanisms, validator sets, and risk assessments. The label "Bitcoin sidechain" is often more marketing than reality. Liquidity moved, but security guarantees didn't.

What all these methods had in common was that they pushed Bitcoin outward, off its base layer, into environments where others enforced the rules. This solved the usability problem short-term but created a bigger one: Bitcoin was operating under the very trust models it was designed to avoid.

The flaws were evident:

- Wrapped BTC (WBTC) grew only because people tolerated custodians as a temporary fix.

- Sidechains existed but remained niche due to failing to inherit Bitcoin's security.

- Bridges connected Bitcoin to other chains but introduced entirely new attack vectors.

Each workaround solved one problem but created another.

The Breakthrough: Bitcoin Finally Gets New Primitives

For a long time, Bitcoin's limitations were seen as irreversible. The base layer wouldn't change, upgrades were slow, and any proposal to enhance its expressiveness was dismissed as unnecessary risk.

But in the past few years, that assumption began to crack.

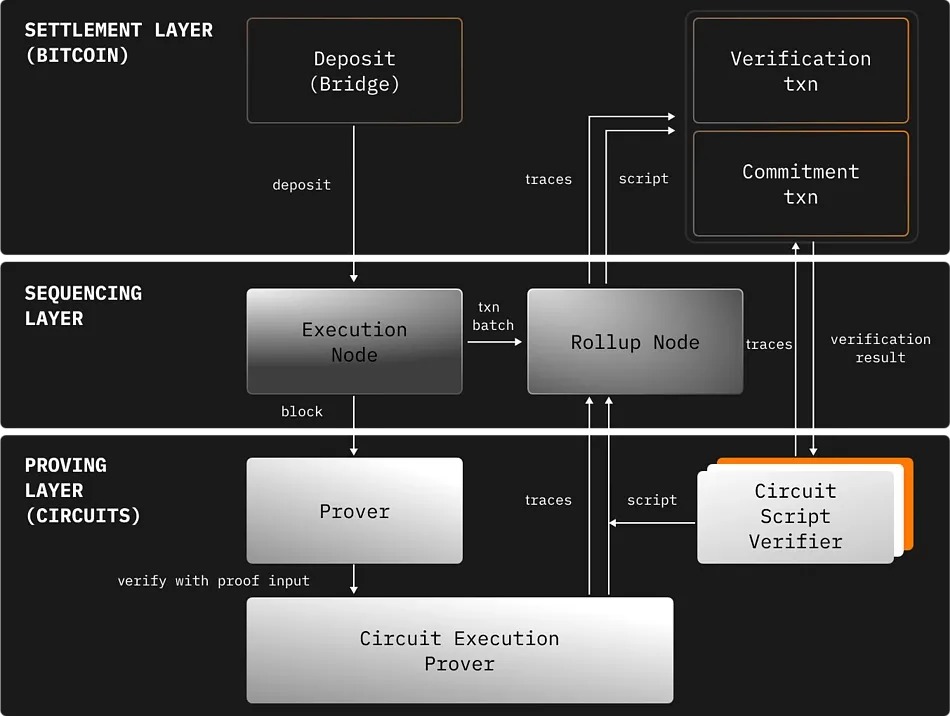

1. Bitcoin gained a "verify, don't execute" capability: The most important breakthrough was the emergence of a new class of verification models enabling Bitcoin to check computations done elsewhere without running them itself.

This breakthrough made BitVM and later BitVM-like systems possible. These systems didn't change Bitcoin's functionality but leveraged its ability to enforce outcomes via fraud proofs.

This means you can build logic, applications, even full execution environments outside Bitcoin, and Bitcoin can still ensure their correctness. This is fundamentally different from Ethereum's "execute everything on L1" philosophy. Bitcoin can now act as a judge. This is what finally opened the door to:

- Bitcoin-secured rollups

- Trust-minimized bridges

- Programmable Bitcoin vaults

- Off-chain computation, on-chain verification

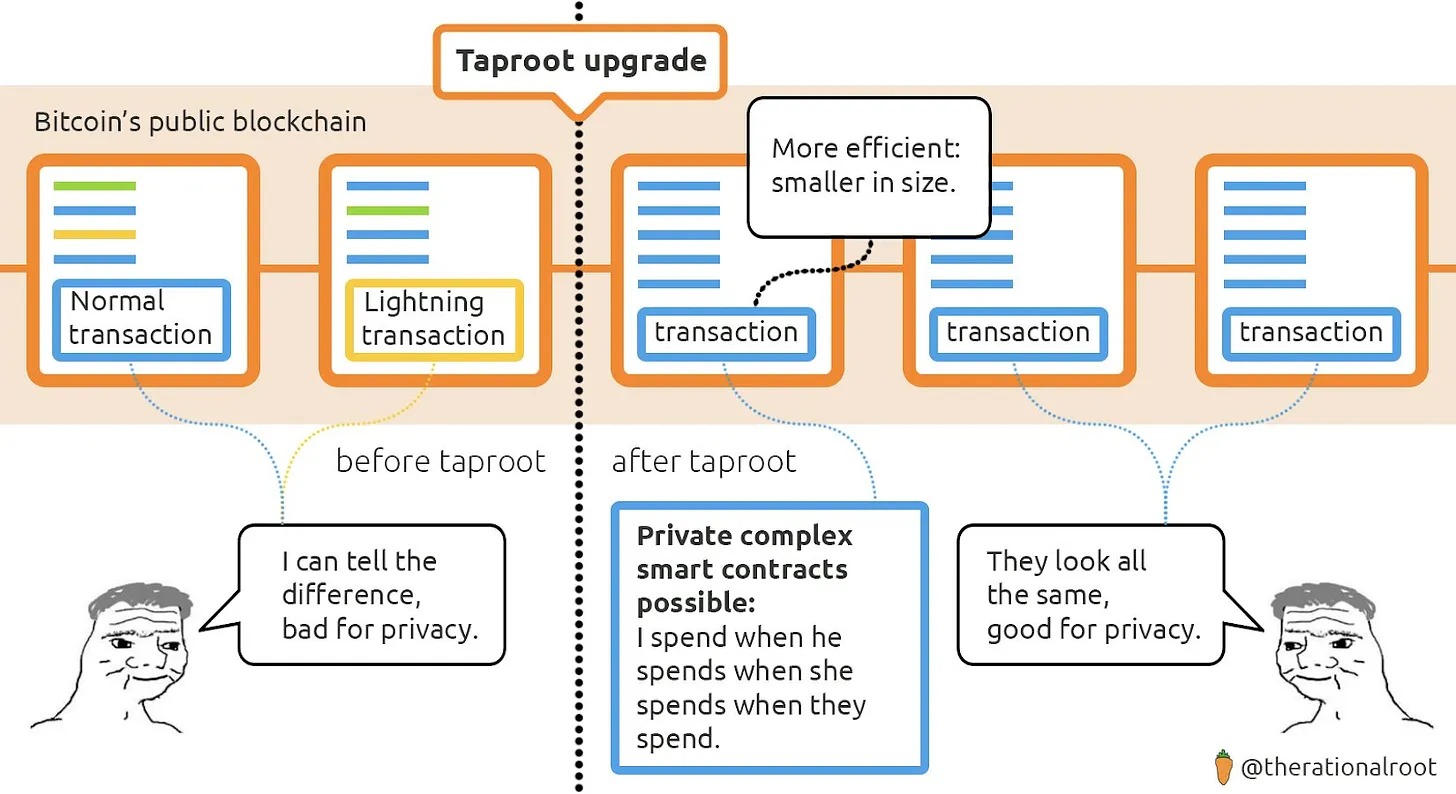

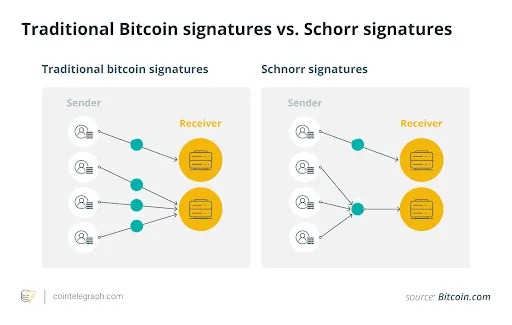

2. Upgrades like Taproot quietly expanded Bitcoin's range: Taproot wasn't initially promoted as a DeFi upgrade, but it provided the cryptographic foundation BTCFi needed: cheaper multisigs, more flexible key path spending, and better privacy. More importantly, it enabled architectures like Taproot Assets (for stablecoins) and more advanced vault systems.

3. The emergence of Bitcoin-native assets: With Taproot and newer proof systems, projects began launching assets native to Bitcoin or secured by Bitcoin without wrapping BTC.

Combining Taproot, Schnorr signatures, and new off-chain verification techniques, developers can now build assets on Bitcoin itself or assets that directly inherit Bitcoin's security.

This includes:

- Taproot Assets (Tether minting USDT directly on Bitcoin/Lightning stack)

- Bitcoin-native stablecoins without relying on Ethereum, Solana, or Cosmos

- BTC-backed synthetic assets without custodial pegs

- Programmable vaults and multisig structures previously impossible

For the first time, assets issued on Bitcoin could be used without leaving Bitcoin. And assets issued by Bitcoin didn't require taking Bitcoin out of self-custody.

4. Bitcoin yield became possible: Bitcoin itself never had yield. Historically, the only way to "earn" yield on Bitcoin was to wrap it, send it to a custodian, lend it on a centralized platform, or bridge it to another blockchain. All these methods carried risk and completely departed from its security model.

BTCFi introduces a completely new way for Bitcoin to generate yield. How? By creating systems where Bitcoin contributes to network security. This leads to three types:

Bitcoin staking (for other networks): BTC can now secure PoS networks or appchains without leaving the Bitcoin chain.

Bitcoin restaking: Similar to how Ethereum can secure multiple protocols via shared security, Bitcoin can now be used as collateral to back external chains, oracles, DA layers, etc.

Lightning Network-based yield systems: Protocols like Stroom allow BTC used in Lightning channels to earn yield by providing liquidity, again without wrapping or relying on custodial bridges.

None of this was possible before BTCFi.

5. Bitcoin finally got an execution layer: Recent advances in off-chain verification allow Bitcoin to enforce the results of computations it doesn't perform itself. This lets developers build rollups, bridges, and contract systems around Bitcoin that rely on Bitcoin for verification, not computation. The base layer remains unchanged, but outer layers can now run logic and prove its correctness to Bitcoin when needed.

This gives Bitcoin unprecedented power: the ability to support applications, contract-like behavior, and new financial primitives without moving Bitcoin into custodial systems or rewriting the protocol. This isn't "smart contracts on Bitcoin" but a verification model that preserves Bitcoin's simplicity while allowing more complex systems to exist around it.

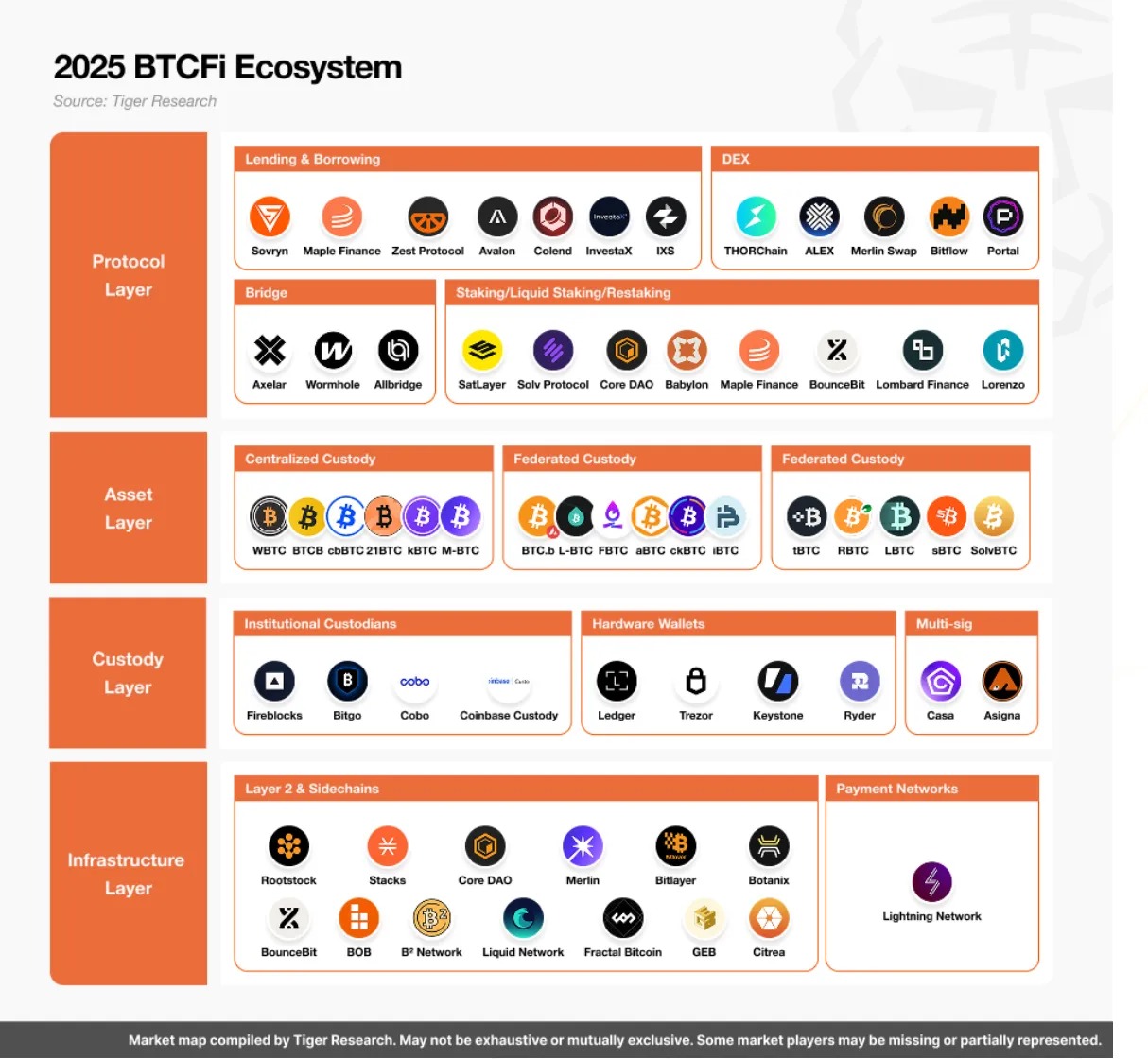

BTCFi Overview: What's Actually Being Built

As the underlying verification and portability tools matured, the Bitcoin ecosystem finally began expanding in ways that no longer rely on custodians or wrapped assets. What's emerging today isn't a single product or category but a series of interconnected layers that, for the first time, give Bitcoin a fully functional economy. The easiest way to understand this is to see how these components complement each other.

Infrastructure Layer: The first significant change is the emergence of Bitcoin-secured execution environments. These aren't L1 competitors or attempts to turn Bitcoin into a smart contract platform. They are external systems that handle computation, relying on Bitcoin only for verification. This separation is crucial. It creates a space where lending, trading, collateral management, and even more complex primitives can exist without any changes to Bitcoin's base layer. It also avoids the pitfalls of the old model, where using Bitcoin meant handing it to a custodian or trusting a multisig. Now, Bitcoin itself remains untouched; computation happens around it.

Assets & Custody Layer: Simultaneously, a new generation of Bitcoin bridges is forming, no longer the custodial, trust-heavy bridges of the last cycle, but bridges built around verifiable outcomes. Instead of requiring users to trust a set of operators, these systems use challenge mechanisms and fraud proofs to automatically reject incorrect state transitions. The result is a safer way to move Bitcoin to external environments without relying on the fragile trust assumptions of earlier designs. More importantly, this type of bridge aligns with Bitcoin holders' inherent sense of security: minimal trust, minimal dependency.

Protocol Layer: As asset movement becomes safer, the next wave of innovation focuses on what Bitcoin can do within these environments. Yield markets and security markets emerge here. For most of Bitcoin's history, earning any yield on Bitcoin meant sending it to an exchange or wrapping it onto another blockchain. Now, staking and restaking models allow Bitcoin to contribute to external network security without leaving its own custody. Yield doesn't come from credit risk or rehypothecation but from the economic value of maintaining consensus or verifying computation results.

Meanwhile, Bitcoin-native assets are starting to appear. Instead of wrapping Bitcoin or moving it to Ethereum, developers are beginning to use Taproot, Schnorr signatures, and off-chain verification to issue assets on Bitcoin or peg assets to Bitcoin's security. This includes stablecoins minted directly on Bitcoin infrastructure, synthetic assets without custodial dependencies, and vault structures allowing more flexible spending conditions. All this expands Bitcoin's utility without introducing it to different trust models.

These advances are interesting individually. Together, they mark the birth of the first coherent Bitcoin financial system. Computation can happen off-chain and be enforced on Bitcoin. Bitcoin can be moved securely without custody. It can earn yield without leaving self-custody. Assets can exist natively without relying on other ecosystems' security. Each advance solves a different part of the liquidity trap that has plagued Bitcoin for over a decade.

My Take?

I think the simplest way to view BTCFi is this: Bitcoin finally has an ecosystem that matches its scale. For years, people tried to build a Bitcoin ecosystem with tools that simply couldn't support trillion-dollar liquidity. No serious Bitcoin holder would stake their Bitcoin on custodial pegs, unverified bridges, or jury-rigged sidechains—and they didn't.

This wave is different because it meets Bitcoin entirely on its own terms. The security model remains intact, self-custody remains intact, and the surrounding systems are finally robust enough to carry meaningful capital. If even a small fraction of dormant BTC starts moving because the infrastructure is finally worthy of it, the impact will be profound.

This new wave is different because it approaches the challenge Bitcoin's way. The security model is preserved, self-custody mechanisms remain whole, and the systems around Bitcoin are finally strong enough to handle significant capital flows. Even if only a small portion of sleeping Bitcoin begins to move because the infrastructure has finally matured, the impact will be significant.