Note de la rédaction : Alors que l'IA passe d'« outil» à « infrastructure de flux de travail », les prix de location des GPU entrent dans une phase d'accélération à la hausse, l'offre continuant de se resserrer.

De la hausse de près de 40 % du prix annuel du H100, à la capacité de calcul verrouillée jusqu'au second semestre 2026, en passant par les laboratoires d'IA qui verrouillent continuellement l'offre via des contrats à long terme et des mécanismes de renouvellement, la logique de fonctionnement du marché des GPU a clairement changé : le prix n'est plus principalement déterminé par le coût du matériel, mais est façonné conjointement par la consommation de tokens, les capacités des modèles et la productivité.

Les changements du côté de la demande sont particulièrement cruciaux. De nouveaux paradigmes tels que les systèmes multi-agents, la génération de contenu natif et les outils de programmation IA poussent l'utilisation des tokens dans une phase de croissance exponentielle. Le constat central du rapport devient également plus clair : le retour sur investissement des outils d'IA a été vérifié, avec des rendements de 5 à 10 fois, ce qui rend le prix de la capacité de calcul incapable de contraindre efficacement la demande pendant une période assez longue.

La tension qui en résulte est de plus en plus nette : le marché réel de la capacité de calcul montre une pénurie généralisée et un transfert du pouvoir de fixation des prix vers l'amont, tandis que le marché financier reste ancré dans l'attente d'« une surabondance finale et d'une marchandisation ». Ce décalage entre les attentes et la réalité est en train de remodeler la logique d'évaluation du secteur des infrastructures d'IA.

Alors que la capacité de calcul devient une nouvelle matière première, son mécanisme de prix, sa structure d'offre et son rendement capitalistique sont en pleine restructuration profonde.

Voici le texte original :

La demande pour Claude 4.6 Opus et Claude Code d'Anthropic a considérablement augmenté. Son revenu annuel récurrent (ARR) est passé de 9 milliards de dollars à la fin de l'année dernière à plus de 25 milliards de dollars actuels en seulement un trimestre, soit une multiplication par près de trois. Dans le même temps, les modèles open source, représentés par GLM et Kimi K2.5, ont également stimulé l'expansion rapide des scénarios d'application liés aux modèles open source. Le financement continu d'entreprises telles qu'Anthropic, OpenAI et plusieurs Neolabs exacerbe également la demande de ressources GPU.

Ce point d'inflexion signifie que la demande a augmenté de manière drastique en peu de temps, et que les hyperscalers et les nouveaux fournisseurs de services cloud (Neoclouds) ont connu une ruée vers l'achat de GPU.

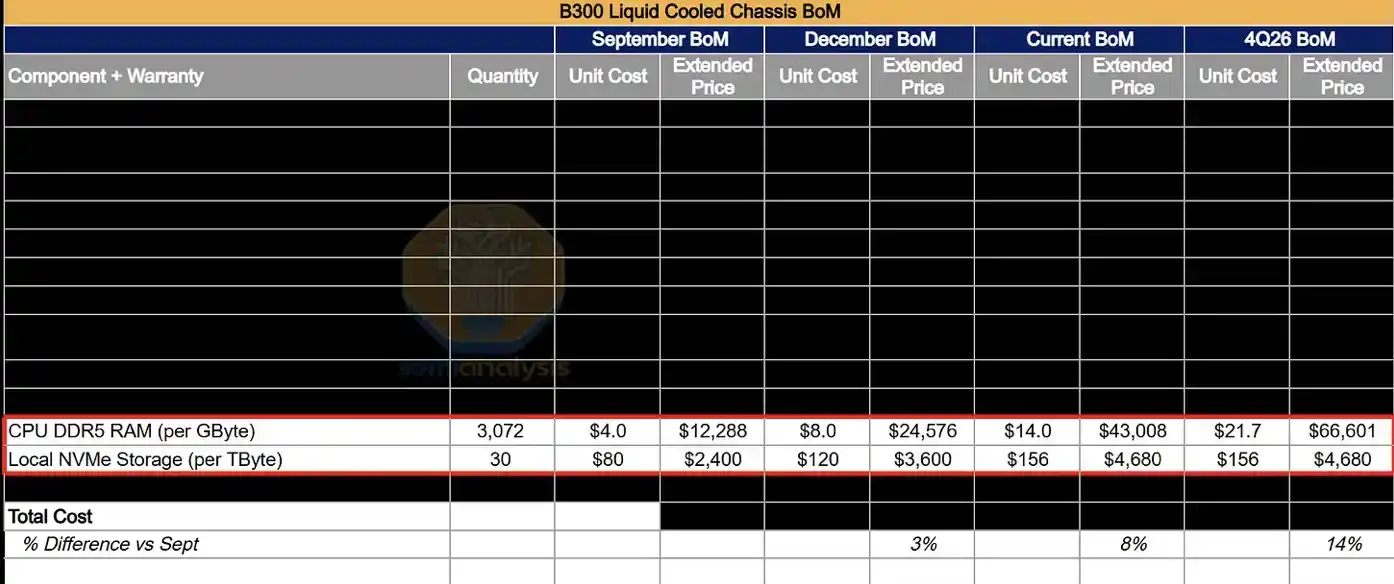

Cette nouvelle demande fait monter les prix tout au long de la chaîne d'approvisionnement, de la mémoire DRAM et NAND, aux câbles à fibres optiques, à l'hébergement de centres de données, en passant par les turbines à gaz et autres infrastructures ; presque tous les produits et services concernés ont vu leurs prix augmenter.

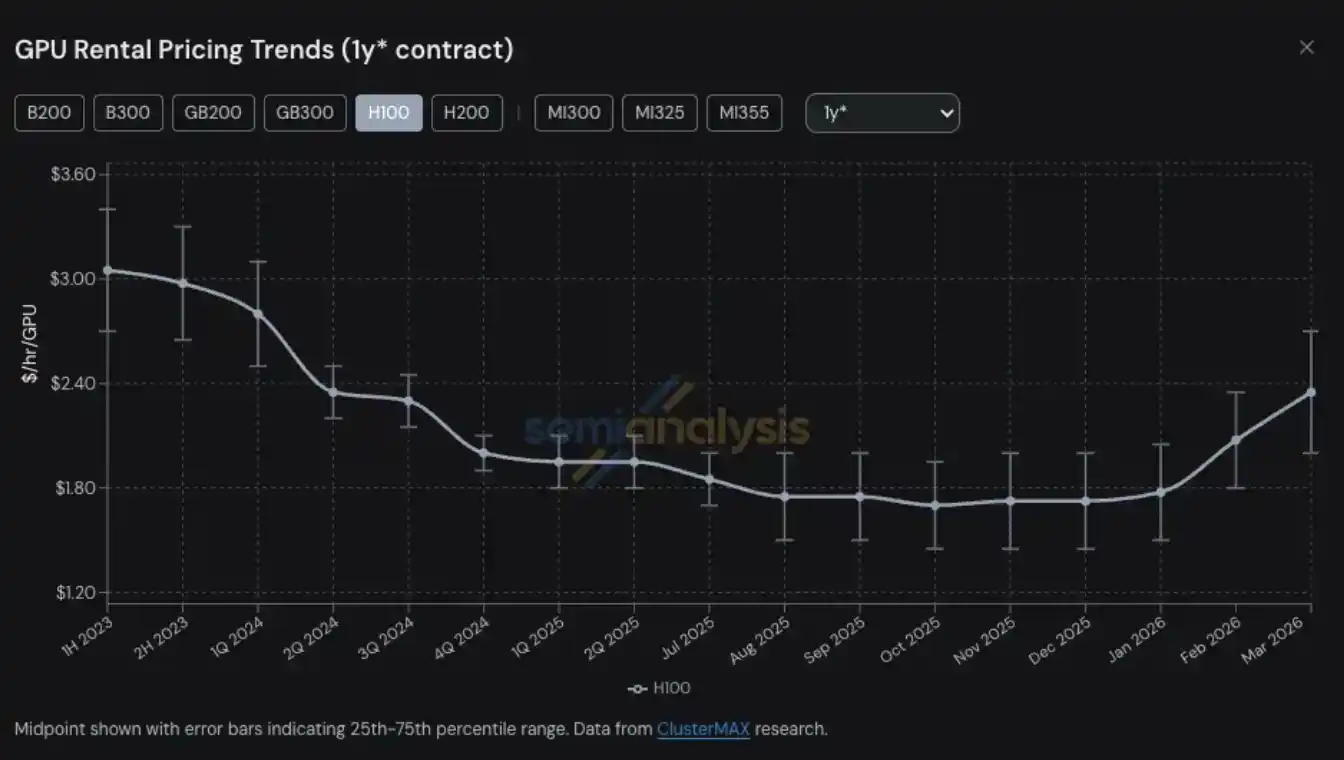

Le prix de location des GPU est devenu le dernier domaine, parmi les nombreux produits et services liés au calcul, à connaître des tensions d'approvisionnement et une flambée des prix. Le prix du contrat de location de GPU H100 sur un an est passé d'un plancher de 1,70 dollar par GPU par heure en octobre 2025 à 2,35 dollars en mars 2026, soit une hausse de près de 40 %.

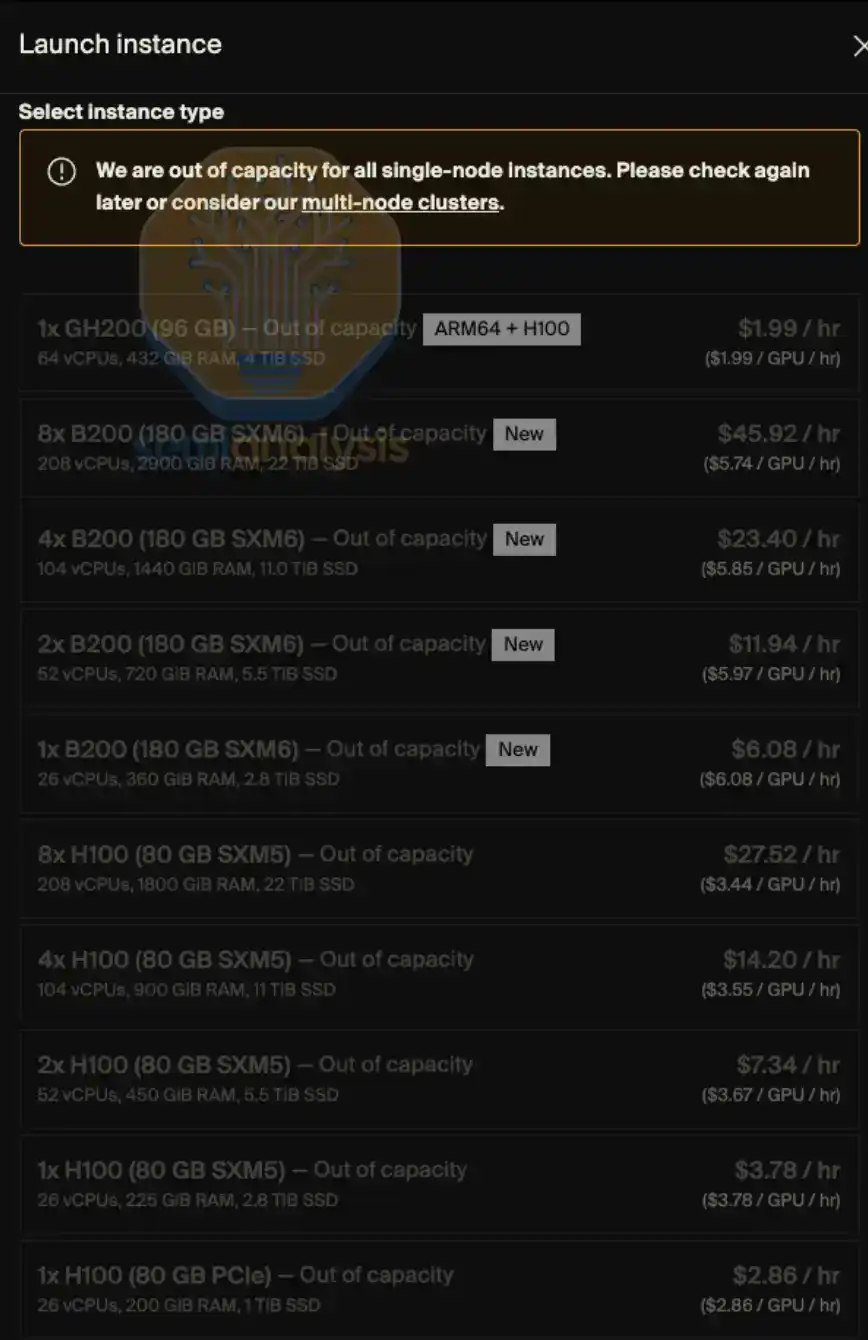

La capacité de location de GPU à la demande (on-demand) est presque entièrement épuisée pour tous les modèles – les utilisateurs qui ont verrouillé des instances à la demande ne sont pas disposés à remettre la capacité de calcul sur le marché, même après la hausse des prix. Début 2026, trouver de la capacité de calcul GPU était presque comme essayer d'obtenir un billet d'avion pour « le dernier vol » : prix élevés, presque plus de billets. Pour utiliser une analogie plus appropriée, c'était moins comme chercher un billet d'avion que comme « trouver un canal pour acheter des médicaments ».

Chez SemiAnalysis, nous suivons en profondeur et à long terme les tendances et les sujets clés dans l'écosystème des Neocloud et des hyperscalers, y compris les prix de location des GPU. Cette capacité provient de nos recherches et pratiques continues dans des projets tels que ClusterMAX, InferenceX et le coût total de possession (TCO) du cloud IA.

Dans le même temps, nous consacrons également beaucoup d'efforts à aider divers laboratoires d'IA à se connecter avec des fournisseurs de services Neocloud, à trouver des ressources de location de GPU sur le marché, et à échanger continuellement avec presque toutes les parties prenantes de l'écosystème sur l'évolution des prix de location des GPU.

Depuis 2023, nous avons créé et maintenu pour nos clients un système d'indice de prix de location de GPU, couvrant les principaux modèles de GPU (tels que H100, H200, B200, B300, GB200, GB300, MI300, MI325, MI355), et couvrant différentes durées de location, de la location à la demande (on-demand), de la location courte durée d'un mois, jusqu'aux contrats à long terme de 5 ans maximum. Cet indice est construit sur la base de données d'enquêtes auprès de plusieurs fournisseurs de services Neocloud et d'acheteurs de capacité de calcul, et est validé par des données de transactions réelles, ainsi que par les négociations et transactions que nous facilitons.

Aujourd'hui, nous rendons public l'indice de prix de location de GPU H100 sur un an de SemiAnalysis, espérant ainsi fournir plus de données et d'analyses à l'industrie. Cet indice est mis à jour mensuellement, et nous publierons continuellement les dernières tendances et observations du marché via X et LinkedIn. Quant aux données de prix complètes couvrant différentes structures de durée de location et d'autres modèles de GPU principaux, elles ne sont actuellement accessibles qu'aux utilisateurs institutionnels abonnés à notre modèle TCO Cloud IA.

Ce rapport se concentrera sur les dernières tendances du marché de la location de GPU, les observations de première ligne et les données clés, expliquant comment nous comprenons la structure globale du marché, et fournissant une évaluation préliminaire de l'orientation future des prix de location.

Le marché de la location de GPU entre dans une phase de « tarification dynamique »

La seule courbe des prix de location du H100 sur un an ne suffit pas à rendre compte pleinement du degré de tension du marché – notre expérience réelle pour obtenir de la capacité de calcul en première ligne, ainsi que les retours des acteurs du marché, reflètent une situation plus grave.

La demande actuelle provient de multiples scénarios d'utilisation hautement hétérogènes, pour lesquels il n'existe presque pas de « solution universelle ». Par exemple, côté inférence, les modèles Mixture of Experts (MoE) à grande échelle sont plus adaptés pour fonctionner sur des systèmes à grande échelle récents comme le GB300 NVL72 ; tandis que côté entraînement, le H100 conserve un avantage en termes de rapport performance/prix, ce qui maintient la demande à un niveau élevé même pour des GPU relativement « anciens ».

Les clients rivalisent désormais même pour payer le prix de 14 dollars par GPU par heure pour les instances spot AWS p6-b200 ; certains fournisseurs Neocloud de premier plan ne vendent plus de nœuds uniques ; les prix de renouvellement de certains H100 sont identiques à ceux signés il y a deux ou trois ans ; et certains contrats H100 ont été directement renouvelés jusqu'en 2028, soit une durée de location de 4 ans. Il est désormais difficile de trouver ne serait-ce qu'un cluster de 8 nœuds (64 GPU) H100 ou H200 – la moitié des fournisseurs que nous avons contactés étaient complètement en rupture de stock, et la majorité ont répondu qu'aucun GPU d'architecture Hopper ne serait libéré prochainement à l'expiration de contrats.

Nous avons même entendu dire que certains locataires de capacité de calcul ont commencé à sous-louer les clusters qu'ils ont loués, un peu comme on sous-loue un appartement pendant le Grand Prix de Monaco. La question de savoir si des « sous-locataires Neocloud » vont apparaître n'est probablement plus une blague.

L'approvisionnement en Blackwell est extrêmement tendu. Nous comprenons qu'en raison de la forte demande de modèles à poids open source et de l'explosion continue de la demande d'inférence, le cycle de déploiement des nouveaux clusters Blackwell est désormais prolongé jusqu'en juin-juillet. De plus, ces clusters sur le point d'être déployés sont pour la plupart déjà réservés à l'avance. En fait, vu l'ensemble du marché, la nouvelle capacité qui ne sera mise en ligne qu'entre août et septembre 2026 est presque entièrement réservée.

Prix de location des GPU : Le retour

Mais comment le marché en est-il arrivé là ? Il y a seulement 6 mois, la plupart des observateurs du marché étaient sceptiques quant à la « valeur terminale » des GPU et pensaient généralement que les prix de location des GPU continueraient de baisser inévitablement avec le temps. À l'époque, si un Neocloud ou un hyperscaler utilisait un cycle d'amortissement de 6 ans pour les actifs de calcul GPU dans ses modèles financiers, il était même critiqué par les analystes financiers. Avant de discuter des tendances futures, revenons rapidement sur la façon dont les choses en sont arrivées là.

Avant le second semestre 2025, l'attente dominante dans tout l'écosystème était que les prix de location des GPU Hopper (c'est-à-dire H100 et H200) baisseraient significativement avec le déploiement à grande échelle de Blackwell et son coût de calcul unitaire nettement inférieur. Mais la réalité fut tout autre. Au second semestre 2025, la demande de H100 non seulement ne faiblit pas, mais s'est même renforcée dans de nombreux scénarios. L'adoption rapide des modèles à poids open source et l'accélération continue de la demande d'inférence à l'époque furent les premiers signaux de cette vague de demande de calcul presque sans fin.

En janvier 2026, le marché du calcul a atteint un nouveau point d'inflexion : les prix de la mémoire DRAM et NAND, après plusieurs trimestres de hausse rapide, ont commencé à entrer dans une phase de flambée quasi « parabolique ». Selon notre modèle de mémoire, au premier trimestre 2026, les prix contractuels du LPDDR5 et du DDR5 ont augmenté d'environ 4 et 5 fois respectivement en glissement annuel.

Pour faire face au risque de marge posé par la hausse drastique des coûts des composants, les fabricants d'OEM ont commencé à augmenter les prix des serveurs IA, et l'ampleur des hausses était nettement supérieure à celle des composants sous-jacents eux-mêmes. Cela a rendu les décisions d'investissement en capital pour les clusters plus complexes : des coûts d'acquisition de serveurs plus élevés compriment le rendement attendu des projets, forçant certains opérateurs à ralentir leur rythme de déploiement, voire à abandonner purement et simplement des projets. Le résultat fut que une partie de l'offre nouvelle qui aurait pu être mise en ligne a été reportée ou mise en suspens, aggravant encore la situation tendue du marché de la location.

Dans ce chaos d'approvisionnement déclenché par la « perte de contrôle des prix des serveurs IA », la demande de location de GPU a considérablement accéléré sa croissance, et la capacité de calcul restante sur le marché a été presque entièrement absorbée en janvier et février. En mars, il était presque impossible de trouver de la capacité disponible, que ce soit pour le H100, le H200 ou le B200, quelle que soit la durée de location. Le prix de location sur un an avait déjà dépassé les 2 dollars par GPU par heure fin janvier, et a de nouveau augmenté de 15 à 20 % par rapport à fin janvier mi-février, avec une nouvelle hausse de 15 à 20 % attendue d'ici fin mars.

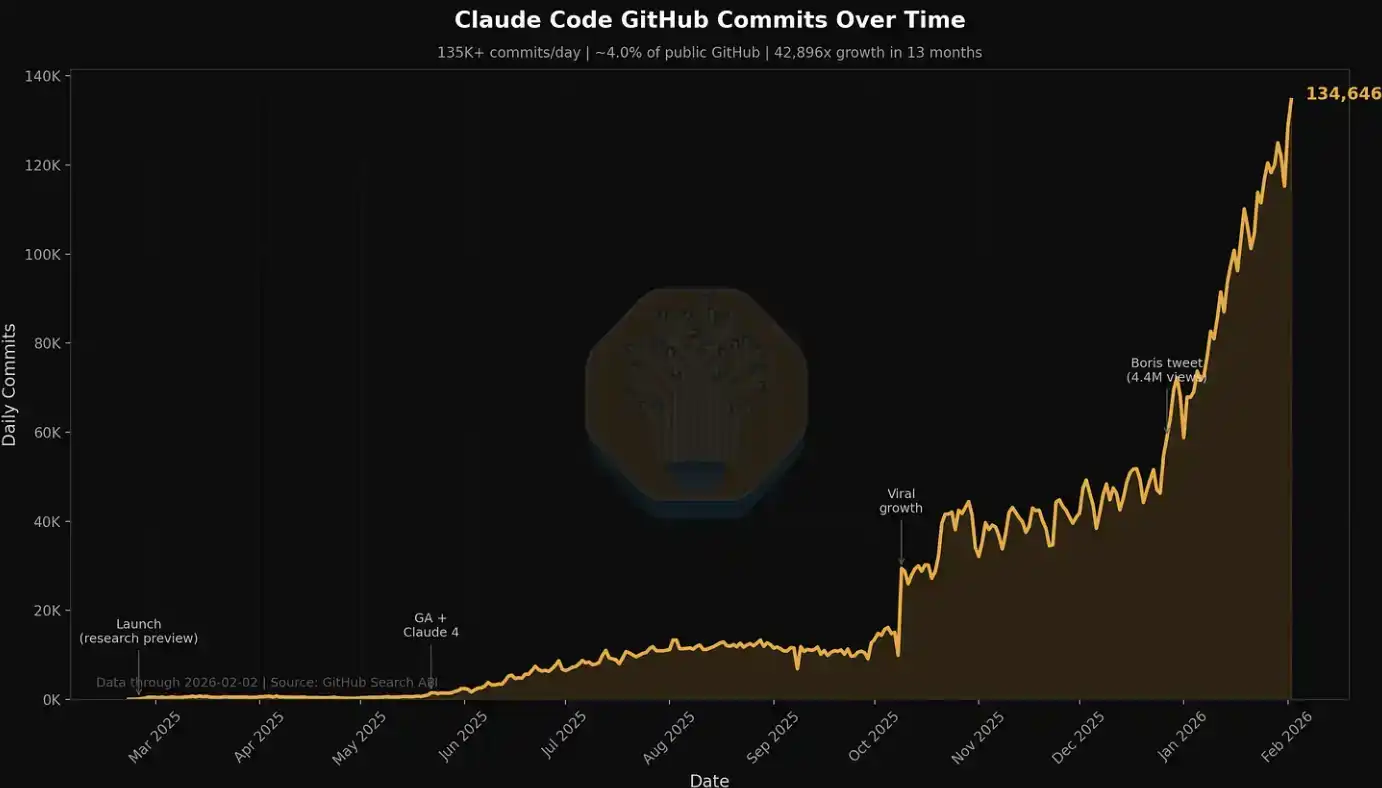

L'un des principaux moteurs de la demande début cette année provenait de la génération de contenu natif (native media generation). Des applications comme Seedance et Nano Banana poussent les utilisateurs à générer et itérer des images et des vidéos à l'échelle, augmentant ainsi significativement le débit de tokens. Mais une source de demande plus cruciale et plus visible fut l'émergence de charges de travail multi-agents (multi-agent) – ces systèmes exécutent des processus à multiples étapes, itèrent continuellement dans des environnements à haute concurrence, entraînant une consommation de tokens et une demande de calcul présentant une croissance « exponentielle ».

Cette tendance est particulièrement visible dans les données relatives à Claude Code, comme nous l'avons mentionné dans plusieurs articles. Prenons SemiAnalysis par exemple, rien que les 7 derniers jours, l'entreprise a consommé des milliards de tokens, pour un coût moyen d'environ 5 dollars par million de tokens. Mais les gains de temps, l'extension des flux de travail et l'amélioration des capacités qui en découlent dépassent de loin le coût lui-même. Aujourd'hui, SemiAnalysis a intégré toute une suite d'outils d'IA dans plusieurs flux de travail, ne se limitant plus à une simple recherche et synthèse, mais s'étendant à des tableaux de bord, de l'extraction automatisée, du traitement de données à grande échelle et de la modélisation financière basée sur des agents.

Nous suivons également cette croissance explosive de la demande via des indicateurs tels que les commits quotidiens de Claude (Claude Commits Daily). Selon la tendance actuelle, nous prévoyons que d'ici fin 2026, Claude Code représentera plus de 20 % de tous les commits de code. On peut dire que, sans que vous ne vous en rendiez compte, l'IA a commencé à « dévorer » l'ensemble du processus de développement logiciel. Les clients institutionnels souhaitant obtenir cet ensemble de données peuvent contacter notre équipe API. Petit indice : ce volume de commits est nettement supérieur à celui de notre publication initiale.

Dans notre cercle, presque tout le monde est un utilisateur intensif de Claude Code. Mais nous savons aussi que ce cercle est lui-même profondément immergé dans le domaine de l'IA et des semi-conducteurs, n'étant essentiellement qu'« une petite poignée de personnes en première ligne ».

Pour de nombreuses entreprises du Fortune 500, et pour le grand public, Claude Code et le « monde des agents » ne sont qu'un sujet marginal légèrement nouveau, apparaissant occasionnellement dans le fil d'actualité Facebook ou sur un podcast NPR. Ils n'ont presque pas encore pris conscience qu'une vague de productivité et un choc structurel pilotés par les agents se rapprochent.

Alors que davantage d'acteurs de l'économie réelle prennent progressivement conscience des rendements sur investissement stupéfiants offerts par l'utilisation des outils d'IA et rejoignent cette « vague de calcul », la consommation de tokens continuera d'augmenter par paliers. Le débat sur le retour sur investissement de l'IA est, de fait, clos – la valeur créée par l'utilisation des outils d'IA dépasse souvent d'un ordre de grandeur son coût. Dans ce contexte, le déplacement continu vers la droite de la courbe de demande de tokens forme une force puissante et (à ce stade) relativement inélastique, poussant les prix de location des GPU à la hausse.

En termes simples, si le retour sur investissement de l'utilisation des outils d'IA peut atteindre 5 à 10 fois, alors les prix de location des GPU ont encore une marge de hausse considérable avant de pouvoir vraiment freiner la demande. Nous n'excluons pas non plus que de nouvelles hausses des prix de location continuent de se répercuter vers l'amont, faisant monter le coût des serveurs et des composants clés.

Publication de l'indice de prix de location H100 sur un an de SemiAnalysis

Aujourd'hui, nous rendons public gratuitement l'indice de prix des contrats de location de GPU H100 sur un an de SemiAnalysis, dans le but d'améliorer la connaissance et la transparence sur les tendances des prix de location des GPU.

Cet indice est construit sur la base de données d'enquêtes mensuelles auprès de plus de 100 acteurs du marché (incluant des fournisseurs de services Neocloud, des acheteurs et des vendeurs de capacité de calcul), afin de déterminer la fourchette représentative des prix de location de GPU (du 25e au 75e percentile). Dans le même temps, nous validons également ces données par des données de transactions réelles, et en facilitant la mise en relation d'acheteurs et de vendeurs dans notre propre réseau, participant directement à certaines transactions pour calibrer davantage les niveaux de prix.

Depuis 2023, nous suivons continuellement les prix contractuels des GPU, y compris H100, H200, B200, B300, GB200, GB300, pour des durées de location allant de 3 mois à 5 ans ; nous incluons également les données pertinentes de la série AMD (MI300, MI325, MI355).

Comparé aux indices de GPU existants sur le marché, l'indice de prix des contrats de location H100 sur un an de SemiAnalysis présente plusieurs différences clés :

Premièrement, de nombreux indices de location de GPU sont basés sur des cotations au spot/à la demande (spot/on-demand) ou des prix affichés publiquement, mais en réalité, la grande majorité des transactions de location de GPU se font via des contrats à long terme, généralement d'une durée de 6 mois ou plus. Ces prix sont souvent formés par des négociations bilatérales et n'apparaissent dans aucune base de données publique. La plupart des grands fournisseurs de services Neocloud préfèrent conclure des baux d'au moins un an, idéalement de 2 à 3 ans, et encore mieux s'ils peuvent conclure un accord important de prise ferme (offtake) de 5 ans. L'indice de location H100 sur un an de SemiAnalysis se concentre précisément sur ce « marché des contrats » – c'est-à-dire la partie où le volume des transactions est le plus concentré. En pointant explicitement vers une durée de location, cet indice est également plus facile pour les utilisateurs de comprendre la partie du marché qu'il couvre et de confronter cela à leurs propres observations.

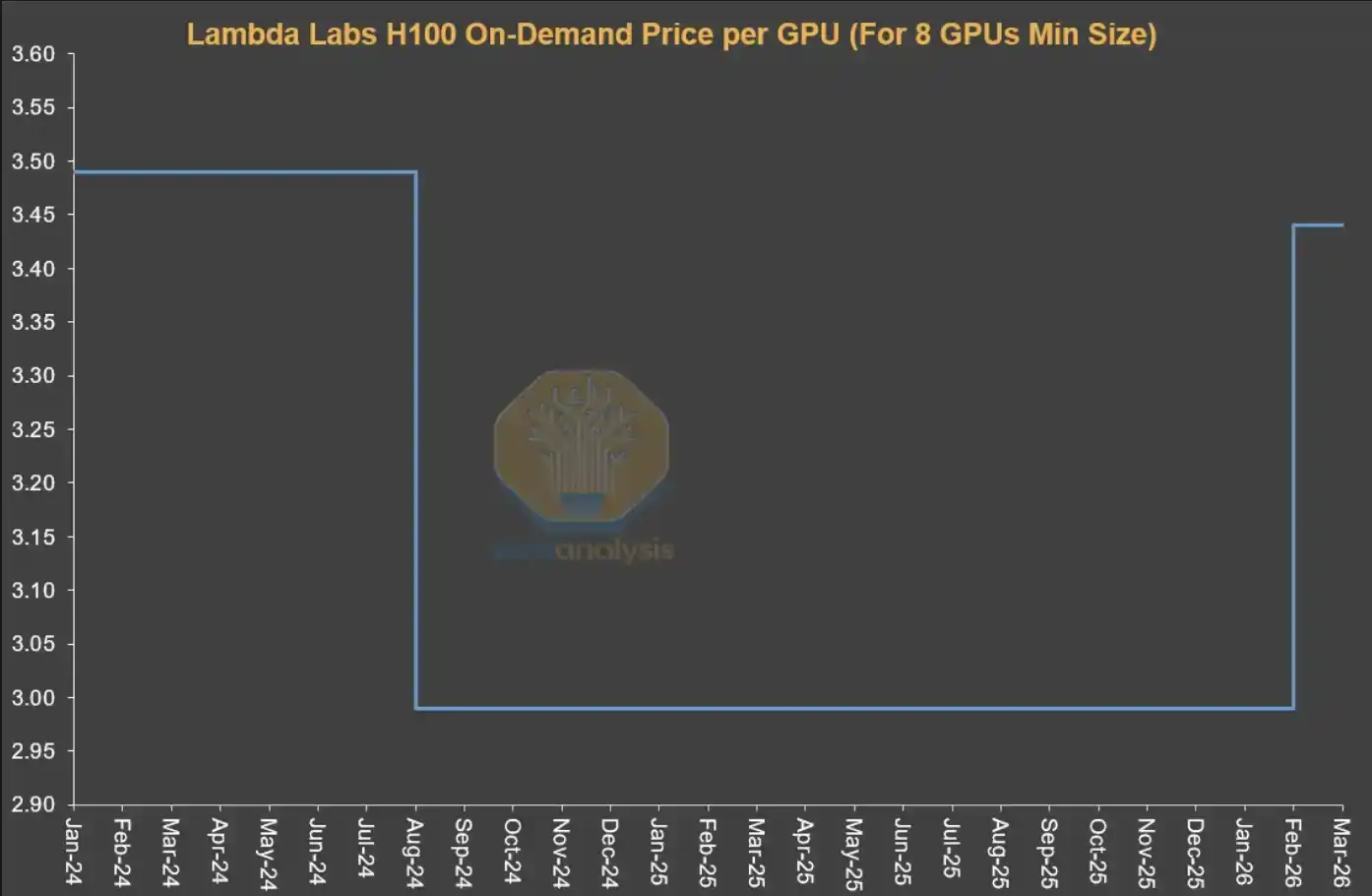

Deuxièmement, les prix divulgués publiquement ne représentent pas les prix de transaction réels. Les prix annoncés par les hyperscalers et les Neocloud fournissent davantage une référence directionnelle de tendance qu'un niveau de transaction réel. Ces prix sont souvent en retard sur les changements du marché des contrats, n'étant généralement ajustés qu'après que la demande de calcul ait déjà changé. Surtout sur le marché à la demande, les prix sont souvent fixés à un niveau relativement stable, et les changements réels de l'offre et de la demande se manifestent through utilization or occupancy rates, and are only adjusted不定期 (irrégulièrement) si nécessaire. Ce mécanisme de marché sera développé plus loin dans l'article.

Troisièmement, bien qu'il existe de nombreux indices sur le marché capables de traiter de grandes quantités de cotations, de prix et de données de transaction, et ayant des avantages en analyse de tendances, notre approche met plus l'accent sur l'interaction directe avec les acteurs du marché. Chaque cotation, chaque transaction a son propre contexte et sa logique décisionnelle, et nous souhaitons, tout en présentant des données quantitatives, compléter ces informations qualitatives et observations de première ligne, afin de restituer plus complètement la structure réelle du marché de la location de GPU.

Pour les utilisateurs abonnés institutionnels, nous fournissons également des données complètes sur la structure des échéances couvrant presque tout le marché principal de la location de GPU.

En publiant l'indice de prix des contrats H100 sur un an, nous avons également lancé le Tableau de bord Tokenomics de SemiAnalysis pour les utilisateurs abonnés au modèle Tokenomics institutionnel, afin de suivre et comprendre le paysage des modèles d'IA de pointe. Ce tableau de bord permet aux utilisateurs de comparer de manière personnalisée différents modèles et fournisseurs de services sur plusieurs dimensions telles que le code, l'inférence, les mathématiques et l'évaluation des agents, de comparer les prix des API, et de consulter les données clés divulguées par les principaux laboratoires d'IA, y compris l'utilisation de tokens, les revenus, la valorisation et la taille de la clientèle.

Structure actuelle du marché de la location de GPU

Avant le second semestre 2025, l'environnement de prix du marché de la location de GPU était relativement plus concurrentiel. À l'époque, les opérateurs disposaient de stocks de GPU plus importants, et la demande finale commençait tout juste à accélérer. Par conséquent, la concurrence entre les fournisseurs de services Neocloud était féroce, se disputant les clients avec des prix plus attractifs. Leur objectif central était d'augmenter le taux d'utilisation, de « squeezer » autant que possible la valeur des actifs de calcul existants avant l'arrivée du prochain cycle d'itération des GPU.

Mais depuis, la dynamique du marché a fait un demi-tour à 180 degrés. Aujourd'hui, les Neocloud et les hyperscalers ont complètement pris les commandes – ils peuvent exiger des acomptes plus élevés, de meilleurs prix, des durées de contrat plus longues, et peuvent même choisir自主地 (autonomously) les dates de début et de fin des contrats pour correspondre à leur planning de stock et de capacité. Dans le même temps, le temps joue également en faveur du côté de l'offre : ils peuvent avancer leurs déploiements à leur propre rythme et, dans un environnement de prix continuellement à la hausse, filtrer progressivement pour obtenir le portefeuille de clients le plus qualifié.

Structurellement, le marché de la location de GPU peut être大致 divisé (roughly divided) en trois segments, correspondant à différents types de besoins clients :

Location à court terme : à la demande (on-demand), spot et contrats de moins de 3 mois

Contrats à moyen terme : contrats de 3 mois à plus de 3 ans

Prises fermes à long terme (offtake) : contrats de 4 à 5 ans, 5 ans étant les plus courants

Location à court terme : À la demande, spot et contrats de moins de 3 mois

La location à court terme se situe à l'extrémité avant de toute la structure des durées, et dans de nombreux cas, elle correspond à une « capacité excédentaire ». Cependant, certains fournisseurs de services (comme Runpod, Lambda) se spécialisent dans la fourniture de capacité de calcul flexible et à l'échelle, à la demande ou spot.

Il est important de noter que le mécanisme de prix du marché à la demande diffère significativement des autres marchés contractuels. Normalement, les fournisseurs de services fixent un prix relativement stable pour les ressources à la demande, et ne l'ajustent que dans de rares cas. En d'autres termes, le prix du marché à court terme n'est pas entièrement驱动 (driven) en direct par l'offre et la demande en temps réel, mais reflète davantage la tension du marché through changes in resource utilization.

Les fournisseurs de services ajustent généralement le prix en une seule fois en fonction du taux d'utilisation des ressources : lorsque l'utilisation est faible, ils baissent les prix pour stimuler la demande ; et lorsque l'utilisation approche de la pleine capacité, ils augmentent les prix, car la demande peut rester élevée même à des prix plus élevés.

Cela explique pourquoi, sur une série chronologique, les prix à la demande annoncés par les Neocloud ont tendance à rester inchangés pendant de longues périodes, puis à subir une « discontinuité » soudaine à la hausse ou à la baisse. Pour le marché à la demande, ce qui reflète vraiment les changements de demande à haute fréquence, ce n'est pas le prix, mais le taux d'utilisation des ressources.

Contrats à moyen terme (Mid-Term Contracts)

D'un point de vue économique, le plus critique est en fait le « marché des contrats », car la grande majorité de la valeur transactionnelle de la location de GPU se produit dans ce segment. Parmi eux, les contrats d'un an sont particulièrement importants – ils reflètent à la fois la demande marginale des clients non laboratoires d'IA et la demande excédentaire des grands clients, ce qui en fait l'indicateur le plus sensible pour juger du degré de resserrement du marché.

Les entreprises natives de l'IA (AI Natives) et les petits et moyens laboratoires d'IA sont principalement actifs dans la fourchette de 1 à 3 ans. Cependant, une tendance récente et évidente est que ces institutions commencent également à essayer de verrouiller les ressources de calcul via des contrats plus longs – beaucoup s'étendent désormais à plus de 4 ans, et sont même prêtes à payer des acomptes supérieurs à 20 %, ce qui n'était pas courant dans les contrats de plus de 4 ans par le passé.

Prises fermes à long terme (Long-Term Offtakes)

Dans le marché plus long terme de 4 à 5 ans, la force motrice est constituée des grands laboratoires d'IA, qui verrouillent des ressources de calcul à grande échelle très tôt. Ce type de transaction correspond généralement à des clusters de grande taille de 50 MW, 100 MW ou même plus, ce qui équivaut大致 (roughly) à environ 24 000 à 48 000 GPU GB300 NVL72. Dans l'ensemble, ces accords de prise ferme à long terme ont déjà占据 (occupied) une part importante du marché de la location de GPU des Neocloud.

Les laboratoires d'IA privilégient ce type de contrats car ils peuvent verrouiller une capacité de calcul à grande échelle en une fois pour faire face à une demande finale en croissance rapide. Dans le même temps, ces institutions sont généralement profondément impliquées dans la conception du cluster,包括 (including) le stockage, le réseau, la configuration du CPU et autres liens clés. Ce type de transaction est souvent livré sous forme de **bare metal (métal nu)** car les laboratoires d'IA disposent de capacités d'ingénierie suffisantes pour personnaliser la pile technologique à un niveau plus bas, achieving the best TCO (coût total de possession) and performance.

Pour les fournisseurs de services Neocloud, ce type de transaction est également attractif. D'une part, ils peuvent concentrer leurs ressources commerciales sur quelques grosses commandes, sans avoir à gérer un grand nombre de petits clients pour le même revenu ; d'autre part, les contrats à long terme leur permettent également d'obtenir de meilleures conditions de financement par emprunt – en alignant la durée du financement sur la durée du contrat, ils peuvent effectively reduce the risk of maturity mismatch and price volatility, et dans la plupart des cas, verrouiller un taux de rendement interne (TRI) de projet de plusieurs dizaines de points de pourcentage.

De plus, les hyperscalers jouent également souvent un rôle de « filet de sécurité » (backstop) – ils agissent comme acheteurs directs, achetant la capacité de calcul auprès des Neocloud pour la revendre aux laboratoires d'IA. Cette structure est gagnant-gagnant pour toutes les parties : les Neocloud peuvent obtenir de meilleures conditions de financement basées sur un acheteur noté AAA ; et les hyperscalers, sans avoir à étendre leur propre bilan, peuvent obtenir une partie des收益 (returns) du projet en fournissant une garantie de crédit.

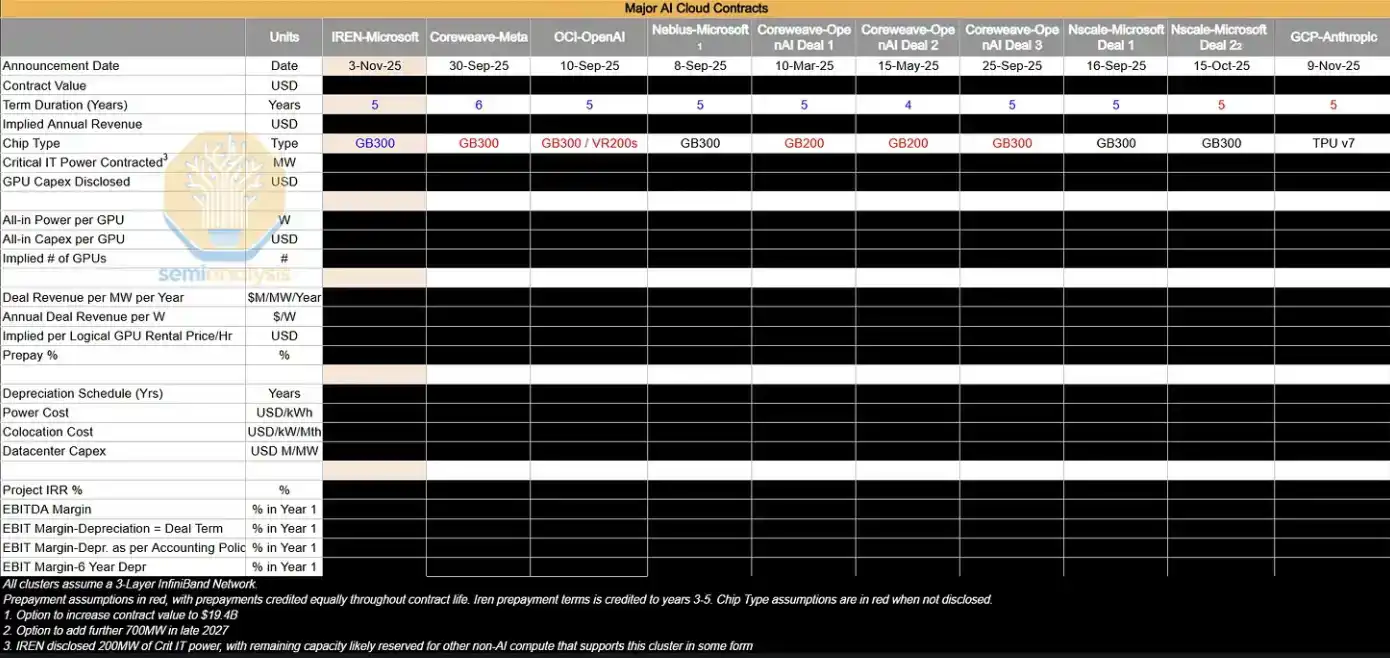

Le tableau ci-dessous répertorie quelques-uns des grands accords de prise ferme que nous suivons. Nous analysons en profondeur ces transactions pour en déduire le prix horaire implicite du GPU ($/hr/GPU), ainsi que des indicateurs clés de rentabilité tels que le TRI du projet et la marge EBIT.

Dans l'environnement de marché actuel, la grande majorité des grands clusters d'IA en expansion sont en fait « internalisés » par les laboratoires d'IA. Cependant, ces institutions continueront de pénétrer le marché des contrats de moins de 4 ans pour compléter leur capacité de calcul, tout en empêchant indirectement l'offre de retourner sur ce marché en renouvelant leurs clusters H100 et H200 existants. Alors que les clusters超大规模 (hyperscale) GB200 et GB300 sont progressivement mis en ligne, l'évolution de la relation entre l'offre et la demande sur le marché des contrats de 1 à 3 ans deviendra une variable值得观察的 (worth observing) dans un avenir proche.

« Où va la rondelle » (Where The Puck is Going)

Ce qui attire le plus l'attention actuellement, c'est le décalage évident entre la réalité sous-jacente et la sentiment du marché. Bien que les signaux de resserrement de l'offre et de hausse des prix – qui devraient normalement bénéficier aux Neocloud (expansion des marges, prolongation de la durée de vie utile des actifs) – soient très clairs, le marché public devient de plus en plus pessimiste envers des sociétés comme CoreWeave, Nebius, Iris Energy, etc., dont les cours actions se situent toujours dans le bas de la fourchette des 6 à 12 derniers mois.

Le marché reste dominé by the narrative of « ultimate oversupply, commoditization of compute », et les changements ci-dessus n'ont pas vraiment atténué les inquiétudes des investisseurs regarding the long-term value of GPUs. Mais from a frontline perspective,持续的供给紧张 (continuous supply tightness) and enhanced pricing power mean that almost all computing power is being « absorbed » by demand – even with performance differences, in this current environment of extreme shortage, it is still in short supply.

Trois points d'observation futurs

Pour juger si les prix de location des GPU continueront de se maintenir à un niveau élevé, trois variables méritent une attention particulière :

1. Le rythme d'expansion des clusters GB300 (2026)

La clé est la vitesse relative entre la nouvelle capacité de calcul et la demande de tokens – si l'offre atténue la tension ou si la demande continue de dépasser l'offre. Cela affectera directement la participation continue des laboratoires d'IA au marché des contrats de moins de 4 ans, ainsi que l'évolution des prix dans cette fourchette.

2. Si la pénurie de puces s'aggrave

Tout波动 (fluctuation) dans l'exécution de la fabrication des liens clés, including TSMC's N3 process capacity, HBM, DRAM, NAND, etc., pourrait further tighten supply.

3. La vitesse de croissance des revenus (ARR) et de la consommation de tokens des laboratoires d'IA

L'expansion de la commercialisation de l'IA et de l'échelle d'utilisation déterminera l'intensité de la demande finale, c'est également la variable核心 (core) qui drive la demande de calcul.

Prix à la hausse unilatérale, taux de rendement随之提升 (improving accordingly)

Dans l'ensemble, une conclusion relativement claire est : la probabilité que les prix de location des GPU continuent d'augmenter est plus élevée que celle qu'ils baissent.

Ce processus présente des caractéristiques d'auto-renforcement évidentes : lorsque les Neocloud observent un resserrement de l'offre et une hausse des prix, ils verrouillent à l'avance plus de matériel, comprimant ainsi davantage l'offre du marché et poussant les prix à continuer de monter. Cela ressemble au cycle de pénurie de GPU de 2023-2024 – à l'époque, la tension de l'offre avait permis aux OEM de réaliser une expansion significative de leurs marges, et avait entraîné une forte hausse des prix des serveurs (bien que la maturité plus élevée du marché actuel signifie que ce processus ne se reproduise pas necessarily exactly).

Dans le même temps, la nouvelle hausse des prix de location des GPU améliore également le rendement du capital investi (ROIC) des Neocloud :

D'une part, en augmentant la marge bénéficiaire des actifs déjà déployés

D'autre part, en prolongeant le cycle d'utilisation économique des GPU, permettant au capital de générer des flux de trésorerie plus longtemps

Qui sont les plus grands bénéficiaires actuels ?

Les fournisseurs de calcul qui bénéficient le plus directement actuellement sont ceux qui présentent les caractéristiques suivantes :

· Structure principalement à court terme (peut être reprixée rapidement)

· Disposent d'un important parc d'équipements H100

· Ont une nouvelle capacité de production qui sera mise en ligne prochainement

Les Neocloud avec une structure de location à court terme peuvent libérer plus rapidement les anciens contrats et les resigner à des prix plus élevés, réalisant ainsi une expansion rapide des bénéfices. Dans le même temps, les hyperscalers et Neocloud qui ont verrouillé à l'avance la capacité de calcul de next-generation (contrats pluriannuels) bénéficieront également dans les cycles futurs.

Alors la question se pose : cette fois, est-ce que ça va vraiment être « différent » ?