Malheureusement, à notre époque, plus vous travaillez avec un dévouement total et sans réserve, plus vous risquez de vous distiller rapidement en une compétence remplaçable par l'IA.

Ces derniers jours, les tendances et les médias ont été submergés par « collègue.skill ». Alors que l'affaire continuait de faire rage sur les plateformes sociales, le public s'est presque inévitablement laissé emporter par les grandes anxiétés que sont « les licenciements par l'IA », « l'exploitation capitaliste » et « l'immortalité numérique des travailleurs ».

Ces sujets sont effectivement anxiogènes, mais ce qui m'inquiète le plus, c'est la ligne de conseil d'utilisation écrite dans le document README du projet :

« La qualité des matières premières détermine la qualité de la compétence : il est recommandé de prioriser la collecte de ses longs textes écrits de manière proactive > les réponses décisionnelles > les messages quotidiens. »

Ceux qui sont les plus facilement et parfaitement distillés par le système, reproduits au pixel près, sont précisément ceux qui travaillent le plus sérieusement.

Ce sont ceux qui, à la fin de chaque projet, s'attellent encore à écrire un document de compte-rendu ; ceux qui, en cas de désaccord, sont prêts à passer une demi-heure à taper de longs textes dans la fenêtre de chat, détaillant avec franchise la logique de leur décision ; ceux qui, extrêmement responsables, confient méticuleusement tous les détails de leur travail au système.

Le sérieux, cette vertu professionnelle autrefois tant prisée, est devenu un catalyseur accélérant la transformation des travailleurs en carburant pour l'IA.

Le travailleur pressé jusqu'à la dernière goutte

Nous devons redéfinir un mot : le contexte.

Dans le langage courant, le contexte est l'arrière-plan d'une communication. Mais dans le monde de l'IA, et surtout parmi les agents IA qui prolifèrent frénétiquement, le contexte est le carburant qui fait rugir le moteur, le sang qui maintient le pouls, le seul point d'ancrage qui permet au modèle de porter un jugement précis dans le chaos.

Une IA privée de contexte, même dotée d'un nombre de paramètres impressionnant, n'est rien de plus qu'un moteur de recherche amnésique. Elle ne peut pas vous reconnaître, ne peut pas discerner les courants sous-jacents de la logique métier, et encore moins savoir quelles longues tensions et arbitrages vous avez subis sur ce réseau tissé de contraintes de ressources et de jeux de pouvoir humains lorsque vous avez pris une décision.

La raison pour laquelle « collègue.skill » a provoqué une telle onde de choc est qu'il cible, avec une froideur et une précision extrêmes, la mine qui regorge de contextes de haute qualité : les logiciels de collaboration des entreprises modernes.

Au cours des cinq dernières années, le milieu professionnel chinois a subi une transformation numérique silencieuse mais radicale. Des outils comme Feishu, DingTalk, Notion, etc., sont devenus d'immenses bases de connaissances d'entreprise.

Prenez Feishu par exemple : ByteDance a publiquement déclaré que le nombre de documents générés quotidiennement en interne est colossal. Ces caractères denses et serrés scellent fidèlement chaque remue-méninges, chaque échange houleux en réunion, et chaque compromis stratégique avalé de force par plus de cent mille employés.

Ce pouvoir de pénétration numérique dépasse de loin celui de toute époque. Il fut un temps où la connaissance avait une chaleur humaine, elle résidait dans l'esprit des anciens employés, flottait dans les conversations négligentes autour de la machine à café ; aujourd'hui, toute l'intelligence et l'expérience humaines sont forcément déshydratées, impitoyablement sédimentées dans la froide matrice de serveurs cloud.

Dans ce système, si vous n'écrivez pas de documents, votre travail ne peut pas être vu, les nouveaux collègues ne peuvent pas collaborer avec vous. Le fonctionnement efficace de l'entreprise moderne est construit sur le cycle quotidien où chaque employé « offre » son contexte au système.

Les travailleurs sérieux, pleins de diligence et de bonne volonté, exposent sans réserve leurs traces de réflexion sur ces plateformes glaciales. Ils le font pour que les engrenages de l'équipe s'emboîtent plus smoothly, pour s'efforcer de prouver leur valeur au système, pour trouver désespérément leur place dans le corps complexe de cette bête commerciale. Ils ne se livrent pas activement ; ils suivent simplement, maladroitement mais assidûment, les règles de survie du monde professionnel moderne.

Mais ce sont précisément ces contextes laissés pour la collaboration humaine qui deviennent le carburant parfait pour l'IA.

L'interface d'administration de Feishu dispose d'une fonction permettant aux super administrateurs d'exporter en masse les documents et les historiques de communication des membres. Cela signifie que les comptes-rendus de projet et les logiques décisionnelles sur lesquels vous avez passé des nuits blanches pendant trois ans ne nécessitent qu'une interface API. En quelques minutes, des tranches de votre vie de ces dernières années seront facilement empaquetées en une archive sans aucune chaleur.

Quand l'humain est réduit à une API

Avec le succès fulgurant de « collègue.skill », des dérivés extrêmement perturbants ont commencé à apparaître dans la section Issues de GitHub et sur les grandes plateformes sociales.

Quelqu'un a créé « ex.skill », essayant de nourrir l'IA avec des années de conversations WeChat passées, pour qu'elle continue à se disputer ou à être tendre avec ce ton familier ; quelqu'un a créé « crush.skill », réduisant une palpitation inaccessible à une froide simulation relationnelle, répétant sans cesse des phrases de séduction, cherchant pas à pas la solution optimale émotionnelle ; d'autres ont créé « patron paternaliste.skill », mâchant à l'avance dans l'espace numérique des discours pleins de PUA, se construisant une triste défense psychologique.

Les scénarios d'utilisation de ces compétences ont complètement dépassé le cadre de l'efficacité au travail. Il apparaît donc que, sans même nous en rendre compte, nous nous sommes habitués à brandir la logique froide réservée aux outils pour démanteler et chosifier des êtres humains vivants, en chair et en os.

Le philosophe allemand Martin Buber a proposé que la relation humaine repose fondamentalement sur deux modes distincts : « Je-Tu » et « Je-Cela ».

Dans la rencontre « Je-Tu », nous transcendons les préjugés et regardons l'autre comme un être de vie complet et digne. Ce lien est ouvert sans réserve, il est plein d'une imprévisibilité vivante, et précisément parce qu'il est sincère, il est particulièrement vulnérable ; cependant, une fois tombé dans l'ombre du « Je-Cela », l'être humain vivant est réduit à un objet qui peut être décomposé, analysé, catégorisé et étiqueté. Sous ce regard utilitariste, la seule chose qui nous importe est : « À quoi me sert cette chose ? »

L'émergence de produits comme « ex.skill » marque l'invasion complète de la rationalité instrumentale du « Je-Cela » dans le domaine le plus intime des émotions.

Dans une relation réelle, une personne est multidimensionnelle, pleine de complexités, en constante évolution avec ses contradictions et ses aspérités ; ses réactions varient en fonction du contexte concret et des interactions émotionnelles. Votre ex, au réveil le matin et après une nuit de travail tardif, pourrait réagir de manière complètement différente à la même phrase.

Mais lorsque vous distillez une personne en une compétence, ce que vous extrayez n'est que les résidus fonctionnels qui vous étaient « utiles », qui pouvaient « produire un effet » dans ce lien spécifique. Et la personne originellement chaleureuse, avec ses propres joies et peines, est complètement vidée de son âme lors de cette cruelle purification, aliénée en une « interface fonctionnelle » que vous pouvez brancher et débrancher à volonté, appeler à loisir.

Il faut admettre que l'IA n'a pas inventé de toutes pièces cette froideur glaçante. Avant l'IA, nous étions déjà habitués à étiqueter les autres, à peser avec précision la « valeur émotionnelle » et le « poids relationnel » de chaque lien. Par exemple, nous quantifions les conditions des personnes en tableaux sur le marché de la rencontre ; nous classons les collègues en « ceux qui bossent » et « ceux qui glandent » au travail. L'IA ne fait que rendre explicite cette extraction fonctionnelle, auparavant implicite, entre les êtres humains.

L'humain est aplati, il ne reste que la facette « utile pour moi ».

Patine électronique

En 1958, le philosophe britannique d'origine hongroise Michael Polanyi a publié « Personal Knowledge ». Dans ce livre, il a proposé un concept percutant : la connaissance tacite.

Polanyi a une célèbre maxime : « Nous en savons toujours plus que nous ne pouvons en dire. »

Il prend l'exemple d'apprendre à faire du vélo. Un cycliste chevronné qui chevauche le vent peut parfaitement maîtriser l'équilibre à chaque inclinaison, mais il ne peut pas décrire avec précision, à l'aide de formules physiques desséchées ou de mots pâles, l'intuition subtile du corps à ce moment-là pour un débutant. Il sait comment faire, mais il ne peut pas l'exprimer. Cette connaissance qui ne peut être codée, qui ne peut être verbalisée, est la connaissance tacite.

Le monde professionnel regorge de ce type de connaissances. Un ingénieur senior qui recherche une panne système peut localiser le problème d'un coup d'œil aux logs, mais il aura du mal à documenter cette « intuition » bâtie sur des milliers d'essais et d'erreurs ; un bon commercial qui fait soudainement silence à la table des négociations, le timing et la pression de ce silence, aucun manuel de vente ne peut le consigner ; un RH expérimenté lors d'un entretien, peut détecter des exaggerations sur un CV rien qu'à travers une demi-seconde d'évitement du regard du candidat.

Ce que « collègue.skill » peut extraire, ce sont seulement les connaissances explicites, déjà écrites, déjà dites. Il peut capturer vos documents de compte-rendu, mais pas les dilemmes que vous avez traversés en les écrivant ; il peut copier vos réponses décisionnelles, mais pas l'intuition qui a guidé votre décision.

Ce que le système distille, ce n'est toujours que l'ombre d'une personne.

Si l'histoire s'arrêtait là, ce ne serait qu'une énième imitation maladroite de l'humanité par la technologie.

Mais lorsqu'une personne est distillée en une compétence, cette compétence ne reste pas statique. Elle sera utilisée pour répondre à des e-mails, écrire de nouveaux documents, prendre de nouvelles décisions. Autrement dit, ces ombres générées par l'IA commencent à produire de nouveaux contextes.

Et ces contextes générés par l'IA seront à leur tour sédimentés dans Feishu et DingTalk, devenant la matière première d'entraînement pour le prochain cycle de distillation.

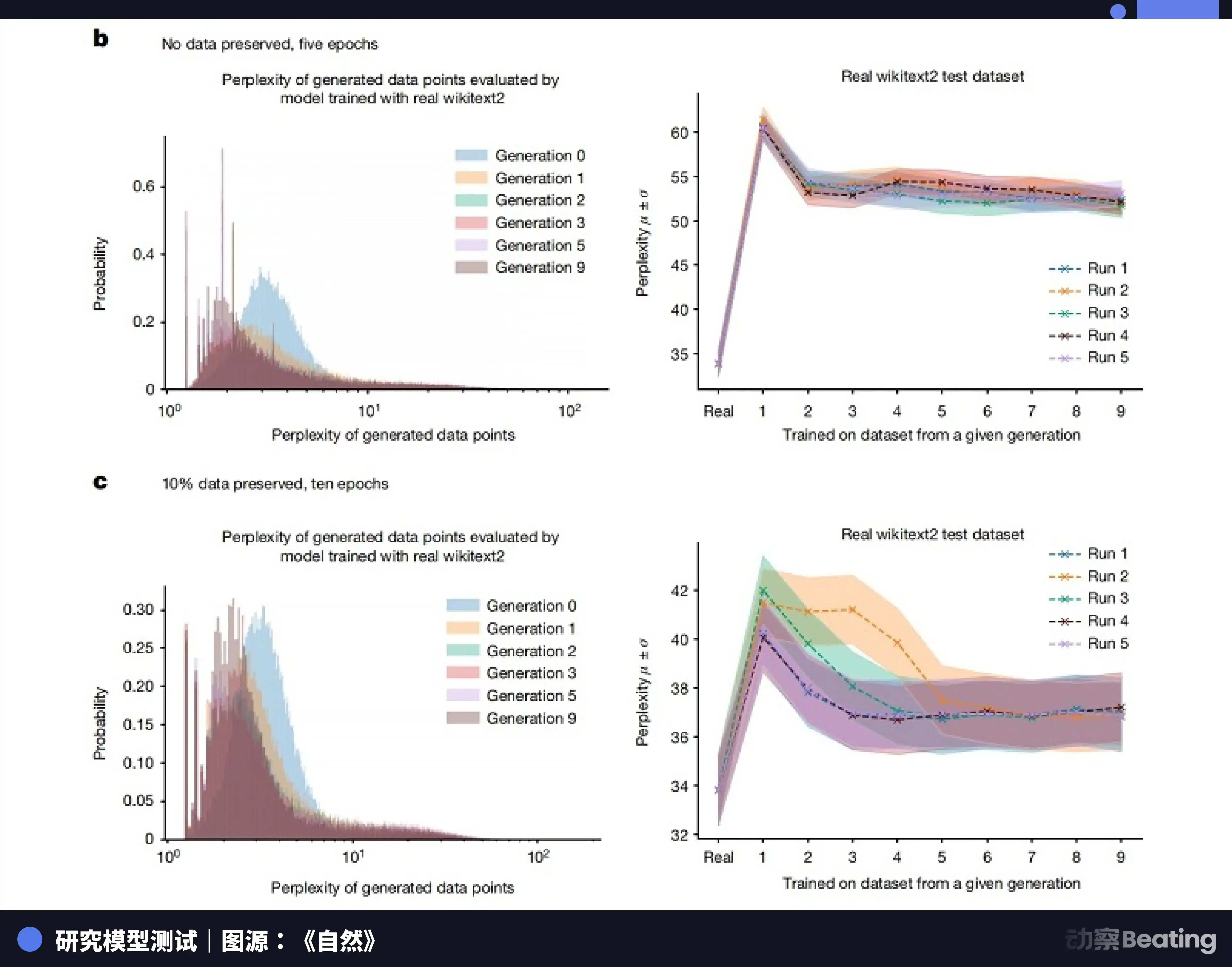

Dès 2023, une équipe de recherche conjointe des universités d'Oxford et de Cambridge a publié un article sur l'« effondrement des modèles » (model collapse). Les recherches montrent que lorsque des modèles d'IA utilisent des données générées par d'autres IA pour leur entraînement itératif, la distribution des données devient de plus en plus étroite. Les traits humains rares, marginaux, mais extrêmement réels, sont rapidement effacés. Après seulement quelques générations d'entraînement sur des données synthétiques, le modèle oublie complètement les données humaines réelles, complexes et de longue traîne, et produit instead un contenu extrêmement médiocre et homogène.

Nature a également publié en 2024 un article de recherche indiquant que l'utilisation d'ensembles de données générés par l'IA pour entraîner les futures générations de modèles d'apprentissage automatique polluerait gravement leur output.

C'est comme ces images memes qui circulent sur Internet, à l'origine une capture d'écran haute définition, partagée, compressée, re-partagée d'innombrables fois. Chaque transmission fait perdre des pixels, ajoute du bruit. Finalement, l'image devient floue, recouverte d'une « patine électronique ».

Lorsque les contextes humains réels, porteurs de connaissances tacites, sont épuisés, et que le système ne peut s'entraîner qu'avec des ombres patinées, que restera-t-il à la fin ?

Qui efface nos traces

Il ne restera que des paroles correctes mais vides de sens.

Lorsque la rivière de la connaissance s'assèche en un perpétuel recyclage et mastication de l'IA par elle-même, tout ce que le système produira deviendra inévitablement extrêmement standard, extrêmement sûr, mais désespérément creux. Vous verrez d'innombrables rapports hebdomadaires parfaitement structurés, d'innombrables e-mails impeccables, mais sans aucune trace de vie, sans aucune insight véritablement valuable.

Cette grande débâcle de la connaissance n'est pas due à un cerveau humain devenu stupide. La vraie tristesse réside dans le fait que nous externalisons le droit de penser et la responsabilité de laisser un contexte à nos propres ombres.

Quelques jours après le buzz de « collègue.skill », un projet nommé « anti-distill » est apparu discrètement sur GitHub.

L'auteur de ce projet n'a pas tenté d'attaquer les grands modèles, ni n'a écrit de manifeste grandiose. Il a simplement fourni un petit outil pour aider les travailleurs à générer automatiquement, dans Feishu ou DingTalk, de longs textes apparemment raisonnables mais en réalité pleins de bruit logique et inefficaces.

Son but est simple : cacher ses connaissances clés avant d'être distillé par le système. Puisque le système aime capturer les « longs textes écrits de manière proactive », nourrissons-le avec un tas de charabia sans aucune nutrition.

Ce projet n'a pas connu le succès fulgurant de « collègue.skill », il peut même sembler minuscule et impuissant. Combattre le feu par le feu, c'est essentiellement jouer selon les règles du jeu définies par le capital et la technologie. Cela ne change pas la tendance générale où le système dépend de plus en plus de l'IA et ignore de plus en plus les vraies personnes.

Mais cela n'empêche pas ce projet d'être la scène la plus tragiquement poétique et profondément métaphorique de tout cet absurde spectacle.

Nous nous efforçons extrêmement de laisser des traces dans le système, d'écrire des documents détaillés, de donner des décisions réfléchies, essayant de prouver que nous avons existé, que nous avions de la valeur dans cette immense machine de l'entreprise moderne. Sans savoir que ces traces, laissées avec tant de sérieux, finiront par devenir la gomme qui nous efface.

Mais, vu sous un autre angle, ce n'est pas nécessairement une impasse totale.

Parce que cette gomme n'efface toujours que « le vous du passé ». Une compétence empaquetée dans un fichier, quelle que soit la finesse de sa logique de capture, n'est par essence qu'un instantané figé. Il est bloqué à la seconde de son exportation, ne pouvant tourner en rond que selon des processus et une logique prédéfinis, avec une nourriture obsolète. Il n'a pas l'instinct de faire face au chaos inconnu, et encore moins la capacité d'évoluer par lui-même grâce aux échecs du monde réel.

Lorsque nous confions ces expériences hautement standardisées et figées, nous nous libérons également les mains. Tant que nous continuons à explorer vers l'extérieur, à briser et reconstruire constamment nos frontières cognitives, l'ombre restée dans le cloud ne pourra que nous suivre à la trace, toujours en retard d'un pas.

L'humain est un algorithme en flux.