Entre 4 et 15 milliards de dollars, ce qui se joue n'est pas une courbe de croissance, mais une auto-subversion du modèle commercial.

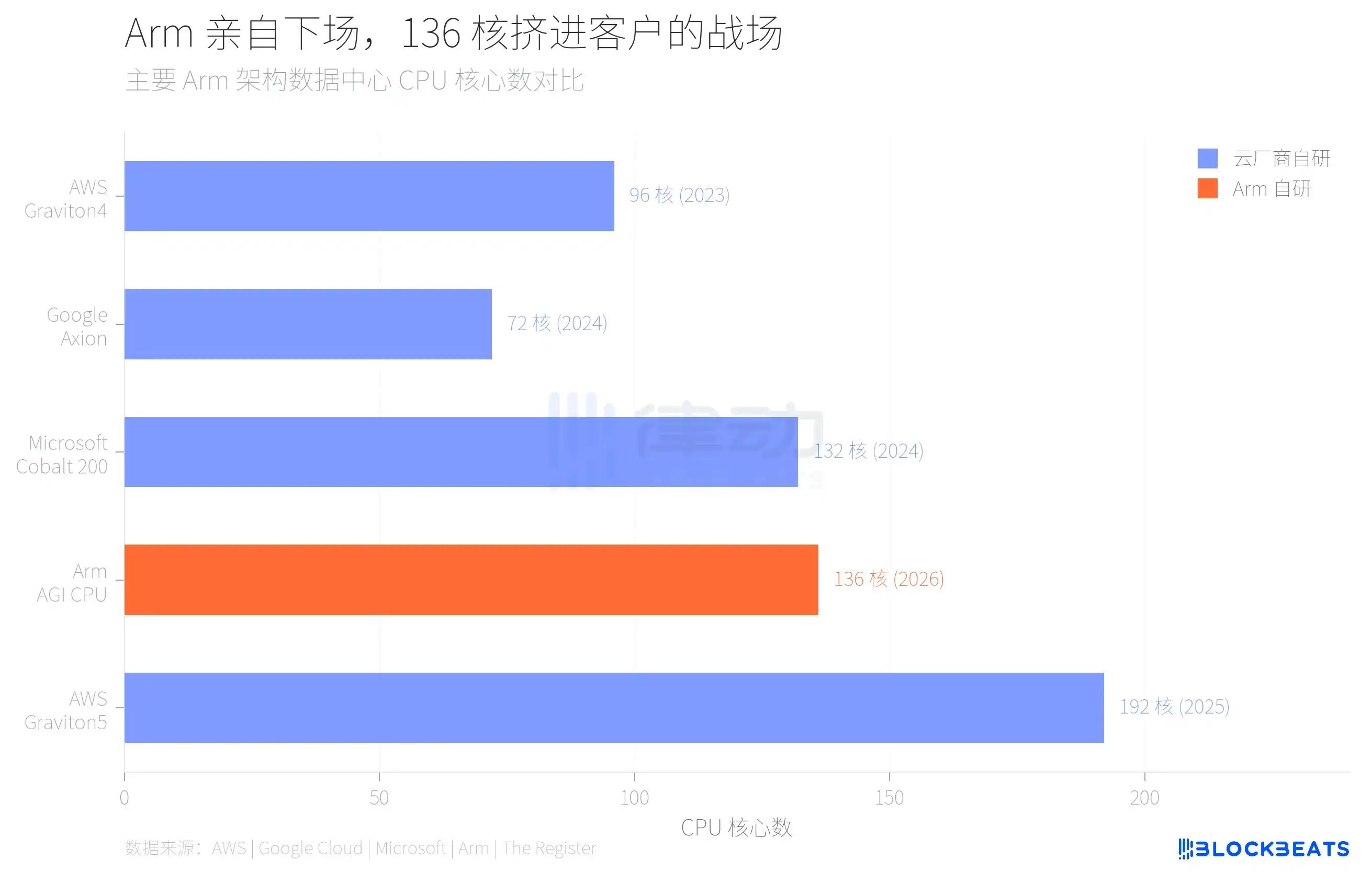

Le 24 mars, Arm a dévoilé à San Francisco son premier CPU de centre de données conçu en interne en 35 ans d'histoire. Cette puce nommée AGI CPU intègre 136 cœurs Neoverse V3, fabriquée en procédé 3nm de TSMC, avec une TDP de 300W. Meta en est le premier client, avec un déploiement à grande échelle prévu dans l'année. OpenAI, Cerebras, Cloudflare, SAP et SK Telecom ont également été annoncés comme partenaires.

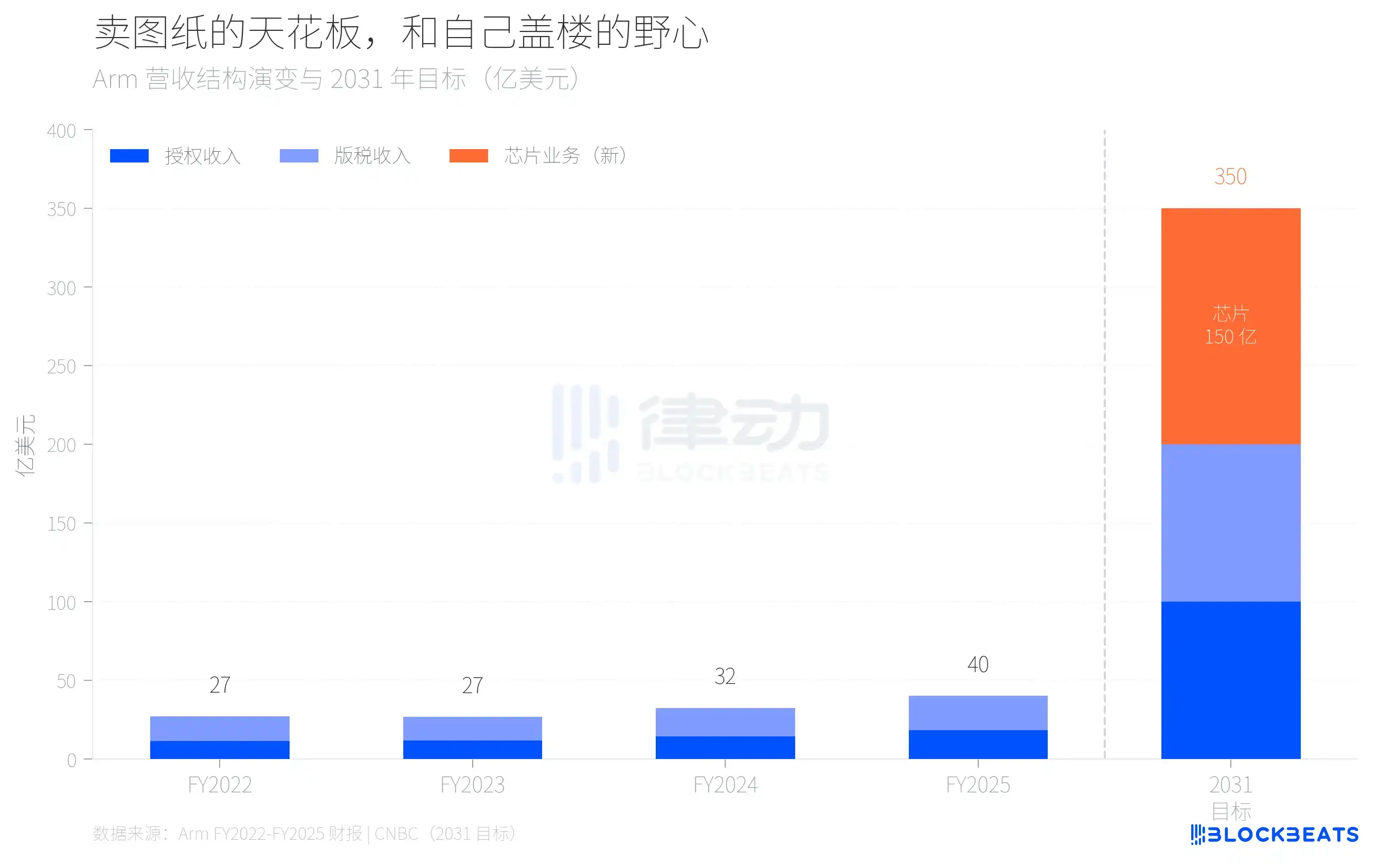

Le PDG d'Arm, Rene Haas, a présenté lors de l'événement un objectif chiffré : d'ici 2031, le chiffre d'affaires de l'activité puces doit atteindre 15 milliards de dollars annuels, le chiffre d'affaires total de l'entreprise 25 milliards de dollars, et le bénéfice par action 9 dollars.

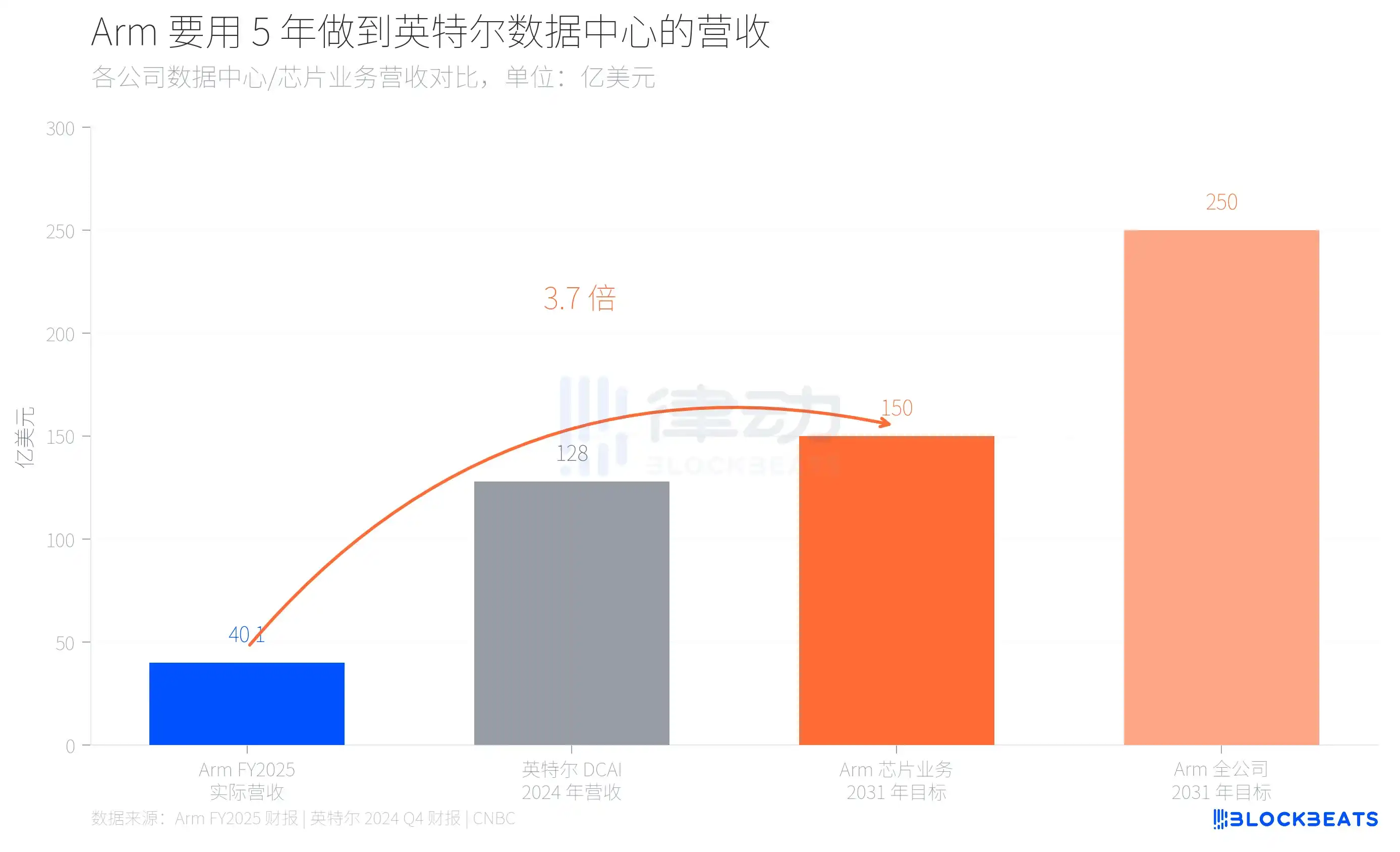

Que signifient ces chiffres ? Le chiffre d'affaires total d'Arm pour l'exercice FY2025 (clos en mars 2025) est de 4,007 milliards de dollars. Selon les données annuelles, cela comprend 1,839 milliard de dollars de revenus de licences et 2,168 milliards de dollars de redevances, avec une marge brute de 97 %. En d'autres termes, une entreprise réalisant 4 milliards de dollars de revenus annuels vise à créer, en seulement 5 ans et avec une nouvelle activité, une taille proche du département Data Center entier d'Intel. Selon le rapport financier Q4 2024 d'Intel, son département DCAI (Data Center and AI) a généré 12,8 milliards de dollars de revenus sur l'année 2024.

Derrière ce bond de 4 à 15 milliards, un multiplicateur de 3,7, se cache la tentative d'Arm de passer d'une entreprise purement IP à un hybride vendant à la fois les plans et le produit fini. Cela n'a pas de précédent dans l'industrie des semi-conducteurs.

Pourquoi Arm prend-t-il ce risque ? La réponse se trouve dans sa liste de clients.

Au cours des trois dernières années, les plus grands clients d'Arm dans le数据中心 ont tous fait la même chose. Selon les données publiques d'AWS, Amazon a migré plus de 50 % de la puissance de calcul EC2 vers ses puces Graviton auto-conçues, la dernière Graviton5 atteignant 192 cœurs. Google Cloud a indiqué que plus de 30 000 applications internes ont été migrées sur sa puce Axion, avec une efficacité énergétique améliorée de 80 %. Le Cobalt 200 de Microsoft est également basé sur l'architecture Arm Neoverse, en procédé 3nm de TSMC, avec 132 cœurs.

Ces cloud providers utilisent tous une licence d'architecture Arm, mais conçoivent, fabriquent et déploient eux-mêmes leurs puces. Arm y gagne des frais de licence et des redevances, pas les bénéfices de la vente des puces. Alors que de plus en plus de besoins en calcul sont absorbés par ces puces maison, le plafond de revenus d'Arm dans le数据中心 devient de plus en plus net.

En examinant la structure des revenus d'Arm sur les quatre dernières années, ce plafond se dessine plus clairement. Selon les rapports annuels d'Arm, de FY2022 à FY2025, le chiffre d'affaires total est passé de 2,7 à 4,0 milliards de dollars, avec une croissance annuelle moyenne d'environ 14 %. Les redevances sont passées de 1,562 à 2,168 milliards de dollars, et les revenus de licences de 1,141 à 1,839 milliard de dollars. La croissance des redevances a déjà ralenti à environ 20 % ces dernières années, et une grande partie de ces 20 % provient de la transition vers l'architecture Armv9 dans le mobile, et non du数据中心.

En extrapolant cette croissance, même si les revenus de licences et de redevances maintiennent une croissance annuelle d'environ 20 %, on n'atteindrait qu'environ 10 milliards de dollars d'ici 2031. Les 15 milliards manquants doivent provenir d'une activité qui n'existe pas aujourd'hui. C'est la logique arithmétique qui pousse Arm à fabriquer ses propres puces.

Le choix d'Arm de fabriquer ses propres puces revient essentiellement à concurrencer ses propres clients. Une entreprise qui vendait des plans de construction se met à construire elle-même des immeubles, alors que ses clients qui achetaient les plans construisent déjà depuis plusieurs années.

C'est le véritable contexte du CPU AGI 136 cœurs. Selon The Register, cette puce a une fréquence de base de 3,2 GHz, pouvant monter à 3,7 GHz, 12 canaux de mémoire DDR5, une bande passante de 6 GB/s par cœur, 96 voies PCIe 6.0, et supporte CXL 3.0. Arm le positionne comme « la base de calcul de l'ère du cloud IA agentique », se spécialisant dans l'ordonnancement des tâches côté CPU et la gestion des flux de données pour l'inférence IA, plutôt que de concurrencer directement les GPU.

Le rythme de changement des parts de marché est également révélateur. Selon les estimations d'Omdia, en 2025, la part des serveurs à architecture Arm dans les expéditions mondiales est d'environ 21 %, avec une croissance de 70 %. Mais au sein des超大规模数据中心, cette proportion approche déjà les 50 %. Le monopole de 40 ans d'x86 ne s'effondre pas, il est remplacé puce par puce.

Le risque pour Arm ne réside pas dans la technologie, mais dans les relations. La volonté de Meta d'être le premier client s'explique en partie parce que Meta n'a pas de projet de puce auto-conçue aussi mature qu'Amazon ou Google. Mais comment Amazon, Google et Microsoft vont-ils percevoir cela ? Un fournisseur qui commence à vous faire concurrence, lui confieriez-vous encore la licence d'architecture la plus cruciale ?

Le pari d'Arm est que la croissance globale du gâteau数据中心 sera plus rapide que la détérioration des relations clients. Rene Haas croit visiblement que la demande supplémentaire en CPU à l'ère de l'IA est suffisamment importante pour que les puces maison et les licences d'architecture puissent coexister. L'objectif de 15 milliards de dollars est le prix de cette conviction.

35 ans à vendre des plans, pour la première fois, il construit lui-même. Les plans se vendent toujours, la construction aussi, reste à voir s'il y aura assez de place sur le même terrain.