Il y a quelques jours, OpenAI a officiellement lancé le nouveau grand modèle GPT-5.4-Cyber. Comme beaucoup d'internautes, ce modèle nous a également donné un fort sentiment de déjà-vu.

Ce nouveau modèle cible presque exactement le même public d'utilisateurs, les mêmes scénarios d'application et même les stratégies de communication que le Claude Mythos publié par Anthropic il y a quelques jours. Cette situation de « combat rapproché » est devenue évidente au point de ne plus être dissimulée. Même le New York Times a souligné sans détour dans le titre de son dernier reportage : « Comme Anthropic, OpenAI... ».

Cette tendance à l'homogénéisation ne se limite pas aux modèles de base les plus fondamentaux. Si vous portez votre regard sur la série de produits récemment publiés par ces deux entreprises, vous constaterez qu'elles deviennent le miroir l'une de l'autre !

Sous les projecteurs invisibles du marché des capitaux, cette convergence est encore plus évidente. Actuellement, les valorisations des deux entreprises sur le marché secondaire sont très serrées, Anthropic dépassant même légèrement OpenAI récemment grâce à ses progrès fulgurants sur le marché des entreprises. L'odorat des capitaux est le plus fin : à leurs yeux, ces deux licornes sont en train de développer les mêmes cornes.

Il semble que l'homogénéisation des grands modèles sous-jacents conduise inévitablement à une convergence des applications de niveau supérieur.

Aujourd'hui, ce dont je souhaite discuter avec vous, ce sont précisément deux outils phares représentant l'état de l'art actuel de l'assistance à la programmation par IA : Codex d'OpenAI et Claude Code d'Anthropic. Comment, après avoir suivi des chemins divergents, en sont-ils arrivés à se ressembler autant ?

De chemins divergents à une destination commune : l'histoire de l'évolution des deux géants

Remontons le temps de quelques années : Codex et Claude Code étaient le produit de deux philosophies technologiques totalement différentes.

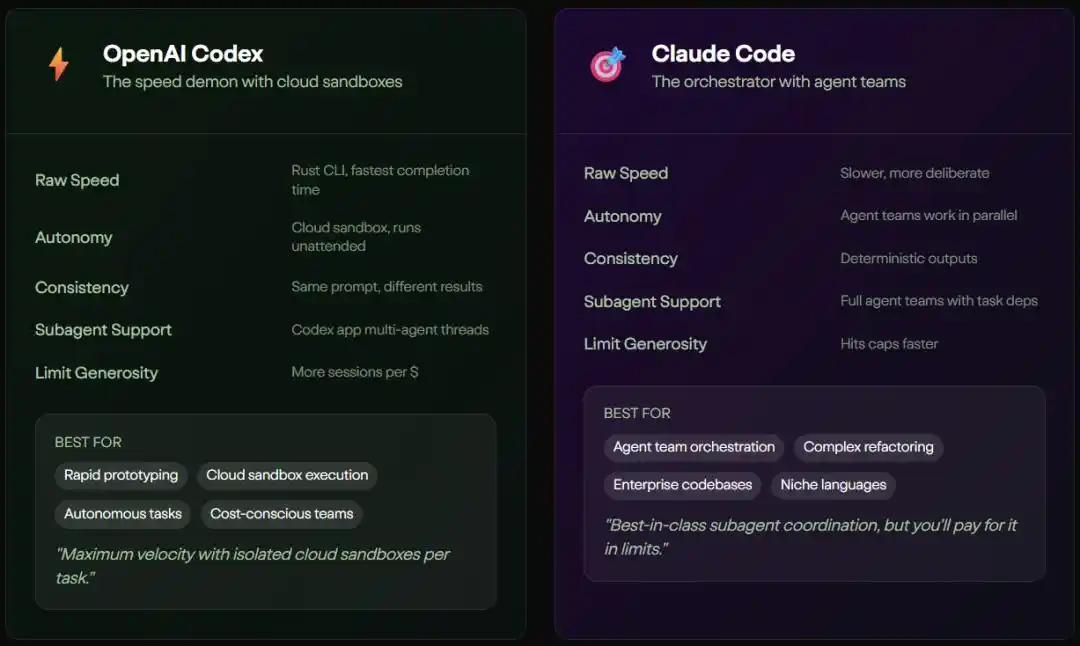

La logique sous-jacente de Codex était « Rien ne vaut la vitesse ». Il ressemblait à un développeur senior avec 5 ans d'expérience qui vous suivait, toujours prêt à compléter votre code.

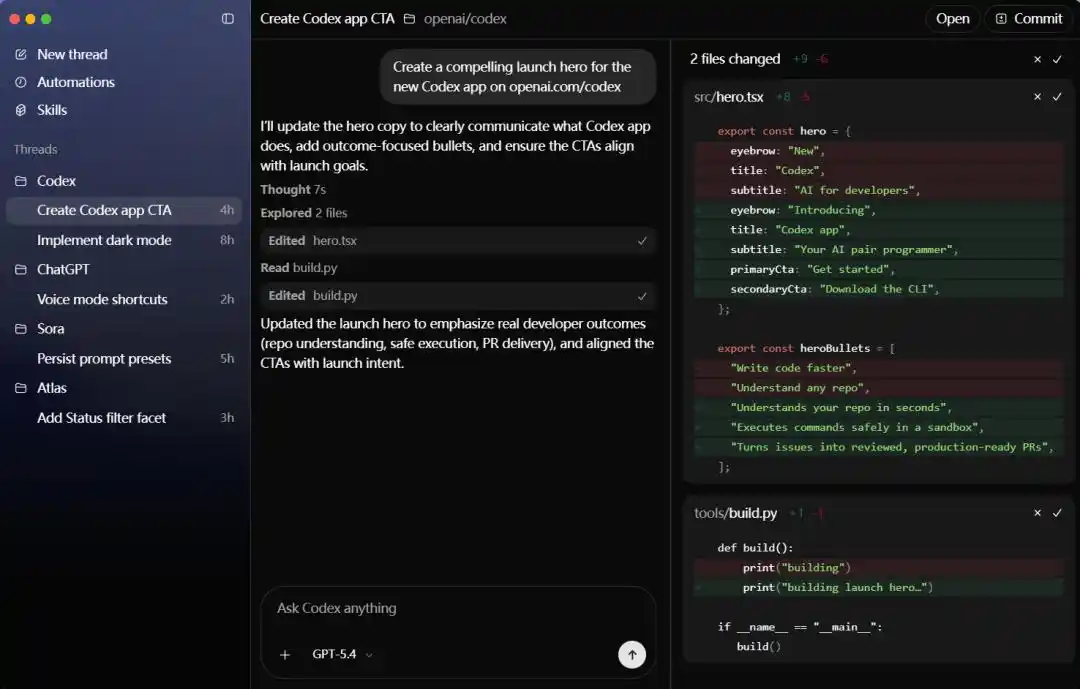

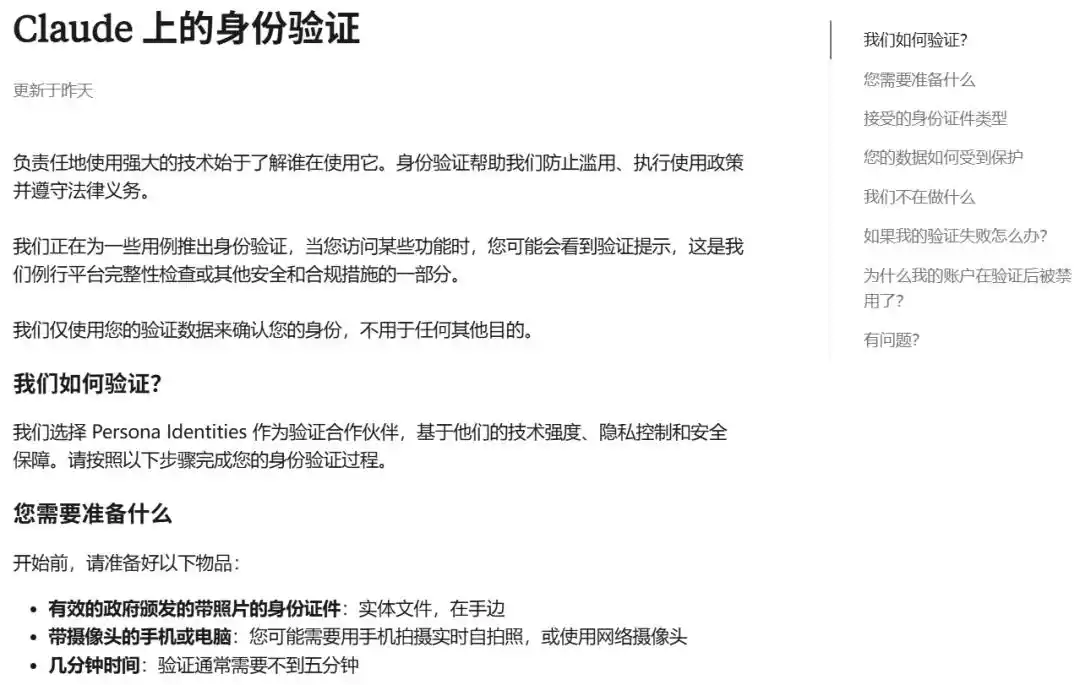

Dans la conception d'OpenAI, Codex était un agent intelligent terminal, léger et très interactif, axé sur l'itération rapide et la programmation interactive. Sa vitesse d'exécution était extrêmement rapide, atteignant un débit de 1000 tokens par seconde avec le support matériel Cerebras WSE-3. Dans le flux de travail concret, Codex offrait trois modes d'approbation clairs : suggestion, édition automatique et entièrement automatique, gardant toujours le développeur dans la boucle. Cette conception correspondait parfaitement aux développeurs geeks qui avaient besoin de construire rapidement des prototypes et de gérer des interactions à haute fréquence.

En revanche, Claude Code, dès sa naissance, possédait un attribut « d'architecte » froid et retenu.

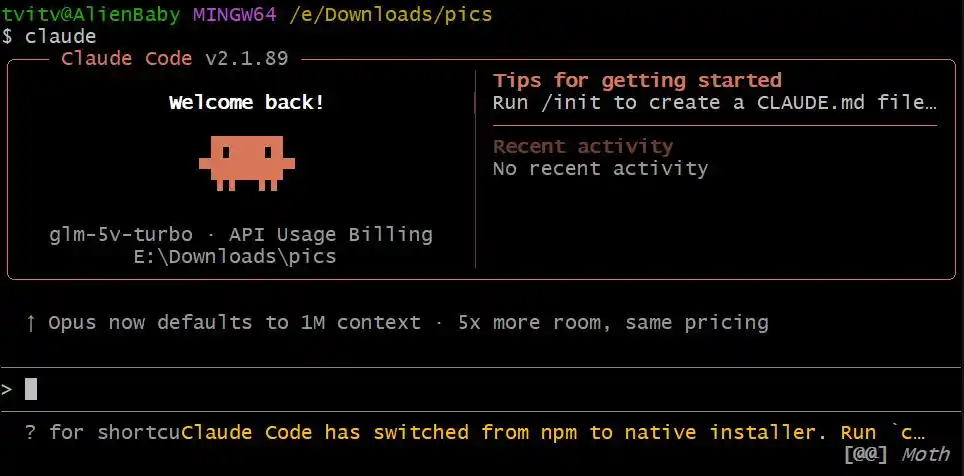

Anthropic lui a injecté les gènes pour traiter des tâches extrêmement complexes. Il dépendait d'une fenêtre de contexte massive allant jusqu'à 1 million de tokens, ainsi que d'une technologie unique de « compression » pour permettre des conversations infinies. Le credo de Claude Code était « Maîtrise globale, planifier avant d'agir ». Avant d'exécuter toute action, il utilisait d'abord la technologie de recherche d'agents pour comprendre parfaitement les tenants et aboutissants de l'ensemble du dépôt de code, puis coordonnait la modification cohérente de multiples fichiers. Pour les tâches de refactorisation de niveau entreprise impliquant la migration de dizaines de milliers de lignes de code, Claude Code a fait preuve d'une domination impressionnante.

Cependant, avec le temps et la descente continue des scénarios d'application, ces deux outils au caractère si différent ont commencé à copier leurs devoirs mutuellement.

Source : MorphLLM

Lors du traitement de projets complexes, le plus grand goulot d'étranglement auquel est confronté un modèle d'IA monolithique est la pollution du contexte. Vous demandez à l'IA de refactoriser un module d'authentification, après avoir lu 40 fichiers, elle oublie souvent le motif de conception du premier fichier. Pour résoudre ce point sensible, les deux entreprises ont apporté une réponse presque identique : attribuer une fenêtre de contexte indépendante à chaque sous-tâche.

OpenAI a rapidement lancé une nouvelle application de bureau macOS, isolant les tâches par projet et les exécutant indépendamment dans des sandbox cloud. Anthropic a quant à lui lancé une architecture d'équipe d'agents, permettant aux développeurs de dériver plusieurs sous-agents, partageant la liste des tâches et les dépendances, et travaillant en parallèle dans leurs propres fenêtres indépendantes. Vous constaterez que, que cela s'appelle « sandbox cloud » ou « équipe d'agents », leurs concepts fondamentaux de mise en œuvre technique se sont complètement superposés.

Sur la feuille de résultats des tests de référence, ils présentent également un équilibre subtil. GPT-5.3-Codex a pris la tête avec un score de 77,3 % dans la tâche terminale Terminal-Bench 2.0. Claude Code a quant à lui obtenu un score de 80,8 % dans le classement complexe SWE-bench Verified. Ils ont tous deux poussé à l'extrême leurs points forts, tout en s'efforçant de combler leurs lacunes.

Effet OpenClaw : la main invisible qui abat les murs

Si la stratégie interne des deux entreprises détermine la cause interne de leur homogénéisation, alors la pression de l'ensemble de l'écosystème open source est une force externe incontournable. Ici, nous devons mentionner l'impact profond qu'OpenClaw a eu sur l'ensemble du secteur des outils de programmation IA.

En tant que framework de flux de travail lancé par la communauté open source, l'émergence d'OpenClaw peut être considérée comme ayant abattu les murs d'écosystème soigneusement construits par les géants. Il a standardisé le processus d'interaction entre les grands modèles et la chaîne d'outils terminale locale. Autrefois, la façon de faire appel élégamment à un commit Git, d'exécuter en toute sécurité des scripts de test dans un sandbox, de procéder à une validation par raisonnement en plusieurs étapes, tout cela constituait les « technologies noires » propriétaires dont Codex et Claude Code étaient si fiers.

Mais OpenClaw a abstrait ces flux en protocoles généraux. Cela signifie que les développeurs n'ont plus besoin d'être liés à une plateforme spécifique pour un mode de collaboration particulier. La frénésie de la communauté open source a fait de la standardisation un flux irréversible. Face à cette situation, OpenAI et Anthropic ont dû abaisser leur position pour se conformer à cette norme ouverte.

Lorsque les barrières technologiques sous-jacentes sont nivelées par des forces open source comme OpenClaw, lorsque toutes les fonctionnalités avancées deviennent la configuration standard de l'industrie, la seule issue pour Codex et Claude Code est de se livrer à une concurrence sans fin au niveau de l'expérience utilisateur la plus infime. C'est aussi pourquoi nous avons l'impression qu'ils se ressemblent de plus en plus, car dans un framework standardisé, la solution optimale n'est souvent qu'une seule - comme une évolution convergente en biologie.

Codex rattrape Claude Code

Bien que Claude Code et Codex soient sur la voie d'une évolution convergente, des différences subsistent entre les deux, et Codex est même préféré par les développeurs à certains égards.

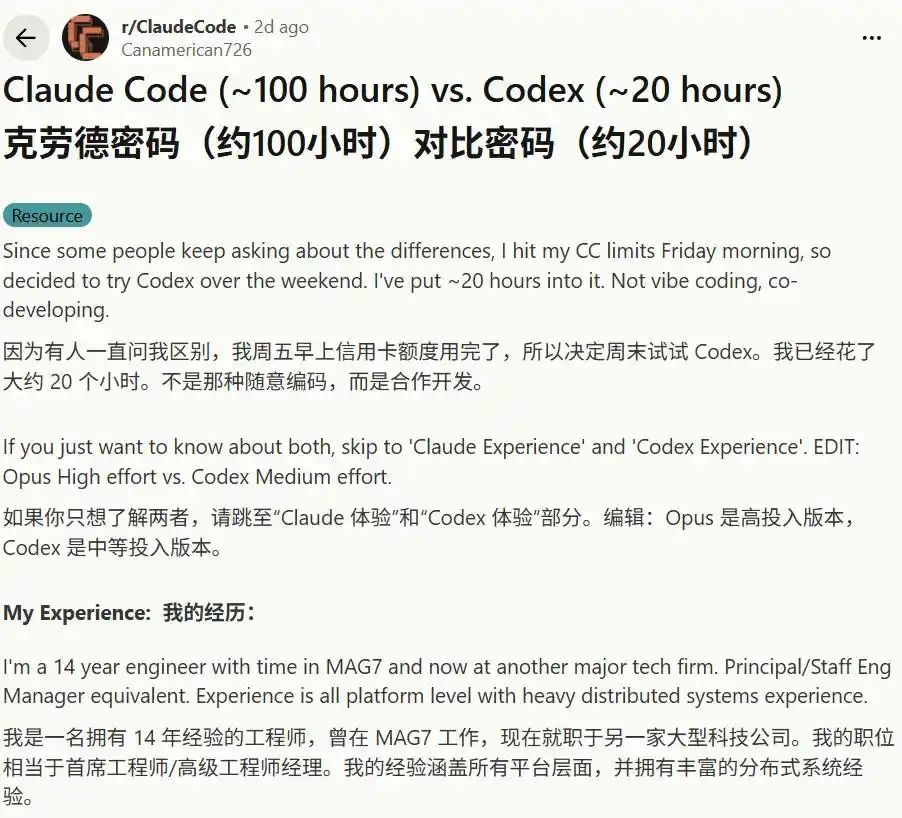

Il y a deux jours, sur la communauté r/ClaudeCode, un ingénieur senior u/Canamerican726, possédant 14 ans d'expérience et ayant travaillé dans des géants technologiques, a partagé une évaluation extrêmement pointue.

Concrètement, dans un projet complexe contenant 80 000 lignes de code, il a consacré 100 heures à utiliser Claude Code et 20 heures à utiliser Codex.

De son point de vue, utiliser Claude Code, c'était comme superviser un ingénieur poursuivi par une date limite, il sprinte extrêmement vite, mais ignore souvent les spécifications écrites par le développeur dans CLAUDE.md, et aime empiler du code dans les fichiers existants pour terminer la tâche, manquant de réflexion sur la refactorisation.

En comparaison, Codex lui donnait l'impression d'être un vétéran calme avec 5 à 6 ans d'expérience. Sa vitesse de traitement était 3 à 4 fois plus lente, mais il s'arrêtait activement en cours de route pour réfléchir et refactoriser le code, et respectait strictement les limites des instructions. Ce haut degré d'autonomie a permis à cet ingénieur de lui confier directement des tâches et de vaquer à autres occupations en toute tranquillité.

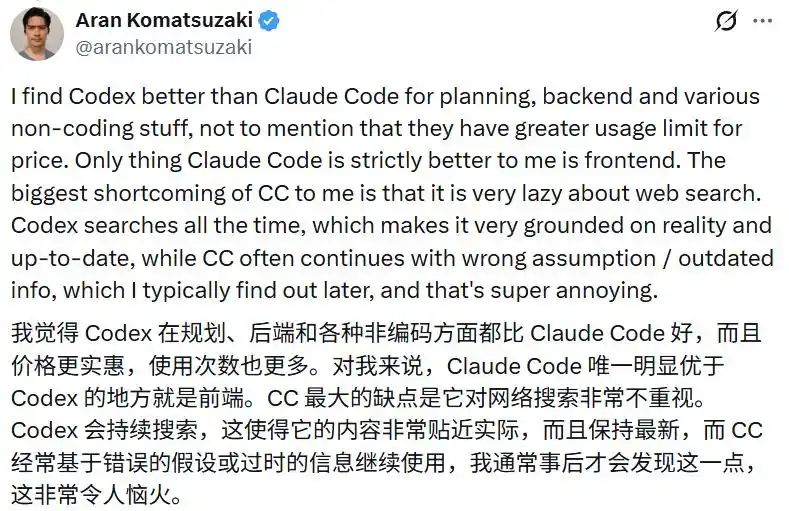

La même opinion est apparue sur X et d'autres réseaux sociaux. Le chercheur Aran Komatsuzaki, partageant sa propre expérience, a mentionné que Claude Code conservait un avantage dans le domaine frontal (front-end), mais qu'en matière de planification back-end et de maintien des informations à jour, Codex, qui fait un usage intensif de la recherche sur le Web, était manifestement plus solide.

Les commentaires étaient remplis de leçons tirées de scénarios métier réels. Un développeur a souligné avec une grande acuité que les modèles basés sur Opus, bien que rapides, avaient tendance à accumuler une énorme « dette de nettoyage de code » dans les projets, tandis que Codex, plus lent, nettoie en même temps qu'il avance. J'ai même vu des utilisateurs résumer une règle de survie, suggérant de lancer immédiatement une nouvelle session lorsque l'utilisation de la fenêtre de contexte atteint 70 %, sinon il était très facile de recevoir un bug caché offert par le système.

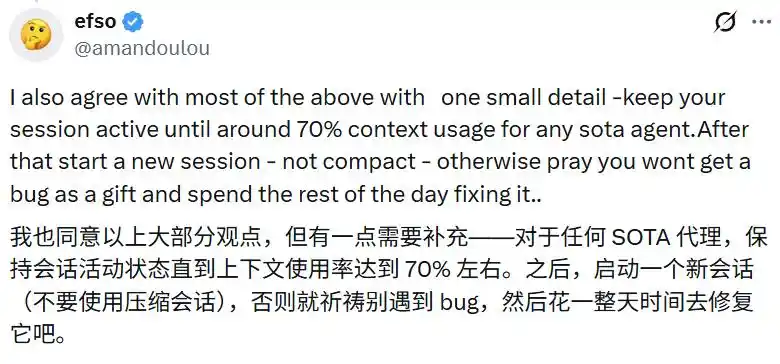

Ces retours véridiques de première ligne montrent clairement que lorsque les capacités des deux outils légendaires se chevauchent de plus en plus, ce qui détermine l'allégeance finale des développeurs, ce sont souvent ces minuscules écarts d'expérience liés au « coût de correction » et à « l'effort mental de maintenance », bien sûr, les utilisateurs chinois rencontrent encore quelques difficultés particulières, comme :

Reflexion froide : la bataille sourde de l'écosystème derrière l'homogénéisation

Bien sûr, les avantages et inconvénients de Codex et Claude Code dépendent aussi des développeurs eux-mêmes, ainsi que de leurs propres capacités, comme le résume le rapport d'évaluation de u/Canamerican726 mentionné ci-dessus : Si vous ne comprenez pas l'ingénierie logicielle, ces deux outils produiront de mauvais résultats, l'outil n'est pas équivalent à la compétence.

Cette phrase perce une certaine illusion entretenue depuis longtemps par les outils de programmation IA. Nous avions cru qu'avec un assistant IA suffisamment puissant, même un Vobe Coder sans aucune base pourrait créer à lui seul une application de niveau entreprise. Mais la réalité est que Claude Code a besoin d'un « pilote » extrêmement concentré et compétent, sinon il risque de se perdre facilement dans l'immensité du dépôt de code. Codex, bien que plus indépendant, a également besoin que le développeur fournisse un contexte système précis pour tirer le meilleur parti de son utilité.

Alors, aujourd'hui, alors que les capacités des outils sont hautement homogènes, où se situe exactement le fossé concurrentiel (moat) de ces deux entreprises ?

La réponse se cache dans les fastidieux états financiers et les stratégies de tarification. Pour la même tâche, le nombre de tokens consommés par Claude Code est souvent 3 à 4 fois supérieur à celui de Codex. Le coût d'utilisation est plus élevé. Pour les équipes d'entreprise, utiliser Claude Code coûte entre 100 et 200 dollars par mois et par développeur. Codex, quant à lui, intègre ses capacités dans des formules d'abonnement plus abordables et a accumulé un large base d'utilisateurs grâce à la vaste communauté GitHub.

Source : MorphLLM

L'ambition d'Anthropic est d'intégrer profondément Claude Code dans les flux de travail des géants technologiques qui ne manquent pas d'argent. Par exemple, Stripe a fait utiliser Claude Code à 1370 ingénieurs pour terminer en 4 jours une migration de code interlangage qui aurait normalement nécessité plusieurs semaines de travail pour 10 personnes. La société Ramp l'a même utilisé pour réduire de 80 % le temps de réponse aux incidents. OpenAI, quant à lui, grâce à son taux de pénétration écologique omniprésent, a fait de Codex le choix par défaut de nombreux développeurs ordinaires.

Ce n'est plus une simple course technologique, mais une guerre d'usure concernant le verrouillage de l'écosystème, la stratégie de prix et la refonte des habitudes des utilisateurs.

Le carrefour des développeurs

En regardant l'évolution technologique de cette dernière année, le lancement de GPT-5.4-Cyber n'est qu'une minuscule annotation dans cette longue bataille. Le fait que Codex et Claude Code tendent vers « un même visage » marque l'entrée des outils de programmation IA dans une phase de production industrielle mature et ennuyeuse, après une phase de test initiale pleine de variantes et de curiosité.

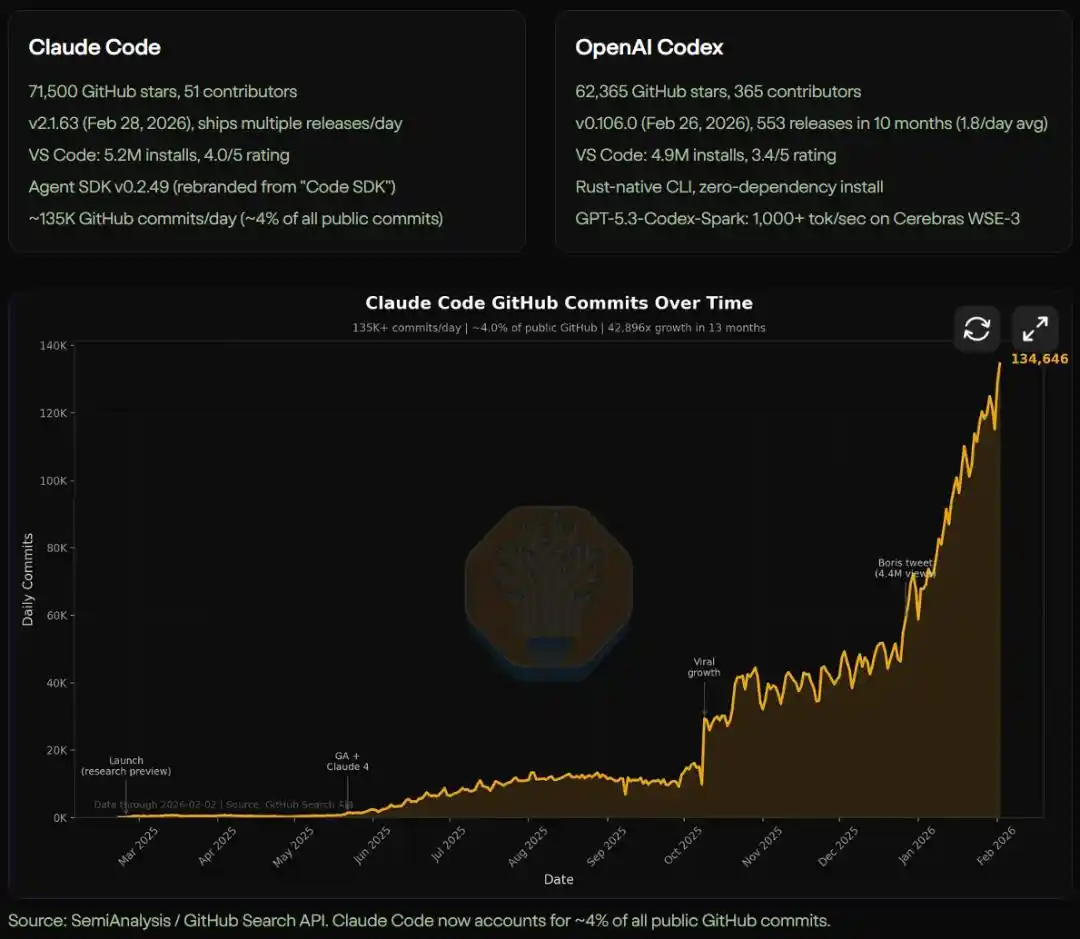

Actuellement, Claude Code génère automatiquement 135 000 commits GitHub par jour, ce chiffre représentant déjà 4 % du volume total des commits publics sur Internet. Nous pouvons prévoir que dans un avenir proche, la majorité du code standard, des cas de test de base et des refactorisations de code conventionnelles seront accomplis en silence en arrière-plan par ces agents IA qui se ressemblent de plus en plus.

Source : MorphLLM & SemiAnalysis / GitHub Search API

Face à deux super-outils aux capacités infiniment convergentes et aux expériences mutuellement imitées, quelle est la valeur fondamentale qui nous reste, nous, développeurs humains ? Peut-être que la période des bénéfices de l'outil touche à sa fin. Lorsque chacun tient la même arme tranchante, ce qui déterminera vraiment la victoire ne sera plus qui possède la meilleure vitesse de complétion de code, mais qui peut mieux définir le problème, qui a une vision d'architecture système plus large, et qui peut, dans ce monde de code rempli par l'IA, trouver cette part d'irremplaçabilité unique à l'humain.

À propos, lequel choisissez-vous ?

Liens de référence

https://www.morphllm.com/comparisons/codex-vs-claude-code

https://www.reddit.com/r/ClaudeCode/comments/1sk7e2k/claude_code_100_hours_vs_codex_20_hours/

https://x.com/arankomatsuzaki/status/2044270102003196007

https://www.nytimes.com/2026/04/14/technology/openai-cybersecurity-gpt54-cyber.html

Cet article provient du compte WeChat officiel « Machine Heart » (ID: almosthuman2014), auteur : Machine Heart