# Audit Articles associés

Le Centre d'actualités HTX fournit les derniers articles et analyses approfondies sur "Audit", couvrant les tendances du marché, les mises à jour des projets, les développements technologiques et les politiques réglementaires dans l'industrie crypto.

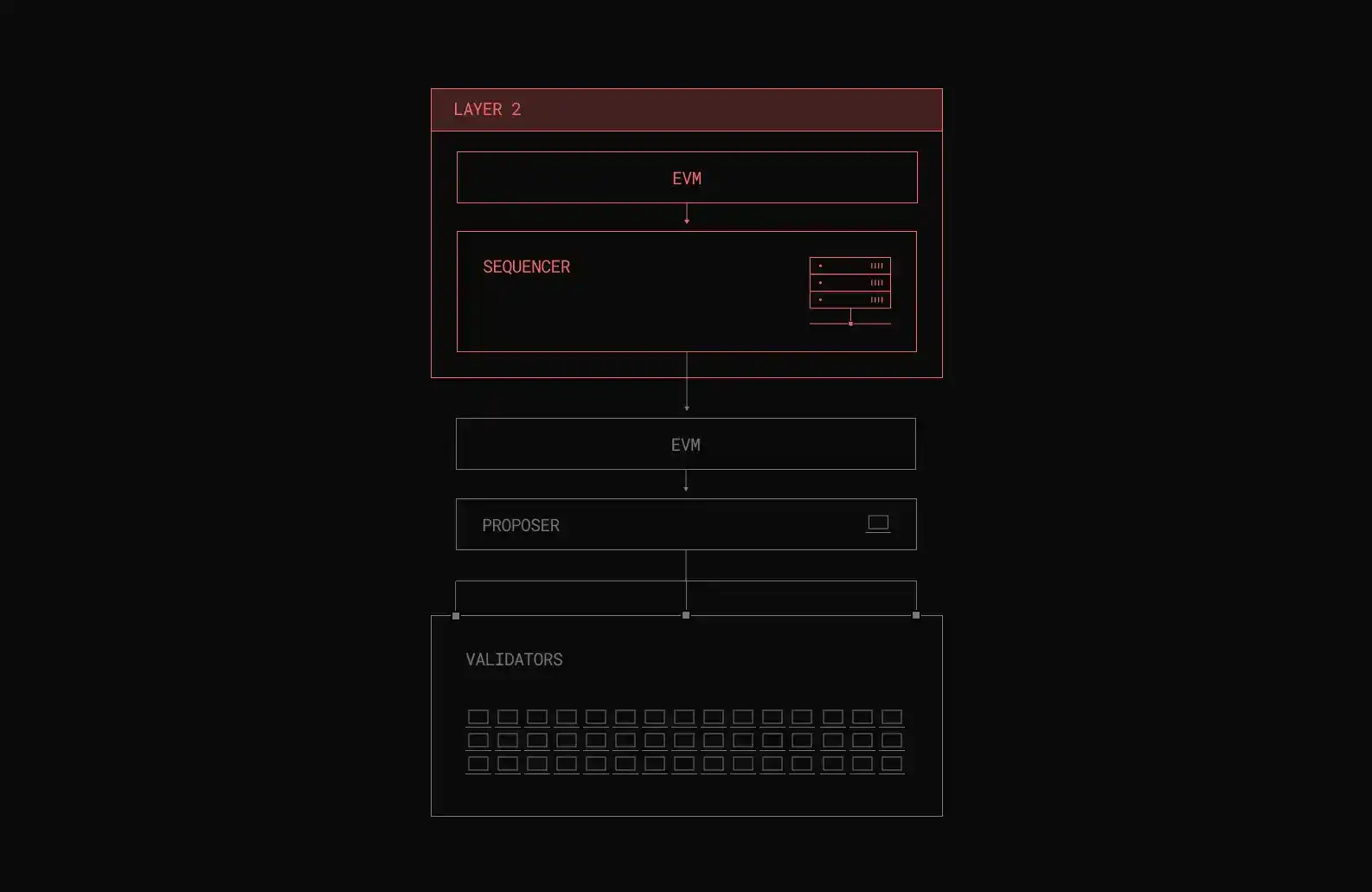

Ethereum

- 1Fondateur d'IOSG : Dites la vérité à Vitalik, que les anciens ayant profité des bénéfices du secteur éclairent la jeune génération

- 2C’est Bankless qui a besoin d’Ethereum, pas l’inverse

- 3Le cofondateur de Bankless liquide ses ETH, la foi collective en Ethereum s'effondre

- 4Départ successif de plusieurs cadres clés, les préoccupations concernant le développement de l'écosystème Ethereum se renforcent

- 5Arrêtez de cliquer les yeux fermés, Ethereum veut vous aider à comprendre ce que vous signez

Nouvelles de l'industrie

- 1Anthropic publie le « manuel du fondateur » : les 4 étapes de l’entrepreneuriat entièrement repensées grâce à l’IA

- 2En moins d'un an, le XRP Ledger atteint la 4ème place du classement RWA

- 3La veille de l'effondrement de l'empire GitHub : Fuite du code source, rupture avec un fan de 18 ans, Microsoft perd 1,5 million de développeurs

- 4Les forfaits token sont là, les opérateurs de télécom sont-ils inquiets ?

- 5Les géants de Wall Street s'emparent du marché des contrats à terme sur GPU, le marché cryptographique a déjà ouvert les hostilités