Si l'IA vous déclare soudainement coupable et que tout le monde croit aveuglément en son jugement, comment prouver votre innocence ?

Cela ressemble à une scène du film Minority Report où l'on prévoit les crimes avant qu'ils n'aient lieu et où l'on est accusé à tort, mais de manière plus abstraite, une version encore plus bâclée se joue déjà dans la réalité :

L'IA a identifié la mauvaise personne, entraînant l'emprisonnement pendant six mois d'une femme innocente, faillissant réduire sa vie à néant.

I. Qu'est-ce que cela signifie que la police ait arrêté "Flash" ?

Angela Lipps, du Tennessee, aux États-Unis, est cette femme malchanceuse. En juillet 2025, une équipe de policiers lourdement armés a fait irruption dans sa vie tranquille, pointant des armes sur elle et lui annonçant son arrestation.

Sur le moment, elle était stupéfaite, ne sachant pas du tout ce qu'on lui reprochait. La police lui a dit qu'elle était suspectée d'avoir participé à une fraude bancaire dans le Dakota du Nord. La scène donnait l'impression que les preuves étaient accablantes, et qu'elle était activement recherchée, mais en entendant cette raison, elle est restée figée sur place :

"Mais je ne suis jamais allée dans cet État de ma vie."

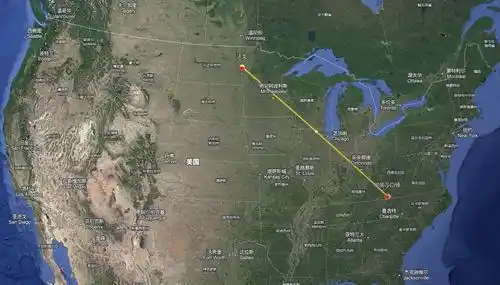

Sur la carte, il y a effectivement une certaine distance entre le Tennessee et le Dakota du Nord. Ce qui l'a liée au suspect, c'est l'IA.

Lors de son arrestation, la police a ignoré ses protestations. Ce n'est qu'une fois en prison qu'elle a appris les détails de l'affaire. La police de Fargo, dans le Dakota du Nord, enquêtait sur une affaire de fraude où le suspect avait escroqué une banque de plusieurs dizaines de milliers de dollars en utilisant une fausse identité militaire. La méthode d'enquête de la police consistait d'abord à examiner les images de surveillance, puis à interroger l'IA, et enfin à arrêter la personne.

On pourrait penser qu'il s'agissait d'utiliser l'IA pour créer un Sherlock Holmes, un détective génial résolvant l'affaire par une déduction logique rigoureuse, mais en réalité, ce n'était pas si "complexe". La police a utilisé un système d'IA pour effectuer une reconnaissance faciale sur des captures d'écran de vidéos de surveillance, puis a filtré les suspects dans sa base de données.

Cette fois, l'IA a fait une énorme erreur en associant incorrectement la photo d'Angela Lipps. Ensuite, ces informations ont été transmises au poste de police chargé de l'enquête, où le personnel a fait encore pire : après avoir vérifié manuellement son permis de conduire et ses réseaux sociaux, ils ont estimé que les caractéristiques faciales, la morphologie et la coiffure étaient similaires, et l'ont donc désignée comme suspecte.

Image de GoFundMe

Mme Lipps était anéantie. N'avaient-ils pas vérifié d'autres indices, au cas où il s'agirait simplement de sosies ? Mais le pire était encore à venir : après cette série de coups, elle n'a pas eu l'occasion de prouver son innocence.

Selon la procédure locale, elle n'a pas été directement emmenée dans le Dakota du Nord pour une enquête plus poussée, mais a été détenue dans une prison locale du Tennessee. Étant considérée comme une "fugitive inter-États", elle n'a bénéficié ni de libération sous caution ni d'interrogatoire par la police. Elle a ainsi été incarcérée pendant 108 jours, de juillet à fin octobre, sans raison apparente. Il est difficile d'imaginer son désespoir pendant cette période.

Angela Lipps a finalement été sortie de prison le 30 octobre pour être transférée vers le Dakota du Nord. Elle faisait face à multiples accusations. Pendant le transfert, elle était non seulement menottée, mais aussi enchaînée à la taille. Pour elle, traverser l'aéroport équivalait à être exposée à la vindicte publique.

Et c'était en fait la première fois de sa vie qu'elle prenait l'avion.

À sa grande surprise, une fois arrivée dans le Dakota du Nord, elle a dû attendre encore. Ce n'a qu'en décembre qu'elle a eu une véritable occasion d'expliquer l'affaire. Son avocat a directement obtenu ses relevés bancaires pour comparer les horaires. Au moment des faits, elle achetait une pizza dans le Tennessee, à 1900 km de là. Cela signifiait qu'à moins d'être "Flash", elle ne pouvait pas avoir commis le crime à travers l'espace-temps.

L'avocat a mis seulement cinq minutes à clarifier l'affaire.

Le 24 décembre, les charges retenues contre elle ont finalement été abandonnées, mais elle n'avait aucune raison de se réjouir, car à ce moment-là, la "ligne d'exécution" lui était déjà arrivée à la cheville.

Angela Lipps a fêté son 50e anniversaire en prison. Pendant sa détention, il était interdit de porter des dentiers, elle ne mangeait que de la malbouffe, son stress mental était énorme et elle a pris beaucoup de poids. Elle était entrée en prison en tenue d'été et en est sortie en hiver, sans même un manteau chaud. Se réchauffer était un problème, sans parler de rentrer chez elle. La police ne lui avait pas donné d'argent pour le voyage. Après sa libération, elle était coincée dans le Dakota du Nord, mais aussi prisonnière du jour où l'IA l'avait accusée à tort.

Heureusement, des personnes bienveillantes lui ont tendu la main.

Son avocat lui a réservé une chambre d'hôtel pour un séjour temporaire et lui a procuré de la nourriture pour survivre aux moments les plus difficiles. Une organisation à but non lucratif locale lui est venue en aide et l'a ramenée chez elle, dans le Tennessee.

Mais une fois rentrée chez elle, recommencer sa vie s'est avéré être un défi infernal. Pendant son séjour en prison, sa situation économique s'est effondrée. Son logement locatif avait disparu, son chien avait disparu, et même sa voiture et les objets qui s'y trouvaient avaient disparu. Ses effets personnels avaient été temporairement stockés dans un entrepôt, mais comme elle n'a pas pu payer la location, tous ses biens ont été liquidés. Même ses relations personnelles étaient précaires, car ses voisins l'avaient vue se faire arrêter et "disparaître" pendant six mois, pensant qu'elle avait vraiment commis un délit.

Parallèlement, son histoire absurde s'est rapidement répandue sur Internet, suscitant des critiques virulentes. Par exemple, beaucoup ont exprimé leur exaspération : aux États-Unis, certaines personnes peuvent faire du "larcin sans payer", mais dès que vous touchez à la banque d'un capitaliste, vous pouvez être arrêté à la vitesse de l'éclair, même si ce n'est pas vous qui l'avez fait.

L'affaire ayant pris une telle ampleur, sa situation désespérée a connu un nouveau rebondissement et elle a reçu plus d'aide. Elle a actuellement collecté 80 000 dollars de dons, ce qui lui permettra amplement de recommencer à reconstruire sa vie.

Cependant, ce que les internautes espèrent le plus maintenant, c'est qu'elle engage une dream team d'avocats pour intenter un procès et obtenir des dommages et intérêts.

Car il ne s'agit pas d'une erreur ponctuelle de la police. Des affaires similaires d'erreurs judiciaires en série se sont produites auparavant, et certaines expériences étaient encore pires que la sienne.

II. Les moments de science-fiction effrayants provoqués par les "erreurs" de l'IA

L'expérience d'Angela Lipps s'est en fait produite une dizaine de fois dans différentes régions, et même dans d'autres pays.

Robert Williams, par exemple, a été l'une des premières victimes de ce type d'incident. En 2020, la police l'a arrêté devant sa femme et sa fille. Il a été détenu pendant 30 heures, alors qu'il mesurait 20 cm de plus que le véritable criminel.

Un autre malchanceux, Chris Gatlin, a été identifié par l'IA à partir d'images floues de surveillance comme suspect potentiel dans une agression dans le métro. Il a ainsi été incarcéré pendant 17 mois, devenant la personne innocente ayant été détenue le plus longtemps. Le plus absurde, c'est que ce n'est qu'à la fin que les enquêteurs ont découvert qu'il existait une preuve cruciale provenant d'une caméra corporelle, mais le suspect filmé ne lui ressemblait pas du tout.

En 2023, Porcha Woodruff a vécu une situation similaire. La police l'a accusée d'avoir participé à un vol de voiture. Elle en a ri, pensant que la police plaisantait, car elle était enceinte de huit mois et n'avait vraiment pas l'air en état de commettre un tel acte. Pourtant, elle a été emmenée et détenue une dizaine d'heures. Plus tard, elle a perdu son procès.

Cette année, un jeune Britannique nommé Alvi Choudhury a également été arrêté dans des circonstances similaires, accusé d'"effraction". Mais les preuves indiquaient qu'il l'avait fait "à distance", une scène également documentée dans les films. L'IA avait identifié une photo de lui prise lors d'une garde à vue en 2021. La police a elle-même ri en le voyant en personne, car il paraissait au moins 10 ans plus vieux que le suspect.

Image tirée de Jumper

En 2022, l'homme d'affaires indien Praveen Kumar a été arrêté alors qu'il se rendait en Suisse. Il faisait une escale à Abou Dhabi lorsque l'IA l'a identifié comme un criminel recherché. Les autorités locales l'ont longuement interrogé et, après avoir constaté qu'il n'était pas le suspect, l'ont renvoyé en Inde. Mais à l'aéroport indien, il a été retenu à deux reprises.

Parmi ce type d'événements, le plus absurde est probablement ce qui est arrivé au scientifique russe Alexander Tsvetkov. L'IA a dit qu'il ressemblait à un meurtrier, et il a été emprisonné pendant 10 mois.

Ce scientifique a subi une double accusation, de la part de l'IA et des humains. En février 2023, il rentrait d'une mission scientifique en Russie lorsqu'il a été arrêté dès sa descente d'avion. La raison : l'IA indiquait qu'il ressemblait à 55 % au portrait-robot d'un suspect dans une série de meurtres vieille de plus de vingt ans. De plus, dans cette affaire, un témoin à charge, cherchant à réduire sa peine, l'avait délibérément faussement identifié. Le problème, c'est que la police n'a pas enquêté sérieusement et l'a simplement arrêté.

Une fois incarcéré, il a d'abord cru à un malentendu, mais l'enquête tardait à se terminer. Sous une énorme pression psychologique et des problèmes de santé, il a été contraint d'avouer, avant de se rétracter. Heureusement, sa femme et ses collègues de l'institut ont continué à se battre pour lui, trouvant d'innombrables preuves qu'au moment des faits, il était en mission ailleurs. Avec la couverture médiatique, l'affaire a été largement discutée par le public. Ce n'est qu'en décembre que la situation a commencé à s'améliorer, et les accusations n'ont été officiellement abandonnées qu'en février 2024.

Ce type d'affaires devient de plus en plus fréquent avec l'évolution de l'IA, donnant l'impression que c'est l'IA qui "dirige", tandis que certains humains ne sont plus que des machines d'exécution.

III. La "maladie professionnelle" du "c'est l'IA qui décide"

La raison pour laquelle on a cette sensation abstraite d'"inversion des rôles" est que l'IA et les humains peuvent tous deux faillir. Même l'IA la plus puissante peut commettre des erreurs, et les humains peuvent toujours être "paresseux".

Prenez le système Clearview AI aux États-Unis, c'est lui qui a envoyé la dame du début de l'article en prison, mais ce n'est pas un logiciel amateur. Clearview AI prétend posséder la plus grande base de données d'images au monde, collectant frénétiquement des dizaines de milliards d'images malgré les amendes de plusieurs pays. Plus de 3000 agences répressives américaines l'utilisent, et l'année dernière, il a signé un contrat de 9,2 millions de dollars avec l'ICE (Immigration and Customs Enforcement).

Pour faire simple, Clearview AI est un "moteur de recherche facial". On upload une image, il la compare à sa base de données et renvoie une série d'images similaires. C'est ensuite à l'utilisateur de déterminer s'il s'agit de la bonne personne.

Bien que l'IA ait progressé à pas de géant ces dernières années, la "précision" reste très controversée, car les données des tests en laboratoire et les conditions réelles d'utilisation de la recherche d'images présentent toujours diverses différences.

Par exemple, la plupart du temps, les images de surveillance trouvées par la police ont une qualité digne d'un téléphone portable des années 90, sans compter les lumières étranges, les angles de prise de vue difficiles, les visages partiels, etc., ce qui rend la reconnaissance difficile. La base de données peut aussi contenir de vieilles photos, et les résultats correspondent peut-être simplement à deux personnes qui se ressemblent par hasard.

Et lorsque ces erreurs s'appliquent à des individus spécifiques, ces derniers doivent en subir les conséquences.

Est-ce un corbeau ou un chat ?

En principe, si l'IA ne faisait que des erreurs occasionnelles, il y aurait un recours, car ce ne sont que des "indices", et la "conclusion" doit encore être validée par un humain. Mais souvent, l'humain est plus "absurde" que l'IA.

En fait, il y a quelques années, des gens se plaignaient déjà que la police américaine se laissait guider par l'IA, tombant dans le "biais d'automatisation", c'est-à-dire une dépendance excessive, voire une confiance exagérée, envers les résultats fournis par l'IA. Si l'IA dit que les deux personnes correspondent, les humains le croient. La taille ne correspond pas ? Ce n'est pas mon problème. Il y a un alibi ? Je ne m'occupe que de l'arrestation. Les autres preuves ? Qu'elles aillent en prison aussi. En sautant les étapes fondamentales de l'enquête, on fait aussi "sauter la vie" des autres.

En réalité, les humains connaissent parfaitement les défauts de l'IA. Après avoir payé de lourdes indemnités, de nombreuses régions américaines ont établi des "lignes de feu", comme l'obligation d'avoir des preuves indépendantes en plus des indices de l'IA pour résoudre une affaire, et certains endroits ont même carrément interdit l'utilisation de cette technologie IA dans les enquêtes.

Mais ces contraintes ne résistent pas au fait que l'IA est vraiment trop pratique. Bien qu'il y ait un risque d'échec, le nombre de succès est clairement plus élevé. Parfois, le seul indice que la police trouve après avoir tout essayé est une image de surveillance de qualité misérable, et il y a de fortes chances qu'ils veuillent tenter leur chance avec l'IA. Dès 2023, des rapports indiquaient que la police américaine avait effectué des millions de recherches avec Clearview AI. Même lorsque c'était interdit officiellement, elle l'utilisait en secret. De toute façon, on pouvait dire qu'on ne l'avait pas utilisé. Si ce logiciel était interdit, on en utilisait un autre. S'il était interdit localement, on demandait à une autre agence de l'utiliser. C'est carrément devenu une addiction.

Ainsi, une fois que l'IA fournit d'abord un indice peu fiable, et que les humains sautent ensuite paresseusement l'enquête, cette combinaison mortelle de "stratèges brillants" produit naturellement des erreurs judiciaires.

Le système brésilien Smart Sampa est confronté à des problèmes similaires ces dernières années. En 2024, São Paulo, au Brésil, a mis en ligne le plus grand système policier de reconnaissance faciale par IA d'Amérique latine, connecté à 40 000 caméras, dit-on.

La bonne nouvelle est que l'efficacité est impressionnante. En quelques années, près de quatre mille criminels ont été arrêtés sur le champ, et plus de trois mille fugitifs ont été capturés. Les vols ont chuté de près de 15 % en 2025, ce qui en fait une véritable "chaîne de production d'arrestation de voleurs".

La mauvaise nouvelle est qu'au moins 59 personnes ont été incorrectement identifiées.

Parmi elles, des cas absurdes, comme un patient psychiatrique emmené de l'hôpital en tant que criminel, puis relâché après que son mandat d'arrêt se soit avéré expiré. Un autre a été arrêté 4 fois en 7 mois, l'IA le confondant avec un meurtrier en fuite. Chaque fois, il était emmené au poste puis relâché immédiatement, pour être à nouveau arrêté quelques jours plus tard. Il était terrifié.

Quand on parlait des emplois que l'IA ne pouvait pas remplacer, on disait que l'IA ne pouvait pas aller en prison à la place des humains, mais nous n'avions pas envisagé l'autre côté de la médaille : elle peut maintenant "envoyer les gens en prison".

Cette phrase était une blague autrefois, mais maintenant, cela devient presque une nouvelle banale. En fait, ce n'est pas seulement la reconnaissance faciale ; l'IA peut aussi faire des dégâts occasionnels dans la reconnaissance d'objets.

L'année dernière, le système de sécurité IA d'un lycée américain a identifié l'emballage de chips tenu par un jeune comme une "arme à feu potentielle", déclenchant directement l'alarme. Huit voitures de police sont arrivées et ont immédiatement maîtrisé le jeune. Après une fouille, ils ont finalement trouvé le sachet de snacks dans une poubelle. La scène était très gênante, le jeune avait cru que sa dernière heure était venue.

Il faut avouer que...

Qui aurait pensé que plus l'IA est puissante, plus les dégâts causés par certains qui l'utilisent sont importants. Avant, l'IA était stupide, elle se trompait en regardant une image, et tout Internet en riait. Maintenant, l'IA est forte, elle se trompe de personne, et un humain fait six mois de prison. À l'avenir, il ne faudrait pas inventer des opérations absurdes comme un jugement par IA, un avocat IA, des tribunaux à nouvelle énergie, etc. En fin de compte, l'IA n'est qu'un outil, tout dépend des capacités et des intentions de celui qui l'utilise. Ou plutôt, plus l'IA est forte, moins les humains peuvent se permettre d'être paresseux.

Bref, on commence un peu à regretter l'IA idiote d'antan.

Cet article provient du compte WeChat public "Cool Play Lab" (酷玩实验室), auteur : Cool Play Lab