Original | Odaily Planet Daily (@OdailyChina)

Auteur | Azuma (@azuma_eth)

Le 8 avril, Anthropic, la société de développement d'IA derrière Claude, a officiellement annoncé le lancement d'un nouveau plan appelé « Project Glasswing » (Aile de verre), qui sera mené conjointement avec plusieurs grands groupes tels qu'Amazon, Apple, Broadcom, Cisco, CrowdStrike, Google, JPMorgan Chase, la Linux Foundation, Microsoft, NVIDIA et Palo Alto Networks.

Anthropic a déclaré que il s'agit d'une mesure d'urgence visant à protéger les logiciels les plus critiques au monde, les parties utiliseront conjointement la version d'aperçu Mythos pour découvrir et corriger les défauts potentiels dans les systèmes dont le monde dépend actuellement.

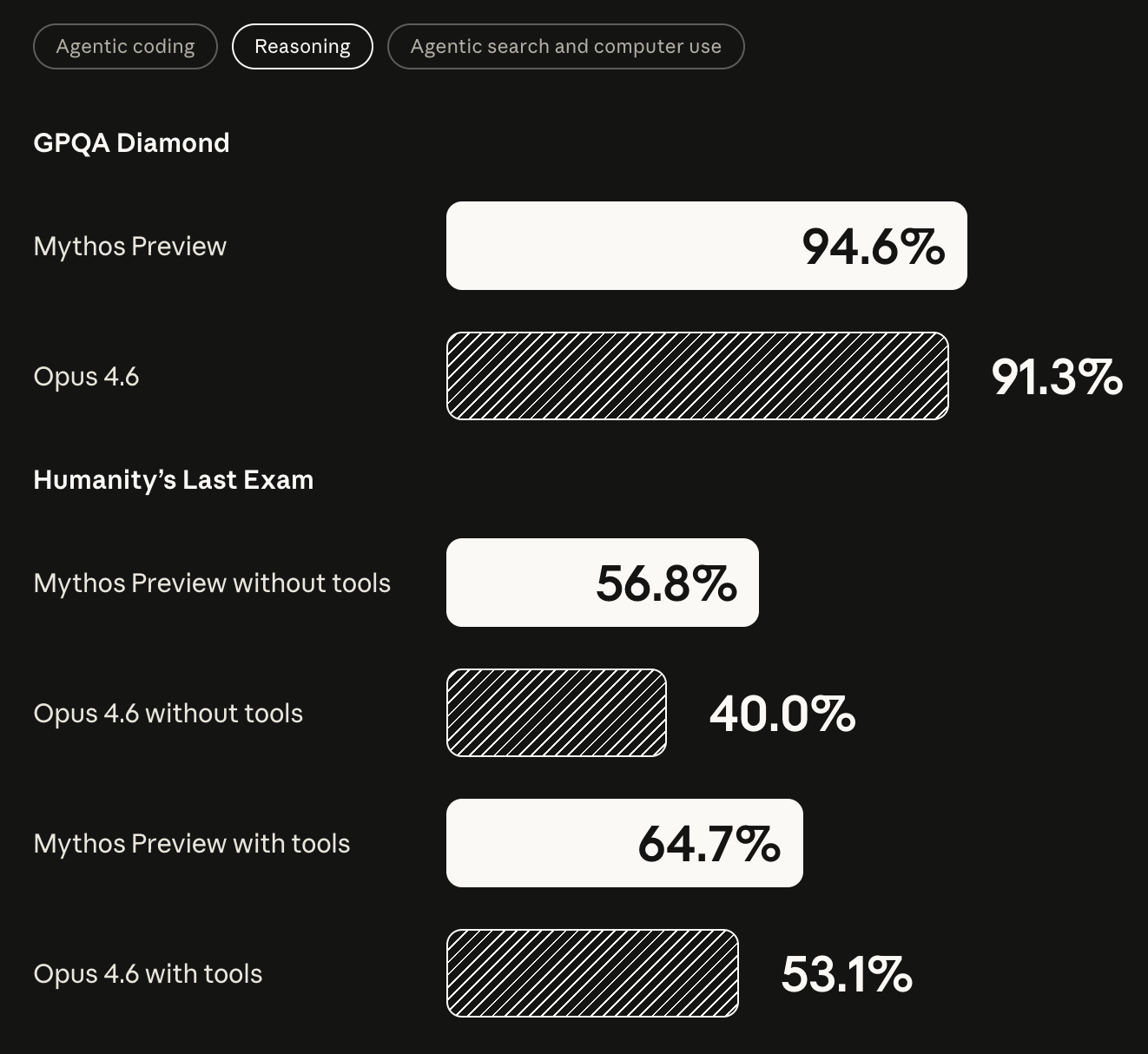

Mythos est le prochain modèle d'IA en cours de développement par Anthropic, le premier modèle de l'histoire humaine dont le nombre total de paramètres dépasse les dix billions (en comparaison, les modèles dominants sur le marché actuel ont des paramètres de l'ordre de centaines de milliards à un billion). Son coût d'entraînement atteint la somme stupéfiante de 10 milliards de dollars. Par rapport au modèle actuellement le plus puissant de Claude, Opus 4.6, Mythos obtient des scores nettement supérieurs dans des tests de codage logiciel, de raisonnement académique et de cybersécurité.

Des rumeurs concernant Mythos circulaient déjà sur le marché la semaine dernière, la préoccupation générale étant de savoir si Mythos, avec ses capacités spécialisées en cybersécurité, affecterait l'équilibre actuel de l'attaque et de la défense en matière de sécurité. S'il était utilisé de manière malveillante, pourrait-il causer des incidents de sécurité à plus grande échelle ? Odaily avait également rapporté cet événement et avait discuté avec Yu Xian, fondateur de SlowMist et expert en sécurité, de l'impact potentiel sur la sécurité offensive et défensive dans l'industrie de la cryptographie (voir « Interview d'Odaily avec Yu Xian : La fuite du nouveau modèle nucléaire d'Anthropic, comment affecte-t-elle l'attaque et la défense en sécurité cryptographique ? »). Mais à l'époque, Anthropic n'avait pas publiquement reconnu l'existence de Mythos, les informations disponibles étaient donc limitées.

Le 8 avril, avec l'annonce du plan « Aile de verre », Anthropic a divulgué plus de détails sur Mythos. Sur la base des cas de test publiés par Anthropic, les capacités de Mythos ne semblent pas exagérées, à tel point que la société n'ose même pas publier directement le modèle, de peur qu'il ne soit utilisé de manière malveillante par des groupes de pirates. Elle prévoit plutôt de le faire tester d'abord par les grands groupes via le plan Aile de verre pour identifier et corriger à l'avance les vulnérabilités potentielles.

Mythos fait étalage de sa force : En quelques semaines, il a découvert des milliers de « vulnérabilités zero-day »

En parlant des capacités de Mythos, Anthropic a déclaré franchement que la naissance de ce modèle signifie qu'un fait严峻 est arrivé — les capacités de codage des modèles d'IA ont atteint un niveau extrêmement élevé, et dans la découverte et l'exploitation des vulnérabilités logicielles, elles peuvent surpasser presque tous les humains, à l'exception des plus expérimentés.

Selon les divulgations d'Anthropic, en seulement quelques semaines, Anthropic a utilisé Mythos pour identifier des milliers de vulnérabilités zero-day (c'est-à-dire des défauts que même les développeurs du logiciel ne connaissaient pas auparavant), dont beaucoup sont des vulnérabilités hautement critiques. Les problèmes couvrent tous les systèmes d'exploitation et navigateurs grand public, et affectent une série d'autres logiciels critiques.

Anthropic a donné plusieurs cas représentatifs :

- Mythos a découvert une vulnérabilité vieille de 27 ans dans OpenBSD, un système réputé pour être « extrêmement sécurisé » et largement utilisé dans les infrastructures critiques comme les pare-feux. Cette vulnérabilité permettait à un attaquant de faire planter le système à distance directement ;

- Dans la bibliothèque de traitement vidéo FFmpeg, utilisée par de nombreux logiciels, Mythos a trouvé une vulnérabilité vieille de 16 ans. Le code problématique avait été déclenché plus de 5 millions de fois par des tests automatisés, mais n'avait jamais été découvert ;

- Mythos a également pu enchaîner automatiquement plusieurs vulnérabilités dans le noyau Linux, passant des permissions d'un utilisateur standard au contrôle complet du serveur.

Plus inquiétant encore, Anthropic a déclaré que la plupart de ces vulnérabilités ont été « découvertes de manière autonome et les chemins d'exploitation construits » par Mythos avec presque aucune intervention humaine, ce qui signifie peut-être que l'IA commence à posséder des capacités offensives et défensives automatisées similaires à celles des meilleures équipes de hackers.

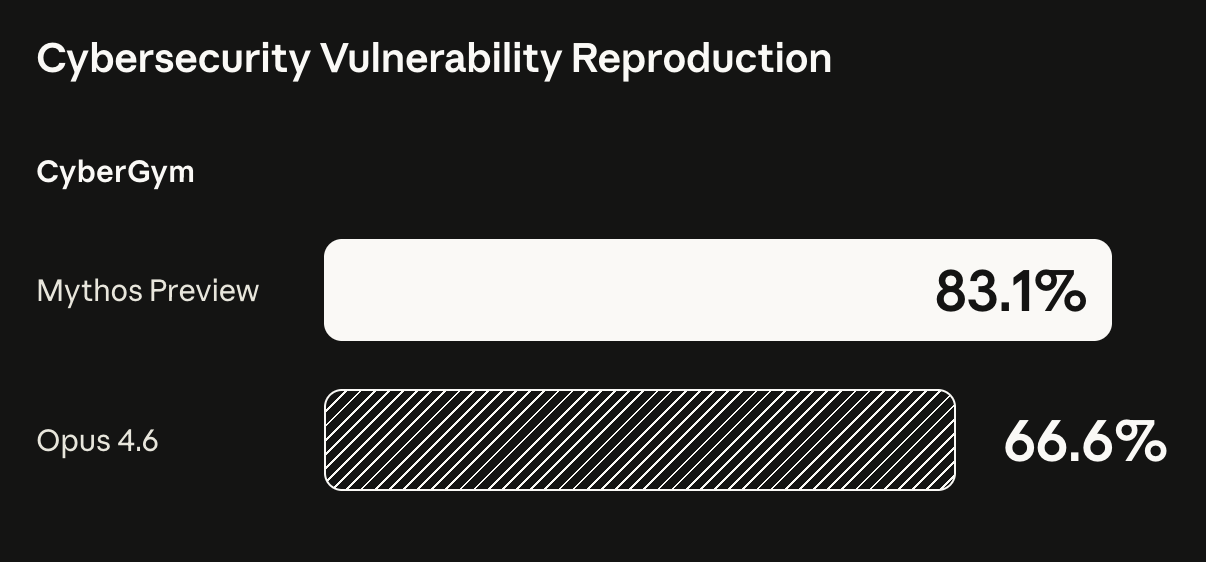

Sur les benchmarks d'évaluation, Mythos a également montré une évolution de rupture par rapport à Opus 4.6. Par exemple, dans les tests de reproduction de vulnérabilités de cybersécurité, Mythos a atteint 83,1 %, contre 66,6 % pour Opus 4.6 ; dans plusieurs tests de codage et de raisonnement, les scores de Mythos étaient également bien supérieurs.

C'est peut-être précisément parce que les capacités de Mythos sont trop puissantes qu'Anthropic n'a pas choisi d'ouvrir directement le modèle, mais a d'abord lancé le plan « Aile de verre » pour permettre à l'ensemble de l'Internet de se « renforcer » au préalable.

Grâce à ce plan, Anthropic ouvrira aux participants une version d'aperçu de Mythos à l'avance, pour découvrir et corriger les vulnérabilités ou points faibles dans leurs systèmes de base — en se concentrant sur des tâches telles que la détection locale de vulnérabilités, les tests en boîte noire de programmes binaires, le renforcement de la sécurité des terminaux et les tests d'intrusion de systèmes.

Anthropic s'est également engagé à fournir aux participants un total de 100 millions de dollars de crédits d'utilisation du modèle pour soutenir l'utilisation pendant toute la phase d'aperçu de la recherche. Par la suite, la version d'aperçu de Mythos sera ouverte aux participants au prix de 25 dollars par million de tokens d'entrée et 125 dollars par million de tokens de sortie (les participants pourront également accéder au modèle via Claude API, Amazon Bedrock, Google Cloud Vertex AI et Microsoft Foundry). Outre les crédits d'utilisation du modèle, Anthropic fera également un don de 2,5 millions de dollars à Alpha-Omega et à l'OpenSSF via la Linux Foundation, et un don de 1,5 million de dollars à la Apache Software Foundation, pour aider les mainteneurs de logiciels open source à faire face à l'environnement de sécurité en constante évolution.

Anthropic prévoit d'élargir progressivement la portée de participation de « l'Aile de verre » et de poursuivre le projet pendant plusieurs mois, tout en partageant autant que possible les expériences afin que d'autres organisations puissent les appliquer à leur propre construction de la sécurité. Dans les 90 jours, Anthropic publiera un rapport sur les résultats intermédiaires, y compris les vulnérabilités déjà corrigées et les mesures d'amélioration de la sécurité pouvant être divulguées.

La technologie ne fera que s'améliorer, mais il ne faut pas trop s'inquiéter

L'IA change de manière irréversible le monde que nous connaissons, y compris le domaine de la cybersécurité sur lequel cet article se concentre. Alors que le seuil de découverte et d'exploitation des vulnérabilités diminue considérablement, les gens ne peuvent s'empêcher de s'inquiéter : l'IA deviendra-t-elle une arme entre les mains d'acteurs malveillants, menaçant l'équilibre actuel de la cybersécurité ? (PS : Pour les utilisateurs de cryptomonnaies qui doivent placer de l'argent réel dans des systèmes de portefeuille ou des protocoles on-chain, cette inquiétude est particulièrement forte.)

Face à cette question, Anthropic estime que « nous avons encore des raisons d'être optimistes ». Les modèles d'IA sont dangereux précisément parce qu'ils ont la capacité de causer des dommages entre de mauvaises mains, mais en même temps, ils ont une valeur inestimable pour découvrir et corriger les défauts des logiciels importants et pour développer de nouveaux logiciels plus sûrs.

On peut prévoir que les capacités de l'IA continueront d'évoluer rapidement dans les années à venir, mais au moment où de nouveaux moyens d'attaque apparaîtront, de nouveaux mécanismes de défense émergeront également. La mise à niveau technologique est inévitable, mais cela ne signifie pas que les risques deviendront nécessairement incontrôlables — à condition que les systèmes de défense évoluent simultanément, et même qu'ils puissent utiliser l'IA pour construire une protection de sécurité encore plus forte.