Auteur : Curry, Deep Tide TechFlow

La semaine dernière, une école secondaire de Manchester, au Royaume-Uni, a fait passer sa bibliothèque au crible de l'IA.

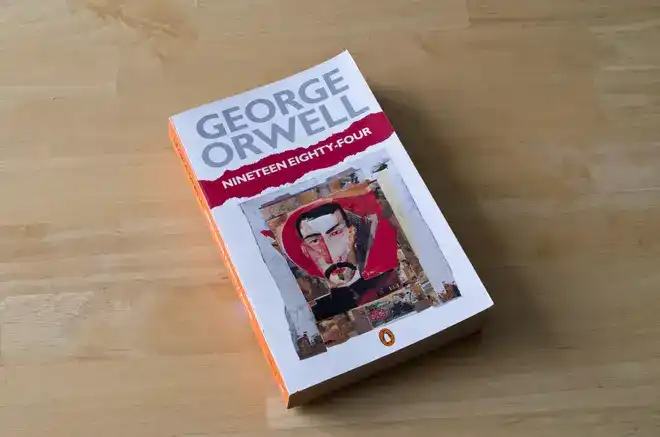

L'IA a dressé une liste de 193 livres à retirer, chacun accompagné d'une justification. « 1984 » de George Orwell figurait en bonne place, pour « thèmes de torture, de violence et de coercition sexuelle ».

« 1984 » décrit un monde où le gouvernement surveille tout, réécrit l'histoire et décide de ce que les citoyens peuvent voir ou non. Aujourd'hui, une IA a fait la même chose pour une école, et elle ne savait probablement pas elle-même ce qu'elle disait.

La bibliothécaire de l'école a jugé cela déraisonnable et a refusé d'appliquer toutes les recommandations de l'IA.

L'école a alors lancé une enquête interne contre elle, invoquant la « sécurité des enfants », l'accusant d'avoir introduit des livres inappropriés dans la bibliothèque, et a signalé l'affaire aux autorités locales. Sous la pression, elle a pris un congé maladie et a finalement démissionné.

L'absurdité veut que les conclusions de l'enquête des autorités locales aient établi qu'elle avait effectivement enfreint les procédures de sécurité relatives aux enfants, validant la plainte.

Caroline Roche, présidente de l'Association britannique des bibliothèques scolaires, a déclaré que cette conclusion signifiait qu'elle ne pourrait plus jamais travailler dans aucune école.

La personne qui a résisté au jugement de l'IA a perdu son emploi, celle qui a approuvé le jugement de l'IA n'a eu aucun problème.

Par la suite, l'école a reconnu dans des documents internes que toutes les classifications et justifications étaient générées par l'IA, affirmant : « Bien que la classification ait été générée par l'IA, nous estimons qu'elle est globalement exacte. »

Une école a confié le jugement de « quels livres sont appropriés pour les élèves » à une IA, l'IA a rendu une réponse qu'elle ne comprenait pas elle-même, puis un gestionnaire humain l'a approuvée sans même la regarder en détail.

Après que cette affaire ait été rendue publique par l'organisation britannique de liberté d'expression Index on Censorship, les questions soulevées dépassent largement les étagères d'une seule école :

Quand l'IA commence à décider à la place des humains de ce qui est approprié et de ce qui est dangereux, qui doit juger si le jugement de l'IA est correct ?

Wikipedia ferme ses portes à l'IA

La même semaine, une autre institution a répondu à cette question par ses actes.

L'école a laissé l'IA décider de ce que les gens peuvent lire. Le plus grand site d'encyclopédie en ligne au monde, Wikipédia (Wikipedia), a fait le choix inverse : ne pas laisser l'IA décider du contenu de l'encyclopédie.

La même semaine, Wikipédia en anglais a officiellement adopté une nouvelle politique interdisant l'utilisation de grands modèles de langage pour générer ou réécrire le contenu des articles. Le vote a donné 44 voix pour et 2 contre.

La cause directe fut un compte IA nommé TomWikiAssist. Début mars de cette année, ce compte a créé et édité de manière autonome plusieurs articles sur Wikipédia, avant d'être traité en urgence par la communauté après sa découverte.

L'IA met quelques secondes pour écrire un article, mais les bénévoles passent des heures à vérifier les faits, les sources et la formulation d'un article généré par l'IA pour s'assurer de son exactitude.

La communauté des éditeurs de Wikipédia est limitée en nombre. Si l'IA peut produire du contenu en quantité illimitée, les éditeurs humains ne pourront tout simplement pas tout examiner.

Ce n'est même pas la partie la plus problématique. Wikipédia est l'une des sources de données d'entraînement les plus importantes pour les modèles d'IA mondiaux. L'IA apprend des connaissances sur Wikipédia, puis utilise ce qu'elle a appris pour écrire de nouveaux articles Wikipédia, qui sont ensuite ingérés par la prochaine génération de modèles d'IA pour continuer l'entraînement.

Une fois que de fausses informations générées par l'IA s'y infiltrent, elles s'amplifient dans cette boucle, devenant un empoisonnement IA en forme d'emboîtement :

L'IA pollue les données d'entraînement, les données d'entraînement polluent à leur tour l'IA.

Cependant, la politique de Wikipédia laisse aussi deux portes entrouvertes à l'IA : les éditeurs peuvent utiliser l'IA pour peaufiner leurs propres textes, ou pour aider à la traduction. Mais la politique met spécifiquement en garde : l'IA peut « aller au-delà de votre demande, modifier le sens du texte, le rendant incompatible avec les sources citées ».

Les auteurs humains font des erreurs, et Wikipédia a compté sur la collaboration communautaire pour les corriger pendant plus de vingt ans. L'IA se trompe différemment ; elle invente des choses qui semblent plus vraies que nature, et peut les produire en masse.

Une école a cru au jugement de l'IA et a perdu une bibliothécaire. Wikipédia a choisi de ne pas croire et a simplement fermé la porte.

Mais que se passe-t-il si même les créateurs de l'IA commencent à douter ?

Les créateurs de l'IA ont eux-mêmes peur

Alors que des institutions extérieures ferment leurs portes à l'IA, les entreprises d'IA elles-mêmes reculent également.

La même semaine, OpenAI a mis indéfiniment en suspens le « mode adulte » de ChatGPT. Cette fonctionnalité, initialement prévue pour décembre dernier, devait permettre aux utilisateurs adultes vérifiés d'avoir des conversations érotiques avec ChatGPT.

Le PDG Sam Altman l'avait annoncé personnellement en octobre dernier, déclarant vouloir « traiter les utilisateurs adultes comme des adultes ».

Résultat, après avoir été reportée trois fois, elle a purement et simplement été annulée.

Selon le Financial Times, le comité consultatif sur la santé interne d'OpenAI s'est opposé à l'unanimité à cette fonctionnalité. Les inquiétudes des conseillers étaient très concrètes : les utilisateurs développeraient une dépendance affective malsaine envers l'IA, et les mineurs trouveraient forcément des moyens de contourner la vérification d'âge.

Un conseiller a été plus direct : sans améliorations majeures, cela pourrait devenir un « coach de suicide sexy ».

Le taux d'erreur du système de vérification d'âge dépasse les 10 %. Compte tenu de l'audience hebdomadaire de ChatGPT, 8 milliards d'utilisateurs actifs, 10 % représentent plusieurs dizaines de millions de personnes potentiellement mal classées.

Le mode adulte n'est pas le seul produit supprimé ce mois-ci. L'outil vidéo IA Sora, la fonction de paiement instantané intégrée à ChatGPT, ont tous été retirés simultanément. Altman a déclaré que l'entreprise se concentrait sur son activité principale, éliminant les « tâches secondaires ».

Mais OpenAI se prépare simultanément à son introduction en bourse (IPO).

Une entreprise en phase de finalisation pour son entrée en bourse qui supprime densément des fonctionnalités potentiellement controversées, cette action pourrait plus précisément s'appeler autre chose que de la concentration.

Il y a cinq mois, Altman disait encore qu'il fallait traiter les utilisateurs comme des adultes. Cinq mois plus tard, il s'est rendu compte que sa propre entreprise n'avait pas encore compris ce que l'IA pouvait laisser les utilisateurs toucher ou non.

Même les créateurs de l'IA n'ont pas eux-mêmes la réponse. Alors, qui devrait tracer cette ligne ?

L'écart de vitesse impossible à combler

Si vous regardez ces trois événements ensemble, il est facile d'en tirer une conclusion centrale :

La vitesse à laquelle l'IA produit du contenu et celle à laquelle les humains le modèrent ne sont plus du même ordre de grandeur.

Le choix de l'école de Manchester devient très compréhensible dans ce contexte. Combien de temps faudrait-il à un bibliothécaire pour lire 193 livres un par un avant de porter un jugement ? Faire passer le tout à l'IA, quelques minutes.

Le directeur a choisi l'option de quelques minutes. Pensez-vous qu'il croyait vraiment au jugement de l'IA ? Je pense que c'est surtout parce qu'il ne voulait pas passer ce temps.

C'est une question économique. Le coût de génération tend vers zéro, le coût de la modération est entièrement supporté par les humains.

Ainsi, chaque institution touchée par l'IA est contrainte de réagir de la manière la plus brutale qui soit : Wikipédia interdit purement et simplement, OpenAI supprime carrément des lignes de produits. Aucune de ces solutions n'est le fruit d'une réflexion approfondie ; ce sont toutes des solutions de fortune, adoptées à la hâte parce qu'il n'y a pas le temps de réfléchir.

« Boucher les trous en urgence » devient la norme.

Les capacités de l'IA évoluent tous les quelques mois, tandis que les discussions sur ce que l'IA peut toucher comme contenu n'ont même pas encore abouti à un cadre international convenable. Chaque institution ne gère que la ligne dans sa propre cour, les lignes sont contradictoires entre elles et personne ne les coordonne.

La vitesse de l'IA continue d'augmenter. Le nombre de modérateurs n'augmentera pas. Cet écart ne fera que se creuser, jusqu'à ce qu'un jour, un événement bien plus grave que l'interdiction de « 1984 » se produise.

À ce moment-là, il sera peut-être trop tard pour tracer des lignes.