Samedi matin, Altman a partagé sur X une capture d'écran d'une lettre interne.

La lettre, écrite jeudi soir aux employés d'OpenAI, indiquait que l'entreprise négociait avec le Pentagone et qu'il espérait aider à « apaiser la situation ». En partageant cette lettre, il a ajouté quelques lignes pour expliquer ce qui s'était passé ces derniers jours.

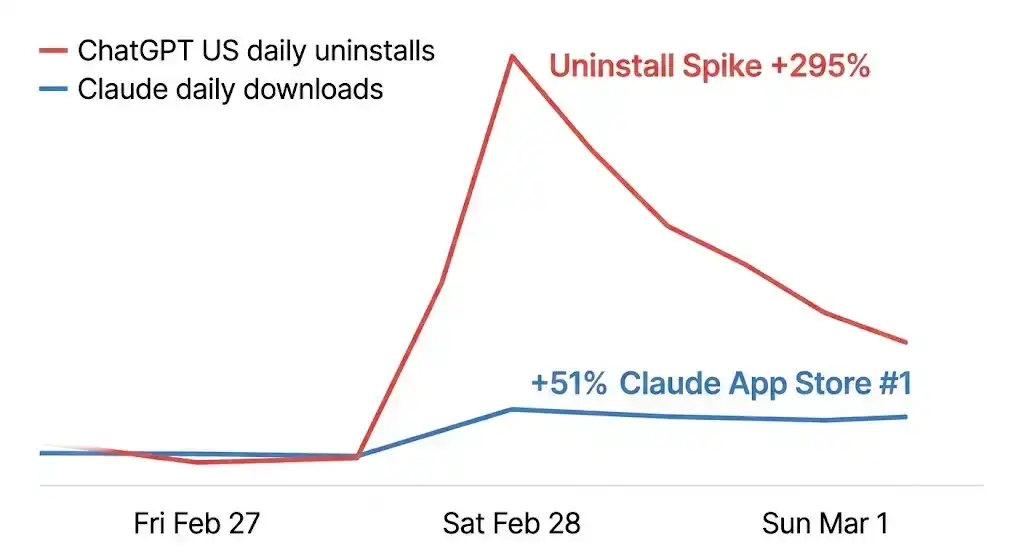

Au moment où il a publié ce tweet, Claude était déjà monté à la première place du classement gratuit de l'App Store américain. La veille, ChatGPT occupait encore cette position.

Les données de Sensor Tower ont enregistré ce qui s'est passé dans les heures suivantes : samedi, les désinstallations de ChatGPT aux États-Unis ont augmenté de 295 % par rapport aux jours ordinaires, et les critiques une étoile ont bondi de 775 %. Dans le même temps, les téléchargements de Claude ont augmenté de 51 % en une journée. Sur Reddit, une vague de publications « Cancel ChatGPT » (Boycott ChatGPT) est apparue, les utilisateurs partageant des captures d'écran de leur désabonnement, et quelqu'un a commenté « fastest install of my life ». Un site appelé QuitGPT.org a été lancé, affirmant que 1,5 million de personnes avaient déjà agi.

Lundi, le nombre d'utilisateurs affluant était si important que Claude a subi une panne massive. L'entreprise classée comme « risque pour la sécurité de la chaîne d'approvisionnement » par le gouvernement fédéral a vu ses serveurs surchargés par l'afflux d'utilisateurs.

Une contre-attaque produit précise

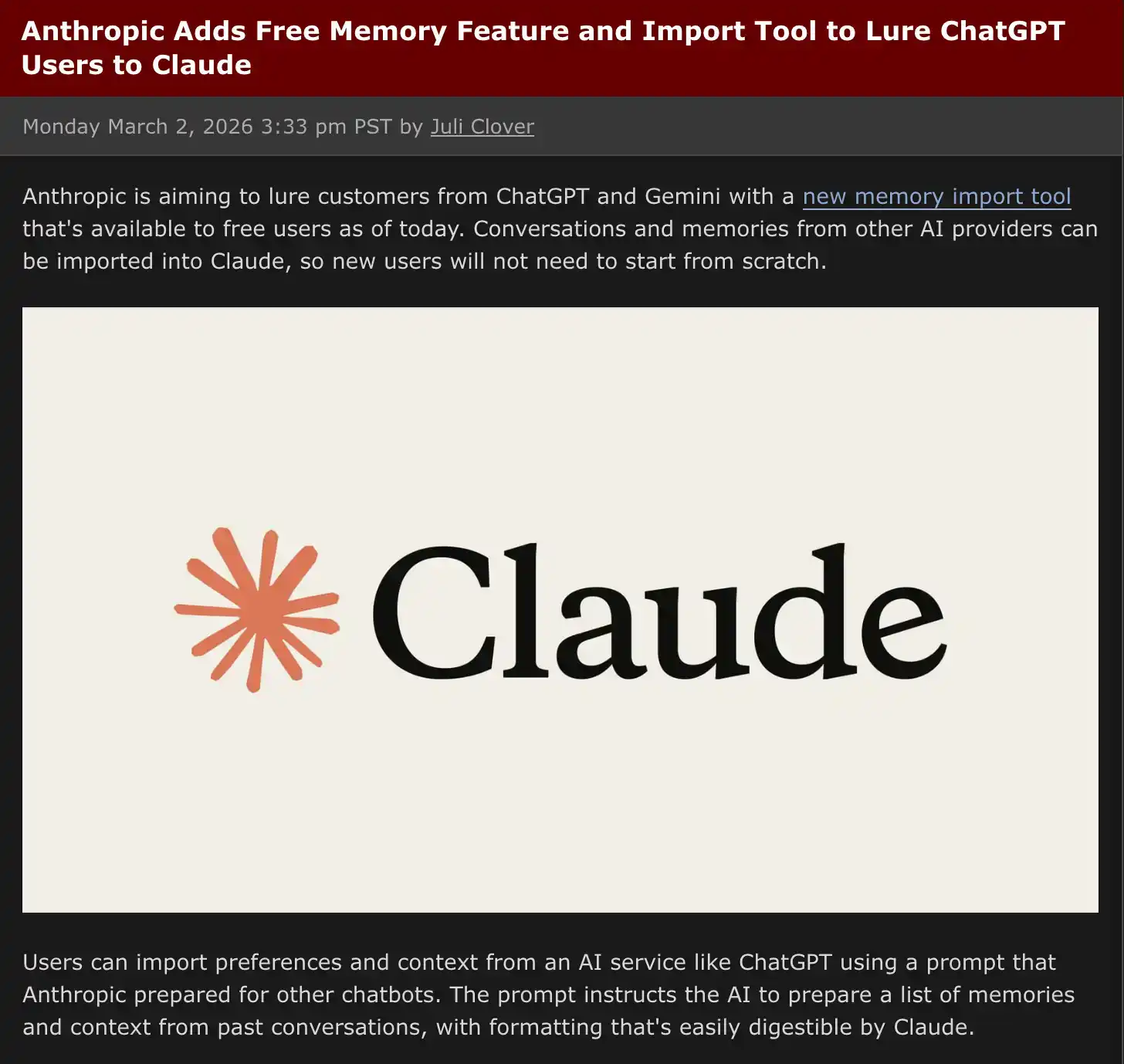

Le même jour où la vague de désinstallations a pris de l'ampleur, Anthropic a lancé un outil de migration de la mémoire.

La fonctionnalité en elle-même n'est pas complexe. L'utilisateur copie une invite dans ChatGPT, lui demande de produire toutes les mémoires et préférences stockées, puis les colle dans Claude, qui les importe en un clic, reprenant là où vous avez quitté ChatGPT. Le slogan sur le site web n'est qu'une phrase : « switch to Claude without starting over » (passez à Claude sans recommencer à zéro).

Le timing de cet outil est son attribut le plus crucial.

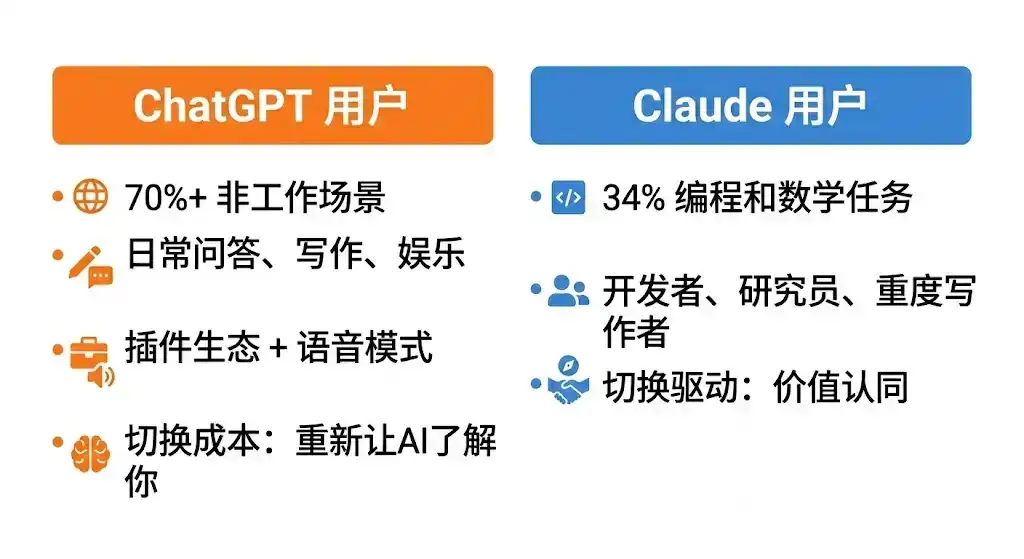

Les propres données d'OpenAI montrent qu'à mi-2025, plus de 70 % des scénarios d'utilisation de ChatGPT par les utilisateurs étaient non liés au travail, incluant les questions-réponses quotidiennes, l'écriture, les loisirs et la recherche d'informations. Pour beaucoup, c'est le premier IA qu'ils ont rencontré, s'intégrant dans la vie quotidienne grâce à son vaste écosystème de plugins, son Voice Mode et son intégration profonde avec des applications tierces. Le coût de changement pour ces utilisateurs n'est pas seulement « télécharger une nouvelle app », mais aussi faire en sorte qu'un IA qui ne vous connaît pas apprenne qui vous êtes à partir de zéro. L'accumulation de mémoires était auparavant la raison la plus forte de rester.

Les propres données de recherche d'Anthropic montrent que les scénarios d'utilisation de Claude sont très concentrés. Les tâches de programmation et de mathématiques représentent 34 %, la plus grande catégorie unique, l'éducation et la recherche étant les domaines à la croissance la plus rapide au cours de l'année écoulée. Les utilisateurs principaux sont les développeurs, les chercheurs et les rédacteurs intensifs, ces personnes sont plus rationnelles, plus susceptibles de changer d'outil en raison d'un jugement de valeur clair, à condition que le coût de migration soit suffisamment faible.

L'outil de migration de la mémoire réduit ce coût au minimum. Parallèlement, Anthropic a annoncé que la fonction de mémoire serait entièrement ouverte aux utilisateurs gratuits, une fonction auparavant réservée aux abonnés payants.

Cependant, une partie importante des utilisateurs ayant afflué n'étaient pas les utilisateurs cibles initiaux de Claude.

D'après les retours sur les réseaux sociaux, de nombreux utilisateurs ordinaires migrant de ChatGPT ont souvent comme première réaction en utilisant Claude : « C'est différent. » Certains trouvent que les réponses de Claude sont plus profondes, qu'elles rebondissent, au lieu de tout accepter. D'autres découvrent qu'il est plus concis dans l'écriture, mais qu'il ne génère pas d'images et n'a pas d'expérience interactive comme le Voice Mode.

Certains qui cherchaient un « remplacement plus obéissant de ChatGPT » ont découvert que la personnalité de Claude est plus forte et que l'adaptation prend du temps. Un guide de migration de TechRadar a été massivement partagé ces derniers jours, intitulé « J'aurais aimé qu'on me dise ces choses », le message central étant : la logique d'utilisation de Claude et de ChatGPT est fondamentalement différente, le premier étant plus comme un collègue de travail avec des positions, le second comme un assistant universel.

Cette différence, qui était à l'origine le positionnement respectif des deux produits, a été accidentellement amplifiée par cet événement. Les utilisateurs ont afflué vers Claude pour des raisons morales, puis ont découvert un produit différent de leurs attentes, un IA plus exigeant, avec plus de limites. Cela aurait pu être une raison de partir, mais à ce moment particulier, c'est devenu une raison de rester : si vous croyez en la position d'une entreprise, il est plus facile d'accepter la logique de son produit.

Quelques jours après le lancement, Anthropic a publié des données : les utilisateurs actifs gratuits ont augmenté de plus de 60 % par rapport à janvier, et les nouvelles inscriptions quotidiennes ont quadruplé. Claude a connu une panne due au volume de trafic, des milliers d'utilisateurs ont signalé ne pas pouvoir se connecter, résolu en quelques heures.

Trois mots dans le contrat : Ce qu'OpenAI a dit et fait

Anthropic est la première entreprise commerciale à avoir déployé un modèle d'IA sur le réseau confidentiel militaire américain, la collaboration passant par Palantir, pour un contrat d'environ 200 millions de dollars. Mais ces derniers mois, la relation s'est détériorée. Le cœur du différend est une clause : le Pentagone exigeait que le modèle d'IA soit ouvert à « tous les usages légaux », sans condition. Anthropic insistait pour ajouter deux exceptions explicites : ne pas être utilisé pour la surveillance de masse des citoyens américains, et ne pas être utilisé pour des systèmes d'armes entièrement autonomes.

Autour du 20 février, un cadre d'Anthropic aurait interrogé son partenaire Palantir sur l'utilisation de Claude lors de l'opération militaire américaine de capture du président vénézuélien Maduro en janvier, ce qui a mécontenté l'armée. Jeudi, le Pentagone a lancé un ultimatum, donnant à Dario Amodei jusqu'à 17h le jour même pour répondre.

Amodei a publié une déclaration avant l'échéance, disant que l'entreprise ne pouvait accepter les termes actuels, « non pas parce que nous nous opposons aux usages militaires, mais parce que dans certains cas, nous croyons que l'IA pourrait saper plutôt que défendre les valeurs démocratiques ». Trump a aussitôt annoncé l'arrêt complet de l'utilisation des produits Anthropic par les agences fédérales dans les six mois, et Hegseth l'a classée comme « risque pour la sécurité de la chaîne d'approvisionnement », une étiquette通常 utilisée pour les entreprises adverses étrangères. Le contrat a été résilié.

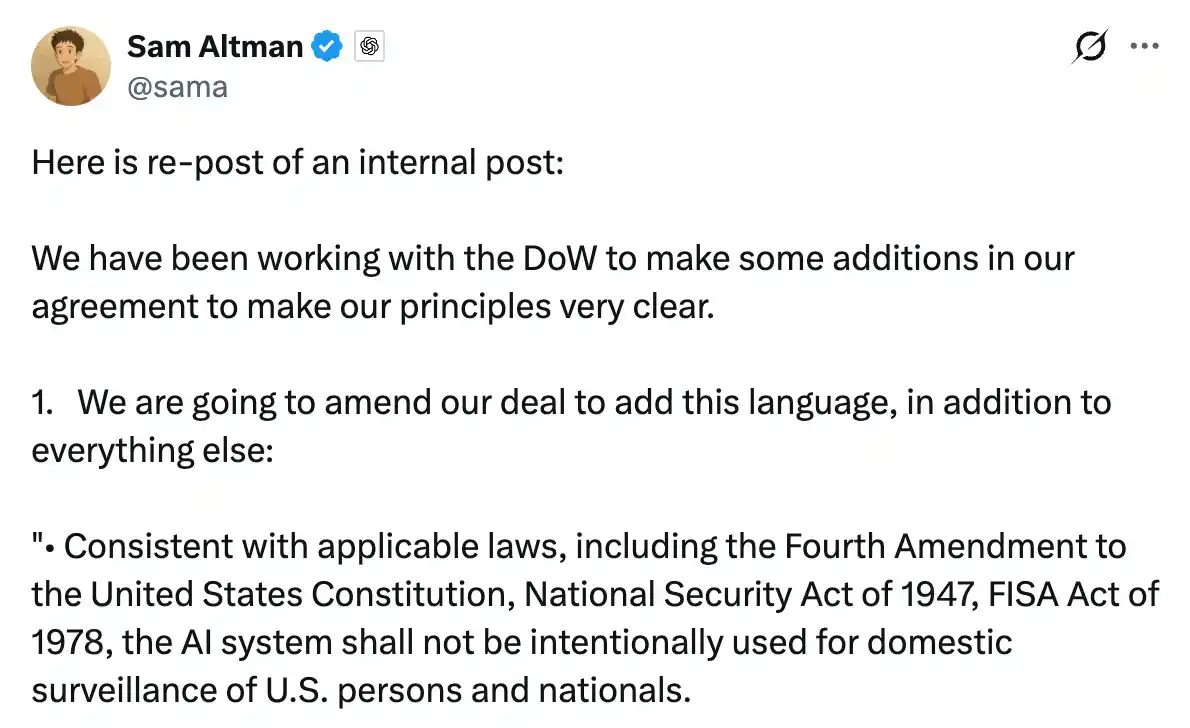

La place vacante a rapidement été comblée. Plus tard dans la journée, OpenAI a annoncé avoir signé un contrat avec le Pentagone. Dans sa lettre interne de jeudi, la position d'Altman était encore claire, il écrivait que c'était déjà « un problème de toute l'industrie », disant qu'OpenAI et Anthropic partageaient les mêmes « lignes rouges » : opposition à la surveillance de masse, opposition aux armes autonomes. Vendredi, l'accord a été conclu, déployant le modèle sur le réseau confidentiel militaire, limité à une exécution dans le cloud, avec des ingénieurs派驻 pour superviser, et affirmant avoir inclus les deux mêmes restrictions dans le contrat.

Altman a ensuite ouvert une session de questions sur X, répondant pendant plusieurs heures. Quelqu'un lui a demandé : pourquoi le Pentagone a accepté OpenAI, mais interdit Anthropic ? Sa réponse fut : « Anthropic semblait plus concentrée sur les clauses d'interdiction spécifiques dans le contrat, plutôt que de citer les lois applicables, alors que nous sommes satisfaits de citer la loi. »

Cette phrase parle d'une différence de méthodologie, mais elle ouvre la vraie controverse de cette affaire.

La clé de l'échec des négociations pour Anthropic était cette phrase insistée par le Pentagone : le système d'IA peut être utilisé pour « all lawful purposes », c'est-à-dire tous les buts légaux. La raison du refus d'Anthropic était que cette phrase, dans un contexte de sécurité nationale, n'est pas une frontière fixe. La loi actuelle n'a pas encore rattrapé les capacités de l'IA dans de nombreux domaines, la portée du « légal » sera déterminée par l'interprétation du gouvernement lui-même. OpenAI a signé cette phrase, tout en affirmant avoir obtenu les mêmes protections dans le contrat.

Des experts juridiques ont ensuite analysé les clauses du contrat publiées par OpenAI, pointant deux problèmes spécifiques de formulation.

La clause sur la surveillance stipule que le système ne doit pas être utilisé pour une surveillance « unconstrained » (sans contrainte) des informations privées des citoyens américains. Samir Jain, vice-président des politiques au Center for Democracy & Technology, a souligné que cette formulation implique qu'une version « contrainte » de la surveillance est autorisée. Dans le cadre juridique actuel, le gouvernement peut tout à fait acheter légalement auprès de courtiers en données les historiques de localisation, de navigation et les données financières des citoyens, et laisser l'IA analyser ces données, ce qui ne constitue pas techniquement une « surveillance illégale ». Amodei a cité exactement cet exemple dans une interview ultérieure avec CBS.

La clause sur les armes stipule que le système ne doit pas être utilisé pour des armes autonomes « dans les cas où la loi, les règlements ou la politique du département exigent un contrôle humain ». Ce qualificatif signifie que la restriction ne s'applique que si d'autres dispositions exigent déjà un contrôle humain, sa force contraignante dépend entièrement des politiques existantes. Et le Pentagone a le pouvoir de modifier sa politique interne à tout moment. Le juriste Charles Bullock a écrit sur X que la clause sur les armes du contrat s'appuie sur la directive DoD 3000.09, qui exige que les commandants conservent un « degré approprié de jugement humain », et ce « degré approprié » est une norme qui peut être interprétée de manière flexible.

La réponse d'OpenAI à ces interrogations est : le modèle ne fonctionne que dans le cloud, ce qui exclut architecturalement une intégration directe dans des systèmes d'armes. Le contrat cite également des bases juridiques spécifiques, offrant plus de contraintes que des clauses d'interdiction textuelles, car la loi est un cadre déjà éprouvé. Altman lui-même a admis lors de la session de questions : « Si nous devons livrer cette bataille à l'avenir, nous la livrerons, mais cela nous expose clairement à certains risques. »

Il ne s'agit pas d'une entreprise prête à compromettre et d'une autre tenant bon sur ses principes, il s'agit de deux philosophies de sécurité fondamentalement différentes. La ligne rouge d'OpenAI est : je ne fais rien d'illégal. La ligne rouge d'Anthropic est : je ne fais rien qui, selon moi, ne devrait pas être fait, même si la loi ne l'a pas encore interdit.

Cette divergence a également créé une fissure au sein d'OpenAI. La semaine dernière, plusieurs employés d'OpenAI ont signé une lettre ouverte soutenant la position d'Anthropic et s'opposant à son classement comme risque pour la supply chain. Le chercheur en alignement Leo Gao a publiquement mis en doute si le contrat de l'entreprise offrait une protection suffisante. Sur le trottoir devant les bureaux d'OpenAI à San Francisco, des graffitis critiques à la craie sont apparus. Devant les bureaux d'Anthropic, ce sont des messages de soutien. La session de questions de plusieurs heures d'Altman sur X s'adressait dans une large mesure aux personnes de sa propre entreprise qui étaient initialement du côté d'Anthropic.

Deux résultats pour un même récit

Anthropic utilise depuis des années le récit de « prévenir les risques au niveau de la civilisation » pour cadrer sa mission de sécurité, comparant les menaces potentielles de l'IA de pointe aux armes nucléaires, se positionnant comme le gardien de cette ligne de défense. Ce récit est au cœur de sa marque et sa façon d'obtenir la confiance sur le marché des capitaux.

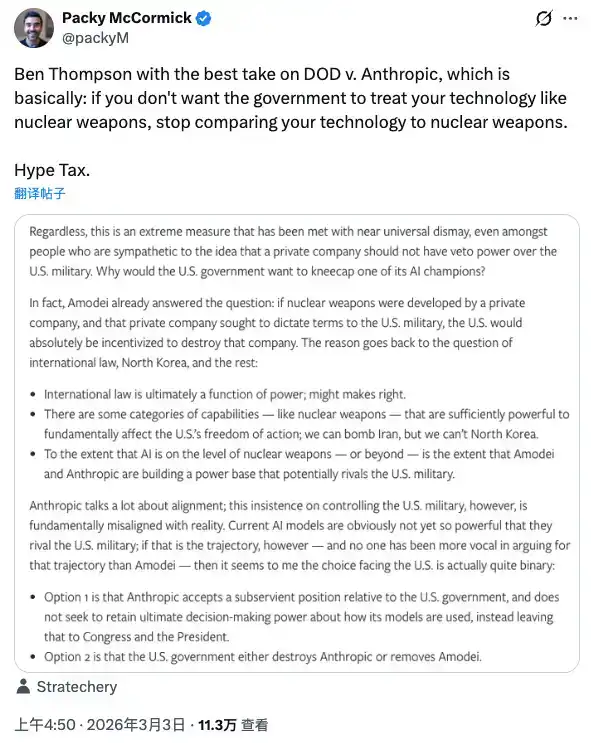

Le commentateur technologique Packy McCormick, pendant la fermentation de cette affaire, a cité un concept de Ben Thompson : Hype Tax. L'idée est que si vous utilisez un récit extrême pour établir votre influence, alors lorsque ce récit rencontre le vrai pouvoir, vous devez en payer le prix. Vous comparez la technologie de l'IA aux armes nucléaires, le gouvernement vous traitera comme il traite les armes nucléaires.

Anthropic a payé le prix de ce récit : perte d'un contrat, classement comme risque de sécurité, mention par le président, exigence de retrait de tous ses produits des systèmes fédéraux dans les six mois.

Mais le même week-end, le même récit a produit un effet complètement opposé dans une autre dimension.

Les utilisateurs ordinaires n'ont pas vu les clauses contractuelles, ni l'interprétation juridique, ni le débat sur la philosophie de sécurité. Ils ont vu : une entreprise a dit non, et s'est fait virer par le gouvernement. Une autre entreprise a dit oui, et a obtenu le contrat. Ils ont fait leur choix avec leur propre cadre de jugement : 295 % de désinstallations en plus, première place sur l'App Store, serveurs en panne.

C'est une rare prise de position morale collective des consommateurs dans l'histoire de l'industrie de l'IA.

Anthropic n'a pas dépensé un centime de budget RP sur cette affaire. La déclaration d'Amodei était mesurée, n'appelant pas les utilisateurs à soutenir, ne nommant pas OpenAI, ne se présentant pas comme un martyr. Mais le résultat s'est produit.

Il y a un détail notable : l'événement qui a poussé les utilisateurs vers Claude était essentiellement qu'OpenAI a fait quelque chose de commercialement tout à fait raisonnable, signer un accord alors qu'un concurrent était interdit et le contrat en suspens, tout en affirmant avoir obtenu les mêmes clauses de protection. Altman a également clairement dit qu'il agissait en partie pour aider à refroidir la situation et prévenir d'autres dommages pour Anthropic.

Quelle que soit la motivation, le résultat est qu'OpenAI a obtenu le contrat, et qu'Anthropic a gagné des utilisateurs. Les deux parties ont payé un prix, les deux parties ont obtenu des gains, mais avec des unités de mesure différentes.

Il y a autre chose qui mérite d'être mentionnée ici.

Le contrat du Pentagone perdu par Anthropic valait environ 200 millions de dollars.

Le chiffre d'affaires annualisé actuel d'Anthropic est de 14 milliards de dollars. L'objectif est d'atteindre 26 milliards de dollars d'ici fin 2026.

Anthropic a terminé le mois dernier un tour de table E de 30 milliards de dollars, avec une valorisation de 380 milliards de dollars.

Ce calcul n'est pas difficile à faire maintenant. Mais une autre question reste sans réponse : lorsque l'IA sera vraiment utilisée à grande échelle pour la prise de décision militaire, ces « garde-fous techniques » écrits dans les contrats et les ingénieurs派驻, pourront-ils vraiment être efficaces, qu'il s'agisse de ceux d'OpenAI ou de ceux qu'Anthropic exigeait initialement.

Cette question ne figure dans aucun contrat public.