Auteur :Lao Bai

Après deux ans, V a de nouveau posté sur Twi, et je profite de ce rapport de recherche d'il y a deux ans pour en parler, même la date est exactement la même, le 10 février. (Lecture connexe : ABCDE : Organisation de l'IA + Crypto depuis la perspective du marché primaire)

Il y a deux ans, V神 avait en fait implicitement exprimé qu'il n'était pas très optimiste concernant les diverses tendances populaires de l'époque sur Crypto Helps AI. À l'époque, les trois piliers populaires dans le cercle étaient la tokenisation de la puissance de calcul, la tokenisation des données et la tokenisation des modèles. Mon rapport de recherche d'il y a deux ans parlait principalement de certains phénomènes et questionnements observés sur le marché primaire concernant ces trois piliers. Du point de vue de V神, il préférait encore AI Helps Crypto.

Les quelques exemples qu'il avait donnés à l'époque étaient respectivement :

- L'IA en tant que participant dans le jeu ;

- L'IA en tant qu'interface de jeu ;

- L'IA en tant que règle du jeu ;

- L'IA en tant qu'objectif du jeu ;

Au cours des deux dernières années, nous avons en fait fait de nombreux essais sur Crypto Helps AI, mais avec des résultats mitigés. De nombreux secteurs et projets se résument à - lancer un token et c'est tout, sans réelle adéquation produit-marché (PMF) commerciale, ce que j'appelle une "illusion de tokenisation".

1. Tokenisation de la puissance de calcul - La plupart ne peuvent pas fournir de SLA de niveau commercial, sont instables, tombent fréquemment en panne. Ne peuvent traiter que des tâches d'inférence de modèles simples et de petite/moyenne taille, servent mostly des marchés de niche, les revenus ne sont pas liés au token......

2. Tokenisation des données - Côté offre (particuliers) : friction élevée, faible volonté, incertitude élevée. Côté demande (entreprises) : besoin de fournisseurs de données professionnels, structurés, avec des dépendances contextuelles, une entité de confiance et une responsabilité légale. Les projets Web3 de type DAO ont du mal à fournir cela.

3. Tokenisation des modèles - Un modèle est en soi un actif processuel, non rare, reproductible, affinable, se dépréciant rapidement, et non un actif final. Hugging Face est lui-même une plateforme de collaboration et de diffusion, plus proche de GitHub pour le ML, que de l'App Store pour les modèles. Ainsi, les tentatives de "Hugging Face décentralisé" pour tokeniser les modèles ont基本上 échoué.

De plus, ces deux dernières années, nous avons essayé diverses formes d'"inférence vérifiable", c'est aussi une histoire typique de chercher un clou pour son marteau. Du ZKML à l'OPML en passant par la théorie des jeux, etc., et même EigenLayer a transformé son récit Restaking en Verifiable AI.

Mais c'est基本ement similaire à ce qui se passe dans le secteur du Restaking - peu d'AVS sont愿意 de payer continuellement pour une sécurité vérifiable supplémentaire.

De même, l'inférence vérifiable vérifie基本ement des "choses que personne n'a vraiment besoin de vérifier", le modèle de menace côté demande est extrêmement flou - qui exactement essaie-t-on de防止?

Les erreurs de sortie de l'IA (problèmes de capacité du modèle) sont bien plus nombreuses que les falsifications malveillantes des sorties de l'IA (problèmes adversariaux). Les divers incidents de sécurité sur OpenClaw et Moltbook récemment l'ont montré, les vrais problèmes viennent de :

- Une stratégie mal conçue

- Trop de permissions accordées

- Des limites mal définies

- Des interactions inattendues entre les outils combinés

- ...

Il n'existe基本ement pas de "modèle falsifié", de "processus d'inférence réécrit malveillamment", ce clou imaginaire.

L'année dernière, j'ai posté cette image, je ne sais pas si des potes s'en souviennent.

Les idées données par V神 cette fois sont明显ement plus mûres que il y a deux ans, aussi grâce aux progrès réalisés dans divers domaines comme la confidentialité, X402, ERC8004, les marchés prédictifs, etc.

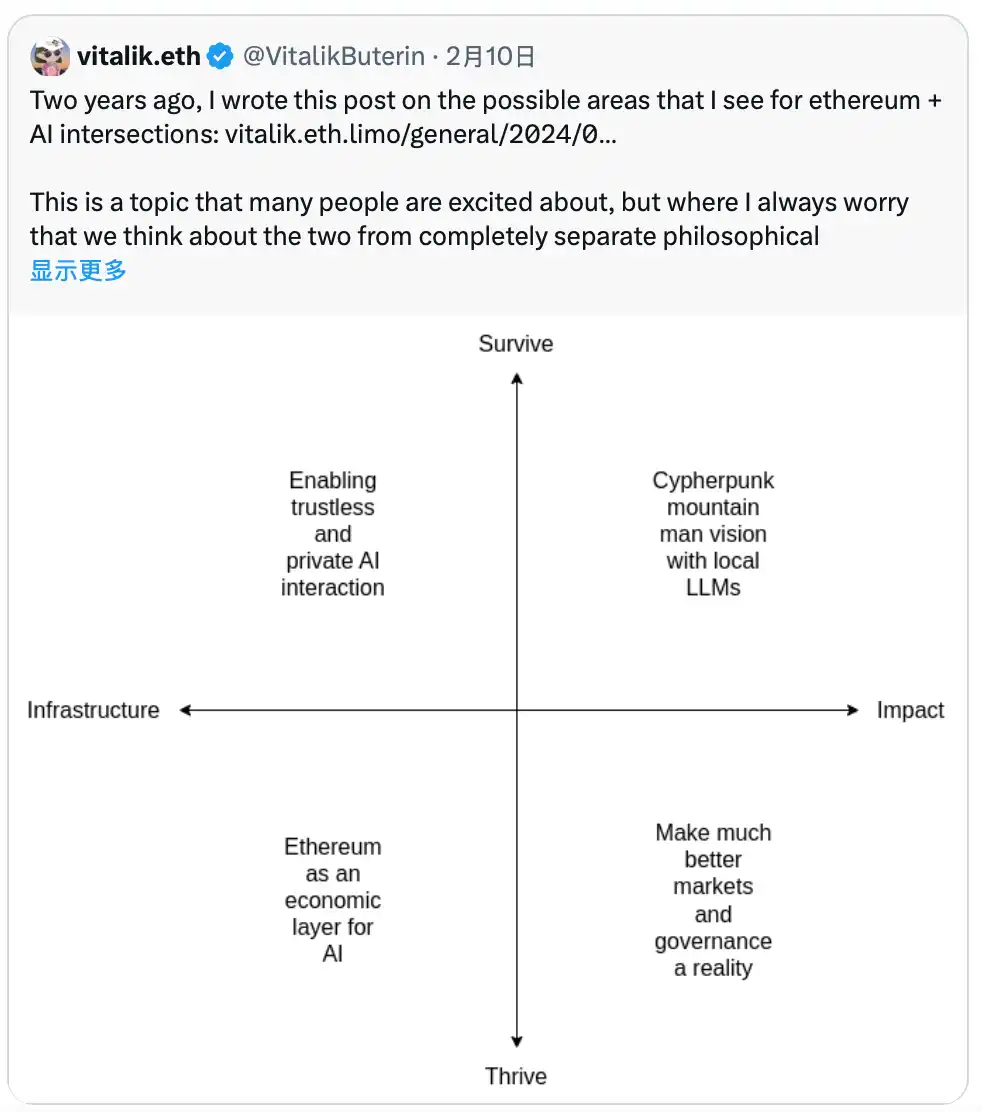

On peut voir que les quatre quadrants qu'il propose cette fois, la moitié appartient à AI Helps Crypto, l'autre moitié à Crypto Helps AI, et non plus comme il y a deux ans où il penchait明显ement vers le premier.

En haut à gauche et en bas à gauche - Utiliser la décentralisation et la transparence d'Ethereum pour résoudre les problèmes de confiance et de collaboration économique de l'IA

1.Activer des interactions IA sans confiance et privées (Infrastructure + Survie) : Utiliser des technologies comme ZK, FHE, etc., pour assurer la confidentialité et la vérifiabilité des interactions IA (je me demande si l'inférence vérifiable dont je parlais plus tôt compte).

2. Ethereum comme couche économique pour l'IA (Infrastructure + Prospérité) : Permettre aux agents IA (Agents) d'effectuer des paiements économiques via Ethereum, de recruter d'autres robots, de payer des cautions ou d'établir un système de réputation, construisant ainsi une architecture IA décentralisée et non limitée à une plateforme unique de géant.

En haut à droite et en bas à droite - Utiliser les capacités intelligentes de l'IA pour optimiser l'expérience utilisateur, l'efficacité et la gouvernance de l'écosystème crypto :

3. Vision Cypherpunk mountain man avec des LLM locaux (Impact + Survie) : L'IA comme "bouclier" et interface de l'utilisateur. Par exemple, un LLM local (grand modèle de langage) peut auditer automatiquement les smart contracts, vérifier les transactions, réduire la dépendance aux interfaces frontales centralisées, garantissant la souveraineté numérique individuelle.

4. Faire de bien meilleurs marchés et une gouvernance une réalité (Impact + Prospérité) : L'IA participant profondément aux marchés prédictifs (Prediction Markets) et à la gouvernance des DAO. L'IA peut être un participant efficace, amplifiant le jugement humain par le traitement à grande échelle de l'information, résolvant divers problèmes de marché et de gouvernance comme le manque d'attention humaine, le coût décisionnel trop élevé, la surcharge informationnelle, l'apathie投票, etc.

Avant, nous voulions疯狂ement que Crypto Help l'IA, V神 était de l'autre côté. Maintenant, nous nous rencontrons enfin au milieu,只是 cela n'a目测 rien à voir avec les XX tokenisés ou quelconque AI Layer1. J'espère qu'en regardant ce post d'aujourd'hui dans deux ans, il y aura de nouvelles directions et surprises.