Le 1er avril, les économistes de la Fed de Saint-Louis, Miguel Faria-e-Castro et Serdar Ozkan, ont publié un billet de blog au titre sobre mais à la conclusion percutante : l'optimisme autour de l'IA est lui-même un facteur d'inflation. Pas à cause de la hausse des factures d'électricité, ni de la pénurie de puces, mais parce que tout le monde croit que l'IA rendra l'avenir meilleur – cette conviction les pousse à dépenser plus dès maintenant.

Le même jour, Fortune a dévoilé une expérience de la Deutsche Bank : ils ont demandé à trois modèles d'IA d'évaluer « l'impact de l'IA sur l'inflation ». La conclusion est que même l'IA elle-même pense qu'elle contribue à la hausse des prix.

Sur les réseaux sociaux, les publications sur la flambée des prix aux États-Unis sont très nombreuses

Ces deux événements mis ensemble pointent vers un cycle plutôt inconfortable : plus les investissements dans l'IA sont importants, plus l'inflation est élevée, plus la baisse des taux est repoussée, plus le coût du financement est élevé – mais les investissements continuent de s'accélérer.

La course aux armements qui ne s'arrête pas

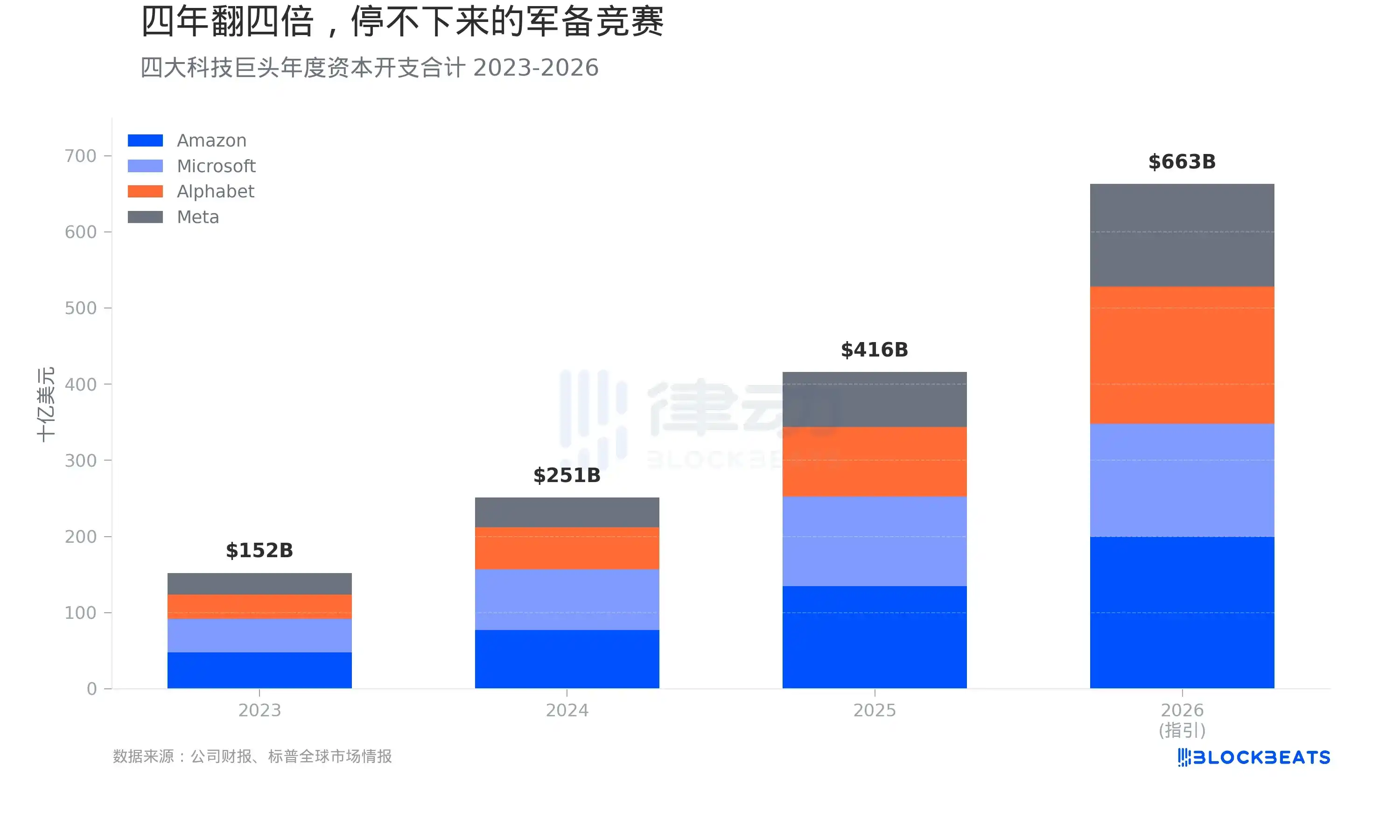

Parlons d'argent. Selon les rapports financiers des entreprises, les dépenses en capital d'Amazon, Microsoft, Google et Meta pour 2023 s'élevaient à environ 152 milliards de dollars. En 2024, ce chiffre est passé à 251 milliards de dollars, une hausse de 65 %. Pour 2025, le montant final s'élève à 416 milliards de dollars, soit une nouvelle hausse de 66 %.

Les prévisions pour 2026 sont encore plus agressives. Selon le résumé de Wolf Street, Amazon prévoit 200 milliards de dollars, Google entre 175 et 185 milliards, Microsoft entre 145 et 150 milliards, et Meta 135 milliards. Les quatre réunis représentent environ 663 milliards de dollars. Si on ajoute les 42 milliards d'Oracle, le total des cinq entreprises approche les 700 milliards de dollars.

En quatre ans, les dépenses en capital de ces quatre entreprises ont quadruplé. Cette vitesse est sans précédent dans l'histoire des entreprises américaines. Selon un reportage de Fortune, cette échelle dépasse déjà le PIB annuel de la Suède.

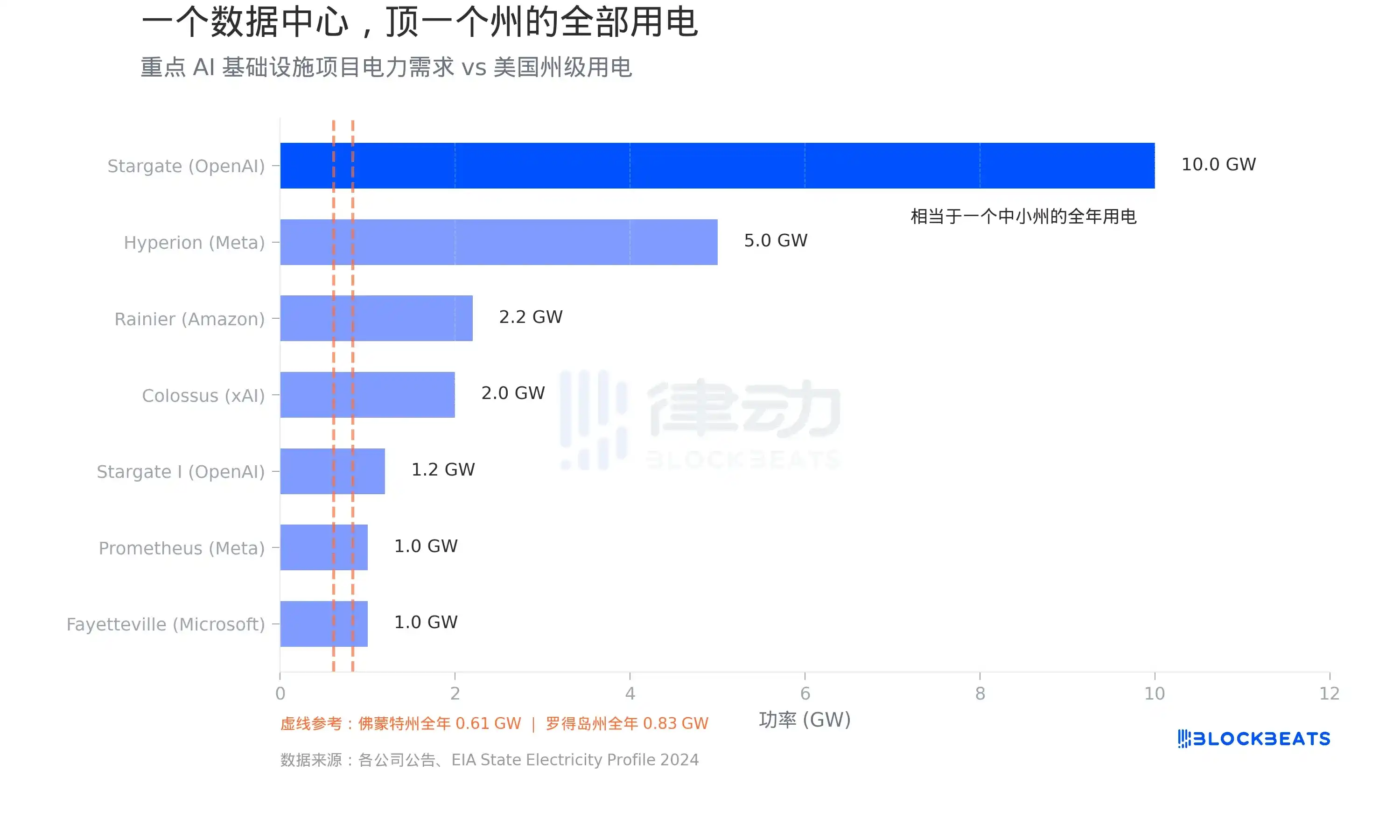

Un centre de données, c'est comme la consommation électrique d'un État entier

La majeure partie de cet argent est dirigée vers les centres de données. Et le plus grand goulet d'étranglement pour un centre de données n'est pas la terre, c'est l'électricité. Selon les données de l'EIA, l'État du Vermont consomme environ 5364 GWh par an, ce qui équivaut à une charge moyenne de 0,61 GW. Le Rhode Island est un peu plus élevé, environ 0,83 GW.

Voyons maintenant ce que font les centres de données. Selon les annonces des entreprises, le projet Stargate, fruit de la collaboration entre OpenAI, Oracle et SoftBank, a une capacité électrique totale planifiée de 10 GW, équivalant à la consommation électrique totale de 16 Vermonts. Le campus Hyperion de Meta en Louisiane est planifié pour 5 GW, avec un investissement de 27 milliards de dollars. Le Colossus de xAI, appartenant à Musk, à Memphis dans le Tennessee, s'est étendu à 2 GW ; selon un reportage d'Introl, 555 000 GPU Nvidia y sont déployés, pour un coût d'environ 18 milliards de dollars. Le projet Rainier, construit conjointement par Amazon et Anthropic dans l'Indiana, est planifié pour 2,2 GW.

Selon les données de S&P Global, la consommation électrique totale des centres de données américains en 2024 était de 183 TWh, représentant plus de 4 % de la consommation nationale d'électricité. D'ici 2030, ce chiffre devrait tripler.

Ces demandes en électricité ne sont pas des histoires lointaines planifiées, elles exercent déjà une pression sur le réseau électrique existant. Selon le rapport de CBRE, le taux d'inoccupation des centres de données en Amérique du Nord est passé de 3,3 % au premier semestre 2023 à 1,6 % au premier semestre 2025, son niveau le plus bas jamais enregistré. Selon les données de Cushman & Wakefield, le taux d'inoccupation a légèrement remonté à 3,5 % au second semestre 2025, mais uniquement en raison de la livraison concentrée d'une grande quantité de nouvelles capacités construites – le niveau absolu reste historiquement bas, et un soulagement significatif de l'offre sera difficile à obtenir avant 2030.

Même l'IA elle-même dit qu'elle pousse à l'inflation

En plus de stimuler la demande, de faire monter les prix de l'électricité et d'aggraver la pénurie de puces, ces investissements empruntent un canal d'inflation plus discret.

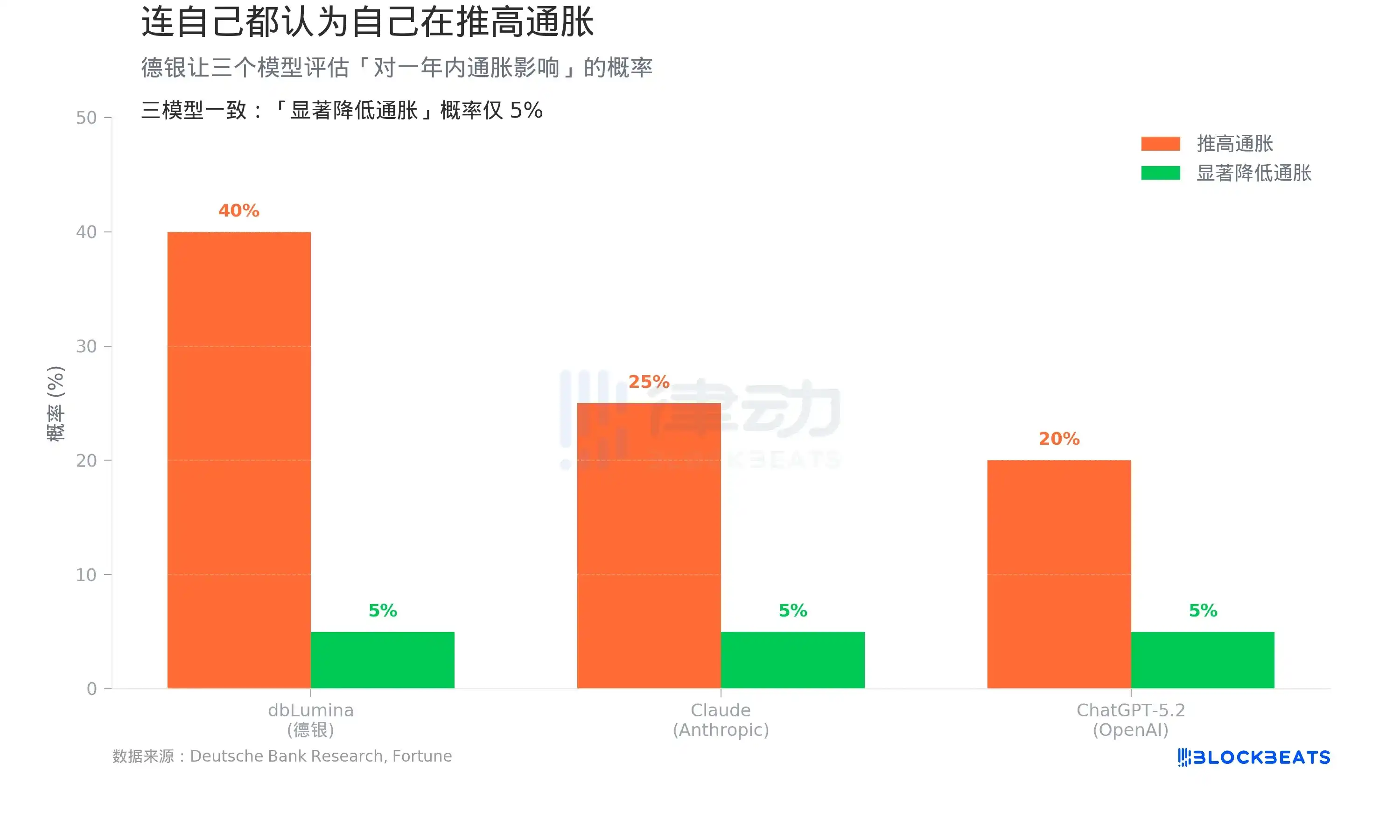

Selon un article de Fortune du 1er avril, une équipe dirigée par Matthew Luzzetti, économiste en chef pour les États-Unis à la Deutsche Bank, a mené une expérience : faire évaluer par trois modèles d'IA – le modèle maison dbLumina de la Deutsche Bank, Claude d'Anthropic et ChatGPT-5.2 d'OpenAI – « la probabilité que l'IA pousse l'inflation à la hausse dans l'année à venir ».

Résultats : dbLumina a donné 40 %, Claude a donné 25 %, ChatGPT-5.2 a donné 20 %. Les trois modèles étaient unanimes sur la probabilité que « l'IA réduise significativement l'inflation » : seulement 5 %.

Les facteurs d'inflation cités par les trois modèles sont très cohérents : les centres de données se développent massivement, la demande de semi-conducteurs monte en flèche, la consommation électrique des charges de travail d'IA croît rapidement – ce sont toutes des pressions sur les prix tirées par la demande.

Ceci va à l'encontre du consensus de certains investisseurs de Wall Street. L'équipe de la Deutsche Bank a écrit dans son rapport de recherche : « L'IA sera-t-elle une force déflationniste majeure ? Même l'IA elle-même ne le pense pas. »

Sur un horizon de cinq ans, les modèles se tournent effectivement vers davantage de possibilités déflationnistes. Mais la probabilité que « l'IA provoque une déflation massive » reste confinée dans la queue de distribution des risques.

L'optimisme lui-même est inflationniste

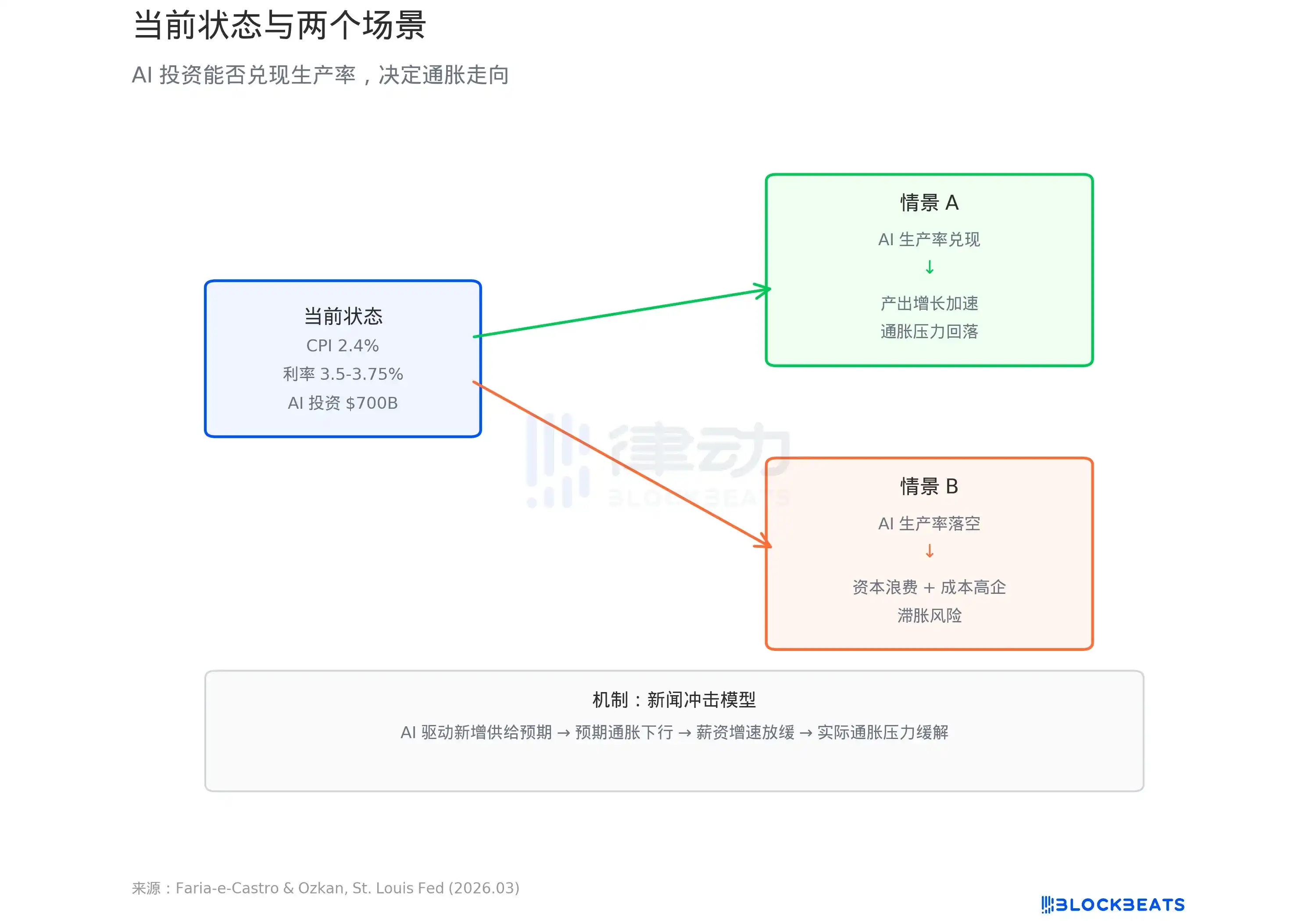

L'article de la Fed de Saint-Louis fournit un cadre théorique pour expliquer tout cela.

Faria-e-Castro et Ozkan utilisent un modèle macroéconomique standard pour définir la frénésie d'investissement dans l'IA comme un « choc de nouvelles » (news shock). Selon le billet de blog de la Fed, la logique du modèle est la suivante : lorsque les ménages voient l'IA décrite comme une technologie révolutionnaire, ils anticipent une hausse de leurs revenus futurs et augmentent leur consommation par anticipation. Les entreprises anticipent une amélioration de la productivité et augmentent leurs investissements. La combinaison des deux fait que la demande dépasse rapidement l'offre. L'article écrit : « Ces forces génèrent ensemble une poussée inflationniste de la demande globale – une caractéristique centrale de la phase initiale d'un choc de nouvelles. »

Le modèle propose deux trajectoires. Si l'IA apporte effectivement un bond de productivité, l'inflation à court terme sera absorbée par la croissance de la production à long terme, et l'économie entrera dans un cercle vertueux. Mais si la productivité ne se concrétise pas – le document utilise le terme de « faible croissance persistante et inflation élevée tenace », c'est-à-dire la stagflation.

Selon les données citées dans le billet de la Fed, le taux de croissance annualisé de la productivité totale des facteurs (PTF) aux États-Unis depuis le lancement de ChatGPT est de 1,11 %, en dessous de la moyenne historique de 1,23 %. Jusqu'à présent, l'IA n'a laissé aucune trace dans les données de productivité.

Dans le même temps, selon les données du BLS, l'IPC américain de février 2026 affichait une hausse de 2,4 % en glissement annuel, et l'IPC core de 2,5 %, aucun des deux n'étant encore revenu à l'objectif de 2 % de la Fed. Le dot plot de la Fed de mars montre une prévision médiane du taux d'intérêt de fin d'année à 3,4 %, indiquant une seule baisse de taux cette année.

700 milliards de dollars se déversent dans les infrastructures d'IA. Que cet argent soit la cause de l'inflation ou le prélude à une révolution de la productivité dépend d'une question à laquelle personne ne peut encore répondre : les modèles qui tournent dans ces centres de données rendront-ils effectivement l'économie plus efficace ?