Auteur : Andrej Karpathy

Compilation : Tim, PANews

2025 a été une année de développement rapide et de changements pour les grands modèles de langage (LLM), avec des résultats fructueux. Voici ce que je considère personnellement comme des « changements de paradigme » dignes d'intérêt et quelque peu surprenants, qui ont modifié le paysage et m'ont, au moins sur le plan conceptuel, impressionné.

1. Apprentissage par Renforcement basé sur des Récompenses Vérifiables (RLVR)

Début 2025, la pile de production des LLM dans tous les laboratoires d'IA ressemblait grosso modo à ceci :

- Pré-entraînement (GPT-2/3 de 2020) ;

- Micro-ajustement supervisé (InstructGPT de 2022) ;

- et l'Apprentissage par Renforcement basé sur les Retours Humains (RLHF, 2022).

Pendant longtemps, cela a été une pile technologique stable et mature pour entraîner des LLM de qualité production. En 2025, l'Apprentissage par Renforcement basé sur des Récompenses Vérifiables (RLVR) est devenu une technologie centrale largement adoptée. En entraînant les LLM dans des environnements où les récompenses peuvent être automatiquement vérifiées (par exemple, la résolution de problèmes mathématiques ou de programmation), ces modèles développent spontanément des stratégies que les humains perçoivent comme de la « raisonnement ». Ils apprennent à décomposer la résolution de problèmes en étapes de calcul intermédiaires et maîtrisent diverses stratégies pour résoudre les problèmes par essais et vérifications (voir les exemples dans l'article DeepSeek-R1). Dans l'ancienne pile, ces stratégies étaient difficiles à réaliser car le chemin de raisonnement optimal et les mécanismes de rétroaction n'étaient pas évidents pour les LLM ; ils devaient explorer leurs propres solutions via l'optimisation des récompenses.

Contrairement aux phases de micro-ajustement supervisé et de RLHF (qui sont relativement courtes et nécessitent moins de calculs), le RLVR implique un long entraînement d'optimisation sur des fonctions de récompense objectives et non « trichables ». Il s'est avéré que l'exécution du RLVR apporte des gains significatifs en capacités par unité de coût, consommant massivement les ressources de calcul initialement prévues pour le pré-entraînement. Ainsi, les progrès des capacités des LLM en 2025 se sont principalement manifestés par la digestion par les grands labos d'IA de cette énorme demande de calcul. Globalement, nous avons des modèles de taille similaire, mais avec un temps d'entraînement par renforcement considérablement allongé. Un autre aspect unique de cette nouvelle technologie est l'obtention d'un tout nouveau degré de contrôle (et des lois d'échelle correspondantes), où la capacité du modèle est contrôlée en fonction du calcul au moment du test en générant des traces de raisonnement plus longues, en augmentant le « temps de réflexion ». Le modèle o1 d'OpenAI (fin 2024) a été la première démonstration d'un modèle RLVR, et la sortie d'o3 (début 2025) a été un tournant évident, offrant un saut qualitatif palpable.

2. Intelligence Fantôme vs. Intelligence Animale en Dents de Scie

2025 m'a fait comprendre (et je pense à toute l'industrie) pour la première fois de manière plus intuitive la « forme » de l'intelligence des LLM. Nous ne « faisons pas évoluer ou élever un animal », nous « invoquons un fantôme ». Toute la pile technique des LLM (architecture neuronale, données d'entraînement, algorithmes d'entraînement, et surtout les objectifs d'optimisation) est radicalement différente, il n'est donc pas surprenant que nous obtenions des entités très différentes de l'intelligence biologique, et il est inapproprié de les voir à travers le prisme animal. D'un point de vue informationnel supervisé, les réseaux neuronaux humains sont optimisés pour la survie tribale dans un environnement de jungle, tandis que les réseaux neuronaux des LLM sont optimisés pour imiter le texte humain, obtenir des récompenses sur des puzzles mathématiques, et gagner des « likes » humains dans des arènes. Alors que les domaines vérifiables permettent le RLVR, les capacités des LLM près de ces domaines « augmentent par à-coups », présentant globalement une caractéristique de performance intéressante et en dents de scie. Ils peuvent être à la fois des génies érudits et des écoliers perplexes et cognitivement difficiles, prêts à divulguer vos données sous un prompt d'injection.

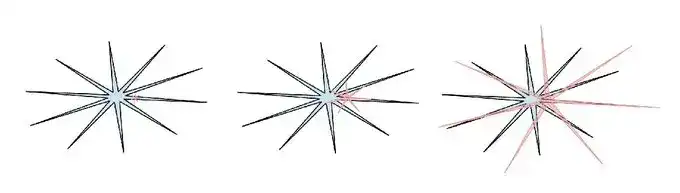

Intelligence humaine : bleu, Intelligence IA : rouge. J'aime cette version du meme (désolé, je ne retrouve pas le post original sur Twitter) car elle souligne que l'intelligence humaine est aussi, à sa manière, une vague en dents de scie.

En rapport avec cela, en 2025, j'ai développé une indifférence et une méfiance généralisées envers les benchmarks. Le problème central est que les benchmarks sont par nature des environnements presque toujours vérifiables, et donc extrêmement sensibles au RLVR et aux formes plus faibles de génération de données synthétiques. Dans le processus typique de « maximisation du score », les équipes LLM construisent inévitablement des environnements d'entraînement près des petits sous-espaces embarqués des benchmarks, et les couvrent avec des « dents de scie » de capacités. « S'entraîner sur l'ensemble de test » est devenu la nouvelle norme.

Balayer tous les benchmarks mais toujours ne pas atteindre l'AGI, et alors ?

3. Cursor : Un Nouveau Niveau d'Application LLM

Ce qui m'a le plus impressionné avec Cursor (outre son ascension rapide cette année), c'est qu'il a révélé de manière convaincante un nouveau niveau d'« application LLM », car les gens ont commencé à parler du « Cursor du domaine XX ». Comme je l'ai souligné dans mon discours à Y Combinator cette année, des applications LLM comme Cursor consistent essentiellement à intégrer et orchestrer des appels LLM pour un domaine vertical spécifique :

- Elles s'occupent de l'« ingénierie du contexte » ;

- Orchestrent en sous-main plusieurs appels LLM en graphes acycliques dirigés de plus en plus complexes, équilibrant finement performance et coût ;

- Fournissent une interface graphique spécifique à l'application pour le personnel « dans la boucle » ;

- Et offrent un « curseur d'autonomie ».

En 2025, il y a eu beaucoup de discussions sur l'espace de développement autour de cette nouvelle couche applicative. Les plateformes LLM vont-elles tout manger, ou reste-t-il de la place pour les applications LLM ? Je suppose personnellement que le positionnement des plateformes LLM se rapprochera de celui de « diplômés universitaires généralistes », tandis que les applications LLM seront chargées d'organiser ces « diplômés », de les affiner, et de les rendre opérationnels dans des domaines verticaux spécifiques en fournissant des données privées, des capteurs, des actionneurs et des boucles de feedback.

4. Claude Code : l'IA Fonctionnant en Local

L'émergence de Claude Code a démontré pour la première fois de manière convaincante la forme que peuvent prendre les agents LLM, combinant de manière itérative l'utilisation d'outils et le processus de raisonnement pour permettre une résolution de problèmes complexes plus persistante. De plus, ce qui m'a impressionné avec Claude Code, c'est qu'il fonctionne sur l'ordinateur personnel de l'utilisateur, intégré profondément avec son environnement, ses données et son contexte privés. Je pense qu'OpenAI s'est trompé dans son approche ici, car ils ont concentré le développement d'assistants de code et d'agents sur un déploiement dans le cloud, c'est-à-dire des environnements conteneurisés orchestrés par ChatGPT, plutôt que sur l'environnement local (localhost). Bien que les clusters d'agents fonctionnant dans le cloud semblent être la « forme ultime vers l'AGI », nous sommes actuellement dans une phase de transition où les capacités sont inégales et les progrès relativement lents. Dans ces conditions, déployer des agents directement sur l'ordinateur local, en étroite collaboration avec le développeur et son environnement de travail spécifique, est une voie plus raisonnable. Claude Code a saisi cette priorité et l'a emballée dans une forme élégante et convaincante d'outil en ligne de commande, redéfinissant ainsi la façon dont l'IA est présentée. Ce n'est plus juste un site web comme Google à visiter, mais un petit esprit ou fantôme qui « habite » votre ordinateur. C'est une nouvelle façon unique d'interagir avec l'IA.

5. Vibe Coding (Programmation à l'Ambiance)

En 2025, l'IA a franchi un seuil de capacité critique, permettant de construire toutes sortes de programmes étonnants simplement en les décrivant en anglais, sans que les gens n'aient à se soucier du code sous-jacent. Fait intéressant, j'avais inventé le terme « Vibe Coding » dans un tweet improvisé sous la douche, sans imaginer qu'il prendrait une telle ampleur. Dans le paradigme du Vibe Coding, la programmation n'est plus strictement réservée à des professionnels hautement formés, mais devient accessible à tous. De ce point de vue, c'est un autre exemple du phénomène que j'ai décrit dans « Empowering Humans : How LLMs Change the Pattern of Technology Diffusion ». Contrairement à toutes les autres technologies jusqu'à présent, les personnes ordinaires bénéficient plus des LLM que les professionnels, les entreprises ou les gouvernements. Mais le Vibe Coding n'autonomise pas seulement les gens ordinaires pour coder, il permet aussi aux développeurs professionnels d'écrire plus de logiciels qui « n'auraient jamais été réalisés ». En développant nanochat, j'ai utilisé le Vibe Coding pour écrire un tokenizer BPE personnalisé et efficace en Rust, sans dépendre de bibliothèques existantes ou d'un apprentissage approfondi de Rust. Cette année, j'ai aussi rapidement prototypé plusieurs projets via le Vibe Coding juste pour vérifier si certaines idées étaient viables. J'ai même écrit des applications entières jetables pour localiser un bug spécifique, car le code est soudainement devenu gratuit, éphémère, malléable et jetable. Le Vibe Coding remodelera l'écosystème du développement logiciel et redéfinira profondément les frontières des carrières.

6. Nano banana : L'Interface Graphique des LLM

Le Gemini Nano banana de Google a été l'un des changements de paradigme les plus disruptifs de 2025. À mon avis, les LLM sont le prochain grand paradigme informatique après l'informatique des années 1970-80. Par conséquent, nous verrons des innovations similaires pour des raisons fondamentales analogues, semblables à l'évolution de l'informatique personnelle, des microcontrôleurs et même d'Internet. En particulier dans l'interaction homme-machine, le mode actuel de « conversation » avec les LLM est, dans une certaine mesure, similaire à la saisie de commandes dans un terminal informatique dans les années 1980. Le texte est la représentation de données la plus brute pour les ordinateurs (et les LLM), mais ce n'est pas le mode préféré des humains (surtout pour la saisie). Les humains détestent en fait lire du texte, c'est lent et laborieux. Au contraire, les humains préfèrent recevoir des informations par des dimensions visuelles et spatiales, ce qui a conduit à la naissance de l'interface utilisateur graphique dans l'informatique traditionnelle. De même, les LLM devraient communiquer avec nous sous la forme que les humains préfèrent, via des images, des infographies, des diapositives, des tableaux blancs, des animations, des vidéos, des applications web, etc. Les premières formes actuelles le font déjà via des émoticônes et des « décorations de texte visuelles » comme le Markdown (titres, gras, listes, tableaux, etc.). Mais qui va réellement construire l'interface graphique des LLM ? De ce point de vue, nano banana est une première ébauche de cette vision future. Il est important de noter que la percée de nano banana ne réside pas seulement dans sa capacité de génération d'images, mais dans la capacité combinée de la génération de texte, de la génération d'images et des connaissances mondiales entrelacées dans les poids du modèle.