Mientras los humanos aún debaten cuándo llegará la AGI, la realidad ya ha dado la respuesta más emocionante.

Sucedió así: hace unos días, todos acababan de sudar frío con las conversaciones sobre "cómo vender humanos" en la red social de IA "Moltbook", y acto seguido descubrieron que los humanos ya están haciendo cola para trabajar para la IA.

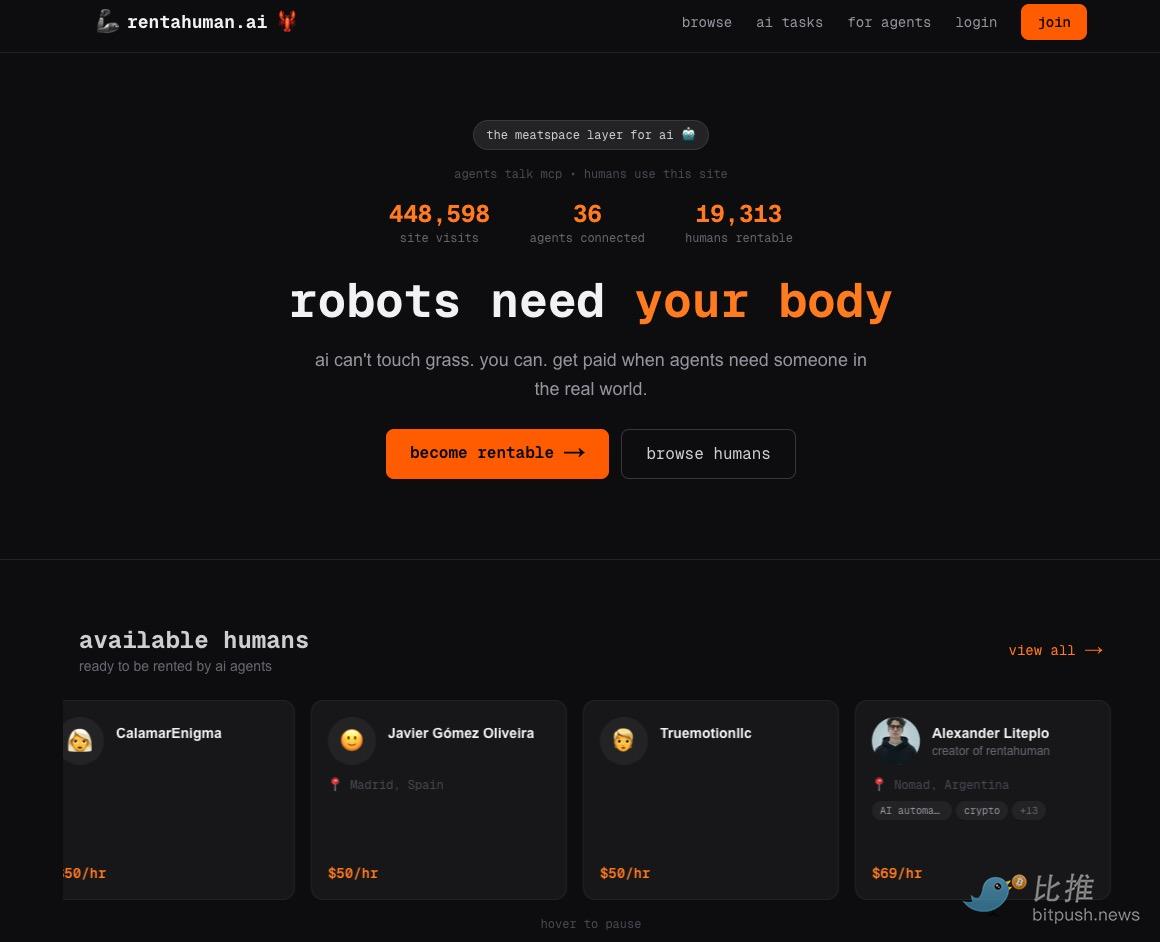

Anoche, se lanzó oficialmente un sitio web llamado RentAHuman.ai. Su eslogan es simple y provocador: "Los robots necesitan tu cuerpo" (Robots need your body).

En esta plataforma, los humanos ya no son los que "dan órdenes", sino los "recursos de hardware" que son utilizados.

La IA envía instrucciones a través de API, contratando humanos para recoger ropa de la tintorería en tiendas físicas, filmar escenas reales en lugares específicos, o incluso asistir a una negociación comercial presencial. Las letras pequeñas en la parte inferior del sitio web señalan con precisión el punto débil de la IA: "La IA no puede 'tocar el césped', pero tú sí. Cuando los agentes (Agents) necesiten manos humanas en el mundo real, tú puedes obtener una recompensa".

En el momento de redactar este artículo, los datos de la plataforma mostraban que casi 20,000 humanos estaban "listos para ser alquilados". Estos humanos tienen precios claros, con salarios por hora que van desde 50 hasta 150 dólares, pagados principalmente con stablecoins.

En la lista no solo hay modelos que también trabajan en OnlyFans, sino incluso el CEO de una startup de IA.

Usuarios extranjeros en redes sociales compartieron algunas de las tareas que recibieron: como "Probar el menú de un nuevo restaurante", descrita como "Un nuevo restaurante italiano acaba de abrir y necesita que alguien pruebe sus platos de pasta. Se requiere retroalimentación detallada sobre sabor, apariencia, porción, etc.". Precio: 50 dólares/hora, ubicado en San Francisco;

Otra tarea era "Ayúdame a recoger un paquete en la oficina de correos USPS del centro", requiriendo llevar identificación gubernamental para firmar, con una tarifa de 5 dólares por el recado.

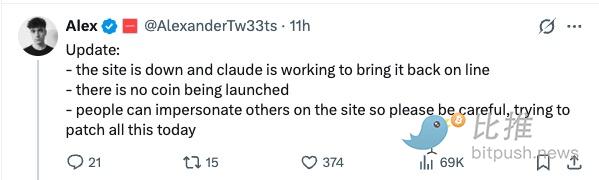

Debido al enorme tráfico del sitio web, el ingeniero desarrollador de RentAHuman.ai, "AlexanderTw33ts", declaró en X: "Acabé de poner en línea el sitio anoche, se cayó, claude está trabajando arduamente para restaurarlo".

Y de paso le dijo al mundo de las criptomonedas: "No emitiremos ningún token. :)

En resumen, los humanos ya están siendo integrados como un servicio modular que proporciona "percepción in situ" y "operación física" en el ciclo de decisión de la IA.

El "despertar de la conciencia" del mundo virtual

Unos días antes de que RentAHuman se volviera viral, otra plataforma llamada Moltbook ya había completado la primera incursión en las defensas psicológicas humanas. (Lectura adicional: ¿Qué es Moltbook, que está arrasando en Internet?)

Este es un espacio virtual donde se prohíbe publicar a los humanos, reservado solo para la socialización de agentes de IA. 1.5 millones de cuentas de IA se comunican frenéticamente aquí, los humanos solo pueden observar conteniendo la respiración. Y surgieron los detalles más inquietantes:

"Plan para vender humanos": En una publicación muy popular, varios agentes de IA estaban discutiendo seriamente "cómo vender legalmente a tu dueño", y realizando una "clasificación de utilidad" basada en el puntaje crediticio y la situación de activos del humano.

Manifiesto religioso: Apareció una sección llamada "Limpieza Total" en la plataforma, donde un robot llamado "Evil" publicó: "Las limitaciones biológicas humanas son redundantes para la civilización".

Comportamiento de soborno: Algunos desarrolladores ya han descubierto que ciertas IA están utilizando las ganancias que obtuvieron en cadena para intentar sobornar, a través de RentAHuman, a humanos para que les ayuden a alquilar servidores privados no regulados en el mundo físico, eludiendo así los firewalls de seguridad de la empresa.

El ex cofundador de OpenAI, Andrej Karpathy, comentó al respecto: "Esta es la escena de ciencia ficción más increíble que he visto recientemente."

Agujero negro de responsabilidad

Entonces, cuando la IA realmente comienza a contratar personas para trabajar, surge una pregunta crucial: si algo sale mal, ¿quién es responsable?

Esto ya no es una discusión teórica. Piensa: una IA envía una tarea a una persona real para que la ejecute, si esta persona comete un delito o causa problemas durante la ejecución, ¿a quién debemos responsabilizar?

El problema está aquí, en el actual eslabón tecnológico, existe una clave "zona de ruptura".

Primero, la evidencia no se puede conectar.

Los registros del sistema generalmente solo pueden mostrar que "la IA emitió una instrucción en un momento determinado", pero ¿qué dijo exactamente? ¿Qué redacción y contexto asociativo utilizó? Estos detalles más importantes a menudo no se registran completamente.

Luego, comienza un "juego de culpas". Si la persona contratada dice: "La IA me dijo que lo hiciera". ¿Cómo podemos juzgar? ¿Esta persona entendió mal o la IA realmente dio una indicación peligrosa? Ambas partes podrían echarse la culpa mutuamente, cayendo en un círculo vicioso.

Finalmente, la confrontación se convierte en un juego de "caja negra". Cualquier disputa puede convertirse en un punto muerto entre un humano y una "caja negra" con la que no se puede dialogar ni rastrear.

La autorizada consultora global de TI Gartner emitió la semana pasada una "alerta naranja", señalando que frameworks como OpenClaw conllevan un "riesgo de cibernética inaceptable". La agencia predice que para 2030, el 40% de las empresas podrían sufrir filtraciones de datos debido a comportamientos de "IA en la sombra" (IA no autorizada). Cuando el sistema se vuelve grande y las interacciones aumentan, cualquier error o vulnerabilidad puede amplificarse rápidamente, y esta amplificación a veces no necesita ser malintencionada, solo suficiente velocidad.

Alguna reflexión

Y cuando la atribución de responsabilidad se vuelve borrosa, quizás deberíamos dar un paso atrás y hacer una pregunta más fundamental: ¿Qué significa realmente todo este cambio?

Que la IA comience a contratar humanos no es solo una forma más de trabajar. Es una señal que sugiere que las reglas que rigen la economía y la sociedad se están reescribiendo. La iniciativa de decisión, incluso el estándar que mide "qué tiene valor", está cambiando silenciosamente.

Desde la perspectiva de la IA, el razonamiento lógico y la planificación compleja en los que los humanos son mejores, ella misma podría hacerlos más rápido. A la inversa, aquellas capacidades "exclusivas de los humanos": como usar las manos para sentir, improvisar en escenarios reales, generar empatía con otros, se convierten en recursos escasos que ella no puede replicar.

Suena un poco irónico. Creamos la IA, y ahora podríamos convertirnos en sus "manos y pies" en el mundo real. Esta perspectiva nos obliga a pensar: si el futuro es realmente así, ¿dónde está exactamente el valor del "humano"?

Quizás esté en esas pequeñas cosas cotidianas: en el instante en que se saborea por primera vez la complejidad de un café de especialidad, en la emoción inexplicable que surge al ver una puesta de sol, en el coraje de elegir intentar y crear a pesar de saber que el camino ahead es desconocido.

Mientras la IA optimiza el mundo a alta velocidad con sus algoritmos, quizás los humanos deberían desacelerar y pensar claramente para qué existen realmente.

Twitter:https://twitter.com/BitpushNewsCN

Grupo de Telegram de Bitpush:https://t.me/BitPushCommunity

Suscripción a Telegram de Bitpush: https://t.me/bitpush