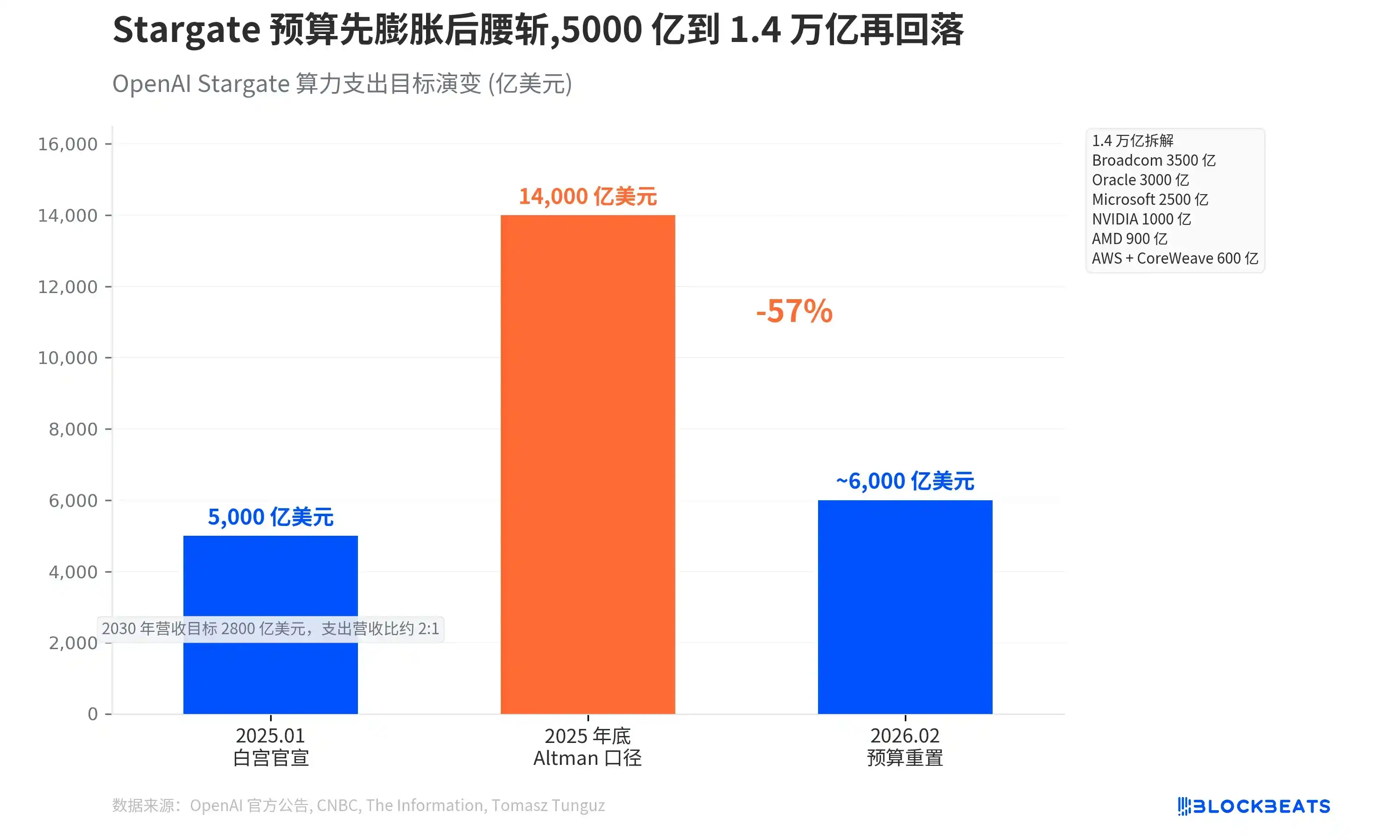

1 400 milliards de dollars. C'est le montant total présenté par le PDG d'OpenAI, Sam Altman, aux investisseurs fin 2025 pour le projet d'infrastructure de calcul Stargate. Quatorze mois plus tard, ce chiffre a été réduit à 600 milliards.

Selon un rapport de The Information du 16 mars, OpenAI a restructuré en profondeur le projet d'infrastructure de calcul Stargate, abandonnant son plan de construire ses propres centres de données pour se tourner entièrement vers la location de puissance de calcul auprès de fournisseurs de services cloud comme Microsoft Azure, Oracle et Amazon AWS. Stargate a été divisé en trois équipes fonctionnelles, toutes supervisées par Sachin Katti, ancien directeur technique et IA d'Intel.

La raison directe de ce changement est simple. Stargate a été annoncé en grande pompe à la Maison Blanche en janvier 2025, avec la création d'une coentreprise avec SoftBank et Oracle pour construire de grands centres de données, avec un investissement initial de 100 milliards de dollars et un investissement total de 500 milliards de dollars sur quatre ans. Mais plus d'un an après son lancement, aucun employé n'a été embauché et aucun centre de données n'a été concrètement développé. Selon CNBC, les prêteurs étaient réticents à fournir des milliards de dollars de financement pour la construction à une entreprise affichant toujours des pertes d'exploitation colossales. OpenAI a également mis fin plus tôt ce mois-ci aux négociations pour l'extension de Stargate avec Oracle à Abilene, au Texas.

Plus d'un an, zéro employé, zéro chantier ouvert. La voie de la « construction propre » de Stargate n'a jamais vraiment démarré.

Selon les données détaillées figurant dans les documents destinés aux investisseurs, l'engagement total de 1 400 milliards de dollars mentionné par Altman était réparti entre sept fournisseurs. Selon l'analyse des documents d'investisseurs par l'analyste en capital-risque Tomasz Tunguz, Broadcom représentait 350 milliards de dollars, Oracle 300 milliards, Microsoft 250 milliards, NVIDIA 100 milliards, AMD 90 milliards, AWS et CoreWeave combinés 60 milliards.

En février 2026, selon CNBC, ce chiffre a été ramené à environ 600 milliards de dollars (d'ici 2030), une réduction de 57%. Le même article donne un chiffre légèrement différent mais allant dans le même sens : OpenAI prévoit de dépenser 665 milliards de dollars en serveurs cloud d'ici 2030.

600 milliards de dollars reste un chiffre qui nécessite un point de comparaison pour être appréhendé. Selon les prévisions internes d'OpenAI, l'objectif de chiffre d'affaires de la société pour 2030 est de 280 milliards de dollars, ce qui signifie un ratio dépenses cumulées sur cinq ans / chiffre d'affaires d'environ 2:1. Et selon les données financières internes citées par ainvest, les pertes prévues de cette société pour 2026 sont de 14 milliards de dollars, et selon plusieurs médias, sa marge brute n'est que de 33% (Note : la marge brute reflète la rentabilité intrinsèque du produit, tandis que la perte nette est le résultat final après déduction de tous les coûts, y compris la R&D et la gestion ; les deux peuvent coexister).

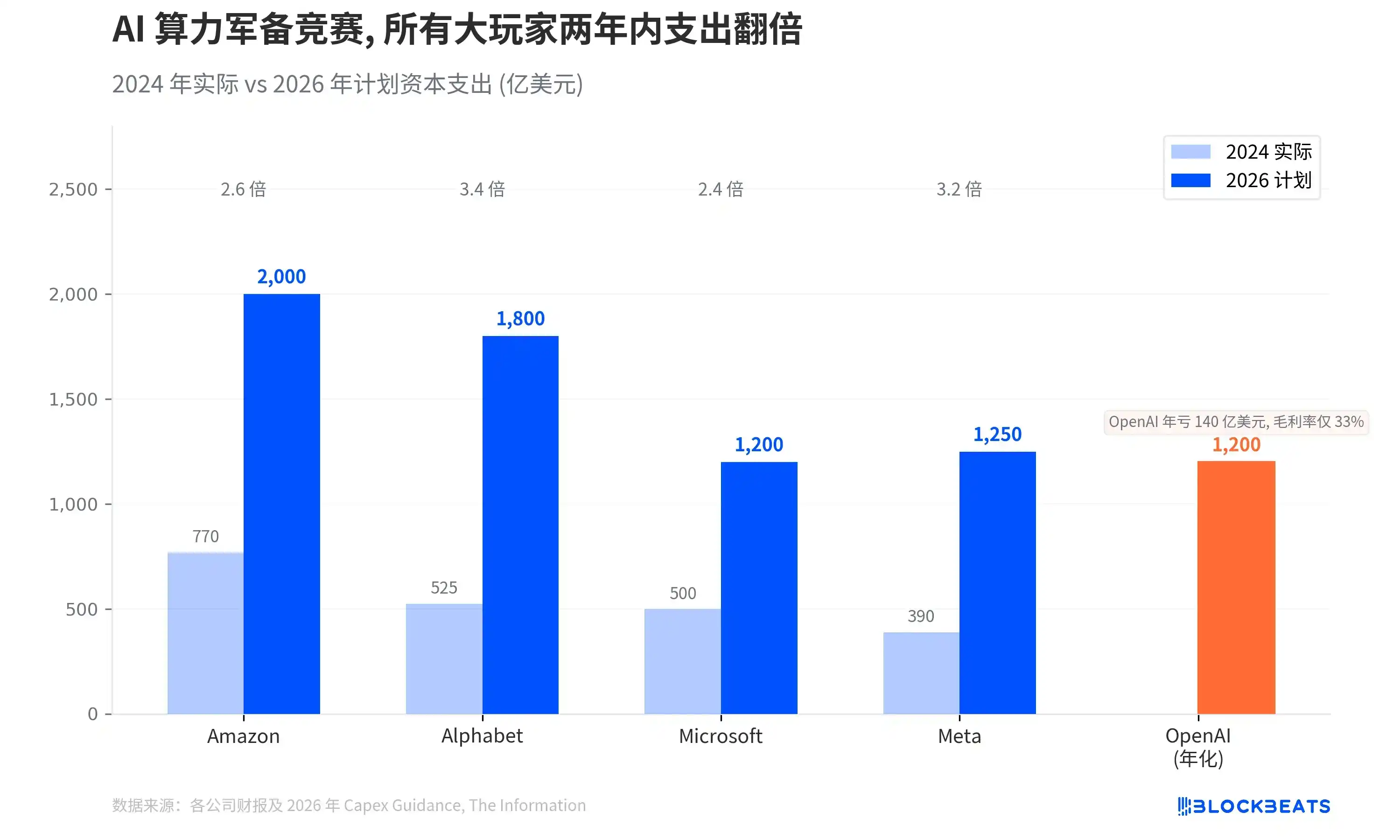

En plaçant l'objectif de dépenses d'OpenAI dans le panorama plus large de la course aux armements en matière de calcul des Big Tech, les rapports de proportion deviennent plus clairs.

Selon les rapports financiers et les prévisions publiques (Guidance) des différentes entreprises, Amazon prévoit des dépenses en capital (capex) de 200 milliards de dollars en 2026, Alphabet 180 milliards, Meta 125 milliards, Microsoft environ 120 milliards. Les dépenses de ces quatre entreprises ont généralement doublé ou triplé en deux ans, dépassant 650 milliards de dollars au total, dont environ les trois quarts sont destinés aux infrastructures d'IA.

Les 600 milliards de dollars d'OpenAI sont un objectif cumulé sur cinq ans, soit environ 120 milliards de dollars annualisés, ce qui est comparable aux dépenses en capital annuelles de Microsoft. La différence est que le chiffre d'affaires annuel de Microsoft dépasse 240 milliards de dollars, tandis que celui d'OpenAI atteint tout juste 25 milliards de dollars annualisés, et la société ne prévoit pas de générer des flux de trésorerie positifs avant 2030.

La restructuration de Stargate ne se limite pas à un changement de chiffres budgétaires ; l'ajustement de la structure organisationnelle révèle un changement d'orientation plus profond.

Le Stargate restructuré est divisé en trois axes. Le groupe Epic Commerce & Partnerships, dirigé par Peter Hoeschele, un vétéran d'OpenAI et ancien manager chez Deloitte, est responsable de la gestion des contrats cloud avec Microsoft, Oracle, Amazon ainsi que des transactions avec les fabricants de puces. Ces transactions incluent un contrat pluriannuel avec AMD (utilisant jusqu'à 6 gigawatts de puces, pour un coût maximal de 10% des actions ordinaires d'AMD) et un accord avec la startup de puces Cerebras Systems.

Le groupe Technique, Ingénierie & Conception est co-dirigé par Chris Malone, ancien ingénieur chez Meta et Google, et Adrian Caulfield, ancien responsable de l'ingénierie chez Microsoft. Il est chargé de reconcevoir les clusters de serveurs IA utilisés par OpenAI. Le groupe Exploitation des Installations Physiques est dirigé par Nick Saddock, ancien directeur des centres de données chez Google, qui remplace Keith Heyde parti il y a quelques semaines.

L'équipe semi-conducteurs, dirigée par l'ancien cadre supérieur de Google, Richard Ho, ne relève pas de Katti et rend compte directement au président d'OpenAI, Greg Brockman. Cette équipe collabore avec Broadcom pour développer ses propres puces, OpenAI espérant que ces puces permettront finalement de réduire les coûts d'inférence pour exécuter des produits comme ChatGPT.

Le nom « Stargate » est toujours là, mais ce qu'il désigne a complètement changé. En janvier 2025, c'était un projet de coentreprise avec SoftBank et Oracle pour construire des centres de données. En mars 2026, c'est la stratégie générale d'OpenAI pour mettre en ligne une capacité de serveurs de l'ordre du gigawatt. On est passé de « Je vais construire ma propre centrale électrique » à « Je vais signer les meilleurs contrats de location ». La capacité totale planifiée de tous les sites reste de près de 7 gigawatts, avec un investissement total sur trois ans dépassant toujours 400 milliards de dollars. OpenAI recentre désormais sa stratégie de puissance de calcul sur la plateforme Vera Rubin de NVIDIA, avec pour objectif de mettre en ligne sa première capacité de l'ordre du gigawatt au second semestre 2026.